Apple Đối Mặt với Một Sợi Dây An Ninh để Phát Hiện Lạm Dụng Trẻ em trong iCloud

Trong nhiều năm qua, các công ty công nghệ đã đấu tranh giữa hai chủ nghĩa: nhu cầu mã hóa dữ liệu người dùng để bảo vệ quyền riêng tư và nhu cầu phát hiện các loại lạm dụng tồi tệ nhất trên nền tảng của họ. Bây giờ Apple đang giới thiệu một hệ thống mật mã mới nhằm mục tiêu giữa những yếu tố đó, phát hiện hình ảnh lạm dụng trẻ em được lưu trữ trên iCloud mà không—lí thuyết là—đưa ra các hình thức xâm phạm quyền riêng tư mới. Trong việc làm này, nó cũng tạo ra một khe giữa các chuyên gia về quyền riêng tư và mật mã, những người coi công việc của nó là một giải pháp sáng tạo mới và những người coi đó là sự nhượng bộ nguy hiểm cho giám sát của chính phủ.

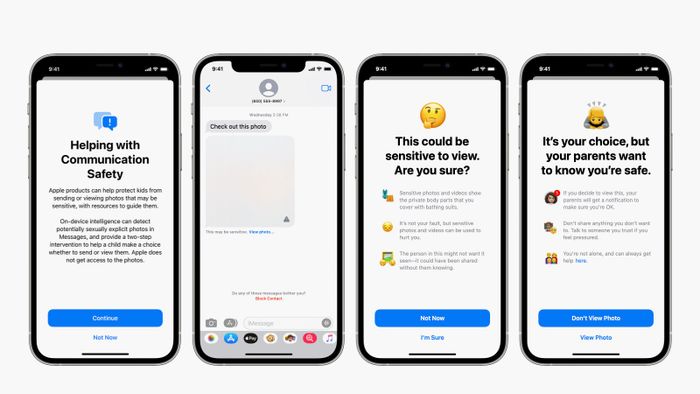

Hôm nay, Apple giới thiệu một loạt các biện pháp công nghệ mới trong iMessage, iCloud, Siri và tìm kiếm, tất cả đều được công ty cho là được thiết kế để ngăn chặn lạm dụng trẻ em. Cài đặt mới tùy chọn trong tài khoản iCloud gia đình sẽ sử dụng học máy để phát hiện sự trần trụi trong các hình ảnh được gửi trong iMessage. Hệ thống cũng có thể chặn những hình ảnh đó từ việc gửi hoặc nhận, hiển thị cảnh báo và trong một số trường hợp thông báo cho bố mẹ rằng một đứa trẻ đã xem hoặc gửi chúng.

Nhưng trong tính năng mới đầy sáng tạo và gây tranh cãi nhất của Apple, iPhone, iPad và Macs sẽ bây giờ tích hợp một hệ thống mới kiểm tra hình ảnh được tải lên iCloud ở Mỹ để kiểm tra hình ảnh lạm dụng trẻ em đã biết. Tính năng đó sẽ sử dụng quy trình mật mã hóa diễn ra một phần trên thiết bị và một phần trên máy chủ của Apple để phát hiện những hình ảnh đó và báo cáo chúng cho Trung tâm Quốc gia về Trẻ em Lạc và Bị Lạm Dụng, hoặc NCMEC, và cuối cùng là cảnh sát Mỹ.

Apple lập luận rằng không có tính năng mới nào trong việc xử lý CSAM đe dọa quyền riêng tư người dùng—rằng thậm chí cơ chế phát hiện iCloud sẽ sử dụng mật mã thông minh để ngăn cơ chế quét của Apple truy cập bất kỳ hình ảnh nào mà không phải là CSAM. Hệ thống được thiết kế phối hợp với nhà mật mã học của Đại học Stanford, Dan Boneh, và thông báo của Apple về tính năng này bao gồm sự ủng hộ từ một số chuyên gia mật mã nổi tiếng khác.

“Tôi tin rằng hệ thống Apple PSI cung cấp sự cân bằc tốt giữa quyền riêng tư và tiện ích, và sẽ hữu ích cực kỳ trong việc xác định nội dung CSAM trong khi duy trì mức cao quyền riêng tư người dùng và giảm thiểu sai lầm,” Benny Pinkas, một nhà mật mã tại Đại học Bar-Ilan ở Israel, người đã xem xét hệ thống của Apple, viết trong một tuyên bố gửi tới MYTOUR.

Nhóm an toàn trẻ em, từ phía họ, ngay lập tức cũng hoan nghênh các động đồ của Apple, lập luận rằng chúng tạo ra sự cân bằc cần thiết, "đưa chúng ta gần hơn một bước đến công lý cho những người sống sót những khoảnh khắc đau đớn nhất của họ được phổ biến trực tuyến," Julie Cordua, CEO của nhóm đấu tranh cho an toàn trẻ em Thorn, viết trong một tuyên bố gửi tới MYTOUR.

Các nhà cung cấp lưu trữ đám mây khác, từ Microsoft đến Dropbox, đã thực hiện quét hình ảnh được tải lên máy chủ của họ. Nhưng bằng cách thêm bất kỳ phân tích hình ảnh nào vào các thiết bị người dùng, một số nhà phê bình về quyền riêng tư lập luận, Apple cũng đã tiến một bước tiến gần đến một hình thức giám sát mới đầy lo ngại và đã làm suy giảm tư thế quyền riêng tư mạnh mẽ lịch sử của mình trước áp lực từ lực lượng chức năng.

“Tôi không bảo vệ lạm dụng trẻ em. Nhưng ý tưởng rằng thiết bị cá nhân của bạn liên tục quét và giám sát bạn dựa trên một số tiêu chí về nội dung không chấp thuận và báo cáo điều đó đến các cơ authorities chức là một dốc rất, rất nguy hiểm,” nói Nadim Kobeissi, một nhà mật mã học và người sáng lập công ty phần mềm mật mã Symbolic Software có trụ sở tại Paris. “Chắc chắn tôi sẽ chuyển sang một điện thoại Android nếu điều này tiếp tục.”

Hệ thống mới của Apple không phải là một quét trực tiếp của hình ảnh người dùng, trên thiết bị của công ty hoặc trên máy chủ iCloud của nó. Thay vào đó, đó là một phân tích hình ảnh mới thông minh—và phức tạp—được thiết kế để ngăn Apple từng nhìn thấy những bức ảnh đó trừ khi chúng đã được xác định là một phần của bộ sưu tập nhiều hình ảnh CSAM được người dùng tải lên. Hệ thống này lấy một "hash" của tất cả các hình ảnh mà người dùng gửi đến iCloud, chuyển đổi các tệp thành chuỗi ký tự được tạo ra duy nhất từ những hình ảnh đó. Sau đó, giống như các hệ thống phát hiện CSAM cũ như PhotoDNA, nó so sánh chúng với một bộ sưu tập lớn các hash hình ảnh CSAM đã biết được cung cấp bởi NCMEC để tìm bất kỳ sự khớp nào.

Apple cũng đang sử dụng một dạng mới của hashing mà nó gọi là NeuralHash, theo công ty nói có thể so sánh hình ảnh mặc dù có sự thay đổi như cắt hoặc màu sắc. Quan trọng như vậy để ngăn chặn sự tránh né, hệ thống của nó thực sự không bao giờ tải những hash NCMEC đó xuống thiết bị người dùng. Thay vào đó, nó sử dụng một số thủ thuật mật mã để chuyển đổi chúng thành một cơ sở dữ liệu mù được tải xuống điện thoại hoặc máy tính của người dùng, chứa chuỗi ký tự có vẻ vô nghĩa được tạo ra từ những hash đó. Điều này ngăn chặn bất kỳ người dùng nào lấy được các hash và sử dụng chúng để né tránh hệ thống phát hiện.

Hệ thống sau đó so sánh cơ sở dữ liệu mù của các hash đó với các hình ảnh được băm trên thiết bị người dùng. Kết quả của những so sánh đó được tải lên máy chủ của Apple trong điều công ty gọi là một “phiếu an toàn” được mã hóa ở hai lớp. Lớp mã hóa đầu tiên được thiết kế để sử dụng một kỹ thuật mật mã được biết đến là giao của tập hợp quyền riêng tư, sao cho nó chỉ có thể được giải mã nếu so sánh hash tạo ra một sự khớp. Không có thông tin nào được tiết lộ về các hash không khớp.

Lớp mã hóa thứ hai được thiết kế để những sự khớp này chỉ có thể được giải mã nếu có một số lượng nhất định các sự khớp. Apple nói rằng điều này được thiết kế để tránh sai lạc và đảm bảo rằng nó đang phát hiện toàn bộ bộ sưu tập CSAM, không phải chỉ là hình ảnh đơn lẻ. Công ty từ chối tiết lộ ngưỡng của mình cho số lượng hình ảnh CSAM mà nó đang tìm kiếm; thực tế, nó có thể sẽ điều chỉnh ngưỡng đó theo thời gian để điều chỉnh hệ thống của mình và giữ cho sai lạc của mình dưới mức ít hơn một tỷ. Những biện pháp an toàn này, Apple lập luận, sẽ ngăn chặn bất kỳ lạm dụng giám sát nào của cơ chế phát hiện CSAM iCloud của nó, cho phép nó xác định bộ sưu tập hình ảnh lạm dụng trẻ em mà không bao giờ nhìn thấy bất kỳ hình ảnh nào khác mà người dùng tải lên iCloud.

Quá trình kỹ thuật vô cùng này đại diện cho một chuỗi các hoạt động kỳ lạ để thực hiện khi Apple hiện tại không mã hóa đầu cuối hình ảnh iCloud, và có thể đơn giản thực hiện các kiểm tra CSAM trên các hình ảnh được lưu trữ trên máy chủ của nó, như nhiều nhà cung cấp lưu trữ đám mây khác làm. Apple lập luận rằng quá trình nó đang giới thiệu, chia kiểm tra giữa thiết bị và máy chủ, ít xâm phạm quyền riêng tư hơn so với việc quét tập trung đơn giản của hình ảnh ở phía máy chủ.

Nhưng các nhà phê bình như nhà mật mã học Matt Green từ Đại học Johns Hopkins nghi ngờ những động cơ phức tạp hơn trong cách tiếp cận của Apple. Anh ta chỉ ra rằng những nỗ lực kỹ thuật lớn mà Apple đã thực hiện để kiểm tra hình ảnh trên thiết bị của người dùng, mặc dù có bảo vệ quyền riêng tư của quy trình đó, chỉ thực sự có ý nghĩa trong những trường hợp mà hình ảnh được mã hóa trước khi rời khỏi điện thoại hoặc máy tính của người dùng và việc phát hiện ở phía máy chủ trở nên không thể thực hiện. Và anh ta lo ngại điều này có nghĩa là Apple sẽ mở rộng hệ thống phát hiện này đến các hình ảnh trên thiết bị của người dùng mà không bao giờ được tải lên iCloud—một loại quét hình ảnh trên thiết bị có thể đại diện cho một hình thức xâm phạm mới vào lưu trữ ngoại tuyến của người dùng.

Hoặc, trong một tình huống lạc quan hơn đối với những người ủng hộ quyền riêng tư, anh ấy suy đoán rằng Apple có thể đang lên kế hoạch thêm mã hóa đầu cuối hình ảnh cho iCloud và đã tạo ra hệ thống phát hiện CSAM mới của mình như một cách để làm hài lòng những người ủng hộ an toàn trẻ em và cảnh sát trong khi mã hóa lưu trữ đám mây của mình sao cho nó không thể truy cập hình ảnh của người dùng nếu không có cách nào khác. “Những gì Apple đang thực hiện ở đây là một bản minh họa công nghệ,” Green nói. “Điều này không phải là điều họ cần quét hình ảnh iCloud chưa được mã hóa. Điều này là điều bạn cần nếu những bức ảnh bạn đang quét sẽ được mã hóa trong tương lai.”

Những người ủng hộ quyền riêng tư đã thúc đẩy Apple thực hiện mã hóa đầu cuối cho lưu trữ iCloud của mình trong nhiều năm. Nhưng Apple đã báo cáo đã chống lại bước đi đó do áp lực từ các cơ quan chức năng như FBI, người mà từ đó mã hóa sẽ loại bỏ một công cụ điều tra quan trọng. Thêm hệ thống phát hiện CSAM mới của mình như là một bước tiền đề để cuối cùng mã hóa iCloud sẽ đại diện cho một chiến thắng quyền riêng tư hỗn hợp—nhưng một chiến thắng mà Green lo ngại có thể mở cửa cho các chính phủ trên thế giới đưa ra yêu cầu khác nhau, yêu cầu điều chỉnh hệ thống để quét nội dung khác ngoài CSAM, như hình ảnh chính trị hoặc dữ liệu nhạy cảm khác.

Trong khi các tính năng phát hiện CSAM mới chỉ giới hạn ở Mỹ trong lúc này, Green lo ngại về một tương lai khi các quốc gia khác, đặc biệt là Trung Quốc, đòi hỏi nhiều nhượng bộ hơn. Sau tất cả, Apple đã từng chấp nhận các yêu cầu của Trung Quốc về việc lưu trữ dữ liệu người dùng tại các trung tâm dữ liệu Trung Quốc. “Áp lực sẽ đến từ Anh, từ Hoa Kỳ, từ Ấn Độ, từ Trung Quốc. Tôi sợ hãi về những gì sẽ xảy ra,” Green thêm vào. “Tại sao Apple muốn nói với thế giới, ‘Chúng tôi có công cụ này’?”

Hiện tại, hệ thống mới của Apple đại diện cho một chiến thắng, ít nhất là, trong cuộc chiến chống lạm dụng trẻ em trực tuyến—mặc dù có thể gặp phải những rủi ro tiềm ẩn. “Thực tế là quyền riêng tư và bảo vệ trẻ em có thể tồn tại cùng nhau,” Tổng giám đốc điều hành và Tổng thư ký của NCMEC John Clark viết trong một tuyên bố gửi đến MYTOUR. “Bảo vệ mở rộng của Apple cho trẻ em là một trò chơi đổi game.”

Mức độ nó thay đổi cuộc chơi về quyền riêng tư cho người dùng của nó—và theo hướng nào—sẽ hoàn toàn phụ thuộc vào những bước tiếp theo của Apple.

CẬP NHẬT 8/11/21 1:40 PM ET: Câu chuyện này đã được cập nhật để làm rõ rằng trong khi Apple mã hóa ảnh iCloud, nhưng hiện tại, họ chưa sử dụng mã hóa đầu cuối cho iCloud.

Nhiều bài viết tuyệt vời khác từ MYTOUR

- 📩 Tin tức mới nhất về công nghệ, khoa học, và nhiều hơn nữa: Nhận bản tin của chúng tôi!

- Trăm cách để hoàn thành công việc và chúng ta vẫn chưa xong

- Đừng phàn nàn về Mass Effect: Andromeda

- Xem một hacker chiếm đoạt ánh sáng, quạt, và giường của một khách sạn

- Làm thế nào để giữ chất lượng không khí trong nhà của bạn ổn định

- Sự thật về thị trấn yên bình nhất ở Mỹ

- 👁️ Khám phá trí tuệ nhân tạo như chưa bao giờ với cơ sở dữ liệu mới của chúng tôi

- 🎮 MYTOUR Games: Nhận các mẹo, đánh giá, và nhiều hơn nữa

- ✨ Tối ưu hóa cuộc sống tại nhà của bạn với những lựa chọn tốt nhất từ đội ngũ Gear của chúng tôi, từ robot hút bụi đến đệm giá rẻ đến loa thông minh