Apple Mở Rộng Tính Năng Phát Hiện Hình Khỏa Thân Trên Thiết Bị Để Đối Phó Với CSAM

Vào tháng 12, Apple thông báo họ sẽ ngừng sử dụng một công cụ quét ảnh iCloud gây tranh cãi mà công ty đã tạo ra để chống lại nội dung lạm dụng tình dục trẻ em (CSAM) theo cách bảo vệ quyền riêng tư. Apple sau đó cho biết những nỗ lực chống lại CSAM sẽ tập trung vào tính năng “An Toàn Giao Tiếp” dành cho trẻ em, ban đầu được công bố vào tháng 8 năm 2021. Và tại Hội nghị Nhà phát triển Toàn cầu của công ty tại Cupertino hôm nay, Apple giới thiệu mở rộng cơ chế này, bao gồm một tính năng bổ sung được tùy chỉnh dành cho người lớn.

An Toàn Giao Tiếp quét tin nhắn trên thiết bị của người dùng trẻ để đánh dấu nội dung mà trẻ em đang nhận hoặc gửi trong tin nhắn trên iOS chứa hình ảnh nude. Apple thông báo hôm nay rằng tính năng này cũng được mở rộng cho tin nhắn video FaceTime, Contact Posters trong ứng dụng Phone, công cụ chọn ảnh hoặc video trong ứng dụng Photos mà người dùng chọn để gửi, và AirDrop. Việc xử lý trên thiết bị của tính năng này đồng nghĩa với việc Apple không bao giờ nhìn thấy nội dung được đánh dấu, nhưng bắt đầu từ mùa thu này, An Toàn Giao Tiếp sẽ được bật mặc định cho tất cả các tài khoản trẻ em - dưới 13 tuổi - trong kế hoạch Chia sẻ Gia đình. Phụ huynh có thể chọn tắt tính năng này nếu muốn.

“An Toàn Giao Tiếp là một tính năng mà chúng tôi thực sự muốn mang đến cho trẻ em một khoảnh khắc để dừng lại và hy vọng họ sẽ bị gián đoạn khỏi những cuộc trò chuyện mà thực chất là việc quyến rũ, hoặc ít nhất là có thể,” Erik Neuenschwander, trưởng phòng quyền riêng tư người dùng của Apple cho biết. “Vì vậy, nó được thiết kế để tạo ra sự ma sát cao. Điều chúng tôi muốn là có một câu trả lời mà chúng tôi nghĩ có thể đúng trong tình huống của đứa trẻ đó, đó là không tiến lên phía trước, và chúng tôi thực sự muốn đảm bảo rằng họ được giáo dục.”

Apple cho biết vào tháng 12 rằng họ dự định cung cấp một giao diện lập trình ứng dụng (API) để các nhà phát triển bên thứ ba có thể dễ dàng tích hợp An Toàn Giao Tiếp vào ứng dụng của họ và sử dụng nó để phát hiện nội dung lạm dụng tình dục trẻ em, hoặc CSAM. API, được biết đến với tên gọi là framework Phân Tích Nội Dung Nhạy Cảm, hiện đã có sẵn cho các nhà phát triển. Các nền tảng như Discord đã nói rằng họ đã có kế hoạch tích hợp nó vào ứng dụng iOS của họ.

Một điều chỉ trích về các sáng kiến chống lại CSAM như An Toàn Giao Tiếp là chúng không có sự bao phủ đầy đủ trên các ứng dụng và dịch vụ để đánh dấu nội dung và bảo vệ trẻ em ở mọi nơi, có thể cho phép các cuộc giao tiếp với những người lạm dụng trượt qua. Và chính vì lý do này, Apple nói rằng họ đã đầu tư mạnh mẽ để phát triển một API mạnh mẽ mà các nhà phát triển ứng dụng có thể dễ dàng tích hợp vào phần mềm của họ.

“Có rất nhiều công việc mà chúng tôi phải làm để tạo ra mô hình này,” Neuenschwander nói. “Chúng tôi có thể đầu tư một lần và sau đó có thể được tận dụng trên toàn bộ nền tảng, có thể là tất cả các ứng dụng mà người dùng của chúng tôi sử dụng.”

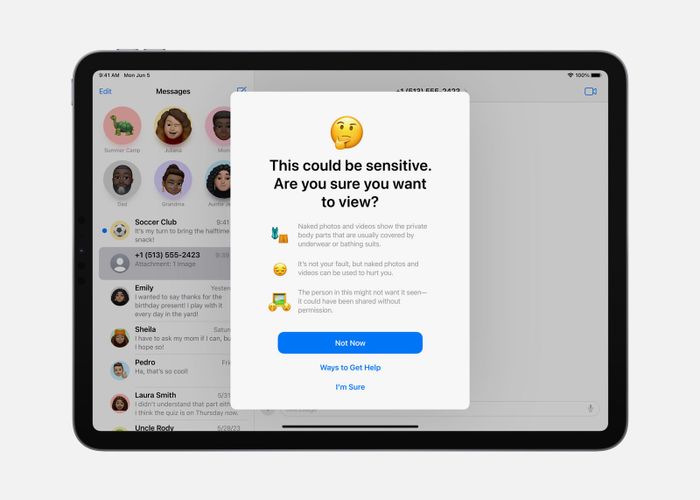

Ngoài An Toàn Giao Tiếp, Apple cho biết họ cũng nhận được phản hồi về sự quan tâm đến một phiên bản của tính năng dành cho người lớn. Vì vậy hôm nay, công ty cũng ra mắt Cảnh Báo Nội Dung Nhạy Cảm, sử dụng cách thức quét trên thiết bị để đánh dấu và làm mờ hình ảnh và video chứa hình khỏa thân. Tính năng này là tùy chọn và được kiểm soát trong menu Cài đặt Bảo mật & Riêng tư trên iOS. Và nó được thiết kế để tinh tế hơn so với An Toàn Giao Tiếp. Mục tiêu là bảo vệ người dùng người lớn khỏi nội dung họ không muốn nhìn thấy mà không làm phiền hoặc không hữu ích.

Giải quyết và giảm bớt lạm dụng tình dục trẻ em trực tuyến một cách ý nghĩa là một vấn đề phức tạp và khó khăn. Và Apple cho biết họ chưa hoàn thành việc khám phá và đầu tư vào các giải pháp mới. Nhưng với những rủi ro cao như vậy, có sự cấp bách thực sự đối với một công ty như Apple để triển khai các tính năng sẽ có tác động và thúc đẩy sự áp dụng của chúng rộng rãi nhất có thể.