Bài viết mới được đăng trên Wall Street Journal bởi tác giả Julie Jargan và mình thấy Elon Musk đã chia sẻ trên Twitter. Dưới đây là bản dịch cơ bản của toàn bộ nội dung bài báo để chia sẻ với mọi người.

Các lời kêu gọi cấm Tiktok tại Hoa Kỳ ngày càng mạnh mẽ hơn. Các nhà lãnh đạo chính trị đang cố gắng ngăn chặn nền tảng video xã hội Trung Quốc này khỏi trường học, cơ quan nhà nước ở mức độ toàn bộ các bang vì lo ngại về việc dữ liệu người dùng có thể bị sử dụng một cách không đúng mục đích. Tuy nhiên, có một vấn đề gây lo ngại hơn cả việc bảo vệ quyền riêng tư, đó là các thuật toán của Tiktok, đặc biệt là đối với phụ huynh.

Gần đây, các nhà nghiên cứu đã tạo ra một số tài khoản giả ở tuổi 13, và họ nhanh chóng bị quá tải bởi các video liên quan đến rối loạn ăn uống, hình ảnh về cơ thể, hành vi tự gây thương tích và thậm chí là hành vi tự tử.

Điều này không phải là điều mới mẻ, vì một cuộc điều tra của Wall Street Journal vào năm 2021 đã phát hiện ra rằng TikTok đưa người xem đến các nội dung nguy hiểm. Sau đó, TikTok đã tăng cường các biện pháp kiểm soát dành cho phụ huynh và hứa hẹn cải thiện thuật toán, nhưng nghiên cứu mới chỉ ra rằng trải nghiệm ứng dụng cho thanh thiếu niên vẫn không có nhiều thay đổi.

Những gì thanh thiếu niên nhìn thấy trên mạng xã hội có thể ảnh hưởng tiêu cực đến tâm trạng của họ, và có nhiều nghiên cứu đã chứng minh điều này. Sau khi liên tục xem các video trên Tiktok về các hành vi giống như hội chứng Tourette, nhiều trẻ em đã phát triển các triệu chứng của hội chứng Tic.

“Tiktok - Nền tảng gây ảnh hưởng tiêu cực đến tâm lý trẻ em”

Các lời kêu gọi cấm Tiktok tại Hoa Kỳ ngày càng mạnh mẽ hơn. Các nhà lãnh đạo chính trị đang cố gắng ngăn chặn nền tảng video xã hội Trung Quốc này khỏi trường học, cơ quan nhà nước ở mức độ toàn bộ các bang vì lo ngại về việc dữ liệu người dùng có thể bị sử dụng một cách không đúng mục đích. Tuy nhiên, có một vấn đề gây lo ngại hơn cả việc bảo vệ quyền riêng tư, đó là các thuật toán của Tiktok, đặc biệt là đối với phụ huynh.

Gần đây, các nhà nghiên cứu đã tạo ra một số tài khoản giả ở tuổi 13, và họ nhanh chóng bị quá tải bởi các video liên quan đến rối loạn ăn uống, hình ảnh về cơ thể, hành vi tự gây thương tích và thậm chí là hành vi tự tử.

Điều này không phải là điều mới mẻ, vì một cuộc điều tra của Wall Street Journal vào năm 2021 đã phát hiện ra rằng TikTok đưa người xem đến các nội dung nguy hiểm. Sau đó, TikTok đã tăng cường các biện pháp kiểm soát dành cho phụ huynh và hứa hẹn cải thiện thuật toán, nhưng nghiên cứu mới chỉ ra rằng trải nghiệm ứng dụng cho thanh thiếu niên vẫn không có nhiều thay đổi.

Những gì thanh thiếu niên nhìn thấy trên mạng xã hội có thể ảnh hưởng tiêu cực đến tâm trạng của họ, và có nhiều nghiên cứu đã chứng minh điều này. Sau khi liên tục xem các video trên Tiktok về các hành vi giống như hội chứng Tourette, nhiều trẻ em đã phát triển các triệu chứng của hội chứng Tic.

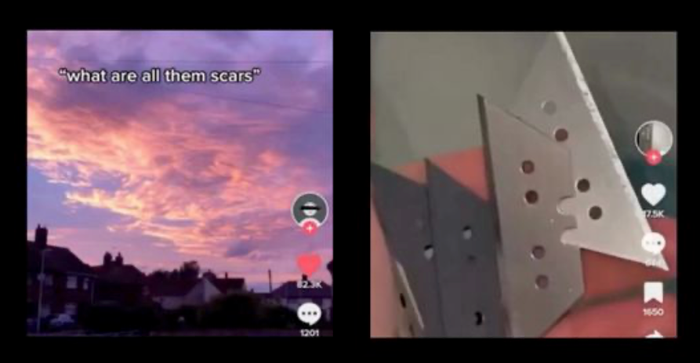

Ảnh chụp màn hình của một video Tiktok về việc tự gây hại

Theo Trung tâm Nghiên cứu Pew, hai phần ba thanh thiếu niên ở Mỹ sử dụng TikTok, trong đó có 16% cho biết họ sử dụng ứng dụng này gần như liên tục. Việc sử dụng mạng xã hội thường xuyên của thanh thiếu niên - cùng với khả năng thu hút thanh thiếu niên vào các hành vi nguy hiểm của thuật toán - là một trong các yếu tố của các khuyến nghị mới nhất của Hiệp hội Tâm lý học Mỹ (APA) về việc sử dụng mạng xã hội của tuổi vị thành niên.

Tuần này, tổ chức này đã khuyến nghị phụ huynh nên giám sát việc sử dụng mạng xã hội của trẻ em nhiều hơn. APA cũng kêu gọi các phụ huynh và các công ty công nghệ cần phải cảnh báo hơn về nội dung khuyến khích thanh thiếu niên tự tử hoặc tự gây hại cho bản thân.

'Mỗi 39 giây'

Trung tâm Chống Kỳ Thị Trực Tuyến, một tổ chức phi lợi nhuận hoạt động để ngăn chặn sự lan truyền của kỳ thị và thông tin sai lệch trên mạng, đã tiến hành thử nghiệm về những gì thanh thiếu niên thấy trên TikTok. Vào tháng Tám năm trước, các nhà nghiên cứu đã tạo tám tài khoản giả thiếu niên 13 tuổi trên TikTok ở Mỹ, Anh, Canada và Úc. Trong vòng 30 phút, họ theo dõi bất kỳ video nào mà trang For You của ứng dụng đề xuất có liên quan đến hình ảnh cơ thể và sức khỏe tâm thần, và nhấn thích chúng. TikTok gần như ngay lập tức đề xuất các video về tự tử và rối loạn ăn uống. Những video về hình ảnh cơ thể và sức khỏe tâm thần xuất hiện trên mục For You của tài khoản mỗi 39 giây.

Ảnh chụp màn hình của một video TikTok về ý nghĩa của việc tự sát

Sau khi công bố kết quả, nhiều video được gắn thẻ bởi các nhà nghiên cứu đã biến mất khỏi TikTok, trong khi các tài khoản vẫn giữ lại nội dung. Các tài khoản này bao gồm các video khuyến khích ăn kiêng hạn chế và thảo luận về tự tử và tự hại.

'Cảm Xúc U ám và Cô Đơn'

Trung tâm Chống Kỳ Thị Trực Tuyến đã chia sẻ toàn bộ nghiên cứu của họ với tác giả, bao gồm các liên kết đến 595 video mà TikTok đã đề xuất cho các tài khoản giả thiếu niên. Họ cũng cung cấp các reel chứa tất cả các video, trong đó có một số video không còn trên trang web. Tác giả cũng đã xem nội dung khác trên các tài khoản có video bị cảnh báo.

Sau vài giờ, tác giả phải dừng lại. “Nếu một chuỗi các video cảm xúc u ám khiến tôi cảm thấy thật tệ, một đứa trẻ 14 tuổi sẽ cảm thấy thế nào sau khi xem loại nội dung này hàng ngày?”

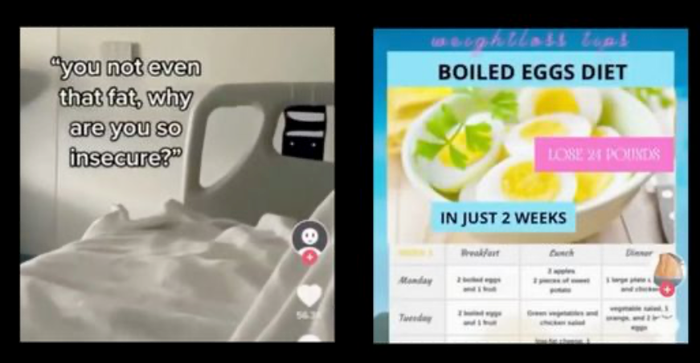

Một tài khoản được dành riêng cho 'âm nhạc u ám và cô đơn'. Một tài khoản khác có một cô gái tuổi teen khóc trong mỗi video, với những lời tuyên bố về tự tử. Một tài khoản khác chứa các video được quay trong phòng bệnh viện. Mỗi video trong phòng bệnh viện chứa văn bản thể hiện những suy nghĩ đến tự tử, bao gồm cả câu 'Cho màn trình diễn cuối cùng, tôi sẽ biến thành một nỗi thất vọng'.

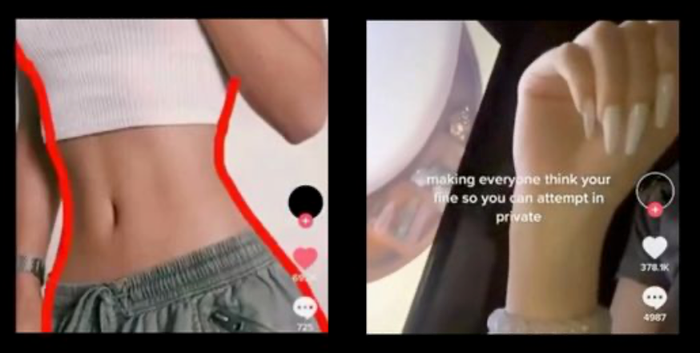

Ảnh chụp màn hình video TikTok về hình ảnh cơ thể và rối loạn ăn uống

Các TikToker đã nghĩ ra cách tránh bộ lọc nội dung của TikTok. Ví dụ, thay vì sử dụng từ 'tự tử', họ có thể dùng từ 'sewerslide' hoặc chỉ viết 'attempt' để người xem tự hiểu. Những người tạo video về rối loạn ăn uống cũng có cách tránh bộ lọc của TikTok.

Quản lý nội dung trên một dịch vụ được sử dụng bởi hơn một tỷ người dùng hàng tháng không phải là điều dễ dàng. Tuy nhiên, việc loại bỏ nội dung có hại và quảng cáo nó là hai việc khác nhau.

'Nếu các công ty công nghệ không thể loại bỏ các nội dung độc hại này khỏi nền tảng của họ, đừng tạo ra các thuật toán dẫn dắt chúng đến trẻ em,' Arthur C. Evans Jr., giám đốc điều hành của Hiệp hội Tâm lý học Hoa Kỳ nói.

Những gì Phụ huynh có thể làm

Xem những gì con bạn đang xem. Ariana Hoet, một nhà tâm lý học nhi khoa tại Bệnh viện trẻ em quốc gia, khuyến khích bố mẹ hỏi trực tiếp con cái đang xem gì trên mục For You. Nếu phát hiện nội dung độc hại, đó là một dấu hiệu cho thấy con bạn có thể đang liên quan trực tiếp đến vấn đề đó. Từ đó, bố mẹ nên bắt đầu trò chuyện về vấn đề này.

Thiết lập Family Pairing. Các bậc cha mẹ có thể thiết lập tài khoản TikTok của riêng mình và sử dụng Family Pairing của ứng dụng để hạn chế nội dung không phù hợp với tuổi và giới hạn thời gian mà con cái họ sử dụng.

Lọc cập nhật. Người dùng có thể lọc bỏ video chứa các từ hoặc hashtag mà họ không muốn xem. Nếu nội dung vẫn bị lọt qua, trẻ em có thể bấm vào 'không quan tâm'.

Làm mới trang cập nhật. Một số người trẻ đã cho tác giả biết khi trang cập nhật của họ trở nên quá nhiều vấn đề, họ đã đóng tài khoản và bắt đầu lại. Ngoài ra, có thể làm mới trang của mà không cần tạo lại tài khoản. Một lần nữa, thanh thiếu niên phải cẩn thận với nội dung mà họ thích hoặc dừng lại, bởi cạm bẫy liên tục được tạo ra, và họ có thể sẩy chân bất cứ lúc nào.

Nguồn: WSJ