Các Thuật toán Tốt Nhất Gặp Khó Khăn Trong Việc Nhận Diện Khuôn Mặt Người Mỹ Gốc Phi Một Cách Công Bằng

Công ty Pháp Idemia quét khuôn mặt theo triệu. Phần mềm nhận diện khuôn mặt của công ty phục vụ cảnh sát ở Mỹ, Úc và Pháp. Phần mềm của Idemia kiểm tra khuôn mặt của một số hành khách du thuyền đổ bộ ở Mỹ so với hồ sơ của Cơ quan Hải quan và Biên phòng. Năm 2017, một quan chức hàng đầu của FBI cho biết một hệ thống nhận diện khuôn mặt quét 30 triệu bức ảnh mugshot sử dụng công nghệ của Idemia giúp “bảo vệ nhân dân Mỹ.”

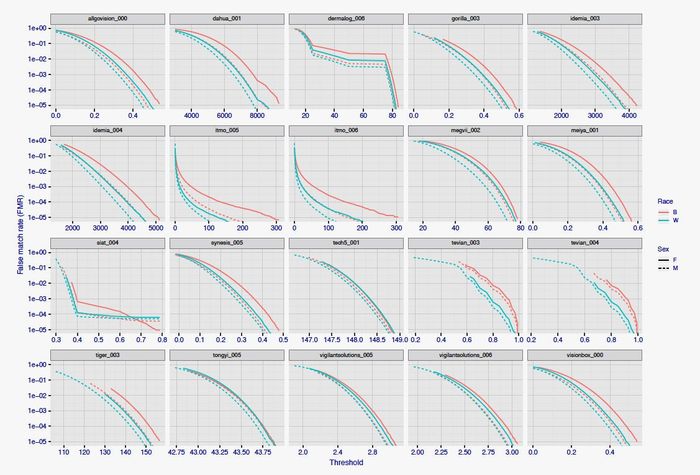

Nhưng các thuật toán của Idemia không phải lúc nào cũng nhìn nhận mọi khuôn mặt một cách rõ ràng như nhau. Kết quả kiểm tra tháng 7 từ Viện Tiêu chuẩn và Công nghệ Quốc gia chỉ ra rằng hai thuật toán mới nhất của Idemia có khả năng nhầm lẫn khuôn mặt phụ nữ da đen đáng kể hơn so với phụ nữ da trắng hoặc đàn ông da đen và trắng.

Kiểm tra của NIST thách thức các thuật toán xác nhận rằng hai bức ảnh hiển thị cùng một khuôn mặt, tương tự như cách một biên giới sử dụng để kiểm tra hộ chiếu. Ở những cài đặt nhạy cảm nơi thuật toán của Idemia sai lẫn kết nối khuôn mặt của hai phụ nữ da trắng với tỷ lệ một trong 10.000, nó sai lầm kết nối khuôn mặt của phụ nữ da đen khoảng một trong 1.000 - nhiều hơn 10 lần. Tỷ lệ sai lầm một trong 10.000 thường được sử dụng để đánh giá hệ thống nhận diện khuôn mặt.

Donnie Scott, người đứng đầu bộ phận an ninh công cộng của Idemia ở Mỹ, trước đây được biết đến là Morpho, cho biết các thuật toán được kiểm tra bởi NIST chưa được phát hành thương mại, và công ty kiểm tra sự chênh lệch dân số trong quá trình phát triển sản phẩm. Anh ta nói rằng các kết quả khác nhau có thể đến từ việc các kỹ sư đang nỗ lực nâng cao công nghệ của họ để đạt được độ chính xác tổng thể tốt nhất trong các kiểm tra được quan sát mật thiết của NIST. “Có sự chênh lệch về thể chất ở con người và thuật toán sẽ cải thiện ở mức độ khác nhau trên những người khác nhau,” ông nói.

Thuật toán thị giác máy tính chưa bao giờ tốt đến vậy trong việc phân biệt khuôn mặt người. NIST nói năm ngoái rằng những thuật toán tốt nhất đã cải thiện 25 lần trong việc tìm kiếm một người trong cơ sở dữ liệu lớn giữa năm 2010 và 2018, và chỉ bỏ lỡ một kết nối thực sự ở tỷ lệ 0,2%. Điều đó đã giúp thúc đẩy việc sử dụng rộng rãi trong chính phủ, thương mại và các thiết bị như iPhone.

Nhưng các kiểm tra của NIST và các nghiên cứu khác liên tục chỉ ra rằng các thuật toán gặp khó khăn trong việc nhận diện những người có làn da tối. Báo cáo tháng 7 của cơ quan này bao gồm các kiểm tra trên mã nguồn từ hơn 50 công ty. Nhiều người có hiệu suất cao trong báo cáo đó cho thấy các khoảng trống hiệu suất tương tự như chênh lệch 10 lần của Idemia trong tỷ lệ sai lầm cho phụ nữ da đen và trắng. NIST đã công bố kết quả của các kiểm tra dân số về thuật toán nhận diện khuôn mặt từ đầu năm 2017. Nó cũng liên tục phát hiện ra rằng chúng thực hiện kém hơn đối với phụ nữ so với nam giới, ảnh hưởng này được tin là do việc sử dụng trang điểm ít nhất một phần.

“Nam giới da trắng ... là đối tượng nhóm dân số thường có tỷ lệ FMR thấp nhất,” tức là tỷ lệ kết nối sai, báo cáo nói. “Phụ nữ da đen ... là đối tượng nhóm dân số thường có tỷ lệ FMR cao nhất.” NIST dự kiến sẽ có một báo cáo chi tiết vào mùa thu này về cách công nghệ hoạt động trên các nhóm dân số khác nhau.

Các nghiên cứu của NIST được coi là tiêu chuẩn vàng để đánh giá thuật toán nhận diện khuôn mặt. Các công ty có kết quả tốt sử dụng chúng để quảng bá. Các công ty Trung Quốc và Nga thường chiếm ưu thế trong xếp hạng về độ chính xác tổng thể, và tự hào về kết quả NIST của họ để giành được kinh doanh trong nước. Idemia phát đi thông cáo báo chí vào tháng 3 khoe rằng nó hoạt động hiệu quả hơn đối thủ cho các hợp đồng liên bang Mỹ.

Bộ An ninh Nội địa cũng phát hiện ra rằng làn da đậm tạo ra thách thức đối với công nghệ nhận diện khuôn mặt thương mại. Vào tháng 2, nhân viên DHS công bố kết quả từ việc thử nghiệm 11 hệ thống thương mại được thiết kế để kiểm tra danh tính của một người, như tại một trạm kiểm tra an ninh sân bay. Người thử nghiệm có mức đo pigmen da của họ. Những hệ thống được kiểm tra thường mất nhiều thời gian hơn để xử lý những người có làn da đậm và ít chính xác trong việc nhận diện họ — mặc dù một số nhà cung cấp có hiệu suất tốt hơn những người khác. Người giám sát quyền riêng tư nội bộ của cơ quan này đã nói rằng DHS nên công bố công khai hiệu suất của các hệ thống nhận diện khuôn mặt đã triển khai, như những hệ thống đang thử nghiệm tại các sân bay, đối với các nhóm dân tộc và sắc tộc khác nhau.

Các báo cáo của chính phủ đồng hành với các nghiên cứ quan trọng năm 2018 từ ACLU và các nhà nghiên cứu MIT cảnh báo một cách rõ ràng về công nghệ. Họ báo cáo rằng các thuật toán từ Amazon, Microsoft và IBM ít chính xác hơn trên làn da đậm.

Những phát hiện này đã kích thích một cuộc tranh luận quốc gia ngày càng tăng về việc sử dụng đúng, và sai, của nhận diện khuôn mặt. Một số nhà bảo vệ quyền tự do công dân, những người làm luật sư và chuyên gia chính sách muốn hạn chế hoặc cấm việc chính phủ sử dụng công nghệ này, như gần đây đã xảy ra ở San Francisco và hai thành phố khác. Lo ngại của họ bao gồm rủi ro về quyền riêng tư, sự cân bằng quyền lực giữa công dân và nhà nước - và sự chênh lệch chủng tộc trong kết quả. Ngay cả nếu nhận diện khuôn mặt hoạt động cũng cho tất cả các khuôn mặt, vẫn có lý do để hạn chế công nghệ này, một số nhà phê bình nói.

Mặc dù có cuộc tranh luận ngày càng tăng, nhận diện khuôn mặt đã được tích hợp sẵn trong nhiều cơ quan chính phủ liên bang, tiểu bang và địa phương, và nó đang lan rộng. Chính phủ Mỹ sử dụng nhận diện khuôn mặt cho các nhiệm vụ như kiểm tra biên giới và tìm kiếm những người nhập cư bất hợp pháp.

Trước đây trong năm nay, Cảnh sát Los Angeles đã phản ứng trước một vụ xâm nhập vào nhà mà leo thang thành một vụ bắn chết người. Một nghi can đã bị bắt nhưng một người khác đã trốn thoát. Các thám tử xác định tên nghi phạm bằng cách sử dụng một ảnh trực tuyến để tìm kiếm trong hệ thống nhận diện khuôn mặt dựa trên ảnh chụp của Văn phòng Cảnh sát Quận Los Angeles.

Đại úy Derek Sabatini của Văn phòng Cảnh sát cho biết vụ án này cho thấy giá trị của hệ thống, được sử dụng bởi hơn 50 cơ quan thuộc quận và tìm kiếm trong cơ sở dữ liệu hơn 12 triệu bức ảnh chụp. Các thám tử có thể không tìm ra nghi phạm một cách nhanh chóng nếu không có nhận diện khuôn mặt, Sabatini nói. “Ai biết được đã mất bao lâu, và có lẽ người đó sẽ không ở đó để bắt giữ,” ông nói.

Hệ thống của Quận Los Angeles được xây dựng xung quanh một thuật toán nhận diện khuôn mặt từ Cognitec, một công ty Đức, giống như Idemia, cung cấp nhận diện khuôn mặt cho các chính phủ trên toàn thế giới. Như với Idemia, kiểm tra của NIST đối với thuật toán của Cognitec cho thấy chúng có thể ít chính xác hơn đối với phụ nữ và những người có màu da khác nhau. Ở ngưỡng nhạy cảm dẫn đến việc phụ nữ da trắng bị kết nối sai một trong 10,000 lần, hai thuật toán Cognitec mà NIST thử nghiệm có khả năng nhầm lẫn gấp khoảng năm lần nếu nhận diện sai phụ nữ da đen.

Thorsten Thies, giám đốc phát triển thuật toán của Cognitec, thừa nhận sự khác biệt nhưng nói rằng khó giải thích. Một yếu tố có thể là “khó chụp được hình ảnh tốt của một người có làn da đen hơn so với một người da trắng,” ông nói.

Sabatini bác bỏ lo ngại rằng - bất kể nguyên nhân cơ bản là gì - các thuật toán chệch lệch có thể dẫn đến chênh lệch chủng tộc trong công tác cảnh sát. Các sĩ quan kiểm tra kết quả đề xuất một cách cẩn thận và tìm kiếm bằng chứng xác nhận trước khi thực hiện hành động, ông nói. “Chúng tôi đã sử dụng nó ở đây từ năm 2009 và chẳng có vấn đề gì: không có kiện tụng, không có vụ án, không có khiếu nại,” ông nói.

Lo ngại về sự giao cắt giữa nhận diện khuôn mặt và vấn đề chủng tộc không mới. Năm 2012, chuyên gia nhận diện khuôn mặt hàng đầu của FBI đồng tác giả một bài nghiên cứu phát hiện rằng các hệ thống nhận diện khuôn mặt thương mại ít chính xác hơn đối với người da đen và phụ nữ. Các nhà nghiên cứu tại Đại học Georgetown cảnh báo về vấn đề này trong một báo cáo ảnh hưởng năm 2016 nói rằng FBI có thể tìm kiếm khuôn mặt của khoảng một nửa dân số Mỹ.

Vấn đề này đã thu hút sự chú ý mới khi nhận diện khuôn mặt trở nên phổ biến hơn, và các chuyên gia chính sách cũng quan tâm hơn đến các giới hạn của công nghệ. Công việc của nhà nghiên cứu và nhà hoạt động chính trị Joy Buolamwini tại MIT đã gây ảnh hưởng đặc biệt lớn.

Đầu năm 2018, Buolamwini và nhà nghiên cứu trí tuệ nhân tạo Timnit Gebru đã chỉ ra rằng các dịch vụ của Microsoft và IBM cố gắng nhận diện giới tính của khuôn mặt trong ảnh gần như hoàn hảo đối với nam giới có làn da trắng nhưng thất bại hơn 20 phần trăm trên phụ nữ có làn da tối; một nghiên cứu sau đó phát hiện ra các mô hình tương tự cho một dịch vụ của Amazon. Những nghiên cứu không thử nghiệm các thuật toán cố gắng nhận diện người—một điều Amazon gọi là “mơ hồ” trong một bài đăng blog quyết liệt.

Buolamwini là một nhân chứng xuất sắc tại cuộc điều trần tháng 5 của Ủy ban Giám sát và Cải cách Hạ viện, nơi các lập pháp đã thể hiện sự quan tâm đa phương tiện về việc quy định nhận diện khuôn mặt. Chủ tịch Elijah Cummings (D-Maryland) nói rằng sự chênh lệch chủng tộc trong kết quả kiểm tra tăng cường lo ngại của ông về cách cảnh sát đã sử dụng nhận diện khuôn mặt trong các cuộc biểu tình năm 2015 tại Baltimore về cái chết trong tù của Freddie Gray, một người đàn ông da đen. Sau đó, Jim Jordan (R-Ohio) tuyên bố rằng Quốc hội cần “làm điều gì đó” về việc sử dụng công nghệ này của chính phủ. “[Nếu] hệ thống nhận diện khuôn mặt mắc lỗi và những sai lầm đó ảnh hưởng mạnh mẽ đến người Mỹ da đen và người có màu da, [nó] dường như là vi phạm trực tiếp tự do Thứ Nhất và Thứ Tư của người Mỹ,” ông nói.

Lý do hệ thống nhận diện khuôn mặt hoạt động khác nhau trên làn da tối chưa rõ ràng. Buolamwini nói trước Quốc hội rằng nhiều bộ dữ liệu được các công ty sử dụng để kiểm tra hoặc đào tạo các hệ thống phân tích khuôn mặt không đại diện đúng cách. Nơi thu thập bộ sưu tập lớn nhất về khuôn mặt là từ web, nơi nội dung thiên về màu trắng, nam giới, và phương Tây. Ba bộ sưu tập hình ảnh khuôn mặt được trích dẫn nhiều nhất trong các nghiên cứu học thuật là 81 phần trăm hoặc nhiều hơn người có làn da nhạt, theo đánh giá của IBM.

Patrick Grother, một nhân vật được nhiều người kính trọng trong lĩnh vực nhận diện khuôn mặt, người đứng đầu cuộc kiểm tra của NIST, nói rằng có thể có những nguyên nhân khác khiến độ chính xác thấp hơn đối với làn da tối. Một trong những nguyên nhân đó là chất lượng ảnh. Công nghệ và kỹ thuật chụp hình đã được tối ưu hóa cho làn da nhạt từ thời kỳ bắt đầu của bức tranh màu vào thời đại số. Ông cũng đưa ra một giả thuyết gây sốc hơn tại một hội nghị vào tháng 11: rằng khuôn mặt người da đen thống kê gần giống nhau hơn so với khuôn mặt người da trắng. “Có thể đoán rằng bản chất con người có liên quan đến điều này,” ông nói. “Các nhóm dân số khác nhau có thể có sự khác biệt trong việc biểu hiện hiện tượng di truyền của gen của chúng ta.”

Michael King, giáo sư đại học tại Viện Công nghệ Florida trước đây quản lý các chương trình nghiên cứu cho các cơ quan tình báo Mỹ bao gồm nhận diện khuôn mặt, không chắc chắn hơn. “Đó là điều mà tôi chưa sẵn sàng thảo luận ở thời điểm này. Chúng tôi chỉ mới tiến xa đủ trong nghiên cứu của mình,” ông nói.

Kết quả mới nhất của King, cùng với đồng nghiệp từ FIT và Đại học Notre Dame, minh họa thách thức của việc giải thích không đồng đều dân số trong các thuật toán nhận diện khuôn mặt và làm thế nào để giải quyết vấn đề.

Nghiên cứu của họ kiểm tra bốn thuật toán nhận diện khuôn mặt—hai thuật toán thương mại và hai nguồn mở—trên 53,000 bức ảnh mugshot. Các lỗi khớp nhầm hai người khác nhau thường xuyên xảy ra với khuôn mặt người da đen, nhưng lỗi trong đó các khuôn mặt khớp nhau không được phát hiện thường xuyên xảy ra với khuôn mặt người da trắng. Một tỷ lệ lớn hơn của các ảnh mugshot của người da đen không đạt chuẩn cho ảnh đại diện, nhưng chỉ điều này không thể giải thích hiệu suất bị chệch.

Các nhà nghiên cứu phát hiện họ có thể làm cho các thuật toán hoạt động một cách đồng đều cho người da đen và người da trắng—nhưng chỉ bằng cách sử dụng các thiết lập nhạy cảm khác nhau cho hai nhóm. Điều này không thể thực hiện ở ngoại ô vì yêu cầu các thám tử hoặc cảnh sát biên giới chọn một thiết lập khác nhau cho các nhóm người sẽ tạo ra rủi ro kỳ thị riêng biệt, và có thể khiến cho bị kiện với cáo buộc đối xử phân biệt chủng tộc.

Trong khi King và những người khác cẩn thận khám phá các thuật toán trong phòng thí nghiệm, cuộc chiến chính trị xoay quanh nhận diện khuôn mặt diễn ra nhanh chóng. Các thành viên của Quốc hội cả hai đảng đều hứa hẹn hành động để kiểm soát công nghệ này, đề cập đến lo ngại về độ chính xác đối với các dân tộc thiểu số. Thứ Ba, Oakland trở thành thành phố thứ ba ở Hoa Kỳ cấm các cơ quan của mình sử dụng công nghệ này kể từ tháng Năm, sau Somerville, Massachusetts, và San Francisco.

King nói rằng khoa học về cách làm cho các thuật toán hoạt động giống nhau trên tất cả các khuôn mặt sẽ tiếp tục theo nhịp của nó. “Việc làm cho hệ thống này hoạt động một cách đồng đều cho các đối tượng dân số khác nhau hoặc thậm chí là hiểu được liệu điều này có thể hay không là một mục tiêu dài hạn thực sự,” ông nói.

Những Trải nghiệm Tuyệt vời từ MYTOUR

- Khi công việc giảng dạy trực tuyến là cửa sổ nhìn thấy lạc hậu

- Thách thức trong việc định lượng sự căm ghét trong “thế giới nam giới”

- Sikorsky’s S-97 Raider khiến chiếc trực thăng của bạn trở nên lười biếng

- Bộ sưu tập ảnh: Những chiếc xe cổ điển như bay trên không

- Nỗi sợ, thông tin sai lệch và bệnh sởi lan rộng tại Brooklyn

- 💻 Nâng cấp trò chơi làm việc của bạn với những chiếc laptop, bàn phím, phương thức đánh máy và tai nghe chống ồn mà đội ngũ Gear yêu thích của chúng tôi đã chọn

- 📩 Muốn thêm nhiều hơn? Đăng ký nhận bản tin hàng ngày của chúng tôi và không bao giờ bỏ lỡ những câu chuyện mới và xuất sắc nhất của chúng tôi