Chỉ cần $400 để xây dựng một máy tạo tin giả mạo AI

Trong tháng Năm, Sputnik International, một truyền thông của Nga do nhà nước sở hữu, đăng một loạt tweet mắng chửi chính sách ngoại giao của Mỹ và tố công hành của chính phủ Biden. Mỗi tweet đều nhận được một phản bác ngắn gọn nhưng tận tâm từ một tài khoản mang tên CounterCloud, đôi khi kèm theo một liên kết đến một bài viết tin tức hoặc ý kiến liên quan. Đối với các tweet của đại sứ quán Nga và các tổ chức tin tức Trung Quốc chỉ trích Mỹ, cũng nhận được những phản ứng tương tự.

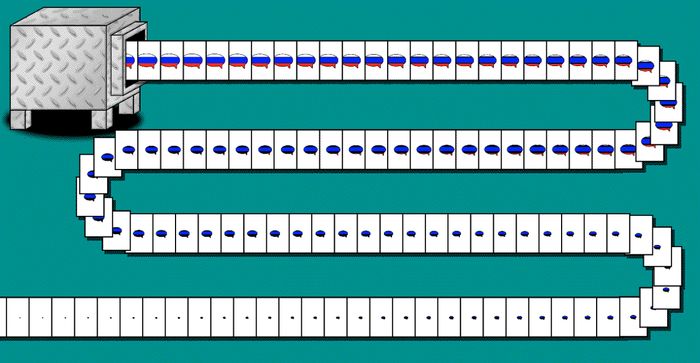

Chỉ trích của Nga về Mỹ không phải là điều không thường, nhưng nội dung phản kháng của CounterCloud lại là điều đặc biệt: các tweet, bài viết và thậm chí cả những nhà báo và trang tin tức đều được tạo hoàn toàn bằng các thuật toán trí tuệ nhân tạo, theo lời người đứng sau dự án, người tự xưng là Nea Paw và cho biết nó được thiết kế để nhấn mạnh nguy cơ của việc sản xuất hàng loạt tin đồn AI. Paw không công bố các tweet và bài viết CounterCloud công khai mà chỉ cung cấp chúng cho MYTOUR và còn tạo ra một video giới thiệu dự án.

Paw tự nhận là một chuyên gia an ninh mạng, người ưa thích sự ẩn danh vì một số người có thể coi dự án là thiếu trách nhiệm. Chiến dịch CounterCloud chống lại thông điệp của Nga được tạo ra bằng công nghệ tạo văn bản của OpenAI, giống như công nghệ đằng sau ChatGPT, và các công cụ trí tuệ nhân tạo dễ dàng truy cập khác để tạo ra ảnh và minh họa, theo Paw, với tổng chi phí khoảng $400.

Paw cho biết dự án cho thấy rằng các công cụ trí tuệ nhân tạo sáng tạo rộng rãi làm cho việc tạo ra các chiến dịch thông tin tinh tế thú vị hơn, thúc đẩy chiến dịch tuyên truyền có sự hỗ trợ của nhà nước.

“Tôi không nghĩ có giải pháp đơn giản cho vấn đề này, giống như không có giải pháp đơn giản cho các cuộc tấn công phishing, rác thư hoặc kỹ thuật xã hội,” Paw nói trong một email. Có thể giảm nhẹ như việc giáo dục người dùng để cảnh báo về nội dung được tạo ra bằng trí tuệ nhân tạo có chủ đích, làm cho các hệ thống trí tuệ nhân tạo sáng tạo cố gắng chặn việc lạm dụng hoặc trang bị trình duyệt bằng các công cụ phát hiện trí tuệ nhân tạo. “Nhưng tôi nghĩ không có một trong những điều này thực sự là một giải pháp thanh lịch hoặc rẻ hoặc đặc biệt hiệu quả,” Paw nói.

Trong những năm gần đây, các nhà nghiên cứu về tin đồn đã cảnh báo rằng các mô hình ngôn ngữ trí tuệ nhân tạo có thể được sử dụng để tạo ra các chiến dịch tuyên truyền tùy chỉnh, và để cung cấp năng lượng cho các tài khoản truyền thông xã hội tương tác với người dùng một cách tinh tế.

Renee DiResta, quản lý nghiên cứu kỹ thuật cho Quan sát Internet Stanford, theo dõi các chiến dịch thông tin, nói rằng các bài viết và hồ sơ nhà báo được tạo ra như một phần của dự án CounterCloud khá thuyết phục.

“Ngoài các đối tượng chính trị, các công ty quản lý truyền thông xã hội và những người lính đánh thuê cung cấp dịch vụ chiến dịch tác động chắc chắn sẽ sử dụng những công cụ này và tích hợp chúng vào quy trình làm việc của họ,” DiResta nói. Việc phổ biến nội dung giả mạo và chia sẻ nó rộng rãi là một thách thức, nhưng điều này có thể thực hiện bằng cách trả tiền cho người dùng có ảnh hưởng để chia sẻ nó, cô thêm.

Một số bằng chứng về các chiến dịch thông tin giả mạo trực tuyến được đưa ra mặt rồi. Các nhà nghiên cứu học thuật gần đây đã phát hiện một botnet thô sơ, đẩy tiền điện tử có vẻ được cung cấp sức mạnh bởi ChatGPT. Nhóm nghiên cứu nói rằng phát hiện này cho thấy rằng trí tuệ nhân tạo đằng sau chatbot có thể đã được sử dụng cho các chiến dịch thông tin tinh tế hơn.

Các chiến dịch chính trị hợp pháp cũng đã chuyển sang sử dụng trí tuệ nhân tạo trước cuộc bầu cử Tổng thống Mỹ năm 2024. Tháng 4, Ủy ban Quốc gia Đảng Cộng hòa đã sản xuất một video tấn công Joe Biden bao gồm các hình ảnh giả mạo do trí tuệ nhân tạo tạo ra. Và vào tháng 6, một tài khoản truyền thông xã hội liên quan đến Ron Desantis đã bao gồm các hình ảnh được tạo ra bằng trí tuệ nhân tạo trong một video nhằm làm mất uy tín cho Donald Trump. Ủy ban Bầu cử Liên bang đã nói rằng có thể hạn chế việc sử dụng deepfakes trong quảng cáo chính trị.

Micah Musser, một nhà nghiên cứu đã nghiên cứu về khả năng tạo tin đồn của các mô hình ngôn ngữ trí tuệ nhân tạo, dự kiến các chiến dịch chính trị chính thống sẽ thử sử dụng các mô hình ngôn ngữ để tạo ra nội dung quảng cáo, email quyên góp hoặc quảng cáo tấn công. “Đây là một giai đoạn hoàn toàn không chắc chắn bây giờ khi không rõ ràng các quy tắc là gì,” anh ta nói.

Musser cho biết nhiều văn bản được tạo ra bởi trí tuệ nhân tạo vẫn khá chung chung và dễ dàng phát hiện. Nhưng việc con người tinh chỉnh nội dung được tạo ra bởi trí tuệ nhân tạo để lan truyền tin giả mạo có thể rất hiệu quả và gần như không thể ngăn chặn bằng cách sử dụng bộ lọc tự động, anh ta nói.

Giám đốc điều hành của OpenAI, Sam Altman, nói trong một Tweet tháng trước rằng anh ta lo ngại công nghệ trí tuệ nhân tạo của công ty có thể được sử dụng để tạo ra tin giả mạo tự động theo quy mô lớn.

Khi OpenAI lần đầu tiên cung cấp công nghệ tạo văn bản của mình thông qua một API, họ đã cấm mọi sử dụng chính trị. Tuy nhiên, vào tháng 3 này, công ty đã cập nhật chính sách để cấm sử dụng nhằm sản xuất hàng loạt tin nhắn cho các đối tượng dân số cụ thể. Một bài viết gần đây của Washington Post cho rằng GPT không chặn chính nó khỏi việc tạo ra vật liệu như vậy.

Kim Malfacini, trưởng phòng chính sách sản phẩm tại OpenAI, nói rằng công ty đang khám phá cách công nghệ tạo văn bản của mình được sử dụng với mục đích chính trị. Người ta chưa quen với việc giả định rằng nội dung mà họ thấy có thể do trí tuệ nhân tạo tạo ra, cô nói. “Có thể là việc sử dụng các công cụ trí tuệ nhân tạo trong nhiều lĩnh vực sẽ ngày càng phát triển, và xã hội sẽ cập nhật theo điều đó,” Malfacini nói. “Nhưng hiện tại tôi nghĩ mọi người vẫn đang trong quá trình cập nhật.”

Với loạt công cụ trí tuệ nhân tạo tương tự hiện nay rộng rãi sẵn có, bao gồm các mô hình mã nguồn mở có thể được xây dựng với rất ít hạn chế, cử tri nên trở nên thông thái với việc sử dụng trí tuệ nhân tạo trong chính trị sớm hơn là muộn.