Cuộc đua giữa các khổng lồ công nghệ trong lĩnh vực trí tuệ nhân tạo đã tạo ra một cuộc đua đầy kích thích, nhắc chúng ta tới thời kỳ hải tặc trong One Piece. Đây là một cuộc đua đầy hứng khởi, mục tiêu là những điều phi thường, nhưng cũng đầy thách thức. Và những công ty phần cứng đã là người hưởng lợi đầu tiên, đặc biệt là Nvidia - công ty vừa gia nhập câu lạc bộ nghìn tỷ đô.

Chi phí phần cứng chiếm hơn 80%

Theo Andreesen, điểm đặc biệt trong việc phát triển AI là sự liên kết mạnh mẽ với sức mạnh của phần cứng: Phần cứng mạnh mẽ sẽ làm cho sản phẩm trở nên xuất sắc hơn. Thường thì chi phí nghiên cứu và phát triển tạo ra sự ảnh hưởng lớn hơn trong việc nâng cao giá trị sản phẩm, và mối quan hệ này gần như là tuyến tính. Tuy nhiên, với sự phát triển hiện nay của AI, yếu tố quan trọng nhất là chi phí huấn luyện máy học và phương pháp suy diễn của AI.Tại sao nuôi AI lại tốn kém về phần cứng?

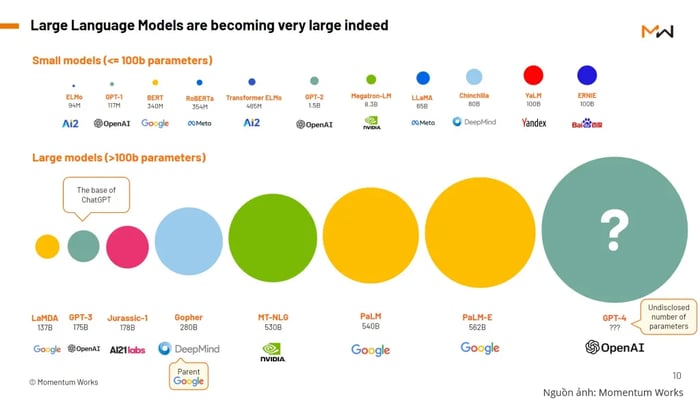

Có nhiều mô hình phát triển AI khác nhau, sử dụng các phương pháp khác nhau, và quy mô khác nhau. Tuy nhiên, hầu hết đều dựa trên mô hình deep learning, gọi chung là transfomer-based, trong đó, các mô hình ngôn ngữ lớn như GPT-3, GPT-J, hay BERT nổi bật nhất. Trong số các yếu tố góp phần vào sức mạnh của AI, số lượng tham số là quan trọng nhất, cùng với số lượng token đầu vào và đầu ra.

***CẬP NHẬT: CEO của OpenAI, Sam Altman, không tiết lộ con số chính xác về số lượng tham số, và con số [100 nghìn tỷ] chỉ là con số được lan truyền, không phải con số chính thức.

Bảng trên biểu diễn sức mạnh cần thiết cho 3 mô hình cơ bản, trong hai giai đoạn huấn luyện và suy luận. Bảng này sử dụng số lượng token trung bình cho đầu vào và đầu ra là 1024 token, và đơn vị TFLOP là Tera-Flop (Tera: 1 nghìn tỷ).

Theo Andreesen, mô hình LLaMA của Meta (công ty sở hữu Facebook) yêu cầu phần cứng cao hơn nhiều, là một trong những khó nhất tính tới thời điểm hiện tại.

Tóm lại, các mô hình AI hiện nay đòi hỏi cơ sở hạ tầng phần cứng quá lớn và phải liên tục nâng cấp theo yêu cầu tăng cao, cũng như các nâng cấp về công nghệ. Điểm lợi thế của các mô hình transfomer-based là đồ thị nâng cấp gần như tuyến tính, giúp dễ dàng ước lượng các chi phí cần thiết cho từng sản phẩm cụ thể.

Thời gian xử lý của GPU

Mỗi nhân xử lý thường xử lý 1-2 lệnh trong mỗi chu kỳ, và tần số xung trung bình của mỗi nhân xử lý đã duy trì ở mức khoảng 3GHz trong suốt 15 năm qua. Để xử lý một câu lệnh suy luận của mô hình GPT-3 sẽ mất khoảng 32 giờ, vì vậy cần những nhân xử lý chuyên dụng hơn. Trên lý thuyết, card A100 mới của Nvidia có thể xử lý một câu lệnh với GPT-3 chỉ trong 1 giây. Nhưng thực tế thì sẽ có rất nhiều vấn đề khác.khoảng hơn 30 năm

Trên lý thuyết, card A100 mới của Nvidia có thể xử lý một câu lệnh với GPT-3 chỉ trong 1 giây. Nhưng thực tế thì sẽ có rất nhiều vấn đề khác.khoảng hơn 30 năm Hình trên này là một thống kê vào tháng 3 năm 2023. Dưới 100 tỷ tham số được xem là mô hình nhỏ, từ 100 tỷ trở lên là Large Language Models.

Hình trên này là một thống kê vào tháng 3 năm 2023. Dưới 100 tỷ tham số được xem là mô hình nhỏ, từ 100 tỷ trở lên là Large Language Models.Chi phí nuôi AI

Chi phí huấn luyện GPT-3 là rất đắt đỏ. Với sức mạnh xử lý của card A100, cần khoảng 560.000 USD cho mỗi lượt chạy chương trình huấn luyện.Vai trò của Việt Nam trong cảnh lớn này

Chi phí để huấn luyện các mô hình AI lớn như GPT-4 hoặc LLaMA của Meta là khổng lồ. Đòi hỏi sức mạnh phần cứng đáng kể để đáp ứng nhu cầu ngày càng tăng của cộng đồng phát triển và sử dụng AI.