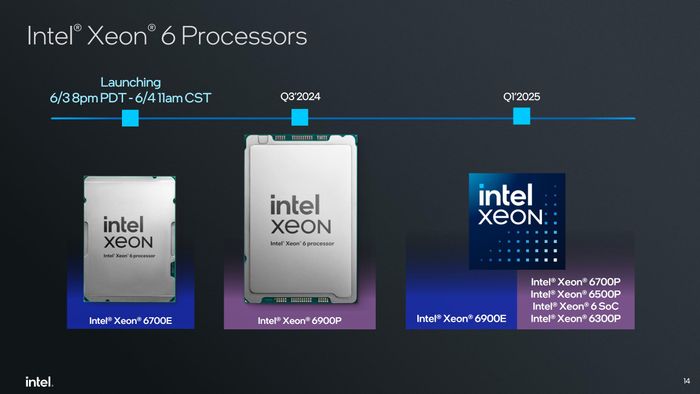

Bên cạnh Xeon 6 và Gaudi 3, sự kiện Computex cũng là dịp để Intel 'khoe' kiến trúc Lunar Lake (LNL) với toàn bộ giới công nghệ, nhất là trên PC.

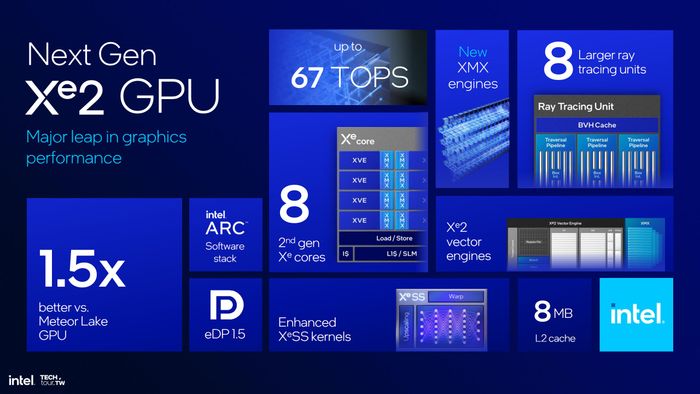

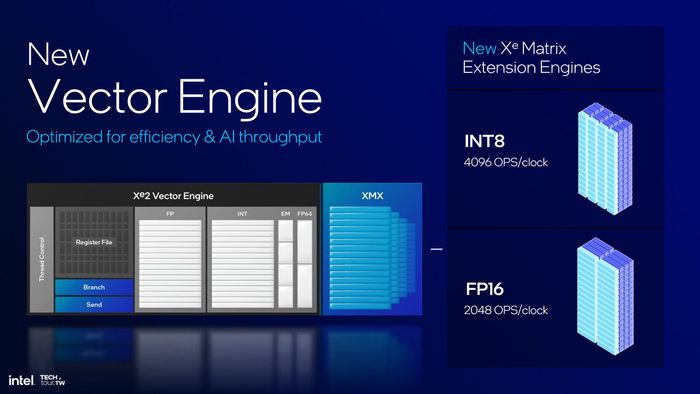

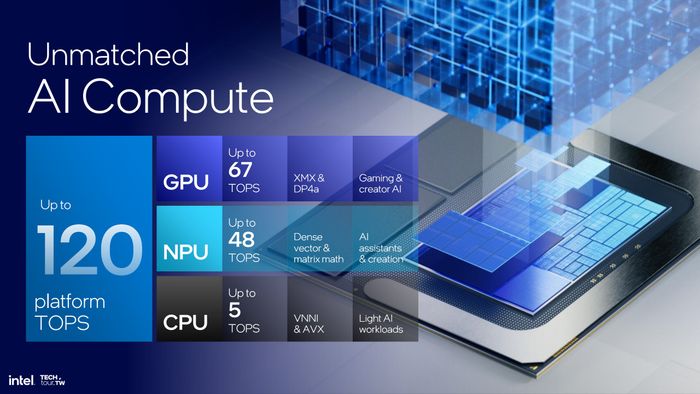

Trí tuệ Nhân tạo đang là xu hướng nóng trong lĩnh vực công nghệ. Do đó, dù chỉ là một trong số rất nhiều tính năng, các công ty vẫn xem đây là điểm nhấn chính khi giới thiệu các sản phẩm mới trong năm này. Hãng chip x86 lớn nhất thế giới, hiển nhiên, cũng không bỏ qua điều này. Kiến trúc LNL hứa hẹn mang đến năng lực xử lý Trí tuệ Nhân tạo tới gần 120 TOPS trong một cấu hình hết sức nhỏ gọn và tiết kiệm điện.

Nhưng trước khi nói về Trí tuệ Nhân tạo của LNL, chúng ta hãy điểm sơ tổng quan con chip x86 mới này.

Chip LNL kèm sẵn 32 GB bộ nhớ RAM

Mặc dù điểm trừ là chi phí sản xuất LNL sẽ cao hơn các chip không kèm DRAM khác, song nhìn chung hãng sản xuất sẽ không cần mua thêm RAM từ công ty khác, nên tổng thể giá thành tới tay người dùng gần như không thay đổi. Nên cơ bản đây là điểm cộng mạnh về thiết kế cho LNL. Theo so sánh của Intel, việc hàn sẵn chip DRAM lên cùng PCB giúp làm giảm 40% mức tiêu thụ điện cho mạch in, từ đó giúp kéo dài thời gian sử dụng pin hơn trước. Ngoài ra, nó cũng tiết kiệm tới 250 mm2 diện tích PCB (so với việc gắn khe RAM riêng).

Toàn bộ con chip rất nhỏ gọn

Ít chiplet hơn, tích hợp sâu hơn

Nhớ khi Meteor Lake (MTL) ra mắt, đó là con chip đầu tiên đánh dấu sự chuyển đổi của Intel sang sử dụng thiết kế chiplet (hoặc MCM). Lúc đó, MTL được cấu tạo từ 4 chiplet riêng biệt bao gồm CPU, GPU, SoC và IO, khá 'cồng kềnh'. Nhưng đến LNL, số lượng chiplet giảm xuống còn 3 (thực tế là 2), cụ thể chúng ta có compute die (CPU, GPU, NPU), IO die (PCH) và... die 'làm đầy' (filler).

Những thành phần tạo nên LNL

* Điều đặc biệt về die filler là nó tồn tại không phải vì tính toán mà vì khối die IO không rộng bằng khối die compute, khiến cho việc đặt miếng tản nhiệt (IHS) lên có thể dẫn tới việc bị 'kênh', làm cho bề mặt tiếp xúc không tốt và tản nhiệt kém hiệu quả. Bạn có thể tưởng tượng die filler như những tấm ván hoặc giấy dưới chân bàn để tránh việc nó bị lệch lạc! Nó cũng giúp hấp thụ một lượng nhất định nhiệt từ các die khác (do không hoạt động), nhưng chức năng chính vẫn là 'miếng lót bàn' *

Theo một cách nhìn khác, cấu trúc LNL chặt chẽ hơn MTL khi phần lớn dữ liệu không cần phải luân chuyển nhiều lần. Nếu bỏ qua khối die IO, LNL gần như được thiết kế như một khối đồng nhất. Tuy nhiên, do quá nhiều thành phần tính toán được nén lại, điểm yếu của LNL là số nhân xử lý của nó không nhiều.

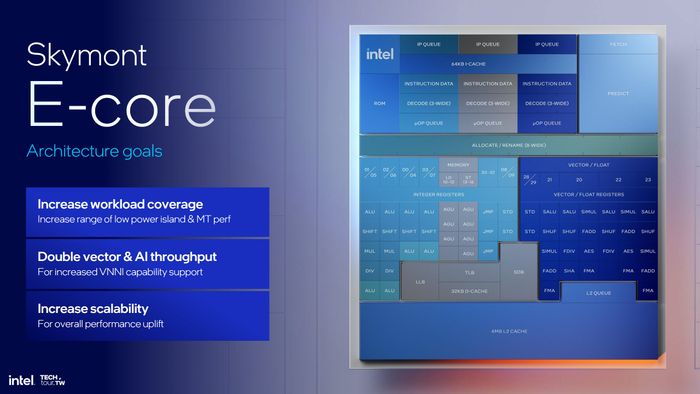

Cấu trúc của nhân P-core Lion Cove

Với Lion Cove, nhân xử lý này đã mở rộng lên 8-wide decoder và 8-wide allocation. So với Redwood Cove là 6-wide và các thế hệ 14 nm chỉ mới là 4-wide. Để so sánh, kiến trúc của AMD Zen 4 trở lại cũng chỉ là 4-wide. Điều này là lý do tại sao Intel thường có hiệu suất đơn lõi cao hơn AMD. Trong thế giới chip, các thiết kế ARM gần đây nhất từ Apple cũng có hiệu suất rất cao nhờ mở rộng kiến trúc xử lý này.

Ngoài việc mở rộng phần front-end, phần execution và back-end của LNL cũng được tăng cường với 4 pipeline FPU, 6 ALU và 6 AGU, cùng với việc tăng dung lượng L2 Cache lên đến 3 MB. Theo Intel, Lion Cove có hiệu suất IPC cao hơn Redwood Cove tới 14%.