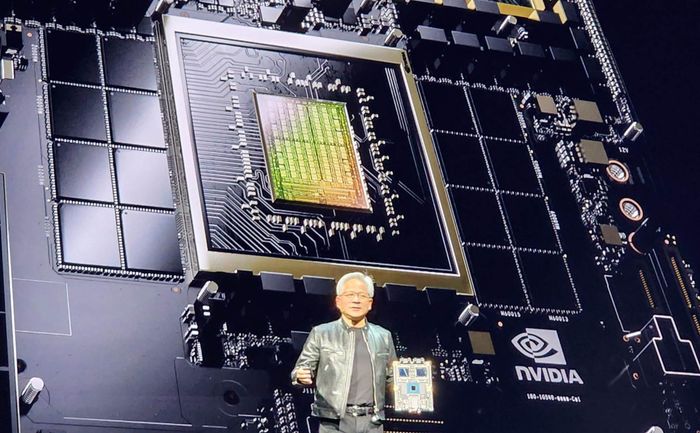

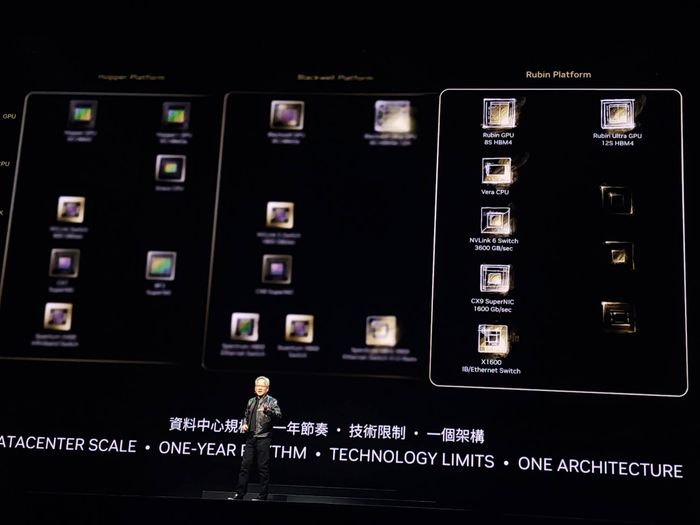

Nvidia quyết định không chờ đến CES năm sau để tiết lộ kiến trúc GPU mới cho máy chủ tiếp theo sau Blackwell. Chỉ vài tháng trước tại sự kiện GTC của Nvidia, CEO Jensen Huang đã tiết lộ kiến trúc của chip Blackwell, dự kiến bán ra thị trường vào giữa năm nay. Blackwell B200 chưa ra mắt, Rubin đã được tiết lộ, cùng với đó là lộ trình ra mắt những sản phẩm chip xử lý phục vụ cơn sốt AI tạo sinh ở thời điểm hiện tại. Trước khi nói về Rubin, hãy nhắc đến Blackwell B100 và B200 trước. Tốc độ phát triển kiến trúc sản phẩm mới của Nvidia vẫn đảm bảo 2 năm cho mỗi thế hệ. Điều này có nghĩa là, trong năm 2024, thế hệ sản phẩm thương mại đầu tiên dựa trên kiến trúc Blackwell sẽ ra mắt vào nửa cuối năm nay.

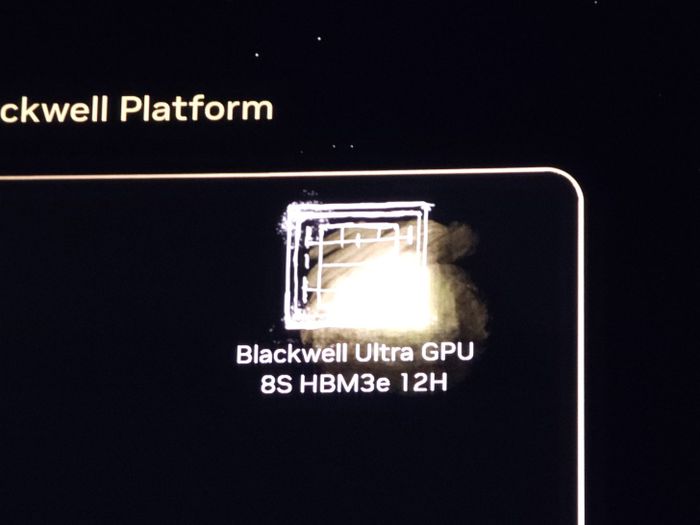

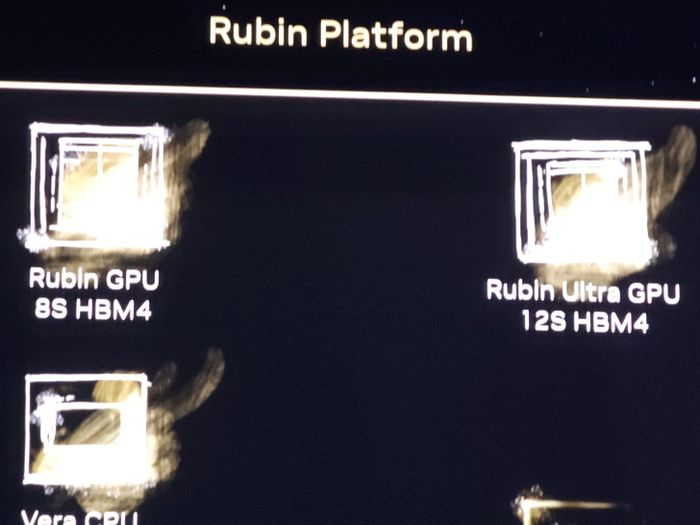

Trong năm 2025, sẽ có một phiên bản mới mang tên Blackwell Ultra, nâng cấp bộ nhớ HBM từ những stack 8Hi lên những stack 12Hi, nhưng vẫn giữ nguyên bố cục 8 chip RAM HBM3 xung quanh die GPU kích thước khổng lồ. Với bộ nhớ cao hơn và băng thông bộ nhớ được cải thiện, tốc độ xử lý thuật toán AI cũng sẽ tăng lên. Năm 2026 sẽ là thời điểm GPU Rubin R100 ra mắt. R100 dự kiến sẽ được gia công thương mại hóa từ cuối năm 2025, rồi tới đầu năm 2026 là những hệ thống máy chủ DGX và HGX phục vụ cho các khách hàng của Nvidia. Và giống hệt như Blackwell, đến năm 2027, Rubin Ultra sẽ ra mắt.

Trong năm 2025, sẽ có một phiên bản mới mang tên Blackwell Ultra, nâng cấp bộ nhớ HBM từ những stack 8Hi lên những stack 12Hi, nhưng vẫn giữ nguyên bố cục 8 chip RAM HBM3 xung quanh die GPU kích thước khổng lồ. Với bộ nhớ cao hơn và băng thông bộ nhớ được cải thiện, tốc độ xử lý thuật toán AI cũng sẽ tăng lên. Năm 2026 sẽ là thời điểm GPU Rubin R100 ra mắt. R100 dự kiến sẽ được gia công thương mại hóa từ cuối năm 2025, rồi tới đầu năm 2026 là những hệ thống máy chủ DGX và HGX phục vụ cho các khách hàng của Nvidia. Và giống hệt như Blackwell, đến năm 2027, Rubin Ultra sẽ ra mắt.Rubin: 2026, Rubin Ultra: 2027

Thông tin quan trọng nhất là GPU Rubin R100 sẽ áp dụng công nghệ RAM HBM4, mà các hãng như Samsung và SK Hynix sắp hoàn thành phát triển. Kế tiếp, kích thước photomask quang khắc EUV thiết kế của con chip trên wafer silicon sẽ có reticle design 4x, lớn hơn con số 3.3x mà Nvidia và TSMC sử dụng với Blackwell. R100 sẽ được gia công trên tiến trình 3nm của TSMC, áp dụng quy trình đóng gói die bán dẫn CoWoS-L để tạo ra những “siêu chip” kích thước lớn, có thể còn hơn cả B100 Blackwell. Gần đây, TSMC đã tiết lộ kế hoạch triển khai công nghệ đóng gói chip bán dẫn để đến năm 2026 có thể gia công được những chip với reticle design 5.5x, lớp đế substrate kích thước lên tới 100x100mm, đủ chỗ đặt 12 cụm chip HBM xếp chồng, thay vì 8 chip HBM trên những con chip với lớp đế 80x80mm như hiện giờ. Đồng thời, TSMC cũng công bố kế hoạch chuyển sang sử dụng thiết kế SoIC mới, có thể gia công những chip bán dẫn với photomask kích thước 8.8 lần kích thước reticle, đế substrate kích thước tối đa 120x120mm. Về mặt bộ nhớ, DRAM HBM4 cũng đã có những thông báo mới. Cả Samsung và SK Hynix đều đã tiết lộ kế hoạch sản xuất thương mại những chip nhớ xếp chồng thế hệ mới, xếp từ 8 đến 12 lớp DRAM để tạo ra những chip RAM dung lượng cực lớn. Tuy nhiên, những con chip này dự kiến phải đến cuối năm 2025 mới bắt đầu sản xuất thương mại, trùng với quá trình gia công những chip Rubin R100.

Gần đây, TSMC đã tiết lộ kế hoạch triển khai công nghệ đóng gói chip bán dẫn để đến năm 2026 có thể gia công được những chip với reticle design 5.5x, lớp đế substrate kích thước lên tới 100x100mm, đủ chỗ đặt 12 cụm chip HBM xếp chồng, thay vì 8 chip HBM trên những con chip với lớp đế 80x80mm như hiện giờ. Đồng thời, TSMC cũng công bố kế hoạch chuyển sang sử dụng thiết kế SoIC mới, có thể gia công những chip bán dẫn với photomask kích thước 8.8 lần kích thước reticle, đế substrate kích thước tối đa 120x120mm. Về mặt bộ nhớ, DRAM HBM4 cũng đã có những thông báo mới. Cả Samsung và SK Hynix đều đã tiết lộ kế hoạch sản xuất thương mại những chip nhớ xếp chồng thế hệ mới, xếp từ 8 đến 12 lớp DRAM để tạo ra những chip RAM dung lượng cực lớn. Tuy nhiên, những con chip này dự kiến phải đến cuối năm 2025 mới bắt đầu sản xuất thương mại, trùng với quá trình gia công những chip Rubin R100.CPU Vera thay thế cho Grace

Trước khi có Vera, Nvidia sẽ nâng cấp chip CPU kiến trúc ARM Grace trên hệ thống siêu chip GR200, kết hợp một CPU Grace và hai GPU Rubin R100. CPU Grace đời mới sẽ được gia công trên tiến trình 3nm TSMC. CPU Grace hiện tại có 72 nhân. Tiếp theo, Nvidia sẽ ra mắt thế hệ CPU ARM mang tên Vera, kết hợp với chip R100 tạo thành “siêu chip” Vera Rubin, giống như Grace Hopper của thế hệ kiến trúc trước đó dành cho máy chủ. Một trong những khía cạnh mà Nvidia tập trung nhiều nhất trong quá trình thiết kế kiến trúc chip xử lý AI Rubin có lẽ chính là hiệu quả tiêu thụ điện năng. Nvidia hiểu rõ tiêu thụ điện năng của từng GPU AI hiện nay nếu nhân lên sẽ tạo ra áp lực rất lớn về nhu cầu năng lượng của những data center khổng lồ. Nvidia khẳng định sẽ tập trung nhiều vào khía cạnh này. Hiện tại, R100 vẫn đang trong quá trình phát triển bên trong phòng lab của Nvidia. Không loại trừ khả năng, tới sự kiện GTC 2025, R100 sẽ được chính thức giới thiệu.

Một trong những khía cạnh mà Nvidia tập trung nhiều nhất trong quá trình thiết kế kiến trúc chip xử lý AI Rubin có lẽ chính là hiệu quả tiêu thụ điện năng. Nvidia hiểu rõ tiêu thụ điện năng của từng GPU AI hiện nay nếu nhân lên sẽ tạo ra áp lực rất lớn về nhu cầu năng lượng của những data center khổng lồ. Nvidia khẳng định sẽ tập trung nhiều vào khía cạnh này. Hiện tại, R100 vẫn đang trong quá trình phát triển bên trong phòng lab của Nvidia. Không loại trừ khả năng, tới sự kiện GTC 2025, R100 sẽ được chính thức giới thiệu.Theo WCCFTech