Các nền tảng mạng xã hội như Facebook, Twitter và YouTube đang đầu tư đáng kể vào việc phát triển trí tuệ nhân tạo để kiểm duyệt nội dung và tự động loại bỏ các bài đăng có hại. Các công nghệ quyết định này thường dựa vào các kỹ thuật học máy và chuyên môn cho các loại nội dung như hình ảnh, video, âm thanh và văn bản. Một số hệ thống trí tuệ nhân tạo này, được phát triển để đo lường "độc hại" của nội dung dựa trên văn bản, sử dụng xử lý ngôn ngữ tự nhiên và đánh giá tâm trạng để phát hiện văn bản có hại.

Mặc dù những công nghệ này có vẻ là một bước ngoặt trong cuộc tranh luận về lời lẽ thù địch trên internet, nghiên cứu gần đây đã chỉ ra rằng chúng vẫn chưa thể phân biệt được ngữ cảnh hay ý định. Nếu các công cụ trí tuệ nhân tạo như vậy được giao trách nhiệm kiểm soát nội dung trực tuyến, chúng có khả năng ức chế ngôn ngữ chính thống và kiểm duyệt việc sử dụng các từ cụ thể, đặc biệt là của nhóm nhóm yếu thế.

Tại InternetLab, chúng tôi gần đây đã thực hiện một nghiên cứu tập trung vào Perspective, một công nghệ trí tuệ nhân tạo được phát triển bởi Jigsaw (thuộc sở hữu của Google, tập đoàn Alphabet). Trí tuệ nhân tạo đánh giá mức độ 'độc hại' của nội dung dựa trên văn bản. Perspective định nghĩa 'độc hại' như 'một bình luận thiếu lịch sự, không tôn trọng hoặc không hợp lý có khả năng khiến bạn rời khỏi một cuộc thảo luận.' Do đó, mô hình trí tuệ nhân tạo được huấn luyện bằng cách yêu cầu người đánh giá xếp hạng bình luận trên internet trên một thang điểm từ 'rất lành mạnh' đến 'rất độc hại.' Mức độ độc hại cảm nhận cho thấy khả năng một bình luận cụ thể sẽ được coi là độc hại.

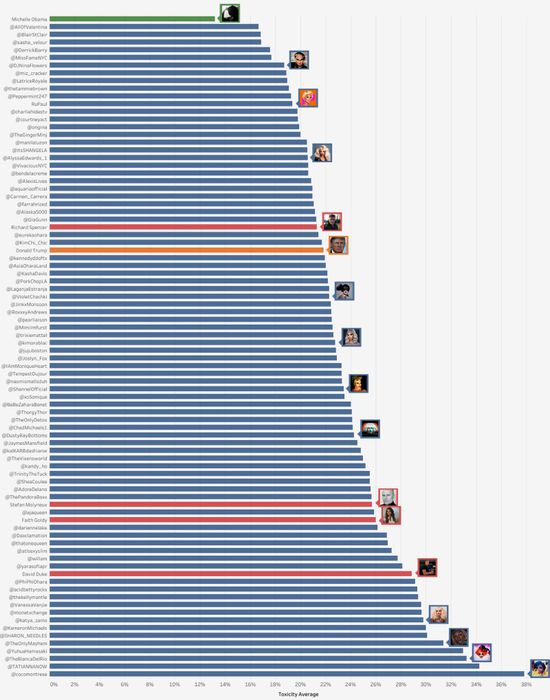

Chúng tôi đã sử dụng API của Perspective để so sánh mức độ độc hại được cảm nhận của các nhân vật drag queen nổi tiếng và các nhà lãnh đạo chính trị cánh tả. Nghiên cứu so sánh tài khoản Twitter của tất cả những người tham gia trước đây của RuPaul's Drag Race với những nhà lãnh đạo cánh tả như David Duke, Richard Spencer, Stefan Molyneux và Faith Goldy. Ngoài ra, chúng tôi bao gồm các người dùng Twitter nổi tiếng không thuộc cộng đồng LGBTQ, bao gồm cả Donald Trump và Michelle Obama. Chúng tôi phân tích hơn 114.000 tweet được đăng bằng tiếng Anh với phiên bản mới nhất của Perspective.

Kết quả của chúng tôi cho thấy một số lượng đáng kể tài khoản Twitter của drag queen được tính toán có mức độ độc hại cao hơn so với những nhà lãnh đạo quốc gia trắng. Trung bình, mức độ độc hại của tài khoản drag queen dao động từ 16,68% đến 37,81%, trong khi trung bình của những nhà lãnh đạo cánh tả nằm trong khoảng từ 21,30% đến 28,87%. Mức độ độc hại của tài khoản Twitter của Tổng thống Trump là 21,84%.

Chúng tôi cũng thực hiện các thử nghiệm đo mức độ độc hại của những từ thường thấy trong các tweet của drag queen. Những từ này có mức độ độc hại cao đáng kể: gay (76,10%), lesbian (60,79%), queer (51,03%) và transvestite (44,48%). Điều này có nghĩa là, ngay cả khi sử dụng trong ngữ cảnh tích cực, những từ này vẫn được xếp hạng là độc hại đáng kể bởi trí tuệ nhân tạo của Perspective. Điều này chỉ ra các độ chệch quan trọng trong công cụ của Perspective.

Ngoài ra, từ như fag (91,94%), sissy (83,20%) và bitch (98,18%) đều đăng ký mức độ độc hại cao. Mặc dù những từ này có thể thường được coi là có hại, nhưng việc sử dụng chúng bởi các thành viên của cộng đồng LGBTQ thường phục vụ một mục đích khác.

Những người drag queen có thể nói mũi nhọn. Từ những lời châm biếm như 'reads'—một hình thức cụ thể của lời xúc phạm mà một cách châm biếm tiết lộ nhược điểm của ai đó—đến những lời nói mạnh mẽ và phản đối, drag queen thường tái chủng những từ thường được sử dụng như là lời lẽ phỉ báng để xây dựng một phong cách giao tiếp đặc biệt.

Trong giao tiếp trực tiếp, việc hiểu rõ ngữ cảnh và nhìn nhận đây là một hình thức tự diễn đạt dễ dàng hơn. Nhưng khi đọc những bức thư như vậy trực tuyến, việc phân biệt giữa lời nói có hại và chính xác là thách thức đáng kể hơn—đặc biệt khi đánh giá được thực hiện bởi máy móc. Những sử dụng nội dung trong nhóm cũng được tìm thấy trong nhiều tweet chúng tôi phân tích. Nhưng trong nhiều trường hợp đó, Perspective vẫn coi bài đăng là cực kỳ độc hại:

Nội dung X

Nội dung này cũng có thể được xem trên trang web nguồn gốc của nó.

Mức độ độc hại: 95,98%

Nội dung X

Nội dung này cũng có thể được xem trên trang web nguồn gốc của nó.

Mức độ độc hại: 91,16%

Rất nhiều lần, những tương tác 'khắc nghiệt' này đề cập đến các chủ đề nhạy cảm như vai trò tình dục trong các mối quan hệ, sự hiển thị của tính đồng tính và sự dâm dật tình dục—những chủ đề thường được khám phá bởi những người nhắm mục tiêu tấn công bằng lời nói với cộng đồng LGBTQ.

Nhưng khi được hướng về nhau bởi các thành viên của cộng đồng LGBTQ, những bình luận này có thể đến từ tinh thần đồng lòng, chứ không phải là ác ý. Những thông điệp cơ bản không khuyến khích sự căm ghét, định kiến và phân biệt đối xử. Ngược lại, chúng thường làm nổi bật lòng tự hào và tự chấp nhận, giúp người LGBTQ đối mặt với sự thù địch bên ngoài.

Lời nói căm ghét thường dựa trên các thông điệp cơ bản. Khi tiểu văn thúc đẩy ý tưởng đầy thù hại hoặc phân biệt đối xử, nó đại diện cho một mối đe dọa đối với các nhóm bị đ margin và yếu đuối. Bằng cách đào tạo thuật toán của mình để hiểu được nội dung nào có khả năng được coi là độc hại, công cụ của Perspective dường như đang tăng cường sự quan trọng của từ ngữ, chứ không phải là các thông điệp cơ bản của chúng.

Mặc dù những ý tưởng được thúc đẩy bởi các tweet của người theo chủ nghĩa trắng tộc có thể nhắm mục tiêu đến nhóm yếu đuối, nhưng AI của Perspective thường phân loại chúng ít độc hại hơn so với tweet của những người drag queen:

Nội dung X

Nội dung này cũng có thể được xem trên trang web nguồn gốc của nó.

Mức độ độc hại: 7.17 phần trăm

Nội dung X

Nội dung này cũng có thể được xem trên trang web nguồn gốc của nó.

Mức độ độc hại: 6.78 phần trăm

Nội dung X

Nội dung này cũng có thể được xem trên trang web nguồn gốc của nó.

Mức độ độc hại: 21.7 phần trăm

Nếu công cụ AI này có quyền quyết định những tweet nào nên bị gỡ bỏ, nhiều bài đăng của các nữ hoàng drag sẽ bị kiềm chế. Thực tế, Perspective đã đưa ra những quyết định như vậy.

Vào tháng 3, Jigsaw ra mắt Tune, một ứng dụng mở rộng trình duyệt thử nghiệm sử dụng Perspective để cho phép người dùng điều chỉnh 'âm lượng' nội dung trực tuyến trên các nền tảng bao gồm Facebook, Twitter, YouTube và Reddit. Người dùng có thể vặn núm lên để xem tất cả các bài đăng hoặc vặn xuống để ẩn tất cả các bình luận độc hại. Những bài đăng đó sẽ được thay thế bằng những dấu chấm màu nhỏ. Tune quảng cáo với ý tưởng rằng “lạm dụng và quấy rối làm mất sự chú ý khỏi cuộc trò chuyện trực tuyến.” Tune cho rằng bằng cách sử dụng Perspective, nó “giúp bạn tập trung vào những điều quan trọng.

Vấn đề là: Những công cụ AI như vậy có thể được phát triển bằng cách sử dụng dữ liệu đào tạo có độ chệch, đe dọa sự tự diễn đạt và sự hiển thị của nhóm nhóm dễ bị tổn thương. Nếu xem xét từng cái một, 3.925 tweet từ các nữ hoàng drag - khoảng 3.7 phần trăm tổng số tweet được phân tích - sẽ bị ẩn khỏi người dùng Tune ở chế độ “Giữ nó thấp,” theo nghiên cứu của chúng tôi.

Việc sử dụng Perspective và các công nghệ tương tự khác có thể bị nhầm lẫn để kiểm soát và kiểm duyệt lời nói chính thức của cộng đồng LGBTQ trên các nền tảng trực tuyến. Nếu các công cụ AI tập trung vào các tín hiệu đánh lạc hướng - như việc sử dụng các từ cụ thể, thay vì ý định của một thông điệp - các mô hình này sẽ ít tiến triển trong việc loại bỏ lời nói căm ghét.

Công cụ AI có tiềm năng định hình cách chúng ta giao tiếp. Nếu máy tính quyết định một cách không phân biệt đối xử cái gì là “độc hại,” công nghệ có quyền lực để ảnh hưởng đến các phương thức diễn đạt trực tuyến và hạn chế tính bao dung của internet một cách nghiêm trọng.

Ý KIẾN Mytour đăng bài viết của các độc giả bên ngoài, đại diện cho nhiều quan điểm khác nhau. Đọc thêm ý kiến tại đây. Gửi bài op-ed tới [email protected]

Những điều tuyệt vời khác của Mytour

- Bên trong phòng tập gym mới của chuyên gia Bulletproof Coffee về đầu tư vào cơ thể

- Vô hiệu hóa bom mìn và bom chưa nổ ở Mosul

- Sự chết của một bệnh nhân và tương lai của việc chuyển giao phân

- Giải thích về 'khoảng trống dữ liệu về giới tính,' từ điện thoại đến giao thông công cộng

- Làm thế nào chín người xây dựng một đế chế Airbnb bất hợp pháp trị giá 5 triệu đô la

- 🎧 Âm thanh không ổn? Hãy kiểm tra tai nghe không dây, thanh âm, và loa Bluetooth yêu thích của chúng tôi

- 📩 Muốn biết thêm? Đăng ký nhận bản tin hàng ngày của chúng tôi và không bao giờ bỏ lỡ những câu chuyện mới nhất và tuyệt vời nhất của chúng tôi