Deepfakes Đang Trở Nên Xuất Sắc Hơn, Nhưng Vẫn Dễ Nhận Diện

Tuần trước, Mona Lisa mỉm cười. Một nụ cười to, rộng, sau đó là những gì có vẻ như là một tiếng cười và sự mím chúi câm lặng của những từ chỉ có thể là câu trả lời cho bí ẩn đã làm cho người xem mê mải suốt nhiều thế kỷ.

Nhiều người đã bị làm phiền.

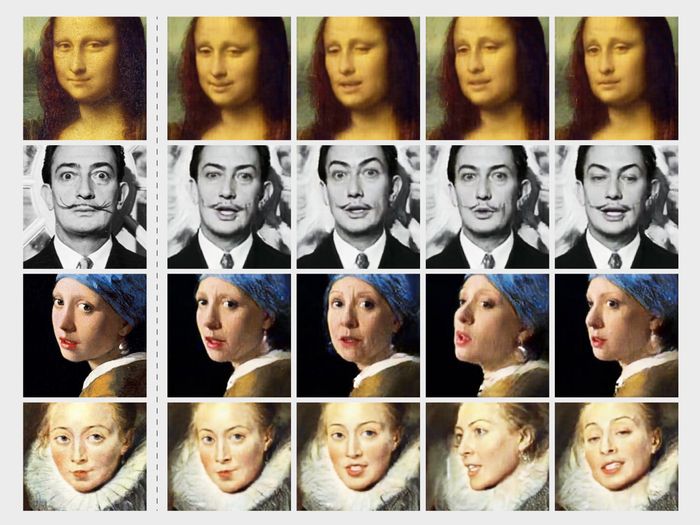

Bức tranh sống động của Mona, cùng với hình ảnh giống như Marilyn Monroe, Salvador Dali và những người khác, đã thể hiện công nghệ mới nhất trong deepfakes - nội dung truyền thông có vẻ thực tế được tạo ra bằng máy học. Được phát triển bởi các nhà nghiên cứu tại Samsung AI Lab ở Moscow, những bức tranh hiển thị một phương pháp mới để tạo ra video đáng tin cậy từ một hình ảnh duy nhất. Chỉ cần vài bức ảnh của khuôn mặt thực, kết quả cải thiện đáng kể, tạo ra những gì tác giả mô tả là 'đầu nói chân thực'. Những nhà nghiên cứu (một cách kỳ lạ) gọi kết quả này là 'puppeteering', một tham chiếu đến cách dây vô hình dường như điều khiển khuôn mặt được nhắm đến. Và đúng, lý thuyết, nó có thể được sử dụng để làm cho ảnh đại diện Facebook của bạn trở nên sống động. Nhưng đừng hoảng sợ về việc có những dây đàn đang độc hại kéo khuôn mặt của bạn.

'Không có điều gì cho tôi nghĩ rằng bạn sẽ đơn giản là sử dụng điều này để tạo ra deepfakes tại nhà. Không phải trong ngắn hạn, trung hạn, hoặc thậm chí là dài hạn,' nói Tim Hwang, giám đốc của Harvard-MIT Ethics and Governance of AI Initiative. Lý do liên quan đến chi phí cao và sự hiểu biết kỹ thuật để tạo ra deepfakes chất lượng - những rào cản mà sẽ không biến mất trong thời gian sớm.

Deepfakes lần đầu tiên xuất hiện vào cuối năm 2017, khi một người ẩn danh trên Reddit dưới tên 'deepfakes' bắt đầu tải lên video của các ngôi sao như Scarlett Johansson được ghép vào cơ thể của diễn viên khiêu dâm. Các ví dụ đầu tiên liên quan đến các công cụ có thể chèn một khuôn mặt vào cảnh quay hiện tại, từng hình ảnh một - một quá trình rối bời lúc đó và đến nay - và nhanh chóng mở rộng sang các nhân vật chính trị và các người nổi tiếng truyền hình. Người nổi tiếng là những mục tiêu dễ dàng, với nhiều hình ảnh công cộng có thể được sử dụng để huấn luyện thuật toán deepfake; làm video chất lượng cao về Donald Trump, ví dụ, là khá dễ dàng với anh ta xuất hiện trên TV ngày và đêm và ở mọi góc độ.

Công nghệ cơ bản cho deepfakes là một lĩnh vực nóng cho các công ty đang làm việc về các công nghệ như thực tế ảo. Vào thứ Sáu, Google đã phát hành một bước đột phá trong việc kiểm soát tri giác sâu trong cảnh quay video - giải quyết, trong quá trình đó, một dấu hiệu dễ nhận biết mà ám ảnh deepfakes. Trong bài báo của họ, được xuất bản vào thứ Hai dưới dạng bản trước, những nhà nghiên cứu của Samsung chỉ đến việc nhanh chóng tạo ra những hình ảnh đại diện cho trò chơi hoặc cuộc họp video. Ở mức độ giả tưởng, công ty có thể sử dụng mô hình cơ bản để tạo ra một hình ảnh đại diện chỉ với vài bức ảnh, một câu trả lời chân thực cho Memoji của Apple. Cùng một lab cũng xuất bản một bài báo trong tuần này về việc tạo ra hình ảnh đại diện toàn bộ cơ thể.

Lo ngại về việc sử dụng gian lận tiến bộ đó đã tạo nên một cuộc tranh luận về việc liệu deepfakes có thể được sử dụng để làm suy yếu nền dân chủ. Lo ngại là một deepfake được chế tạo một cách tài tình của một nhân vật nổi tiếng, có thể là một bản sao video điện thoại di động nho nhỏ để những không hoàn hảo của nó được bỏ qua, và được đồng bộ hóa đúng thời điểm, có thể tạo ra nhiều ý kiến. Điều này đã tạo nên cuộc đua vũ trang để tự động hóa cách phát hiện chúng trước cuộc bầu cử 2020. Darpa của Bộ Quốc phòng đã chi hàng chục triệu đô la vào chương trình nghiên cứu chứng cứ truyền thông, và một số công ty khởi nghiệp đang cố gắng trở thành trọng tài của sự thật khi chiến dịch bắt đầu.

Nhưng Robert Chesney, một giáo sư luật tại Đại học Texas, cho biết sự rối loạn chính trị không đòi hỏi công nghệ tiên tiến; nó có thể xuất phát từ những thứ chất lượng thấp, nhằm gieo rắc sự mất ổn định, nhưng không nhất thiết phải lừa đảo. Hãy xem, ví dụ, đoạn video ba phút của Nghị sĩ Quốc hội Nancy Pelosi lan truyền trên Facebook, dường như cho thấy bà nói lắp bắp khi say rượu ở nơi công cộng. Đó thậm chí không phải là một deepfake; kẻ phạm tội chỉ đơn giản là làm chậm lại cảnh quay.

Bằng cách giảm số lượng ảnh yêu cầu, phương pháp của Samsung thêm một vấn đề khác: 'Điều này có nghĩa là vấn đề lớn hơn đối với người bình thường,' Chesney nói. 'Một số người có thể cảm thấy an toàn một chút với sự ẩn danh khi họ không có nhiều bằng chứng video hoặc hình ảnh trực tuyến.' Gọi là 'học từ ít hình ảnh,' phương pháp thực hiện hầu hết công việc tính toán nặng nề trước thời gian. Thay vì được huấn luyện bằng, ví dụ, cảnh quay cụ thể của Trump, hệ thống được cung cấp một lượng lớn video có chứa nhiều người đa dạng. Ý tưởng là hệ thống sẽ học các đường nét cơ bản của đầu người và biểu hiện khuôn mặt. Từ đó, mạng nơ-ron có thể áp dụng những gì nó biết để điều khiển một khuôn mặt cụ thể dựa trên chỉ vài bức ảnh - hoặc, như trong trường hợp của Mona Lisa, chỉ một bức ảnh.

Phương pháp này tương tự như các phương pháp đã làm thay đổi cách mà các mạng nơ-ron học những điều khác, như ngôn ngữ, với bộ dữ liệu lớn giúp chúng học được các nguyên tắc có thể tổng quát hóa. Điều đó đã tạo ra các mô hình như GPT-2 của OpenAI, tạo ra ngôn ngữ viết mạch mà những người tạo ra đã quyết định không phát hành, vì sợ nó sẽ được sử dụng để tạo tin giả.

Có những thách thức lớn đối với việc sử dụng kỹ thuật mới này một cách ác ý đối với bạn và tôi. Hệ thống dựa vào ít hình ảnh của khuôn mặt mục tiêu, nhưng đòi hỏi việc đào tạo một mô hình lớn từ đầu, điều này tốn kém và tốn thời gian, và có lẽ sẽ chỉ trở nên đắt đỏ hơn. Chúng cũng đòi hỏi sự hiểu biết để sử dụng. Không rõ tại sao bạn muốn tạo video từ đầu, thay vì sử dụng các kỹ thuật đã được thiết lập trong chỉnh sửa phim hoặc PhotoShop. 'Những người tuyên truyền là những người thực tế. Có nhiều cách chi phí thấp hơn để làm điều này,' nói Hwang.

Hiện tại, nếu nó được điều chỉnh để sử dụng một cách ác ý, dạng lừa dối cụ thể này sẽ dễ phát hiện, theo Siwei Lyu, một giáo sư tại Đại học Albany thuộc Hệ thống Đại học New York nghiên cứu về chứng cứ truyền thông deepfake trong chương trình của Darpa. Bản demo, mặc dù ấn tượng, bỏ sót các chi tiết tinh tế, như nốt ruồi nổi tiếng của Marilyn Monroe, mà biến mất khi cô gật đầu cười. Các nhà nghiên cứu cũng chưa giải quyết được những thách thức khác, như cách đồng bộ âm thanh một cách đúng đắn với deepfake, và cách làm mờ các nền không ổn định. Để so sánh, Lyu gửi cho tôi một ví dụ tiên tiến sử dụng một kỹ thuật truyền thống hơn: một video kết hợp khuôn mặt của Obama với một người giả mạo hát 'Happy' của Pharrell Williams. Các nhà nghiên cứu ở Albany không công bố phương pháp, ông nói, vì khả năng nó có thể được sử dụng như một vũ khí.

Hwang không nghi ngờ rằng công nghệ cải tiến sẽ cuối cùng làm cho khó phân biệt giả mạo và thực tế. Chi phí sẽ giảm xuống, hoặc một mô hình được đào tạo tốt hơn sẽ được phát hành somehow, giúp một số người sáng tạo tạo ra một công cụ mạnh mẽ trực tuyến. Khi thời gian đó đến, ông cho rằng giải pháp không nhất thiết sẽ là chuyên sâu về chứng cứ số, mà là khả năng nhìn nhận vào các dấu hiệu ngữ cảnh - một cách mạnh mẽ để công chúng đánh giá bằng chứng ngoài video, xác nhận hoặc bác bỏ sự chính xác của nó. Kiểm chứng sự thật, cơ bản là vậy.

Tuy nhiên, việc kiểm chứng như vậy đã chứng minh là một thách thức đối với các nền tảng kỹ thuật số, đặc biệt khi đến lúc hành động. Như Chesney chỉ ra, hiện tại đủ dễ dàng để phát hiện ra đoạn video đã được chỉnh sửa, như video Pelosi. Câu hỏi là phải làm gì tiếp theo, mà không rơi vào một dốc trơn để xác định ý định của người tạo ra - liệu đó có phải là châm biếm, có lẽ, hay tạo ra với tâm ý ác độc. 'Nếu nó có vẻ rõ ràng được thiết kế để lừa dối người nghe nghĩ về một cái gì đó có tính chất tiêu cực, thì có vẻ rõ ràng phải loại bỏ nó,' ông nói. 'Nhưng sau đó, khi bạn bước vào con đường đó, bạn sẽ rơi vào một tình thế vẽ đường.'

Đến cuối tuần, Facebook dường như đã đưa ra một kết luận tương tự: Video Pelosi vẫn đang được chia sẻ trên internet - với, theo công ty, bối cảnh bổ sung từ các nhà kiểm chứng độc lập.

Những điều tuyệt vời hơn từ MYTOUR

- What tech companies pay employees in 2019

- Facing the ubiquity of Fortnite in our kids' lives

- Thinking of buying a new camera? Go mirrorless

- Feds busted the dark-web drug trade—and it's rebounding

- LA’s plan to reboot its bus system using cell phone data

- 📱 Torn between the latest phones? Never fear—check out our iPhone buying guide and favorite Android phones

- 📩 Hungry for even more deep dives on your next favorite topic? Sign up for the Backchannel newsletter