Trí tuệ nhân tạo trước đây là điều mà người thông thường mô tả ở mức trừu tượng. Họ không có mối quan hệ cảm giác với nó mà họ có ý thức, ngay cả khi thiết bị của họ thường xuyên sử dụng nó. Mọi thứ đã thay đổi trong năm qua khi mọi người đã bắt đầu tương tác với các chương trình AI như DALL-E và ChatGPT của OpenAI, và công nghệ này đang phát triển nhanh chóng.

Khi AI trở nên dân chủ hóa, chính dân chủ cũng đang phải đối mặt với áp lực mới. Có nhiều cách thú vị mà nó sẽ được triển khai, nhưng cũng có thể bắt đầu biến tướng hiện thực và có thể trở thành một đe dọa lớn đối với cuộc bầu cử tổng thống năm 2024 nếu âm thanh, hình ảnh và video được tạo ra bởi AI của ứng cử viên tràn lan. Đường ranh giới giữa thực và giả có thể bắt đầu mờ đi đáng kể hơn so với thời đại thông tin sai lệch.

“Chúng ta đã thấy những biến động đáng kể trong cảnh quan khi sử dụng các công cụ tạo sinh, đặc biệt là trong năm qua,” nói Henry Ajder, một chuyên gia AI độc lập. “Tôi nghĩ quy mô nội dung mà chúng ta đang thấy được tạo ra trực tiếp liên quan đến sự mở rộng đột ngột đó về sự tiếp cận.”

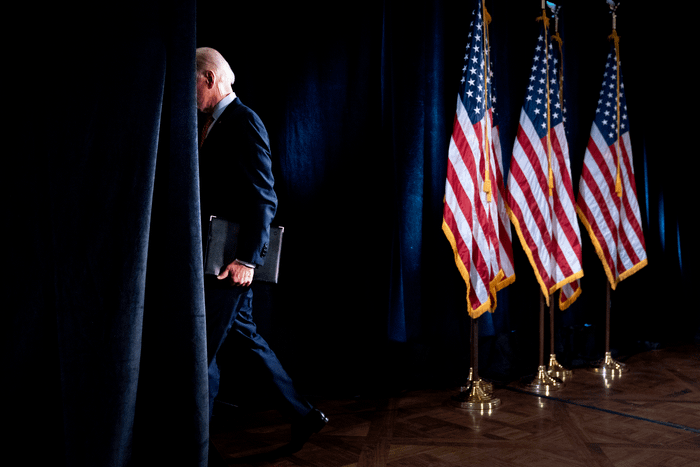

Không phải là một câu hỏi về việc liệu nội dung được tạo ra bởi trí tuệ nhân tạo có đóng một vai trò trong chính trị hay không, vì nó đã diễn ra. Hình ảnh và video được tạo ra bởi AI với sự xuất hiện của Tổng thống Joe Biden và Donald Trump đã bắt đầu lan truyền trên internet. Các đảng viên Cộng hòa gần đây đã sử dụng trí tuệ nhân tạo để tạo ra một đoạn quảng cáo tấn công chống Biden. Câu hỏi là, điều gì sẽ xảy ra khi bất kỳ ai cũng có thể mở laptop của họ và, với rất ít cố gắng, nhanh chóng tạo ra một video deepfake thuyết phục về một chính trị gia?

Có nhiều cách để tạo ra hình ảnh AI từ văn bản, như DALL-E, Midjourney và Stable Diffusion. Việc tạo ra một bản sao của giọng nói của ai đó với chương trình AI như chương trình được cung cấp bởi ElevenLabs là dễ dàng. Việc tạo ra video deepfake thuyết phục vẫn khó, nhưng Ajder nói rằng có thể sẽ không phải là trường hợp trong một năm hoặc thậm chí ngắn hơn.

“Để tạo ra một deepfake chất lượng cao thực sự đòi hỏi một mức độ chuyên nghiệp khá lớn, cũng như kiến thức chuyên sâu về hậu kỳ để sửa chữa kết quả mà AI tạo ra,” Ajder nói. “Video thực sự là bước tiến mới trong trí tuệ nhân tạo sáng tạo.”

Một số video deepfake của các nhân vật chính trị đã xuất hiện trong những năm gần đây, như một video của Tổng thống Ukraine Volodymyr Zelensky kêu gọi binh lính của mình đầu hàng được phát sóng năm ngoái. Một khi công nghệ đã tiến xa hơn, điều này có thể không mất nhiều thời gian, xem xét cách mà các hình thức khác của trí tuệ nhân tạo sáng tạo đang phát triển nhanh chóng, nhiều video kiểu này có thể xuất hiện khi chúng trở nên thuyết phục và dễ dàng sản xuất hơn.

“Tôi không nghĩ có một trang web nào bạn có thể nói ‘Tạo cho tôi một video của Joe Biden nói về X.’ Điều đó chưa tồn tại, nhưng sẽ tồn tại,” nói Hany Farid, một giáo sư tại Trường Thông tin của Đại học California, Berkeley. “Đó chỉ là vấn đề thời gian. Người ta đã bắt đầu làm việc trên việc chuyển đổi văn bản thành video.”

Điều đó bao gồm các công ty như Runway, Google và Meta. Một khi một công ty phát hành một phiên bản chất lượng cao của công cụ trí tuệ nhân tạo sáng tạo từ văn bản thành video, chúng ta có thể thấy nhiều công ty khác nhanh chóng phát hành phiên bản của họ, như chúng ta đã thấy sau khi ChatGPT được phát hành. Farid nói rằng không ai muốn bị “bị bỏ lại,” vì vậy những công ty này thường chỉ phát hành những gì họ có ngay khi có thể.

“Điều đó liên tục làm tôi kinh ngạc rằng trong thế giới vật lý, khi chúng ta phát hành sản phẩm, có các hướng dẫn cực kỳ nghiêm ngặt,” Farid nói. “Bạn không thể phát hành một sản phẩm và hy vọng nó không giết chết khách hàng của bạn. Nhưng với phần mềm, chúng ta như, ‘Điều này không hoạt động thực sự, nhưng hãy xem điều gì xảy ra khi chúng ta phát hành nó cho tỷ lệ người dùng hàng tỷ.’”

Nếu chúng ta bắt đầu thấy một số lượng đáng kể các video deepfake lan truyền trong cuộc bầu cử, dễ tưởng tượng ai đó như Donald Trump chia sẻ loại nội dung này trên mạng xã hội và khẳng định đó là thật. Một video deepfake của Tổng thống Biden nói một điều gì đó không thích hợp có thể xuất hiện ngay trước cuộc bầu cử, và nhiều người có thể sẽ không bao giờ biết rằng nó được tạo ra bởi trí tuệ nhân tạo. Nghiên cứu đã liên tục cho thấy, sau tất cả, tin giả mạo lan rộng hơn tin thật.

Ngay cả khi deepfakes không trở nên phổ biến trước cuộc bầu cử 2024, còn 18 tháng nữa, việc duy nhất là loại nội dung này có thể được tạo ra cũng có thể ảnh hưởng đến cuộc bầu cử. Việc biết rằng hình ảnh, âm thanh và video giả mạo có thể được tạo ra một cách tương đối dễ dàng có thể khiến người ta không tin tưởng vào nội dung chính thức mà họ gặp phải.

“Ở một số khía cạnh, deepfakes và trí tuệ nhân tạo sáng tạo thậm chí không cần phải tham gia vào cuộc bầu cử để vẫn gây rối, bởi vì giờ đây giếng đã bị đầu độc với ý nghĩa rằng mọi thứ có thể là giả mạo,” Ajder nói. “Điều này cung cấp một lý do hữu ích nếu có điều gì đó không thuận tiện xuất hiện có liên quan đến bạn. Bạn có thể bác bỏ nó là giả mạo.”

Vậy làm thế nào có thể giải quyết vấn đề này? Một giải pháp là cái gọi là C2PA. Công nghệ này ký số mọi nội dung được tạo ra bởi một thiết bị, như điện thoại hoặc máy quay video, và ghi chép ai đã chụp ảnh, ở đâu và khi nào. Chữ ký mật mã sau đó được giữ trên một sổ cái không thể thay đổi trung tâm. Điều này sẽ cho phép những người sản xuất video chính thức chứng minh rằng chúng là chính thức.

Một số lựa chọn khác liên quan đến cái gọi là việc đặt dấu vết và đóng dấu ảnh và video. Dấu vết bao gồm việc lấy những gì được gọi là “hash” từ nội dung, đó thực sự chỉ là chuỗi dữ liệu của nó, để sau này có thể được xác minh là chính thức. Đóng dấu, như bạn có thể mong đợi, bao gồm việc chèn một dấu nước số lên ảnh và video.

Thường được đề xuất rằng công cụ trí tuệ nhân tạo có thể được phát triển để phát hiện deepfakes, nhưng Ajder không tin vào giải pháp đó. Anh ta nói rằng công nghệ không đủ đáng tin cậy và nó sẽ không thể theo kịp với những công cụ trí tuệ nhân tạo sáng tạo liên tục thay đổi đang được phát triển.

Một khả năng cuối cùng để giải quyết vấn đề này là phát triển một loại bộ kiểm tra sự thật ngay lập tức cho người dùng truyền thông xã hội. Aviv Ovadya, một nghiên cứu viên tại Trung tâm Berkman Klein về Internet & Society tại Đại học Harvard, nói bạn có thể làm nổi bật một phần nội dung trong ứng dụng và gửi nó đến một động cơ ngữ cảnh có thể thông báo cho bạn về tính chính xác của nó.

“Sự hiểu biết truyền thông tiến triển theo tốc độ tiến bộ của công nghệ này không dễ dàng. Bạn cần nó gần như tức thì—khi bạn nhìn vào một cái gì đó bạn thấy trực tuyến và bạn có thể có ngữ cảnh về điều đó,” Ovadya nói. “Đó là cái gì bạn đang nhìn? Bạn có thể đối chiếu nó với nguồn bạn có thể tin cậy.”

Nếu bạn nhìn thấy một cái gì đó có thể là tin giả mạo, công cụ có thể nhanh chóng thông báo cho bạn về tính chính xác của nó. Nếu bạn nhìn thấy một hình ảnh hoặc video có vẻ giả mạo, nó có thể kiểm tra nguồn để xem liệu nó đã được xác minh hay chưa. Ovadya nói rằng nó có thể có sẵn trong các ứng dụng như WhatsApp và Twitter, hoặc có thể chỉ là một ứng dụng riêng của nó. Vấn đề, ông nói, là nhiều nhà sáng lập mà ông đã nói chuyện đơn giản không thấy có nhiều tiền trong việc phát triển một công cụ như vậy.

Có hay không bất kỳ giải pháp nào trong những giải pháp có thể được áp dụng trước cuộc bầu cử 2024 vẫn là điều còn phải chờ đợi, nhưng mối đe dọa đang tăng lên, và có rất nhiều tiền đang được đầu tư vào việc phát triển trí tuệ nhân tạo sáng tạo và rất ít tiền đang được đầu tư vào việc tìm cách ngăn chặn sự lan truyền của loại thông tin sai lệch này.

“Tôi nghĩ chúng ta sẽ thấy một làn sóng các công cụ, như chúng ta đã thấy, nhưng tôi nghĩ [nội dung chính trị được tạo bởi trí tuệ nhân tạo] sẽ tiếp tục,” Ajder nói. “Về cơ bản, chúng ta không ở trong một tư thế tốt để đối mặt với những công nghệ mạnh mẽ, di chuyển nhanh như vậy.”