Kiến trúc Gaudi là sự lựa chọn mà MLPerf đánh giá có thể cạnh tranh với Nvidia H100 trong việc đào tạo và suy luận các mô hình ngôn ngữ lớn.

Intel gần đây đã công bố những tiến bộ đáng kể trong lĩnh vực AI tạo sinh và các mô hình ngôn ngữ lớn (LLMs), với tâm điểm là bộ tăng tốc AI mang tên Gaudi-3. Mục tiêu của việc ra mắt này là gia tăng tốc độ xử lý và giảm chi phí cho các tác vụ AI. Bằng cách tận dụng cơ sở hạ tầng x86 - lựa chọn phổ biến và được sử dụng rộng rãi trong gần như tất cả môi trường trung tâm dữ liệu, Intel đang mở ra cơ hội tích hợp mượt mà công nghệ AI, đồng thời đảm bảo khả năng tương thích chi phí hiệu quả và tận dụng lợi ích từ một hệ sinh thái mở cho các nhà phát triển và khách hàng.

Trong trái tim của sáng kiến này là các bộ xử lý Intel Xeon, được xem là lựa chọn lý tưởng cho các tác vụ AI. Khi kết hợp với bộ tăng tốc AI Gaudi của Intel, được thiết kế đặc biệt cho các nhiệm vụ AI, chúng tạo nên một giải pháp mạnh mẽ và tích hợp hoàn hảo vào cơ sở hạ tầng hiện có.

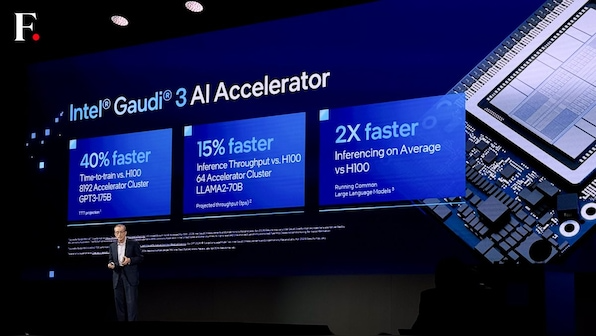

Intel thuyết trình về Gaudi-3 tại Computex 2024

Kiến trúc Gaudi là lựa chọn mà MLPerf đánh giá có thể sánh kịp với Nvidia H100 trong việc đào tạo và suy luận các mô hình ngôn ngữ lớn, mang lại cho khách hàng hiệu suất AI thế hệ mới với lợi thế về hiệu suất giá thành. Lợi ích này không chỉ đem lại sự lựa chọn mà còn hỗ trợ triển khai nhanh chóng với chi phí vận hành tổng thể thấp hơn.

Intel cung cấp các bộ kit AI tiêu chuẩn bao gồm tám bộ tăng tốc Intel Gaudi 2 với một bảng mạch chung (UBB) với giá 65,000 USD, ước tính chỉ bằng một phần ba so với chi phí của các nền tảng cạnh tranh tương đương. Ngoài ra, các bộ kit bao gồm tám bộ tăng tốc Intel Gaudi 3 với một bảng gốc chung được niêm yết với giá 125,000 USD, khoảng hai phần ba chi phí so với các nền tảng cạnh tranh tương đương.

Bộ tăng tốc Intel Gaudi 3 hứa hẹn mang lại sự cải thiện đáng kể trong hiệu suất cho việc đào tạo và suy luận trên các mô hình AI mới, giúp các doanh nghiệp khai thác dữ liệu độc quyền của họ. Trong một cụm 8,192 bộ tăng tốc, Gaudi 3 dự kiến sẽ cung cấp thời gian đào tạo nhanh hơn tới 40% so với cụm GPU Nvidia H100 cùng kích thước và tốc độ đào tạo nhanh hơn tới 15% cho cụm 64 bộ tăng tốc so với Nvidia H100 trên mô hình Llama2-70B. Ngoài ra, Intel Gaudi 3 dự kiến sẽ cung cấp hiệu suất suy luận nhanh gấp đôi so với Nvidia H100 khi chạy các mô hình ngôn ngữ lớn như Llama-70B và Mistral-7B.

Để đảm bảo sự phân phối rộng rãi của các hệ thống AI này, Intel đang hợp tác với ít nhất 10 nhà cung cấp hệ thống hàng đầu trên toàn thế giới, trong đó có sáu nhà cung cấp mới giới thiệu Intel Gaudi 3 ra thị trường. Trong số các đối tác có Asus, Foxconn, Gigabyte, Inventec, Quanta và Wistron, họ đang mở rộng sản phẩm cùng với các nhà cung cấp hệ thống hàng đầu như Dell, Hewlett-Packard Enterprise, Lenovo và Supermicro. Mục tiêu của sự hợp tác này là làm cho các khả năng AI tiên tiến dễ tiếp cận hơn với đông đảo người dùng, thúc đẩy sự đổi mới và tiến bộ trong lĩnh vực trí tuệ nhân tạo.