JEST Mới Của DeepMind Mang Lại Tin Vui Đối Với Lo Ngại Về Năng Lượng Điện Do Nhu Cầu AI Tăng Cao.

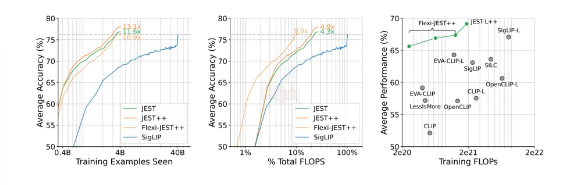

Google DeepMind, Một Trong Những Công Ty Hàng Đầu Về Nghiên Cứu Trí Tuệ Nhân Tạo, Công Bố Phương Pháp Đào Tạo AI Mới Gọi Là JEST, Hứa Hẹn Tăng Tốc Độ Đào Tạo Lên Đến 13 Lần Và Tiết Kiệm Năng Lượng Cao Hơn 10 Lần So Với Các Phương Pháp Truyền Thống. Điều Này Quan Trọng Trong Bối Cảnh Ngành Công Nghệ Đang Đối Mặt Với Áp Lực Về Môi Trường Từ Trung Tâm Dữ Liệu AI.

Sự Khác Biệt Chính Của JEST So Với Các Phương Pháp Truyền Thống Là Thay Vì Tập Trung Vào Từng Điểm Dữ Liệu Riêng Lẻ, Nó Tập Trung Vào Toàn Bộ Các Batch Dữ Liệu. Trong Quá Trình Này, Một Mô Hình AI Nhỏ Hơn Được Sử Dụng Để Đánh Giá Chất Lượng Dữ Liệu Từ Các Nguồn Cao Cấp, Sau Đó Xếp Hạng Các Batch Theo Chất Lượng. Kết Quả Từ Mô Hình Nhỏ Này Sau Đó Được Sử Dụng Để Đào Tạo Một Mô Hình Lớn Hơn.

DeepMind Đặt Nặng Việc Đào Tạo Mô Hình Với Dữ Liệu Chất Lượng Cao Do Con Người Quản Lý. Kỹ Thuật Này Phụ Thuộc Nhiều Vào Nguyên Tắc 'Rác Vào, Rác Ra', Do Đó Yêu Cầu Kỹ Năng Quản Lý Dữ Liệu Cao Và Có Thể Không Phù Hợp Với Nhà Phát Triển AI Nghiệp Dư.

Việc Sử Dụng Phương Pháp JEST Rộng Rãi Trong Ngành Công Nghiệp AI Có Thể Đóng Góp Đáng Kể Giảm Chi Phí Và Tiêu Thụ Năng Lượng Trong Quá Trình Đào Tạo. Tuy Nhiên, Việc Áp Dụng Phương Pháp Này Trong Các Công Ty Lớn Vẫn Là Một Câu Hỏi Mở, Bởi Chi Phí Đào Tạo Các Mô Hình AI Dự Báo Sẽ Ngày Càng Tăng Cao, Có Thể Lên Đến Một Tỷ Đô La Cho Một Số Mô Hình Trong Tương Lai.

Phương Pháp JEST Có Thể Là Giải Pháp Giảm Chi Phí Và Tiêu Tốn Năng Lượng, Nhưng Cũng Có Thể Dẫn Đến Sử Dụng Năng Lượng Mạnh Mẽ Hơn Để Đạt Tốc Độ Đào Tạo Nhanh Hơn. Quan Trọng Là Làm Thế Nào Để Cân Bằng Giữa Tiết Kiệm Chi Phí Và Quy Mô Đầu Ra Để Tối Đa Hóa Hiệu Quả Cuối Cùng.