Tác động đáng kể khi lòng tin từ các nhà đầu tư bị tác động. Chatbot Bard, dựa trên mô hình ngôn ngữ LaMDA của Google, gặp rắc rối do clip quảng cáo chứa thông tin sai lệch. Sự kiện livestream giới thiệu mô hình ngôn ngữ rạng sáng thứ 5 theo giờ Việt Nam không ấn tượng, khiến giá cổ phiếu của Alphabet tụt 9% trong phiên giao dịch hôm thứ 4 ở Mỹ.

Con số này tương đương 100 tỷ USD giá trị vốn hoá trên thị trường chứng khoán đã bị cuốn trôi. Coi đây là hậu quả của một màn giới thiệu sản phẩm mới không như ý muốn từ Google. Trong khi đó, Microsoft ghi nhận giá cổ phiếu tăng 3% ngay sau khi công bố trình duyệt Edge và công cụ tìm kiếm Bing kết hợp mô hình ngôn ngữ Prometheus, đã có bản thử nghiệm.

Khám phá thêm:

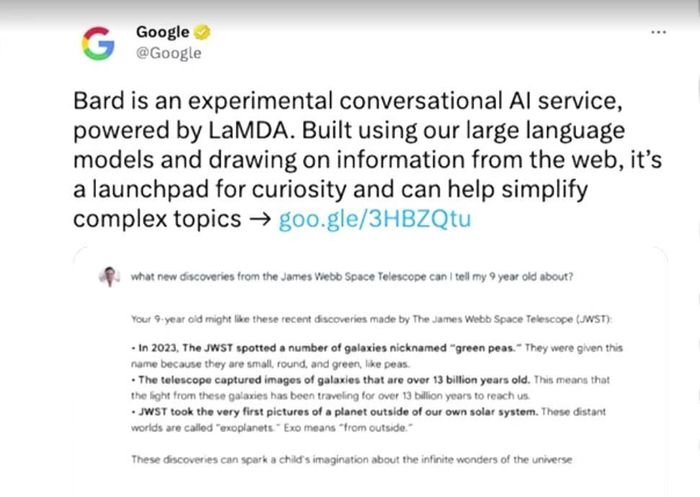

Câu chuyện bắt đầu khi Alphabet chia sẻ một số hình ảnh mô tả cách Bard hoạt động trên Twitter, hứa hẹn rằng mô hình ngôn ngữ của chatbot có thể đơn giản hóa câu trả lời cho những vấn đề phức tạp.

Điều thú vị là, câu trả lời trong ví dụ mà Google cung cấp lại không chính xác. Bard cung cấp thông tin cho biết kính thiên văn James Webb (JWST) là hệ thống đầu tiên chụp được hình ảnh một hành tinh ngoài hệ Mặt Trời vào năm 2023. Thông tin đúng phải là năm 2004, khi hệ thống kính thiên văn VLT của đài thiên văn phía nam châu Âu chụp được hình ảnh của một hành tinh ngoài hệ Mặt Trời. Thông tin này đã được NASA xác nhận:

Tính đến thời điểm hiện tại, bức tranh này đã thu hút hàng triệu lượt xem trên Twitter.

Gil Luria, chuyên gia phân tích phần mềm tại D.A. Davidson, cho biết: “Google trước đây đã dẫn đầu trong cuộc đua về trí tuệ nhân tạo trong vài năm, nhưng gần đây, dường như họ đã bị bỏ lại trong việc tích hợp công nghệ này vào sản phẩm tìm kiếm trực tuyến. Trong vài tuần qua, Google đã nhanh chóng đuổi kịp thời gian, cố gắng tích hợp trí tuệ nhân tạo vào công cụ tìm kiếm, dẫn đến việc sản phẩm mới ra mắt hối hả, với kết quả là bản demo đáng xấu hổ khi thông tin tìm kiếm hiển thị không chính xác.”

Người phát ngôn của Google đã đưa ra giải thích cho sự cố này: “Điều này làm nổi bật tầm quan trọng của quá trình thử nghiệm, mà chúng tôi sẽ bắt đầu trong tuần này thông qua chương trình Trusted Tester. Chúng tôi sẽ kết hợp ý kiến độc lập với thử nghiệm nội bộ để đảm bảo rằng Bard có thể đáp ứng đúng những yêu cầu cao về tiêu chuẩn, an toàn và độ chính xác của thông tin.”Trong thế giới của chatbot AI, luôn có những lo ngại rằng chúng có thể bị ảnh hưởng bởi thông tin sai lệch do con người tạo ra trong quá trình huấn luyện thuật toán. Microsoft đã trải qua tình huống tương tự năm 2016 khi ra mắt một chatbot trên Twitter. Họ đã phải tắt nó ngay lập tức vì chatbot này đưa ra những nội dung mang tính phân biệt chủng tộc.Theo thông tin từ Reuters

Tính đến thời điểm hiện tại, bức tranh này đã thu hút hàng triệu lượt xem trên Twitter.

Gil Luria, chuyên gia phân tích phần mềm tại D.A. Davidson, cho biết: “Google trước đây đã dẫn đầu trong cuộc đua về trí tuệ nhân tạo trong vài năm, nhưng gần đây, dường như họ đã bị bỏ lại trong việc tích hợp công nghệ này vào sản phẩm tìm kiếm trực tuyến. Trong vài tuần qua, Google đã nhanh chóng đuổi kịp thời gian, cố gắng tích hợp trí tuệ nhân tạo vào công cụ tìm kiếm, dẫn đến việc sản phẩm mới ra mắt hối hả, với kết quả là bản demo đáng xấu hổ khi thông tin tìm kiếm hiển thị không chính xác.”

Người phát ngôn của Google đã đưa ra giải thích cho sự cố này: “Điều này làm nổi bật tầm quan trọng của quá trình thử nghiệm, mà chúng tôi sẽ bắt đầu trong tuần này thông qua chương trình Trusted Tester. Chúng tôi sẽ kết hợp ý kiến độc lập với thử nghiệm nội bộ để đảm bảo rằng Bard có thể đáp ứng đúng những yêu cầu cao về tiêu chuẩn, an toàn và độ chính xác của thông tin.”Trong thế giới của chatbot AI, luôn có những lo ngại rằng chúng có thể bị ảnh hưởng bởi thông tin sai lệch do con người tạo ra trong quá trình huấn luyện thuật toán. Microsoft đã trải qua tình huống tương tự năm 2016 khi ra mắt một chatbot trên Twitter. Họ đã phải tắt nó ngay lập tức vì chatbot này đưa ra những nội dung mang tính phân biệt chủng tộc.Theo thông tin từ Reuters