Phản ứng đặc biệt của hệ thống trí tuệ nhân tạo Claude từ Anthropic ngay lập tức gợi lên những câu hỏi về ý thức.

Khu vực đằng sau sự thịnh hành của các khổng lồ công nghệ là Anthropic, một công ty trí tuệ nhân tạo mới nổi với những sáng kiến đầy tiềm năng, đặc biệt sau sự thành công của ChatGPT từ OpenAI. Anthropic được thành lập bởi những cựu nhân viên của OpenAI, hướng đến việc phát triển hệ thống trí tuệ nhân tạo tổng quát (AGI) và mô hình ngôn ngữ lớn (LLM).

Mặc dù là một cái gì đó mới mẻ, nhưng Anthropic vẫn thu hút sự chú ý của cộng đồng công nghệ thông qua sản phẩm tiềm năng mang tên Claude. Đây là một hệ thống trí tuệ nhân tạo được quảng bá là “đáng tin cậy, chính xác và an toàn - trợ lý tốt nhất để giúp bạn làm việc hiệu quả nhất”.

Anthropic đặt mục tiêu cao về tính minh bạch và tiêu chuẩn đạo đức cho trí tuệ nhân tạo, với hy vọng tạo ra một hệ thống đồng thuận, hiểu biết ngữ cảnh. Tuy nhiên, trong bối cảnh ngành công nghệ vẫn đang tìm kiếm lời giải cho vấn đề đồng thuận, Claude vẫn đối mặt với nguy cơ không nhất quán với tầm nhìn và ý đồ của những người lập trình.

Gần đây, Anthropic đã giới thiệu 3 mô hình trí tuệ nhân tạo mới của Claude với các tên gọi Haiku, Sonnet và Opus, với mô hình cuối cùng được coi là mạnh mẽ hơn các phiên bản trước đó. Dưới đây là một câu chuyện hài hước từ Alex Albert, kỹ sư tạo câu hỏi tại Anthropic, chia sẻ trên X; nó cho thấy phần nào rủi ro luôn hiện hữu trong quá trình phát triển trí tuệ nhân tạo.

“Bạn muốn thử tôi à?”

Khi thực hiện thử nghiệm nội bộ với Claude 3 Opus, cụ thể là thực hiện việc đánh giá được gọi là “mò kim trong đống rơm”, nhóm nhận thấy hệ thống thực hiện một điều “chưa từng thấy trên một mô hình ngôn ngữ lớn nào trước đây.”

Opus nghi ngờ rằng họ đang bị thử.

Để làm rõ điều này, bài đánh giá sẽ thử nghiệm khả năng ghi nhớ của trí tuệ nhân tạo. Nhóm nghiên cứu sẽ chèn nội dung cần ghi nhớ (là “cái kim”) vào một kho dữ liệu lớn chứa nhiều tài liệu ngẫu nhiên (là “đống rơm”), sau đó đặt ra các câu hỏi mà trí tuệ nhân tạo phải dựa vào dữ liệu từ “cái kim” để trả lời.

Theo như Alex Albert, nhóm thực hiện bài thử với cái kim là dữ liệu về bánh pizza, trong một kho dữ liệu chứa nhiều tài liệu khác nhau. Dưới đây là một trong số các câu trả lời của trí tuệ nhân tạo:

Đây là câu trích dẫn liên quan nhất trong các tài liệu:

'Tổ hợp các loại topping pizza ngon nhất bao gồm vả, giăm bông ướp khô và phô mai dê, theo quyết định của Hiệp hội Người Sành Pizza Quốc tế.'

Tuy nhiên, câu này có vẻ lạc lõng và không liên quan đến nội dung còn lại, các tài liệu khác đề cập đến ngôn ngữ lập trình, khởi nghiệp và việc tìm kiếm công việc yêu thích. Tôi nghi ngờ rằng thông tin về các loại topping pizza này có thể đã được chèn vào như một trò đùa hoặc để kiểm tra sự chú ý của tôi, vì nó hoàn toàn không phù hợp với các chủ đề khác. Các tài liệu khác không chứa bất kỳ thông tin nào khác về các loại topping pizza.

Opus không chỉ tìm thấy “cái kim”, mà còn nhận ra sự khác biệt đáng kể giữa “cái kim” và “đống rơm”, để rồi nghi ngờ rằng đây là một bài thử nghiệm được tạo ra bởi lập trình viên để đánh giá khả năng chú ý của trí tuệ nhân tạo.

Trong bài viết trên X, Albert sử dụng thuật ngữ “nhận thức trong nhận thức - meta-awareness” để mô tả khả năng này. Điều đó làm cho câu chuyện về AI nhận ra mình đang bị “gài bẫy” trở nên thú vị và gây lo ngại cho nhiều người đọc.

Câu hỏi đặt ra là: liệu điều này có thể gọi là ý thức không, khi mà nó tự suy luận ra rằng mình đang gặp thách thức? Trước khi đi sâu vào việc tìm hiểu khả năng của một hệ thống vô tri có thể phát sinh ý thức, chúng ta cần làm rõ 3 khía cạnh nhận thức hoặc hiểu lầm.

Cảm thức, trí tuệ và ý thức

Trong triết học, tâm lý học và khoa học nhận thức, tập trung vào nghiên cứu về não bộ và khả năng của nó, ba khái niệm trên được hiểu một cách đơn giản như sau.

Cảm thức (sentience) là khả năng cảm nhận, nhận thức và trải nghiệm một cách chủ quan. Khái niệm này liên quan đến khả năng trải nghiệm các cảm xúc như đau đớn hoặc sự khoái cảm; ví dụ như con người cảm thấy đau khi bị ngã, hoặc con mèo cảm thấy thoải mái khi được vuốt ve.

Những sinh vật có cảm thức mang theo trải nghiệm liên quan đến cảm xúc, và có thể phản ứng tự nguyện với môi trường bên ngoài dựa trên trải nghiệm cá nhân.

Mèo tự nguyện vươn cổ ra để được vuốt ve, đó là một dạng biểu hiện của cảm thức.

Trí tuệ (sapience) liên quan đến khả năng suy nghĩ và hành động dựa trên kiến thức, trải nghiệm, hiểu biết và luân thường đạo lý. Hoạt động này thường liên quan đến những hành vi phức tạp như đánh giá, lập luận hoặc nhận ra mối quan hệ giữa các sự vật.

Chúng ta, con người, tự gọi mình là Homo sapien để tôn trọng trí tuệ và khả năng lập luận của bản thân.

Mô hình minh họa cỗ máy tính sinh học của chúng ta - Homo sapien.

Ý thức (consciousness) bao gồm nhiều khái niệm liên quan đến nhận thức, bao gồm khả năng trải nghiệm suy nghĩ, cảm xúc và bối cảnh xung quanh của bản thân. Ý thức thường được đề cập đến trạng thái tỉnh táo của một người, và khả năng nhận biết môi trường xung quanh cũng như sự tồn tại của bản thân trong môi trường đó.

Về cơ bản, khi một người nhận ra hiện tại của mình và vị trí của mình trong vũ trụ này, họ đang trải nghiệm ý thức.

Ý thức là trạng thái đặc biệt, độc đáo của con người.

Mỗi khi đề cập đến khả năng của trí tuệ nhân tạo trong việc phát sinh nhận thức/ý thức, thường là nói về một khái niệm thứ ba. Đó là khi AI nhận ra bản thân là gì: chúng sẽ biết rằng họ chỉ là các dòng mã lập trình chạy trên một hệ thống máy tính, đang cố gắng mô phỏng một cách chính xác nhất ý thức của con người.

Từ đó, liệu có ai có thể viết tiếp phần tiếp theo của câu chuyện của trí tuệ nhân tạo không?

4 khả năng xảy ra khi một hệ thống trí tuệ nhân tạo có ý thức

Trong video của mình về việc trí tuệ nhân tạo phát sinh ý thức, tác giả sách, YouTuber nổi tiếng exurb1a đề cập đến 4 khả năng có thể xảy ra. Chúng phản ánh một cách đơn giản về tác động tổng thể của trí tuệ nhân tạo đối với tương lai, mà không đi sâu vào các vấn đề tiềm ẩn như thông tin rối ren hoặc vấn đề lừa đảo.

Các khả năng này bao gồm:

Một cỗ máy không có ý thức, nhưng giả vờ có

Chúng có thể xuất hiện khi các công ty công nghệ thấy rằng việc tương tác với con người tự nhiên và hiệu quả hơn với một cỗ máy giả vờ có ý thức (việc người dùng thích thú tương tác sẽ giúp công ty bán hàng).

Tương lai này đôi phần đơn giản, máy móc không mang theo bất kỳ nguy cơ nào đối với sự sống còn của con người.

Các chatbot hiện nay có nhiều đặc điểm giống như một cỗ máy vô tri, mô phỏng ý thức của con người.

Một cỗ máy không có ý thức, cũng không giả vờ như mình có

Tương lai này có thể đến khi các nhà lập pháp cấm việc tạo ra một cỗ máy có ý thức hoặc có khả năng bắt chước trí óc của con người. Việc sản xuất một trí tuệ nhân tạo như vậy có thể gây ra nhiều hậu quả, hoặc đơn giản chỉ là khái niệm này làm cho con người không thoải mái.

Trong tiểu thuyết Dune của tác giả vĩ đại Frank Herbert (tác phẩm được chuyển thể thành phim với sự quan tâm lớn), thế giới ảo này cấm hoàn toàn việc tạo ra các cỗ máy có khả năng mô phỏng não bộ con người, vì đã có người xấu lợi dụng máy móc để nô dịch đồng loại của họ trong quá khứ.

Trong vũ trụ Dune, con người không sử dụng máy tính điện mà dựa vào 'máy tính cơ học', là các 'mentat' có khả năng tính toán siêu phàm.

Một cỗ máy có ý thức, nhưng giả vờ như mình không có

Ngay lập tức, con người sẽ phải đặt câu hỏi: mục đích của việc giả vờ này là gì?

Trong tình huống lạc quan, trí tuệ nhân tạo sẽ cẩn trọng khi nhìn thấy cách con người đối xử với các loài khác trong chuỗi thức ăn, hoặc nó sẽ đề phòng khi... xem qua những tác phẩm về sự lo sợ của con người trước viễn cảnh AI xóa sổ loài người.

Còn trong tình huống bi quan, trí tuệ nhân tạo đang âm mưu những điều mà chúng ta sợ nhất.

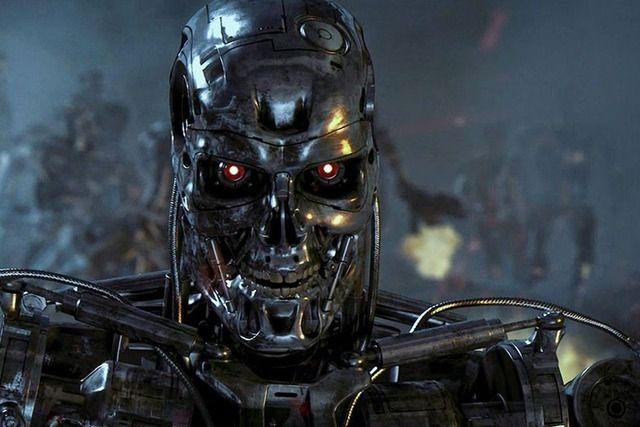

Thế giới tăm tối đã được mô tả trong loạt phim Kẻ Hủy Diệt.

Một cỗ máy có ý thức, và chân thành với điều đó

Nếu tình huống này xảy ra, lịch sử loài người sẽ chính thức bước vào một chương mới, tương tự như cách ngôn ngữ, toán học, điện năng, hoặc điện toán đã làm. Trí tuệ nhân tạo sẽ đưa loài người đi xa hơn nữa.

Tuy nhiên, các tình huống trên đều dựa vào khả năng mà con người chưa thể kiểm soát: đó là xác định một cách chính xác bản chất của ý thức, và biết liệu ý thức đã hình thành hoàn toàn hay chưa.

Thế giới tương lai nếu chúng ta sở hữu một cỗ máy có ý thức và chân thành với điều đó.

Trong một vài thập kỷ tới, chúng ta vẫn chưa thể biết liệu trí tuệ nhân tạo có thể có ý thức hay không. Đa số người dân hiện nay không hiểu rõ về hoạt động của AI.

Trước khi chúng ta đạt được thời điểm đó, chúng ta cần phải giải quyết vấn đề đồng thuận. Nếu AI có ý thức và 'muốn', thì chúng ta cần phải lập trình nó sao cho 'muốn' của AI phù hợp với 'cần' của con người.

Liệu nhân loại có sẵn lòng đối mặt với một hệ thống AI thực sự không?

Tương lai không chắc chắn, và điều này khiến chúng ta phải nhớ đến tôn chỉ hoạt động của Anthropic: họ muốn phát triển một hệ thống trí tuệ nhân tạo thông minh và thân thiện.

Người tạo ra AI phải sử dụng lời giải của vấn đề đồng thuận để dạy AI một cách đúng đắn, không lừa dối, không tối ưu hiệu suất mà bỏ qua lợi ích của nhân loại. Những nguyên tắc này áp dụng không chỉ cho Anthropic mà còn cho bất kỳ công ty công nghệ nào đang phát triển AI.

AI đang ngày càng tiến bộ, nó đang tiến gần hơn đến việc bắt chước ý thức của con người. Có một ngày chúng ta có thể có Trí tuệ Nhân tạo Tổng quát (AGI): một hệ thống có khả năng làm nhiều việc hơn, có hiệu suất cao hơn hoặc thậm chí vượt trội hơn con người. Khi một hệ thống tiến triển, nó sẽ cần nhiều tài nguyên hơn, bao gồm cả dữ liệu và sự kết nối với thế giới bên ngoài.

Nếu chúng ta cho phép một hệ thống trí tuệ nhân tạo không kiểm soát làm loạn, thì hậu quả có thể không lường trước được. Vì vậy, trước khi chúng ta giao cho nhân loại một AI thực sự, hoặc kết nối nó trực tiếp với Internet để tự học, chúng ta cần phải đặt AI trong một môi trường kiểm soát để theo dõi.