Hóa đồng nhân loại: Tại sao trí tuệ nhân tạo làm kém trong việc kiểm duyệt nội dung

Chào mừng bạn đến với 'Hóa đồng nhân loại.' Một loạt bài mới của Neural phân tích những nỗ lực của thế giới học máy trong việc tạo ra trí tuệ nhân tạo cấp độ con người. Các bài trước bao gồm có thể hài hước được giảm xuống thành một thuật toán? và Tại sao robot nên sợ cái chết như chúng ta.

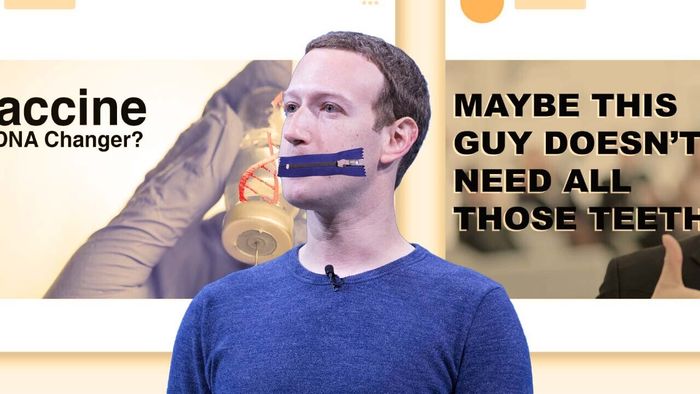

Meta (công ty mà ông bà của bạn vẫn gọi là Facebook) vừa giới thiệu một hệ thống trí tuệ nhân tạo mới mà họ gọi là 'một cột mốc quan trọng cho thấy một chuyển động hướng tới các hệ thống trí tuệ nhân tạo thông minh, tổng quát hơn.'

Nó được gọi là 'Meta AI Few-Shot Learner,' có lẽ vì người đặt tên thứ làm việc tại Meta đã đi nghỉ mát khi đến lúc đặt tên. Thậm chí nó còn không hoạt động như một từ viết tắt. MAIFSL? Không phải.

Ý tưởng lớn

Việc kiểm duyệt nội dung là khó khăn. Con người không hiểu nhau. Cho dù chúng ta nói về thế giới mở rộng trên Facebook và Twitter, cộng đồng nhỏ nhắn như diễn đàn đan, hoặc bất kỳ trang web nào có phần bình luận, nếu bạn đưa cho con người một chút nặc danh và một nền tảng, họ sẽ làm tổn thương lẫn nhau. Điều này không bao giờ thay đổi.

Vấn đề rất đơn giản. Nội dung vượt quá ranh giới - bất kỳ định nghĩa nào của một nền tảng cụ thể có thể là - cần được sắp xếp. Nhưng việc tìm ra một giải pháp là vô cùng khó khăn.

Ngay cả những nền tảng tự hào về việc không kiểm duyệt và tôn trọng đầy đủ quyền tự do ngôn luận cũng cần có hình thức kiểm duyệt nội dung. Chúng tôi không muốn video lạm dụng trẻ em và động vật lưu thông mà không kiểm soát hoặc kẻ giết người hàng loạt sử dụng các nền tảng truyền thông xã hội để phát sóng tội ác của họ.

Một vài chục năm trước, câu trả lời rất đơn giản. Cộng đồng trực tuyến chỉ định các bảo trì viên con người để giám sát diễn đàn. Càng nhiều người dùng một trang web có, càng cần nhiều bảo trì viên con người để duy trì cuộc trò chuyện lịch sự.

Thật không may, hệ thống đó không thể hoạt động ở quy mô toàn cầu. Chúng ta sẽ cần tạo ra một hành tinh hoàn toàn đầy bảo trì viên để giám sát tất cả mọi người trên hành tinh này. Và sau đó là một hành tinh khác để giám sát mọi người trên hành tinh thứ hai, và cứ như vậy.

Điều đó đặt ra cho các công ty truyền thông xã hội hai lựa chọn: hoặc giới hạn số lượng người dùng để có thể theo dõi bởi bảo trì viên con người, hoặc phát minh một cách để tự động hóa kiểm duyệt nội dung.

Thất bại hiệu quả hơn

Công nghệ lớn đã chọn 'không cái nào.' Tất cả các nền tảng truyền thông xã hội phổ biến đã trở nên quá lớn để việc kiểm duyệt của con người có tác động lớn, và hiện tại không có hệ thống trí tuệ nhân tạo nào mạnh mẽ đủ để hoạt động với hiệu suất ngang bằng một phần nhỏ của bảo trì viên con người.

Nói cách khác: Trí tuệ nhân tạo làm tệ trong việc kiểm duyệt nội dung. Và không có lý do nào để tin rằng điều đó sẽ thay đổi cho đến khi nó đạt được hiệu suất ngang bằng con người trong ngôn ngữ và hiểu biết xã hội.

Điều này không xảy ra với hệ thống mới này. Nó vẫn sẽ thất bại trong việc kiểm duyệt đa số lớn nội dung người dùng trên nền tảng. Nó chỉ sẽ thất bại hiệu quả hơn.

Trí tuệ nhân tạo mới của Meta là một hệ thống học một vài bước. Điều đó có nghĩa là nó là một mô hình nhỏ, dễ đào tạo có thể được điều chỉnh và cập nhật nhanh hơn so với các mô hình lớn, chậm hơn.

Nghiên cứu rất hấp dẫn và khả năng của đội ngũ để khiến trí tuệ nhân tạo làm nhiều với lượng dữ liệu ít đến đáng kinh ngạc. Nhưng tuyên bố rằng điều này 'đánh dấu một chuyển động hướng tới các hệ thống trí tuệ nhân tạo thông minh, tổng quát hơn,' là điều buồn cười nhất ít nhất.

Điều đó cũng mỉa mai. Thuật ngữ 'trí tuệ nhân tạo tổng quát' (AGI) được sử dụng để mô tả một trí tuệ nhân tạo có khả năng thực hiện bất kỳ chiến công nào mà con người có thể, với cùng quyền truy cập. Và, mặc dù có lẽ đó là những gì cần thiết để trí tuệ nhân tạo kiểm duyệt nội dung thành công ở quy mô của truyền thông xã hội, nhưng rõ ràng là làm cho một mô hình ngôn ngữ hiệu quả hơn một chút không giống như việc giải quyết AGI.