IBM cam kết nền tảng suy luận quy mô cao ModelMesh cho mã nguồn mở

IBM đã thông báo hôm nay rằng họ đã cam kết dịch vụ suy luận ModelMesh của họ cho mã nguồn mở. Điều này quan trọng đối với cộng đồng MLOps và DevOps, nhưng các tác động đối với người dùng cuối trung bình cũng rất lớn.

Trí tuệ nhân tạo là một công nghệ cốt lõi mà gần như tất cả doanh nghiệp đều phụ thuộc vào. Đa số bài viết của chúng tôi trên Neural thường thảo luận về những thách thức trong việc huấn luyện và phát triển các mô hình AI.

Nhưng khi đến việc triển khai các mô hình AI để chúng có thể làm điều chúng được thiết kế để làm khi chúng cần làm, quy mô vấn đề là vô cùng lớn lao.

Hãy tưởng tượng: bạn đăng nhập vào tài khoản ngân hàng của mình và phát hiện một không khớp. Bạn chạm vào biểu tượng “Làm thế nào chúng tôi có thể giúp?” ở phía dưới màn hình và một cửa sổ trò chuyện mở ra.

Bạn nhập một truy vấn như “Tại sao số dư của tôi không phản ánh các giao dịch gần đây nhất của tôi?” Một chat bot trả lời rằng “Chờ một lát, tôi sẽ kiểm tra tài khoản của bạn,” và sau đó, như phép màu, nó nói rằng “Tôi đã tìm thấy vấn đề” và cung cấp cho bạn một phản hồi chi tiết về điều đã xảy ra.

Những gì bạn đã làm là gửi một yêu cầu suy luận đến một mô hình học máy. Mô hình đó, sử dụng một kỹ thuật gọi là xử lý ngôn ngữ tự nhiên (NLP), phân tích văn bản trong truy vấn của bạn và sau đó lọc qua tất cả dữ liệu huấn luyện của nó để xác định cách tốt nhất để phản hồi.

Nếu mà nó hoạt động như dự kiến và một cách nhanh chóng và chính xác, bạn có thể rời đi từ trải nghiệm đó với một cái nhìn tích cực về hệ thống.

Nhưng nếu nó trì hoãn hoặc không tải được kết quả suy luận? Bạn cuối cùng sẽ lãng phí thời gian với một chat bot và vẫn cần giải quyết vấn đề của bạn.

ModelMesh có thể giúp.

Animesh Singh, Giám đốc Công nghệ Watson AI & ML Open Tech của IBM, nói với Neural:

ModelMesh là nền tảng cơ bản của hầu hết các dịch vụ đám mây Watson, bao gồm Trợ lý Watson, Hiểu Ngôn ngữ Tự nhiên Watson và Khám Phá Watson và đã hoạt động trong nhiều năm.

IBM hiện đang đóng góp nền tảng suy luận cho cộng đồng mã nguồn mở KServe.

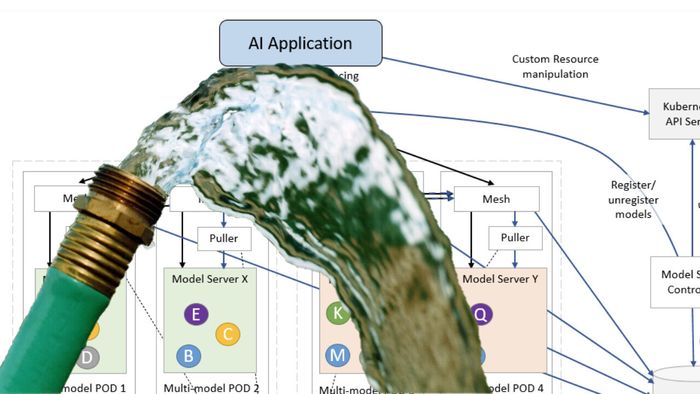

Được thiết kế cho các trường hợp sử dụng mô hình quy mô lớn, mật độ cao và thay đổi thường xuyên, ModelMesh có thể giúp các nhà phát triển mở rộng Kubernetes.

ModelMesh, kết hợp với KServe, cũng sẽ thêm các chỉ số AI Đáng tin cậy như khả năng giải thích, công bằng cho các mô hình triển khai trong sản xuất.

Quay trở lại ví dụ về khách hàng ngân hàng của chúng ta, chúng ta biết rằng chúng tôi không phải là người dùng duy nhất mà trí tuệ nhân tạo của ngân hàng cần phục vụ. Có thể có hàng triệu người dùng truy vấn cùng một giao diện đồng thời. Và những triệu truy vấn này có thể đòi hỏi dịch vụ từ hàng nghìn mô hình khác nhau.

Tìm cách tải tất cả các mô hình này vào thời gian thực để chúng có thể hoạt động theo cách phù hợp với nhu cầu của khách hàng của bạn có thể là một trong những thách thức lớn nhất mà bất kỳ đội IT của công ty nào cũng phải đối mặt.

ModelMesh quản lý cả việc tải và giải phóng các mô hình vào bộ nhớ để tối ưu chức năng và giảm thiểu việc tiêu tốn năng lượng không cần thiết.

Theo thông cáo báo chí của IBM:

Nó được thiết kế cho các trường hợp sử dụng mô hình quy mô lớn, mật độ cao và thay đổi thường xuyên. ModelMesh thông minh tải và giải phóng các mô hình trí tuệ nhân tạo vào và ra khỏi bộ nhớ để đạt được sự đáp ứng thông minh giữa người dùng và dấu chân tính toán của họ.

Bạn có thể tìm hiểu thêm về ModelMesh tại trang web của IBM tại đây.