Vào thứ 4 tuần trước, trong buổi phỏng vấn với Reuters, CEO Jensen Huang xác nhận rằng đã có một số vấn đề về thiết kế của GPU Blackwell, dòng sản phẩm dành cho trung tâm dữ liệu AI thế hệ mới. Những vấn đề này đã làm gián đoạn quá trình sản xuất, nhưng nhờ sự hỗ trợ từ TSMC, mọi sự cố đã được giải quyết.

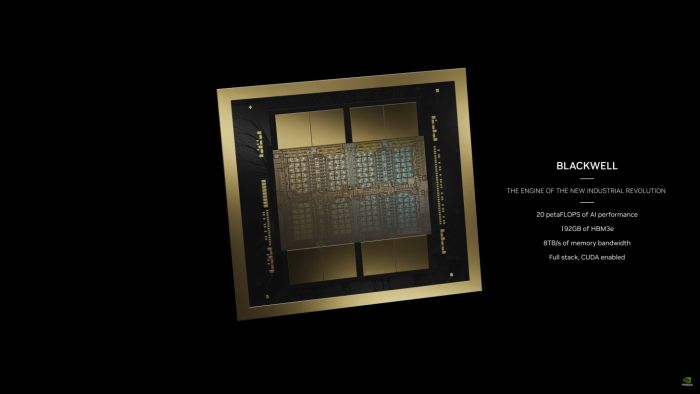

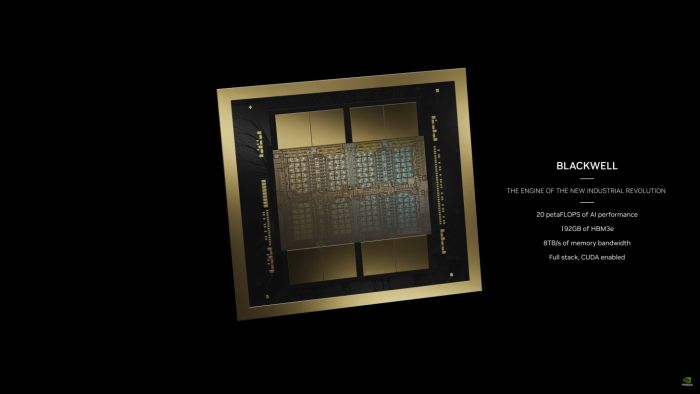

Vào tháng 3, Nvidia chính thức giới thiệu GPU Blackwell, tự hào khẳng định đây là mẫu GPU AI mạnh mẽ nhất với 208 tỷ transistor, được sản xuất trên tiến trình 4NP của TSMC. Thiết kế đặc biệt này bao gồm hai die silicon kết nối với nhau qua cầu nối 10TB/s. Ban đầu, Nvidia dự định phát hành Blackwell vào quý II năm 2024, nhưng sau đó đã phải hoãn sang quý IV, ảnh hưởng đến các khách hàng lớn như Meta, Alphabet và Microsoft.Mới đây, CEO Jensen Huang chia sẻ: "Chúng tôi đã phát hiện lỗi thiết kế trên chip Blackwell. Dù chip vẫn vận hành tốt, nhưng lỗi này đã ảnh hưởng đến tỷ lệ chip đạt chuẩn trong quá trình sản xuất. Đây là hoàn toàn lỗi của Nvidia. Để phát triển Blackwell và đảm bảo hoạt động của nó, chúng tôi phải thiết kế 7 loại chip xử lý khác nhau từ đầu và sản xuất ngay lập tức để đáp ứng nhu cầu thị trường.TSMC đã giúp chúng tôi nâng cao tỷ lệ chip đạt chuẩn, khắc phục các vấn đề thiết kế và nhanh chóng quay lại gia công các die bán dẫn để sản xuất chip Blackwell với tốc độ ấn tượng.Cùng lúc, ông Huang đã bác bỏ tin đồn rằng các vấn đề thiết kế của chip Blackwell đã làm tổn hại đến mối quan hệ hợp tác giữa Nvidia và TSMC.Về mặt kỹ thuật, GPU B200 sử dụng kiến trúc Blackwell sở hữu 104 tỷ transistor trên mỗi die, tổng cộng 208 tỷ transistor khi kết hợp 2 die MCM. GPU này được chia thành 160 Stream Microprocessor, tương đương với 20480 nhân CUDA. Con chip này được gia công bởi Synopsys và TSMC, ứng dụng công nghệ và thư viện phần mềm CuLitho của Nvidia, giúp tăng tốc nghiên cứu và phát triển chip nhờ vào sức mạnh tính toán. So với Hopper, B200 vượt trội H200 với 128 tỷ transistor, hiệu suất xử lý số thực FP8 và FP6 nhanh gấp 2.5 lần, còn FP4 nhanh gấp 5 lần so với H200.Bề mặt chip B200 được trang bị 8 stack chip nhớ HBM3e, với dung lượng tối đa lên tới 192GB và tốc độ truyền tải 8TB/s, chạy trên bus giao tiếp 8192-bit. Công suất tiêu thụ điện của chip này có thể lên tới 700W, tương đương với các dòng H100 và H200 hiện có trên thị trường, được trang bị trong các hệ thống data center vận hành mô hình AI của những tập đoàn lớn.Với cấu hình tối đa, GB200 có thể tạo ra một trung tâm dữ liệu quy mô khổng lồ với 32 nghìn GPU, 13 petabyte RAM HBM3e, và sức mạnh xử lý lên tới 645 exaflop. Hiệu suất xử lý dữ liệu mạng cũng được đo bằng đơn vị petaflop.Theo Reuters