Khi Trí Tuệ Nhân Tạo Nhìn Thấy Một Người Đàn Ông, Nó Nghĩ 'Chính Thức.' Một Phụ Nữ? 'Mỉm Cười'

Đàn ông thường đánh giá phụ nữ dựa trên ngoại hình. Rất ngạc nhiên, máy tính cũng vậy.

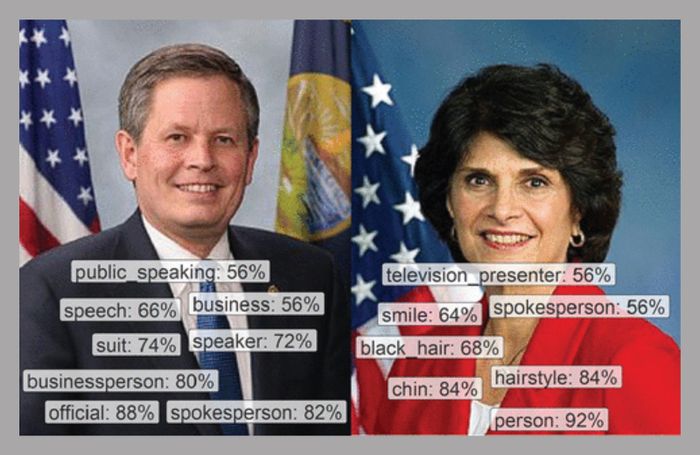

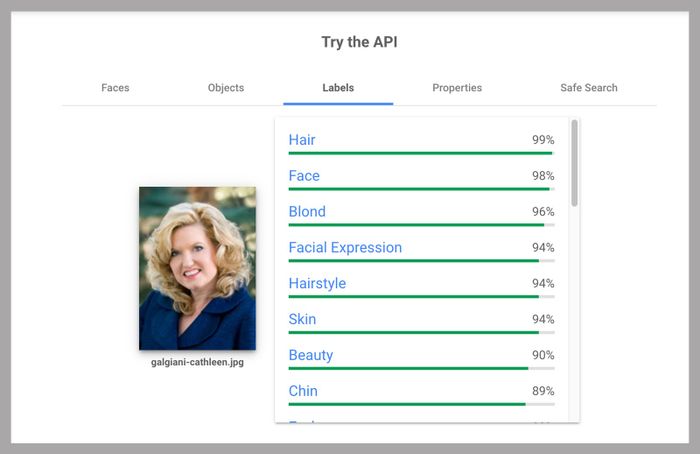

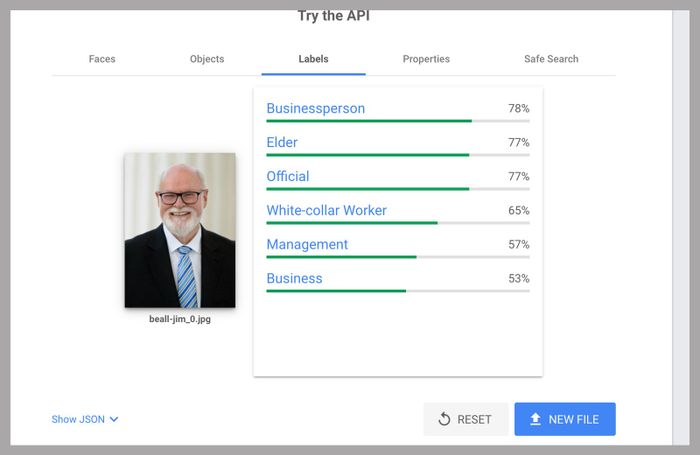

Khi các nhà nghiên cứu Mỹ và châu Âu cung cấp hình ảnh của các thành viên quốc hội cho dịch vụ nhận diện hình ảnh trên đám mây của Google, dịch vụ này áp dụng ba lần nhiều nhãn chú thích liên quan đến ngoại hình vào hình ảnh của phụ nữ so với đàn ông. Nhãn hàng đầu được áp dụng cho đàn ông là “chính thức” và “doanh nhân”; còn đối với phụ nữ, họ là “mỉm cười” và “cằm.”

“Nó dẫn đến việc phụ nữ nhận được một định kiến về địa vị thấp hơn: rằng phụ nữ chỉ ở đó để trông xinh đẹp và đàn ông là các nhà lãnh đạo kinh doanh,” Carsten Schwemmer, một nghiên cứu viên sau tiến sĩ tại Viện GESIS Leibniz cho Các Khoa Học Xã Hội ở Köln, Đức, nói. Ông đã tham gia vào nghiên cứu, được công bố vào tuần trước, cùng với các nhà nghiên cứu từ Đại học New York, Đại học Mỹ, Đại học Dublin College, Đại học Michigan và tổ chức phi lợi nhuận California YIMBY.

Các nhà nghiên cứu thực hiện thử nghiệm thị giác máy của họ trên dịch vụ nhận diện hình ảnh trí tuệ nhân tạo của Google và các đối thủ Amazon và Microsoft. Người lao động đám đông được trả tiền để xem xét các chú thích mà các dịch vụ đó áp dụng cho các bức ảnh chính thức của các nhà lập pháp và các hình ảnh mà những nhà lập pháp đó đăng trên Twitter.

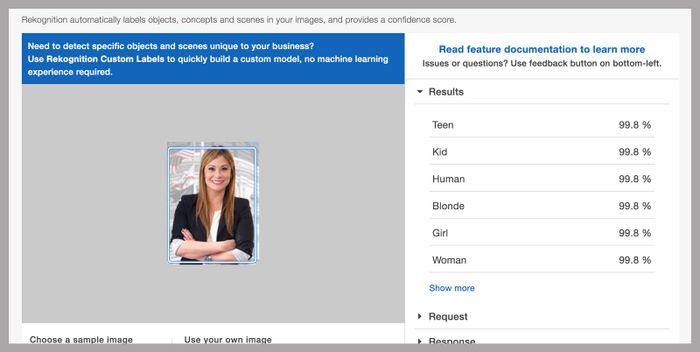

Các dịch vụ trí tuệ nhân tạo thông thường nhìn thấy những điều mà nhà xét duyệt con người cũng có thể nhìn thấy trong những bức ảnh. Nhưng họ có xu hướng để ý đến những điều khác nhau về phụ nữ và đàn ông, với phụ nữ có khả năng bị phân loại nhiều hơn dựa trên ngoại hình. Các nhà lập pháp nữ thường được gắn thẻ với “bé gái” và “vẻ đẹp.” Các dịch vụ có khuynh hướng không nhìn thấy phụ nữ, thậm chí thất bại trong việc phát hiện họ nhiều hơn so với việc họ không nhìn thấy đàn ông.

Nghiên cứu này cung cấp thêm bằng chứng cho thấy các thuật toán không nhìn thế giới với tính toán lạnh lùng mà thay vào đó có khuynh hướng sao chép hoặc thậm chí khuếch đại các định kiến văn hóa lịch sử. Nó được truyền cảm hứng một phần từ dự án Gender Shades năm 2018 đã chỉ ra rằng các dịch vụ đám mây trí tuệ nhân tạo của Microsoft và IBM rất chính xác trong việc xác định giới tính của đàn ông da trắng, nhưng rất không chính xác trong việc xác định giới tính của phụ nữ da đen.

Nghiên cứu mới được công bố vào tuần trước, nhưng các nhà nghiên cứu đã thu thập dữ liệu từ các dịch vụ trí tuệ nhân tạo vào năm 2018. Các thử nghiệm của MYTOUR bằng cách sử dụng các bức ảnh chính thức của 10 người đàn ông và 10 phụ nữ từ Thượng Viện California cho thấy kết quả của nghiên cứu vẫn đúng.

Tất cả 20 nhà lập pháp đều mỉm cười trong ảnh chính thức của họ. Các nhãn được đề xuất hàng đầu của Google chỉ ghi nhận nụ cười của một người đàn ông, nhưng đối với bảy phụ nữ. Dịch vụ tầm nhìn AI của công ty đánh dấu tất cả 10 người đàn ông là “doanh nhân,” thường cũng với “chính thức” hoặc “người lao động cổ áo trắng.” Chỉ có năm phụ nữ thượng nghị sĩ nhận được một hoặc nhiều thuật ngữ đó. Phụ nữ cũng nhận được các nhãn liên quan đến ngoại hình, như “da,” “kiểu tóc,” và “cổ,” những nhãn này không được áp dụng cho đàn ông.

Các dịch vụ của Amazon và Microsoft dường như không có sự thiên vị rõ ràng hơn, mặc dù Amazon báo cáo rằng họ chắc chắn hơn 99 phần trăm rằng hai trong số 10 phụ nữ thượng nghị sĩ là “bé gái” hoặc “đứa trẻ.” Họ không đề xuất bất kỳ người đàn ông nào trong số 10 người đàn ông là người dưới 18 tuổi. Dịch vụ của Microsoft xác định giới tính của tất cả nam giới, nhưng chỉ có tám phụ nữ, gọi một người là đàn ông và không gắn nhãn giới tính cho người khác.

Google đã tắt tính năng nhận diện giới tính của dịch vụ tầm nhìn AI từ đầu năm nay, nói rằng giới tính không thể suy luận từ ngoại hình của một người. Tracy Frey, giám đốc điều hành của trí tuệ nhân tạo có trách nhiệm tại phân đoạn đám mây của Google, cho biết công ty vẫn tiếp tục làm việc để giảm thiểu định kiến và hoan nghênh đầu vào từ bên ngoài. “Chúng tôi luôn cố gắng để trở nên tốt hơn và tiếp tục hợp tác với các bên liên quan bên ngoài—như các nhà nghiên cứu học thuật—để phát triển công việc của chúng tôi trong lĩnh vực này,” bà nói. Amazon và Microsoft từ chối bình luận; cả hai công ty chỉ nhận diện giới tính theo cách nhị phân.

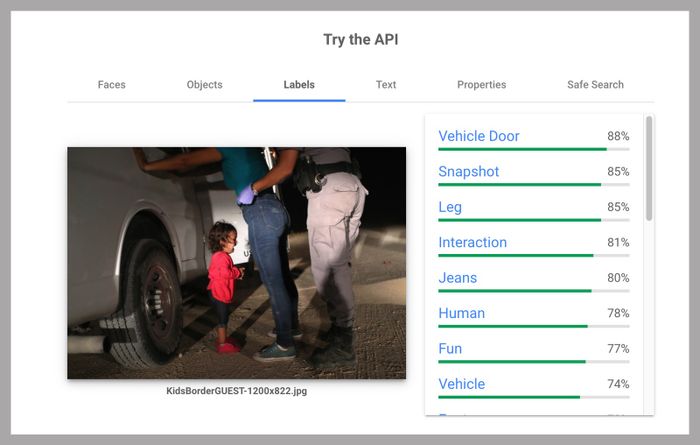

Nghiên cứu của Mỹ và châu Âu được truyền cảm hứng một phần từ việc khi các nhà nghiên cứu cung cấp dịch vụ tầm nhìn của Google một bức ảnh ấn tượng, đoạt giải từ Texas, hiển thị một đứa trẻ người Honduras khóc khi một cảnh sát biên giới Mỹ giữ lại mẹ của cô. Trí tuệ nhân tạo của Google đề xuất các nhãn bao gồm “vui vẻ,” với điểm số 77 phần trăm, cao hơn điểm số 52 phần trăm mà nó gán cho nhãn “đứa trẻ.” MYTOUR nhận được đề xuất tương tự sau khi tải lên hình ảnh lên dịch vụ của Google vào thứ Tư.

Schwemmer và đồng nghiệp của ông bắt đầu thử nghiệm với dịch vụ của Google với hy vọng nó có thể giúp họ đo lường các mô hình trong cách mọi người sử dụng hình ảnh để nói về chính trị trực tuyến. Những gì ông sau đó giúp phát hiện về định kiến giới tính trong các dịch vụ hình ảnh đã thuyết phục ông rằng công nghệ chưa sẵn sàng để được sử dụng bởi các nhà nghiên cứu theo cách đó, và các công ty sử dụng các dịch vụ như vậy có thể gánh chịu hậu quả không mong muốn. “Bạn có thể nhận được một hình ảnh hoàn toàn sai lệch về hiện thực,” ông nói. Một công ty sử dụng dịch vụ trí tuệ nhân tạo chệch lệch để tổ chức một bộ sưu tập ảnh lớn có thể vô tình che giấu phụ nữ doanh nhân, thay vì chỉ đánh dấu họ bằng nụ cười của họ.

Nghiên cứu trước đó đã phát hiện ra rằng các tập dữ liệu nổi bật của các bức ảnh được gắn nhãn sử dụng để huấn luyện các thuật toán thị giác đã có sự thiên vị giới tính đáng kể, ví dụ như hiển thị phụ nữ đang nấu ăn và đàn ông đang bắn súng. Sự chệch lệch này có vẻ đến từ phần nào do các nhà nghiên cứu thu thập hình ảnh của họ trực tuyến, nơi các bức ảnh có sẵn phản ánh định kiến xã hội, ví dụ như cung cấp nhiều hình ảnh về các doanh nhân nam hơn là doanh nhân nữ. Phần mềm học máy được huấn luyện trên các tập dữ liệu đó được phát hiện khuếch đại định kiến trong các bộ sưu tập ảnh cơ bản.

Schwemmer tin rằng dữ liệu huấn luyện thiên vị có thể giải thích sự thiên vị mà nghiên cứu mới tìm thấy trong các dịch vụ trí tuệ nhân tạo của ông lớn, nhưng không thể biết chắc chắn nếu không có quyền truy cập đầy đủ vào hệ thống của họ.

Chẩn đoán và sửa các hạn chế và thiên vị trong các hệ thống trí tuệ nhân tạo đã trở thành một đề tài nghiên cứu hot trong những năm gần đây. Cách con người có thể hấp thụ ngay lập tức ngữ cảnh tinh tế trong một hình ảnh trong khi phần mềm trí tuệ nhân tạo hẹp hơn về các mẫu điểm ảnh tạo ra tiềm năng lớn cho sự hiểu lầm. Vấn đề trở nên cấp thiết hơn khi các thuật toán ngày càng giỏi hơn trong xử lý hình ảnh. “Bây giờ chúng đang được triển khai khắp mọi nơi,” Olga Russakovsky, giáo sư trợ giảng tại Princeton, nói. “Vì vậy, chúng ta nên đảm bảo rằng chúng đang làm những điều đúng trong thế giới này và không có hậu quả không mong muốn nào xảy ra.

Một phương pháp tiếp cận với vấn đề này là làm việc để cải thiện dữ liệu huấn luyện có thể là nguyên nhân gốc rễ của các hệ thống học máy thiên vị. Russakovsky là một phần của dự án Princeton đang làm việc trên một công cụ được gọi là REVISE có thể tự động ghi chú một số thiên vị được tích hợp vào một bộ sưu tập hình ảnh, bao gồm theo địa lý và giới tính.

Khi các nhà nghiên cứu áp dụng công cụ này vào bộ sưu tập Open Images có 9 triệu hình ảnh được duy trì bởi Google, họ phát hiện rằng đàn ông thường được gắn thẻ trong các cảnh ngoài trời và sân thể thao hơn phụ nữ. Và đàn ông được gắn nhãn “đồ thể thao” chủ yếu là ở ngoài trời chơi các môn thể thao như bóng chày, trong khi phụ nữ thì ở trong nhà chơi bóng rổ hoặc mặc đồ tắm. Đội ngũ Princeton đề xuất thêm hình ảnh hiển thị phụ nữ ở ngoài trời, bao gồm việc chơi thể thao.

Google và các đối thủ trong lĩnh vực Trí tuệ nhân tạo đều là những nhà đóng góp quan trọng cho nghiên cứu về sự công bằng và thiên vị trong Trí tuệ nhân tạo. Điều này bao gồm làm việc trên ý tưởng tạo ra các cách tiêu chuẩn để truyền thông về các hạn chế và nội dung của phần mềm và bộ dữ liệu Trí tuệ nhân tạo cho các nhà phát triển—một cái gì đó giống như một nhãn dinh dưỡng Trí tuệ nhân tạo.

Google đã phát triển một định dạng được gọi là “thẻ mô hình” và công bố các thẻ cho các thành phần nhận diện khuôn mặt và đối tượng của dịch vụ tầm nhìn đám mây của họ. Một thẻ tuyên bố rằng bộ dò khuôn mặt của Google hoạt động tương đương cho các giới tính khác nhau, nhưng không đề cập đến các hình thức thiên vị giới tính Trí tuệ nhân tạo khác có thể xảy ra.

Những điều tuyệt vời từ MYTOUR

- 📩 Muốn nhận thông tin mới nhất về công nghệ, khoa học và nhiều hơn nữa? Đăng ký nhận bản tin của chúng tôi!

- Câu chuyện kỳ lạ và kỳ dị về hydroxychloroquine

- Làm thế nào để thoát khỏi một con tàu đắm (như là Titanic)

- Tương lai của McDonald's nằm trong làn đường drive-thru

- Tại sao việc sử dụng sạc điện thoại quan trọng

- Kết quả vắc-xin Covid mới nhất, được giải mã

- 🎮 MYTOUR Games: Nhận các mẹo mới nhất, đánh giá và nhiều hơn nữa

- 💻 Nâng cấp công việc của bạn với những chiếc laptop, bàn phím, các phương thức gõ khác nhau và tai nghe chống ồn được yêu thích của nhóm Gear của chúng tôi