Không nên kỳ vọng rằng các mô hình ngôn ngữ lớn như GPT tiếp theo sẽ được dân chủ hóa

Bài viết này là một phần của sự báo cáo về những điều mới nhất trong nghiên cứu trí tuệ nhân tạo.

Vào đầu tháng 5, Meta phát hành Open Pretrained Transformer (OPT-175B), một mô hình ngôn ngữ lớn (LLM) có thể thực hiện nhiều nhiệm vụ khác nhau. Các mô hình ngôn ngữ lớn đã trở thành một trong những lĩnh vực nóng nhất trong lĩnh vực trí tuệ nhân tạo trong những năm gần đây.

OPT-175B là ứng cử viên mới nhất trong cuộc đua vũ khí LLM bắt đầu từ GPT-3 của OpenAI, một mạng nơ-ron sâu với 175 tỷ tham số. GPT-3 đã chứng minh rằng LLM có thể thực hiện nhiều nhiệm vụ mà không cần đào tạo thêm và chỉ cần nhìn thấy một vài ví dụ (học một hoặc ít-shot). Sau đó, Microsoft tích hợp GPT-3 vào một số sản phẩm của mình, cho thấy không chỉ là những hứa hẹn khoa học mà còn là thương mại của LLM.

Điều làm cho OPT-175B độc đáo là cam kết của Meta đối với “sự mở cửa,” như ngụ ý từ tên của mô hình. Meta đã công bố mô hình cho công chúng (với một số lưu ý). Họ cũng đã công bố rất nhiều chi tiết về quá trình đào tạo và phát triển. Trong một bài viết được đăng trên blog AI của Meta, công ty mô tả việc phát hành OPT-175B của họ như là “Dân chủ hóa quyền truy cập vào các mô hình ngôn ngữ quy mô lớn.”

Chuyển động của Meta hướng về sự minh bạch là đáng khen ngợi. Tuy nhiên, cuộc cạnh tranh về các mô hình ngôn ngữ lớn đã đạt đến một điểm mà không còn có thể dân chủ hóa.

Khám phá bên trong các mô hình ngôn ngữ lớn

Việc phát hành của Meta về OPT-175B có một số tính năng quan trọng. Nó bao gồm cả các mô hình được đào tạo trước cũng như mã cần thiết để đào tạo và sử dụng LLM. Các mô hình được đào tạo trước đặc biệt hữu ích cho các tổ chức không có tài nguyên tính toán để đào tạo mô hình (đào tạo mạng nơ-ron đòi hỏi nhiều nguồn lực hơn là chạy chúng). Nó cũng sẽ giúp giảm dấu chân carbon lớn do tài nguyên tính toán cần thiết để đào tạo mạng nơ-ron lớn.

Như GPT-3, OPT có các kích thước khác nhau, từ 125 triệu đến 175 tỷ tham số (các mô hình có nhiều tham số có nhiều khả năng học hỏi). Tính đến thời điểm viết bài này, tất cả các mô hình lên đến OPT-30B đều có thể tải xuống. Mô hình đầy đủ 175 tỷ tham số sẽ được cung cấp cho các nhà nghiên cứu và tổ chức được chọn sau khi điền đơn đề nghị.

Theo blog Meta AI, “Để duy trì tính toàn vẹn và ngăn chặn việc sử dụng sai mục đích, chúng tôi phát hành mô hình của mình dưới một giấy phép phi thương mại để tập trung vào các trường hợp sử dụng nghiên cứu. Quyền truy cập vào mô hình sẽ được cấp cho các nhà nghiên cứu học thuật; những người liên quan đến tổ chức trong chính phủ, xã hội dân sự và giáo dục; cùng với các phòng thí nghiệm nghiên cứu ngành công nghiệp trên toàn thế giới.”

Ngoài các mô hình, Meta còn công bố một sổ nhật ký đầy đủ cung cấp một dòng thời gian kỹ thuật chi tiết về quá trình phát triển và đào tạo các mô hình ngôn ngữ lớn. Các bài báo công bố thường chỉ bao gồm thông tin về mô hình cuối cùng. Sổ nhật ký mang lại cái nhìn quý báu về “bao nhiêu tính toán đã được sử dụng để đào tạo OPT-175B và gánh nặng nhân sự khi cơ sở hạ tầng cơ bản hoặc quy trình đào tạo trở nên không ổn định ở quy mô lớn,” theo Meta.

So sánh với GPT-3

Trong bài đăng trên blog của mình, Meta cho biết rằng các mô hình ngôn ngữ lớn chủ yếu có thể truy cập thông qua “API trả phí” và việc truy cập hạn chế đối với LLM đã “hạn chế khả năng của các nhà nghiên cứu để hiểu cách và tại sao những mô hình ngôn ngữ lớn này hoạt động, gây trở ngại cho tiến triển trong việc cải thiện tính ổn định của chúng và giảm những vấn đề đã biết như độ chệch và độc hại.”

Đây là một cú đánh vào OpenAI (và mở rộng là Microsoft), đã phát hành GPT-3 dưới dạng dịch vụ API hộp đen thay vì công khai trọng lượng và mã nguồn của mô hình cho công chúng. Trong số lý do mà OpenAI nêu ra để không công bố GPT-3 là kiểm soát việc sử dụng sai mục đích và phát triển các ứng dụng có hại.

Meta tin rằng việc làm cho các mô hình này có sẵn cho đông đảo người dùng sẽ giúp họ nắm bắt và ngăn chặn mọi tổn thương mà chúng có thể gây ra.

Dưới đây là cách Meta mô tả nỗ lực này: “Chúng tôi hy vọng rằng OPT-175B sẽ mang đến nhiều giọng điệu hơn đến biên giới của việc tạo ra mô hình ngôn ngữ lớn, giúp cộng đồng thiết kế chiến lược phát hành có trách nhiệm và thêm mức độ minh bạch và sự mở cửa chưa từng có vào quá trình phát triển các mô hình ngôn ngữ lớn trong lĩnh vực.”

Những chi phí của các mô hình ngôn ngữ lớn

Tuy nhiên, cần lưu ý rằng “minh bạch và sự mở cửa” không phải là tương đương với “dân chủ hóa các mô hình ngôn ngữ lớn.” Chi phí của việc đào tạo, cấu hình và chạy các mô hình ngôn ngữ lớn vẫn là không thể và có thể sẽ tăng trong tương lai.

Theo bài đăng trên blog của Meta, các nhà nghiên cứu của họ đã thành công trong việc giảm đáng kể chi phí đào tạo các mô hình ngôn ngữ lớn. Công ty cho biết dấu chân carbon của mô hình đã giảm xuống chỉ còn một phần bảy so với GPT-3. Các chuyên gia mà tôi đã nói chuyện trước đó ước tính chi phí đào tạo GPT-3 là lên đến 27,6 triệu đô la.

Điều này có nghĩa là việc đào tạo OPT-175B vẫn sẽ tốn một số triệu đô la. May mắn thay, mô hình được đào tạo trước sẽ loại bỏ nhu cầu đào tạo mô hình và Meta nói rằng họ sẽ cung cấp mã nguồn được sử dụng để đào tạo và triển khai mô hình đầy đủ “chỉ bằng 16 GPU NVIDIA V100.” Điều này tương đương với một Nvidia DGX-2, có giá khoảng 400,000 đô la, không phải là một số tiền nhỏ đối với một phòng thí nghiệm nghiên cứu hoặc một nhà nghiên cứu cá nhân có hạn ngân sách. (Theo một bài báo cung cấp thêm thông tin về OPT-175B, Meta đã đào tạo mô hình của họ với 992 GPU A100 80GB, chúng có tốc độ nhanh hơn đáng kể so với V100.)

Sổ nhật ký của Meta AI tiếp tục xác nhận rằng việc đào tạo các mô hình ngôn ngữ lớn là một nhiệm vụ rất phức tạp. Dòng thời gian của OPT-175B đầy sự cố vấn đề máy chủ, lỗi phần cứng và những vấn đề khác yêu cầu một đội ngũ kỹ thuật cao cấp. Các nhà nghiên cứu cũng phải khởi động lại quá trình đào tạo nhiều lần, điều chỉnh siêu tham số và thay đổi chức năng mất. Tất cả những điều này gây thêm chi phí mà các phòng thí nghiệm nhỏ không thể chi trả.

Tương lai (phi dân chủ) của các mô hình ngôn ngữ lớn

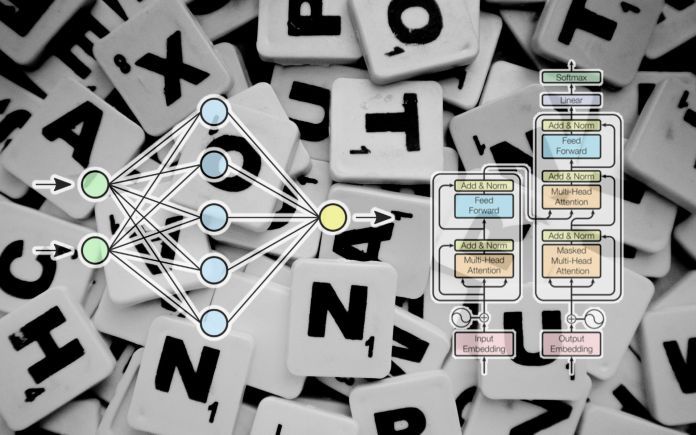

Các mô hình ngôn ngữ như OPT và GPT dựa trên kiến trúc transformer. Một trong những đặc điểm quan trọng của transformers là khả năng xử lý dữ liệu tuần tự lớn (ví dụ: văn bản) theo cách song song và quy mô.

Trong những năm gần đây, các nhà nghiên cứu đã chứng minh rằng bằng cách thêm nhiều tầng và tham số hơn vào các mô hình transformer, họ có thể cải thiện hiệu suất của chúng trên các nhiệm vụ ngôn ngữ. Một số nhà nghiên cứu tin rằng đạt đến các cấp độ thông minh cao hơn chỉ là một vấn đề quy mô. Do đó, các phòng thí nghiệm nghiên cứu giàu có như Meta AI, DeepMind (thuộc Alphabet) và OpenAI (được Microsoft hỗ trợ) đang hướng đến việc tạo ra càng ngày càng lớn hơn các mạng nơ-ron.

Năm ngoái, Microsoft và Nvidia đã tạo ra một mô hình ngôn ngữ có 530 tỷ tham số gọi là Megatron-Turing (MT-NLG). Tháng trước, Google giới thiệu Pathways Language Model (PaLM), một LLM với 540 tỷ tham số. Và có tin đồn rằng OpenAI sẽ phát hành GPT-4 trong vài tháng tới.

Tuy nhiên, các mạng nơ-ron lớn hơn cũng đòi hỏi tài nguyên tài chính và kỹ thuật lớn hơn. Và trong khi các mô hình ngôn ngữ lớn hơn sẽ có những tính năng mới (và thất bại mới), chúng sẽ không thể tránh khỏi việc tập trung quyền lực trong tay một số ít công ty giàu có hơn, khiến cho việc làm việc trên các mô hình ngôn ngữ lớn trở nên khó khăn hơn đối với các phòng thí nghiệm nghiên cứu nhỏ và các nhà nghiên cứu độc lập.

Trên mặt kinh doanh, các công ty công nghệ lớn sẽ có lợi thế lớn hơn nữa. Việc chạy các mô hình ngôn ngữ lớn rất đắt đỏ và khó khăn. Các công ty như Google và Microsoft có các máy chủ và bộ xử lý đặc biệt cho phép họ chạy những mô hình này ở quy mô và một cách có lợi nhuận. Đối với các công ty nhỏ, chi phí vận hành phiên bản riêng của họ về một LLM như GPT-3 là quá cản trở. Giống như hầu hết các doanh nghiệp sử dụng dịch vụ lưu trữ đám mây thay vì thiết lập máy chủ và trung tâm dữ liệu của họ, các hệ thống tận rưởi như GPT-3 API sẽ thu hút nhiều sự chú ý khi các mô hình ngôn ngữ lớn trở nên phổ biến hơn.

Điều này lại tiếp tục tập trung trí tuệ nhân tạo trong tay các công ty công nghệ lớn. Càng nhiều phòng thí nghiệm nghiên cứu AI phải hợp tác với các công ty công nghệ lớn để tài trợ cho nghiên cứu của họ. Và điều này sẽ mang lại cho các công ty công nghệ lớn nhiều quyền lực hơn để quyết định hướng phát triển tương lai của nghiên cứu AI (có lẽ sẽ phù hợp với lợi ích tài chính của họ). Điều này có thể đến giá của các lĩnh vực nghiên cứu không mang lại lợi nhuận ngay lập tức.

Điểm quan trọng là, trong khi chúng ta vui mừng về việc Meta đưa ra sự minh bạch đối với LLMs, hãy không quên rằng bản chất của các mô hình ngôn ngữ lớn là phi dân chủ và ủng hộ cho những công ty đang quảng bá chúng.

Bài viết này được viết ban đầu bởi Ben Dickson và được công bố bởi Ben Dickson trên TechTalks, một tờ báo nghiên cứu xu hướng công nghệ, cách chúng ảnh hưởng đến cuộc sống và kinh doanh của chúng ta, và các vấn đề mà chúng giải quyết. Nhưng chúng tôi cũng thảo luận về mặt tối của công nghệ, những hậu quả tối tăm của công nghệ mới và những điều chúng ta cần phải để ý. Bạn có thể đọc bài viết gốc tại đây đây.