Mỗi ngày trôi qua, những kỹ năng giúp phân biệt chúng ta với máy móc đang dần được các thiết bị này thực hiện thành thạo.

Máy móc đã vượt qua con người ở nhiều lĩnh vực, từ chơi cờ, tham gia game show truyền hình (Jeopardy!), chơi Go, nhận diện vật thể, nhận diện khuôn mặt, cho đến chơi game máy tính. Nếu bạn nghĩ rằng con người đang tụt lại so với máy móc, có lẽ bạn không hề sai.

Tuy nhiên, chỉ cần thử sử dụng bất kỳ phần mềm nhận diện giọng nói nào, niềm tin của bạn vào con người sẽ nhanh chóng được khôi phục. Dù đã tiến bộ và ngày càng tiến bộ hơn, những hệ thống này chưa bao giờ hoàn hảo. Bạn đang nói 'đặt món kem' (Ice Cream), hay bạn đang nói 'tôi hét' (I scream)? Có lẽ là cả hai - đó là suy nghĩ của một máy nếu bạn đang nói chuyện với nó.

Vì vậy, bạn có thể yên tâm khi biết rằng việc nhận diện giọng nói trong cuộc trò chuyện thông thường vẫn là một thách thức lớn đối với máy móc, và con người vẫn là những chuyên gia về ngôn ngữ của chính mình.

Nhưng cái nhìn đó có thể sẽ thay đổi sớm thôi. Hôm nay, Geoff Zweig và các nhà nghiên cứu tại Microsoft Research ở Redmond, Washington thông báo rằng họ đã có một bước đột phá trong lĩnh vực nhận diện giọng nói, với các thuật toán máy học của họ vượt qua con người trong việc nhận biết giọng nói trong cuộc trò chuyện thông thường lần đầu tiên.

Lịch sử nghiên cứu nhận diện giọng nói đã rất dài. Vào những năm 1950, các máy tính ban đầu chỉ có thể nhận diện tối đa 10 từ được nói rõ ràng bởi một người duy nhất. Đến những năm 1980, các nhà nghiên cứu đã phát triển các thiết bị có khả năng ghi lại bài phát biểu đơn giản với khoảng 1000 từ vựng. Vào những năm 1990, máy móc đã có thể ghi lại nội dung khi một người đọc bản tin Wall Street Journal, và sau đó là cả đoạn tin tức trên TV.

Có thể thấy tham vọng của các nhà nghiên cứu ngày một tăng cao theo thời gian. Nhưng các bài kiểm tra đó lại đơn giản hơn so với các đoạn hội thoại thông thường vì nhiều lý do. Từ vựng trên tờ Wall Street Journal chủ yếu xoay quanh kinh doanh và tài chính, và cách diễn đạt mạch lạc, chuẩn mực - điều này không phải lúc nào cũng đúng trong hội thoại hàng ngày. Các bản tin truyền hình ít hình thức hơn, nhưng vẫn đảm bảo mạch lạc và phát âm rõ ràng. Tất cả các ví dụ trên đều làm cho máy móc dễ dàng vượt qua.

Tuy nhiên, tác vụ khó nhất - ghi lại một đoạn hội thoại thông thường - vẫn là một thách thức mà máy móc chưa thể vượt qua.

Hội thoại thông thường khó hơn nhiều với sự đa dạng từ vựng, và bên cạnh từ ngữ con người tạo ra khi nói, còn có tiếng ồn. Con người sử dụng rất nhiều tiếng ồn để quản lý lượt lời trong hội thoại - một loại giao tiếp mà các nhà ngôn ngữ học gọi là 'kênh phụ' (backchannel).

Ví dụ, uh-huh được sử dụng để báo hiệu cho người nói biết rằng họ nên tiếp tục nói. Nhưng 'uh' là một từ ấp úng chỉ ra rằng người nói còn nhiều điều để nói, một cảnh báo rằng có nhiều thứ khác nữa. Trong việc quản lý lượt lời, 'uh' là điều ngược lại của 'uh-huh'.

Con người có thể phân tích những âm thanh như vậy một cách dễ dàng và hiểu vai trò của chúng trong một đoạn hội thoại. Nhưng với máy móc thì khác.

Năm 2000, Viện Quốc gia về Tiêu chuẩn và Công nghệ đã phát hành một bộ dữ liệu để hỗ trợ các nhà nghiên cứu đối mặt với thách thức này. Bộ dữ liệu này bao gồm các bản ghi của các đoạn hội thoại thông thường trên điện thoại. Một số đoạn nói về một chủ đề cụ thể. Các đoạn còn lại là cuộc trò chuyện giữa bạn bè với nhau và liên quan đến bất kỳ chủ đề nào có thể.

Phần lớn dữ liệu được tạo ra để huấn luyện thuật toán máy học nhận diện giọng nói. Phần còn lại là bài kiểm tra mà máy móc phải giải mã.

Đánh giá hiệu suất bằng số từ máy nhận diện sai, và mục tiêu cuối cùng là giúp máy nhận diện tốt hơn cả con người.

Con người nhận diện giọng nói với tỉ lệ lỗi khoảng 4% khi diễn dịch. Máy móc trong quá khứ chưa bao giờ đạt kết quả tương tự.

Microsoft tuyên bố họ đã đạt được hiệu suất ngang ngửa con người, mặc dù vẫn có một hạn chế quan trọng.

Kết quả khiến nhiều người bất ngờ: tỉ lệ lỗi của dịch vụ là 5,9% đối với các đoạn hội thoại về một chủ đề nhất định và 11,3% đối với các đoạn hội thoại giữa bạn bè và gia đình.

Microsoft tối ưu hóa các hệ thống học sâu của họ và sử dụng bộ dữ liệu huấn luyện để dạy máy hiểu các đoạn hội thoại thông thường.

Kết quả: hệ thống nhận diện giọng nói của Microsoft có tỉ lệ lỗi tương đương với con người, nhưng loại lỗi mà nó gặp phải lại khá khác biệt.

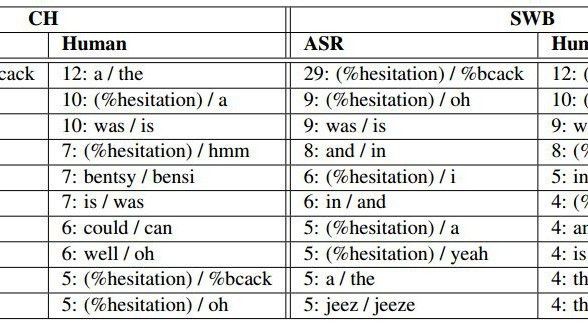

Lỗi phổ biến nhất của máy của Microsoft là nhầm lẫn các âm thanh kênh phụ 'uh' và 'uh-huh', trong khi con người hiếm khi gặp lỗi này.

Không có lý do nguyên tắc nào giải thích tại sao một máy không thể được huấn luyện để nhận diện các âm thanh kênh phụ.

Nhìn chung, máy có tỉ lệ lỗi ngang ngửa con người ở mức 5,9% đối với các đoạn hội thoại về chủ đề cụ thể, nhưng vượt trội hơn con người trong diễn dịch đoạn hội thoại giữa bạn bè và gia đình, với tỉ lệ lỗi là 11,1%.

Đó thực sự là một kết quả thú vị. Microsoft có lẽ rất vui mừng với chiến thắng này của máy móc của họ, nhưng thực ra đó lại là một vấn đề. Máy móc đang trở nên xuất sắc hơn con người trong việc nhận diện giọng nói.

Tham khảo: TechnologyReview