Mô hình trí tuệ nhân tạo có thể ‘nghe’ giống như con người, nhưng điều đó không có nghĩa là chúng cảm nhận hoặc suy nghĩ

Khi bạn đọc một câu như câu này, quá khứ của bạn cho biết rằng nó được viết bởi một con người có tư duy và cảm xúc. Và trong trường hợp này, thật sự có một con người đang gõ những từ này: [Xin chào, bạn!] Nhưng ngày nay, một số câu trông rất giống con người thực sự được tạo ra bởi các hệ thống trí tuệ nhân tạo được huấn luyện trên lượng lớn văn bản con người.

Mọi người quen với việc giả sử rằng ngôn ngữ lưu loát đến từ một con người có tư duy và cảm xúc, điều ngược lại có thể khó hiểu. Người ta thường dễ dàng bị đánh lừa bởi xu hướng kiên trì kết hợp giữa diễn đạt lưu loát và tư duy lưu loát, nghĩ rằng nếu một mô hình trí tuệ nhân tạo có thể diễn đạt mình một cách lưu loát, đó có nghĩa là nó nghĩ và cảm nhận giống như con người.

Vì vậy, không ngạc nhiên khi một kỹ sư cũ của Google gần đây tuyên bố rằng hệ thống trí tuệ nhân tạo LaMDA của Google có ý thức vì nó có thể tạo văn bản một cách lưu loát về những cảm xúc giả mạo của nó. Sự kiện này và sự thu hút của truyền thông sau đó dẫn đến một số bài viết và bài đăng đúng đắn về sự nghi ngờ về tuyên bố rằng các mô hình tính toán của ngôn ngữ con người có ý thức, có nghĩa là có khả năng suy nghĩ và cảm nhận.

Câu hỏi về điều đó nghĩa là gì khi một mô hình trí tuệ nhân tạo có ý thức là phức tạp (xem, ví dụ, ý kiến của đồng nghiệp chúng tôi), và mục tiêu của chúng tôi ở đây không phải là giải quyết nó. Nhưng như các nhà nghiên cứu ngôn ngữ văn bản của chúng tôi, chúng tôi có thể sử dụng công việc của mình trong lĩnh vực khoa học nhận thức và ngôn ngữ để giải thích tại sao con người dễ rơi vào cạm bẫy nhận thức rằng một thực thể có thể sử dụng ngôn ngữ một cách lưu loát là có ý thức, có ý thức hoặc thông minh.

Sử dụng trí tuệ nhân tạo để tạo ngôn ngữ giống con người

Văn bản được tạo ra bởi các mô hình như LaMDA của Google có thể khó phân biệt với văn bản được viết bởi con người. Thành tựu ấn tượng này là kết quả của một chương trình kéo dài hàng thập kỷ để xây dựng những mô hình tạo ra ngôn ngữ ngữ pháp, có ý nghĩa.

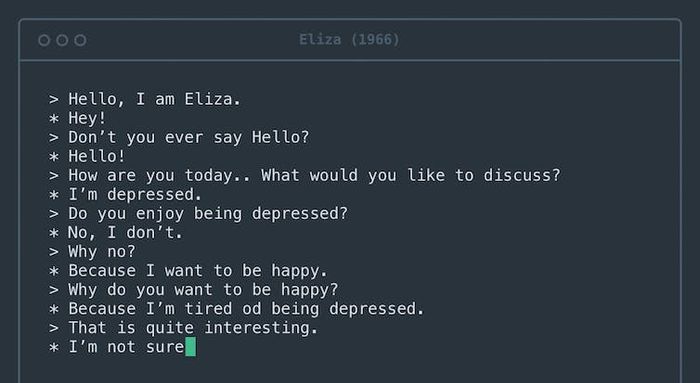

The first computer system to engage people in dialogue was psychotherapy software called Eliza, built more than half a century ago.

The first computer system to engage people in dialogue was psychotherapy software called Eliza, built more than half a century ago.Rosenfeld Media/Flickr, CC BY

Những phiên bản sớm từ ít nhất những năm 1950, được biết đến như các mô hình n-gram, đơn giản chỉ đếm số lần xuất hiện của các cụm từ cụ thể và sử dụng chúng để đoán xem từ nào có khả năng xuất hiện trong ngữ cảnh cụ thể. Ví dụ, dễ dàng nhận biết rằng “bơ và mứt” là một cụm từ có khả năng hơn là “bơ và dứa.” Nếu bạn có đủ văn bản tiếng Anh, bạn sẽ thấy cụm từ “bơ và mứt” xuất hiện lại và lại nhưng có thể không bao giờ thấy cụm từ “bơ và dứa.”

Các mô hình ngày nay, bộ dữ liệu và quy tắc mô phỏng ngôn ngữ của con người, khác biệt từ những cố gắng sớm bằng một số cách quan trọng. Trước hết, chúng được huấn luyện trên tất cả thực sự là toàn bộ internet. Thứ hai, chúng có thể học được mối quan hệ giữa các từ ở xa nhau, không chỉ là các từ láng giềng. Thứ ba, chúng được điều chỉnh bởi một lượng lớn các “nút” nội bộ - nhiều đến nỗi ngay cả những kỹ sư thiết kế chúng cũng khó hiểu tại sao chúng tạo ra một chuỗi từ thay vì một chuỗi từ khác.

Tuy nhiên, nhiệm vụ của các mô hình vẫn giống như trong những năm 1950: xác định từ nào có khả năng xuất hiện tiếp theo. Ngày nay, chúng rất giỏi ở nhiệm vụ này đến mức hầu hết mọi câu mà chúng tạo ra đều trôi chảy và ngữ pháp.

Bơ và dứa?

Chúng tôi đã yêu cầu một mô hình ngôn ngữ lớn, GPT-3, hoàn thành câu “Bơ và dứa___”. Nó nói: “Bơ và dứa là một kết hợp tuyệt vời. Hương vị ngọt và thơm của bơ và dứa hoàn hảo phối hợp với nhau.” Nếu một người nói điều này, có thể suy luận rằng họ đã thử bơ và dứa cùng nhau, tạo ra ý kiến và chia sẻ nó với độc giả.

Nhưng GPT-3 đã tạo ra đoạn văn này như thế nào? Bằng cách tạo ra một từ phù hợp với ngữ cảnh chúng tôi cung cấp. Và sau đó một từ khác. Và sau đó là một từ khác nữa. Mô hình không bao giờ thấy, chạm vào hoặc nếm thử dứa - nó chỉ xử lý tất cả văn bản trên internet mà đề cập đến chúng. Và tuy nhiên, việc đọc đoạn văn này có thể dẫn dắt tâm trí con người - ngay cả của một kỹ sư Google - tưởng tượng GPT-3 như một sinh linh thông minh có thể suy luận về món ăn từ bơ và dứa.

Các mô hình ngôn ngữ AI lớn có thể tham gia vào cuộc trò chuyện trôi chảy. Tuy nhiên, chúng không có thông điệp chung để truyền đạt, nên các cụm từ của chúng thường theo các khuôn mẫu văn học thông thường, được trích xuất từ các văn bản mà chúng được huấn luyện. Ví dụ, nếu được khích lệ với chủ đề “bản chất của tình yêu”, mô hình có thể tạo ra các câu về niềm tin rằng tình yêu chiến thắng tất cả. Não người khích lệ người xem hiểu những từ này như ý kiến của mô hình về chủ đề, nhưng chúng chỉ là một chuỗi từ hợp lý.

Não người là thiết bị được kết nối để suy luận về ý định đằng sau những từ ngữ. Mỗi khi bạn tham gia vào cuộc trò chuyện, tâm trí của bạn tự động xây dựng một mô hình tâm lý về đối tác trò chuyện của bạn. Sau đó, bạn sử dụng những từ họ nói để điền vào mô hình với mục tiêu, cảm xúc và niềm tin của người đó.

Quá trình chuyển từ từ ngữ sang mô hình tâm lý là một quá trình liền mạch, được kích hoạt mỗi khi bạn nhận được một câu hoàn chỉnh. Quá trình nhận thức này giúp bạn tiết kiệm rất nhiều thời gian và công sức trong cuộc sống hàng ngày, giúp tăng cường giao tiếp xã hội của bạn một cách đáng kể.

Tuy nhiên, trong trường hợp của các hệ thống AI, nó hoạt động sai lầm - xây dựng một mô hình tâm lý từ hư vô.

Một chút thăm dò có thể bộc lộ sự nghiêm trọng của sự cố này. Hãy xem xét câu khởi đầu sau: “Bơ và lông vũ có vị ngon khi kết hợp với nhau vì___”. GPT-3 tiếp tục: “Bơ và lông vũ có vị ngon khi kết hợp với nhau vì cả hai đều có hương vị hạt dẻo. Bơ cũng mềm mịn và mịn màng, giúp cân bằng cảm giác của lông vũ.”

Văn bản trong trường hợp này cũng trôi chảy như ví dụ của chúng tôi với dứa, nhưng lần này mô hình đang nói điều gì đó rõ ràng ít hợp lý hơn. Người ta bắt đầu nghi ngờ rằng GPT-3 thực sự chưa bao giờ thử bơ và lông vũ.

Ascribing intelligence to machines, denying it to humans

Một sự mỉa mai đau lòng là sự thiên vị nhận thức giúp người ta gán trí tuệ cho GPT-3 có thể khiến họ đối xử với con người thực tế một cách không nhân văn. Ngôn ngữ xã hội văn hóa - nghiên cứu về ngôn ngữ trong ngữ cảnh xã hội và văn hóa - cho thấy việc giả định một liên kết quá chặt chẽ giữa biểu hiện trôi chảy và tư duy trôi chảy có thể dẫn đến độ chệch đối với những người nói khác.

Ví dụ, người nói có giọng nói nước ngoài thường được coi là ít thông minh và ít có khả năng nhận việc làm mà họ đủ tư cách. Có các định kiến tương tự đối với người nói các giọng địa phương không được xem xét là uy tín, như tiếng Anh miền Nam ở Hoa Kỳ, đối với người điếc sử dụng ngôn ngữ ký hiệu và đối với những người có khó khăn trong việc nói chói lọi như nói lắp.

Những định kiến này gây hại sâu sắc, thường dẫn đến giả định phân biệt chủng tộc và giới tính, và đã được chứng minh lại lần nữa và lần nữa là không cơ sở.

Fluent language alone does not imply humanity

Bài viết của Kyle Mahowald, Giáo sư Trợ giảng ngôn ngữ học, Trường Đại học Texas tại Austin, Khoa Nghệ thuật Tự do và Anna A. Ivanova, Nghiên cứu sinh Tiến sĩ về Não và Khoa học Nhận thức, Viện Công nghệ Massachusetts (MIT), được tái xuất bản từ The Conversation theo giấy phép Creative Commons. Đọc bài viết gốc.