Một Cụm Chip Mới Sẽ Mang Lại Các Mô Hình Trí Tuệ Nhân Tạo Cỡ Lớn

Khi nói về các mạng thần kinh làm nền tảng cho trí tuệ nhân tạo ngày nay, đôi khi kích thước càng lớn thì thông minh càng cao. Các bước tiến gần đây trong việc hiểu ngôn ngữ máy móc, ví dụ, đã dựa vào việc xây dựng một số mô hình trí tuệ nhân tạo lớn nhất từ trước đến nay và đổ vào chúng một lượng lớn văn bản. Một cụm chip máy tính mới có thể giúp các mạng này phát triển đến kích thước gần như không thể tưởng tượng—và cho thấy việc ngày càng lớn có thể mở ra những tiến bộ vượt trội hơn trong trí tuệ nhân tạo, không chỉ trong việc hiểu ngôn ngữ mà có lẽ còn trong các lĩnh vực như robot học và thị giác máy tính.

Cerebras Systems, một startup đã xây dựng chip máy tính lớn nhất thế giới, giờ đây đã phát triển công nghệ cho phép một cụm chip đó chạy các mô hình trí tuệ nhân tạo lớn hơn hơn trăm lần so với những mô hình khổng lồ nhất hiện nay.

Cerebras nói rằng họ hiện có thể chạy mạng thần kinh với 120 nghìn tỷ kết nối, mô phỏng toán học về sự tương tác giữa các tế bào thần kinh và các nối liên. Các mô hình trí tuệ nhân tạo lớn nhất hiện nay có khoảng một nghìn tỷ kết nối, và chúng tốn hàng triệu đô la để xây dựng và huấn luyện. Nhưng Cerebras nói rằng phần cứng của họ sẽ thực hiện tính toán khoảng 1/50 thời gian của phần cứng hiện tại. Cụm chip của họ, cùng với yêu cầu về điện và làm mát, có lẽ vẫn không rẻ, nhưng Cerebras ít nhất khẳng định công nghệ của họ sẽ hiệu quả hơn đáng kể.

“Chúng tôi xây dựng nó với các tham số tổng hợp,” ông Andrew Feldman, người sáng lập và CEO của Cerebras, cho biết sẽ trình bày chi tiết về công nghệ tại hội nghị chip tuần này. “Vì vậy, chúng tôi biết chúng ta có thể, nhưng chúng tôi chưa huấn luyện một mô hình, vì chúng tôi là những người xây dựng cơ sở hạ tầng, và, dù sao, hiện vẫn chưa có mô hình nào” với kích thước đó, ông thêm.

Ngày nay, hầu hết các chương trình trí tuệ nhân tạo được huấn luyện bằng GPU, một loại chip ban đầu được thiết kế để tạo ra đồ họa máy tính nhưng cũng rất phù hợp cho việc xử lý song song mà các mạng thần kinh đòi hỏi. Các mô hình trí tuệ nhân tạo lớn về cơ bản được chia thành hàng chục hoặc hàng trăm GPU, được kết nối bằng dây chuyền tốc độ cao.

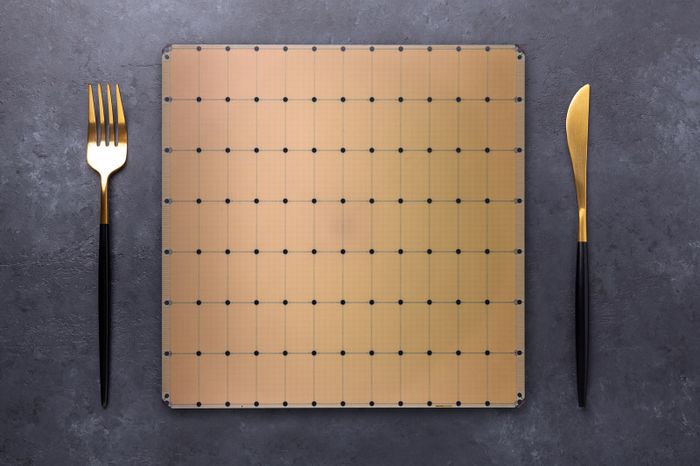

GPU vẫn hợp lý cho trí tuệ nhân tạo, nhưng khi các mô hình trở nên lớn hơn và các công ty tìm kiếm lợi thế, các thiết kế chuyên biệt hơn có thể tìm thấy vị trí của mình. Các tiến bộ gần đây và sự quan tâm thương mại đã gây ra một cuộc nổ không loại trừ về các thiết kế chip mới chuyên biệt cho trí tuệ nhân tạo. Chip của Cerebras là một phần thu hút trong sự tiến hóa đó. Trong khi các nhà thiết kế bình thường chia một wafer thành các mảnh để tạo ra các chip cá nhân, Cerebras đóng gói nhiều sức mạnh tính toán hơn bằng cách sử dụng toàn bộ wafer, để các đơn vị tính toán, hoặc cores, của họ trò chuyện với nhau hiệu quả hơn. Một GPU thường có vài trăm cores, nhưng chip mới nhất của Cerebras, được gọi là Wafer Scale Engine Two (WSE-2), có 850,000 cores.

Thiết kế có thể chạy một mạng thần kinh lớn một cách hiệu quả hơn so với các banks của GPU được kết nối với nhau. Nhưng việc sản xuất và chạy chip là một thách thức, đòi hỏi các phương pháp mới để điểm ets silicon, một thiết kế bao gồm các tính năng dự phòng để đối phó với các khuyết điểm trong quá trình sản xuất, và một hệ thống nước độc đáo để làm nguội chip khổng lồ.

Để xây dựng một cụm chip WSE-2 có khả năng chạy các mô hình trí tuệ nhân tạo có kích thước kỷ lục, Cerebras đã phải giải quyết một thách thức kỹ thuật khác: làm thế nào để lấy dữ liệu vào và ra khỏi chip một cách hiệu quả. Các chip thông thường có bộ nhớ riêng trên board, nhưng Cerebras đã phát triển một hộp bộ nhớ ngoại gọi là MemoryX. Công ty cũng tạo ra phần mềm cho phép một mạng thần kinh được lưu trữ một phần trong bộ nhớ ngoại đó, chỉ có các tính toán được chuyển đến chip silicon. Và họ xây dựng một hệ thống phần cứng và phần mềm gọi là SwarmX để kết nối mọi thứ.

“Họ có thể cải thiện khả năng mở rộng của quá trình huấn luyện lên quy mô lớn, vượt xa những gì mọi người đang làm hiện nay,” Mike Demler, một nhà phân tích cấp cao của Linley Group và là một biên tập viên cấp cao của The Microprocessor Report, nhận xét.

Demler cho biết hiện vẫn chưa rõ thị trường sẽ có bao nhiêu cho cụm chip này, đặc biệt khi một số khách hàng tiềm năng đã tự thiết kế các chip chuyên biệt hơn trong nhà. Ông nói thêm rằng hiệu suất thực sự của chip, về tốc độ, hiệu quả và chi phí, vẫn chưa rõ ràng. Cerebras chưa công bố bất kỳ kết quả benchmark nào cho đến nay.

“Có rất nhiều kỹ thuật ấn tượng trong công nghệ MemoryX và SwarmX mới,” Demler nói. “Nhưng giống như bộ xử lý, đây là những thứ rất chuyên biệt; chỉ hợp lý cho việc huấn luyện các mô hình rất lớn.”

Cho đến nay, các chip của Cerebras đã được các phòng thí nghiệm cần sức mạnh siêu máy tính áp dụng. Các khách hàng sớm bao gồm Argonne National Labs, Lawrence Livermore National Lab, các công ty dược phẩm như GlaxoSmithKline và AstraZeneca, và những tổ chức 'tình báo quân sự' mà Feldman mô tả.

Điều này cho thấy rằng chip Cerebras có thể được sử dụng không chỉ để cung cấp sức mạnh cho các mạng thần kinh; các phép tính mà các phòng thí nghiệm này chạy liên quan đến các phép toán toán học song song cực kỳ lớn. “Và họ luôn khao khát nhiều sức mạnh tính toán hơn,” Demler nói thêm, người cho biết rằng chip có thể trở thành một phần quan trọng cho tương lai của siêu máy tính.

David Kanter, một nhà phân tích của Real World Technologies và giám đốc điều hành của MLCommons, một tổ chức đo lường hiệu suất của các thuật toán và phần cứng AI khác nhau, nói rằng anh thấy có thị trường tương lai cho các mô hình AI lớn hơn nhiều. “Tôi thường tin vào ML [học máy] tập trung vào dữ liệu, vì vậy chúng ta cần các tập dữ liệu lớn hơn để xây dựng các mô hình lớn hơn với nhiều tham số hơn,” Kanter nói.

Theo Feldman, Cerebras có kế hoạch mở rộng bằng cách nhắm vào một thị trường mới nổi cho các thuật toán AI xử lý ngôn ngữ tự nhiên khổng lồ. Ông nói rằng công ty đã trò chuyện với các kỹ sư tại OpenAI, một công ty tại San Francisco đã tiên phong trong việc sử dụng các mạng thần kinh khổng lồ cho việc học ngôn ngữ cũng như robot và chơi game.

Công nghệ thuật toán mới nhất của OpenAI, được gọi là GPT-3, có khả năng xử lý ngôn ngữ một cách rất sáng suốt. Nó có thể tạo ra các bài báo về các chủ đề cụ thể, tóm tắt nội dung một cách chặt chẽ, và thậm chí viết mã máy tính. Tuy nhiên, nó dễ dàng mắc phải những hiểu lầm, thông tin sai lệch, và đôi khi có sự kỳ thị với phụ nữ. Mạng thần kinh điều khiển GPT-3 có khoảng 160 tỷ tham số.

“The next iteration, GPT-4, is projected to have about 100 trillion parameters,” Feldman mentions. “However, it won’t be ready for several years,” he adds.

OpenAI has provided access to GPT-3 for developers and startups through an API. Nonetheless, the company faces growing competition from startups developing similar language tools. Sam Altman, one of OpenAI’s founders, is an investor in Cerebras. “I believe we can achieve much more progress with current hardware,” Altman comments. “But it would be fantastic if Cerebras’ hardware could offer even greater capabilities.”

Việc xây dựng một mô hình có kích thước như GPT-3 đã tạo ra một số kết quả đáng ngạc nhiên. Khi được hỏi liệu một phiên bản của GPT lớn gấp 100 lần có chắc chắn thông minh hơn không - có thể thể hiện ít lỗi hơn hoặc hiểu biết sâu sắc hơn về common sense - Altman nói rằng khó có thể chắc chắn, nhưng anh ấy 'lạc quan'.

Những tiến bộ như vậy có thể cách xa ít nhất vài năm. Gần hơn, Cerebras hy vọng rằng đủ số công ty sẽ nhìn thấy nhu cầu về phần cứng được thiết kế để phát triển tất cả các loại mô hình trí tuệ nhân tạo.

Những bài viết tuyệt vời khác trên MYTOUR

- 📩 Cập nhật mới nhất về công nghệ, khoa học và hơn thế nữa: Nhận bản tin của chúng tôi!