Mặc dù giá bán cao, chiếc GPU chuyên dụng này của Nvidia vẫn thu hút sự quan tâm của nhiều ông lớn công nghệ, giúp hãng thu về lợi nhuận lớn.

Nvidia đang thu được gần 1.000% lợi nhuận cho mỗi GPU chuyên dụng AI H100 mà họ bán ra. Đây là con số được đưa ra trong một bài đăng gần đây trên mạng xã hội từ Tae Kim - một phóng viên kinh nghiệm từ trang tin Barron - chuyên về tin tức tài chính và đầu tư.

Nếu chuyển thành tiền mặt (USD), giá thị trường của mỗi chiếc H100 của Nvidia được ước tính từ 25.000 đến 40.000 USD (tương đương khoảng 952 triệu đồng), nhiều lần so với chi phí sản xuất. H100 được ước tính tốn khoảng 3320 USD/chiếc (tức là khoảng 79 triệu đồng) để sản xuất, bao gồm cả các chi phí liên quan đến chip bộ nhớ HBM trên bo mạch.

Con số chi phí ước tính này được trích dẫn từ nguồn tin của công ty tư vấn tài chính Raymond James. Tuy nhiên, vẫn chưa rõ chi tiết phân tích chi phí này ra sao.

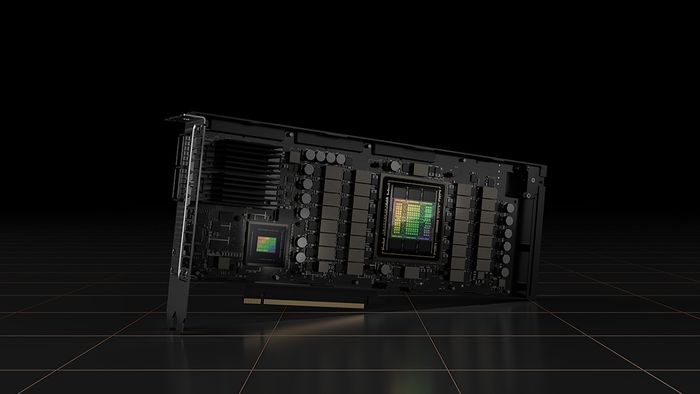

GPU chuyên dụng H100 của Nvidia. Ảnh: Internet

Nếu con số này chỉ là chi phí sản xuất thuần túy (bao gồm giá trung bình trên mỗi tấm wafer và các thành phần khác, tính đến sản lượng), Nvidia vẫn phải trang trải một khoản chi phí đáng kể cho mỗi chiếc H100 được xuất xưởng và gửi đến người dùng.

Tổng quan, việc phát triển sản phẩm yêu cầu rất nhiều thời gian và tài nguyên. Các chi phí nghiên cứu và phát triển cũng như chi phí nhân sự tham gia vào việc phát triển sản phẩm như H100 cần được tính toán trước khi đưa ra chi phí trung bình cuối cùng cho việc phát triển sản phẩm.

Theo thông tin từ Glassdoor, mức lương trung bình của một kỹ sư phần cứng điện tử tại Nvidia là khoảng 202.000 USD mỗi năm. Thường thì, quá trình phát triển các chip như H100 cần hàng nghìn giờ làm việc từ một lượng lớn chuyên gia hàng đầu. Tất cả điều này cũng phải được tính toán.

Tuy nhiên, Nvidia không thể phủ nhận được lợi thế khi trở thành thương hiệu hàng đầu trong lĩnh vực GPU chuyên dụng xử lý AI. Theo nhiều nguồn tin, GPU chuyên dụng của Nvidia được đặt hàng nhiều đến mức các đơn hàng đều đã được bán hết cho đến năm 2024.

Trong khi đó, các công ty AI đang cố gắng đảm bảo có đủ GPU để cung cấp năng lượng cho các mô hình sản xuất và tạo sinh do AI cung cấp. Foxconn dự đoán rằng thị trường máy chủ AI sẽ đạt giá trị 150 tỷ USD vào năm 2027 và những máy chủ AI hiện đại này phụ thuộc rất nhiều vào khả năng tính toán mạnh mẽ của phần cứng Nvidia mới nhất.

GPU H100 dựa trên vi kiến trúc Hopper, được thiết kế để sử dụng trong các trung tâm dữ liệu, khác biệt so với kiến trúc Ada Lovelace hỗ trợ thế hệ GPU chơi game GeForce RTX mới nhất. Tuy nhiên, mục đích chính của Hopper không phải là chơi game. H100 được trang bị GPU GH100 đã được cải tiến với 14.592 lõi CUDA, cùng với 80GB RAM HBM3 với bus bộ nhớ 5.120 bit.

Tham khảo Tomshardware