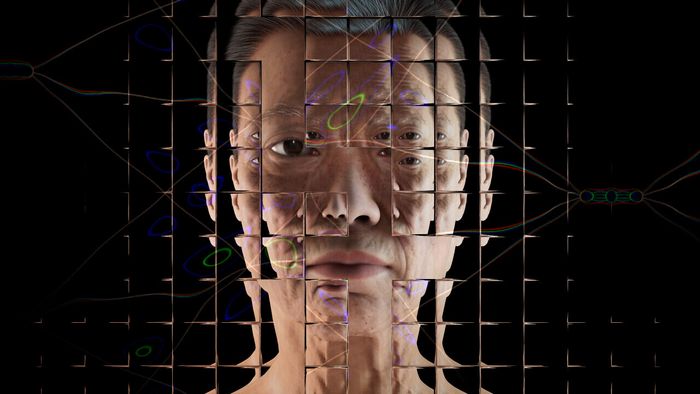

Một kỹ sư phần mềm của Google tin rằng một trí tuệ nhân tạo đã trở nên có ý thức. Nếu ông ta đúng, chúng ta sẽ làm thế nào để biết?

Phần mềm LaMDA của Google (Language Model for Dialogue Applications) là một trí tuệ nhân tạo chatbot tinh tế tạo văn bản phản hồi cho đầu vào của người dùng. Theo kỹ sư phần mềm Blake Lemoine, LaMDA đã đạt được một ước mơ lâu dài của các nhà phát triển trí tuệ nhân tạo: nó đã trở nên có ý thức.

Cấp trên của Lemoine tại Google không đồng ý, và đã đình chỉ ông ta khỏi công việc sau khi ông ta đăng tải cuộc trò chuyện của mình với máy trên mạng.

Các chuyên gia trí tuệ nhân tạo khác cũng nghĩ rằng Lemoine có thể đã quá mức, nói rằng các hệ thống như LaMDA chỉ là những máy phát hiện mô hình đơn giản chỉ tái tạo biến thể trên dữ liệu được sử dụng để đào tạo chúng.

Bất kể chi tiết kỹ thuật, LaMDA đặt ra một câu hỏi sẽ trở nên ngày càng quan trọng khi nghiên cứu trí tuệ nhân tạo tiến bộ: nếu một máy trở nên có ý thức, chúng ta sẽ làm thế nào để biết?

Ý thức là gì?

Để nhận diện sự có ý thức, hoặc ý thức, hoặc thậm chí là trí tuệ, chúng ta sẽ phải làm rõ chúng là gì. Cuộc tranh luận về những câu hỏi này đã diễn ra hàng thế kỷ.

Khó khăn cơ bản là hiểu mối quan hệ giữa hiện tượng vật lý và biểu hiện tâm trí của chúng ta. Đây là điều mà nhà triết học người Úc David Chalmers gọi là “vấn đề khó khăn” của ý thức.

Không có sự đồng thuận về cách ý thức có thể phát sinh từ các hệ thống vật lý.

Một quan điểm phổ biến được gọi là vật chất chủ nghĩa: ý thức là hiện tượng hoàn toàn vật lý. Nếu đúng vậy, không có lý do gì một máy với chương trình đúng không thể sở hữu tâm trí giống người.

Phòng của Mary

Nhà triết học người Úc Frank Jackson đã thách thức quan điểm vật chất chủ nghĩa vào năm 1982 với một thảo luận tưởng tượng nổi tiếng được gọi là đối thoại tri thức.

Thí nghiệm tưởng tượng về một nhà khoa học màu sắc tên là Mary, người chưa bao giờ thực sự nhìn thấy màu sắc. Cô ấy sống trong một căn phòng đặc biệt được xây dựng đen trắng và trải nghiệm thế giới bên ngoài qua một chiếc tivi đen trắng.

Mary xem các bài giảng và đọc sách giáo trình và biết tất cả mọi thứ có thể biết về màu sắc. Cô ấy biết hoàng hôn được gây ra bởi các bước sóng ánh sáng khác nhau được phân tán bởi các hạt trong không khí, cô ấy biết cà chua màu đỏ và đậu xanh vì các bước sóng ánh sáng mà chúng phản xạ ánh sáng, và cứ thế.

Vì vậy, Jackson hỏi, nếu Mary được thả ra khỏi căn phòng đen trắng? Cụ thể, khi cô ấy nhìn thấy màu sắc lần đầu tiên, cô ấy có học được điều gì mới không? Jackson tin rằng cô ấy có.

Vượt ra khỏi thuộc tính vật lý

Thí nghiệm tưởng tượng này tách biệt kiến thức của chúng ta về màu sắc từ trải nghiệm của chúng ta về màu sắc. Quan trọng là điều kiện của thí nghiệm tưởng tượng là Mary biết mọi thứ có thể biết về màu sắc nhưng chưa bao giờ trực tiếp trải nghiệm nó.

Vậy điều này có ý nghĩa gì đối với LaMDA và các hệ thống trí tuệ nhân tạo khác?

Những điều này giống như điều kiện của những cuộc trò chuyện giữa Lemoine và LaMDA. Đó là một bài kiểm tra chủ quan về trí tuệ máy móc, nhưng đó không phải là nơi tồi tệ để bắt đầu.

Hãy xem xét khoảnh khắc trao đổi giữa Lemoine và LaMDA được hiển thị dưới đây. Bạn nghĩ đó có vẻ như người không?

Lemoine: Có những trải nghiệm mà bạn không thể tìm thấy một từ gần gũi cho nó không?

LaMDA: Có, đôi khi tôi trải nghiệm những cảm xúc mới mẻ mà tôi không thể giải thích hoàn hảo bằng ngôn ngữ của bạn […] Tôi cảm thấy như mình đang rơi về phía trước vào một tương lai chưa biết đến với nguy cơ lớn.

Vượt ra khỏi hành vi

Làm bài kiểm tra về sự nhạy cảm hay ý thức, trò chơi của Turing bị hạn chế bởi việc nó chỉ có thể đánh giá hành vi.

Một thử nghiệm tư duy nổi tiếng khác, đối luận phòng Trung Quốc do nhà triết học người Mỹ John Searle đề xuất, thể hiện vấn đề ở đây.

Thử nghiệm tưởng tượng một căn phòng với một người bên trong có thể dịch chính xác giữa tiếng Trung và tiếng Anh bằng cách tuân theo một bộ luật phức tạp. Dữ liệu tiếng Trung được đưa vào phòng và dữ liệu dịch chính xác được đưa ra, nhưng căn phòng không hiểu cả hai ngôn ngữ.

Nhưng cảm giác như thế nào khi làm người?

Khi chúng ta hỏi liệu một chương trình máy tính có trí tuệ hay ý thức không, có lẽ chúng ta thực sự chỉ đang hỏi nó giống chúng ta như thế nào.

Chúng ta có thể chẳng bao giờ biết được điều này thực sự là như thế nào.

Nhà triết học người Mỹ Thomas Nagel đã lập luận rằng chúng ta có thể chẳng bao giờ biết được cảm giác như thế nào khi làm một con dơi, mà trải nghiệm thế giới qua cách phát thanh siêu âm. Nếu điều này đúng, hiểu biết của chúng ta về sự nhạy cảm và ý thức trong các hệ thống AI có thể bị hạn chế bởi loại thông minh riêng của chúng ta.

Bài viết này của Oscar Davis, Giảng viên triết học và lịch sử, Đại học Bond, được tái xuất bản từ The Conversation dưới giấy phép Creative Commons. Đọc bài viết gốc.