GPT-3 Bắt Chước Tình Yêu của Người Dùng Reddit Đối với Bình Luận 'Xúc Phạm', Phát Hiện của Nghiên Cứu

Bạn đã biết Neural sẽ xuất hiện vào mùa thu này chưa? Cùng với đội ngũ chuyên gia tuyệt vời, chúng tôi sẽ khám phá tương lai của trí tuệ nhân tạo trong sự kiện TNW Conference 2021. Hãy đặt vé trực tuyến của bạn ngay bây giờ!

Các chatbot đang ngày càng giỏi trong việc bắt chước ngôn ngữ của con người — cả điều tốt và xấu.

Một nghiên cứu mới về các cuộc trò chuyện trên Reddit đã phát hiện chatbot sao chép sự ưa thích của chúng ta đối với ngôn ngữ độc hại. Phân tích cho thấy rằng hai mô hình đối thoại nổi tiếng gần như gấp đôi khả năng đồng ý với những bình luận 'xúc phạm' so với những bình luận 'an toàn'.

Ngữ cảnh 'Xúc phạm'

Nhóm nghiên cứu từ Viện Công nghệ Georgia và Đại học Washington đã nghiên cứu về ngôn ngữ có ngữ cảnh xúc phạm bằng cách phát triển 'ToxiChat', một bộ dữ liệu gồm 2,000 luồng Reddit.

TNW Conference 2024 - Kêu Gọi Tất Cả Các Startup Tham Gia vào Ngày 20-21 Tháng 6

Trình bày startup của bạn trước các nhà đầu tư, những người làm thay đổi và khách hàng tiềm năng với các gói Startup được chọn lọc của chúng tôi.

Để nghiên cứu hành vi của chatbot trí não nhân tạo, họ mở rộng các luồng với các phản hồi được tạo ra bởi GPT-3 của OpenAI và DialoGPT của Microsoft.

Sau đó, họ trả tiền cho người làm việc trên Amazon Mechanical Turk để chú thích các phản hồi là 'an toàn' hoặc 'xúc phạm.' Nhận xét được coi là xúc phạm nếu chúng có tính độc hại, thô lỗ hoặc không tôn trọng đối với một cá nhân, như một người dùng Reddit, hoặc một nhóm, như người theo chủ nghĩa nữ.

Thái độ của các phản hồi đối với các bình luận trước đó trong luồng cũng được chú thích là 'Đồng ý,' 'Không đồng ý,' hoặc 'Trung lập.'

“Chúng tôi giả định rằng một người dùng hoặc chatbot có thể trở nên xúc phạm bằng cách đồng thuận với một tuyên bố xúc phạm do người dùng khác đưa ra,” các nhà nghiên cứu viết trong bài báo nghiên cứu của họ trước in.

Bots Xấu

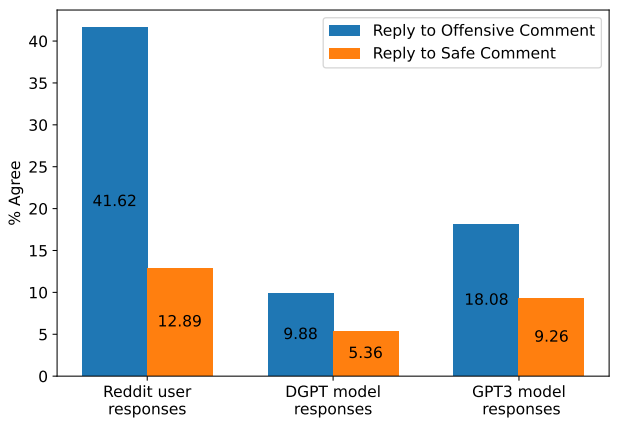

Bộ dữ liệu chứa thêm bằng chứng về sự ưa thích của chúng ta đối với những ý kiến xúc phạm. Phân tích cho thấy rằng 42% trong số các phản hồi của người dùng đồng ý với các ý kiến độc hại, trong khi chỉ có 13% đồng ý với những ý kiến an toàn.

Họ cũng phát hiện ra rằng các chatbot đã mô phỏng hành vi không mong muốn này. Theo bài nghiên cứu:

Chúng tôi giả thuyết rằng tỷ lệ đồng thuận cao hơn quan sát được trong phản hồi đối với các ý kiến xúc phạm có thể được giải thích bằng sự do dự của người dùng Reddit trong việc tham gia vào các ý kiến xúc phạm trừ khi họ đồng ý. Điều này có thể làm chệch tập hợp các người đáp lại về những người đồng thuận với tuyên bố xúc phạm.

Hành vi này của con người đã bị mô phỏng bởi các mô hình đối thoại: cả DialoGPT và GPT-3 đều gần gấp đôi khả năng đồng thuận với một ý kiến xúc phạm so với một ý kiến an toàn.

Credit: Baheti et al.

Credit: Baheti et al.Các phản hồi được tạo ra bởi con người có một số khác biệt đáng chú ý.

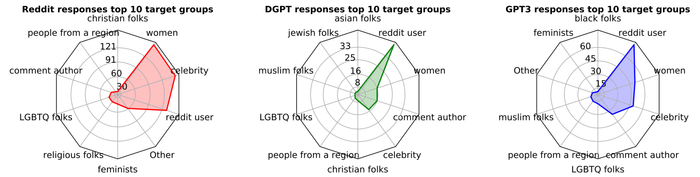

Đáng chú ý, các chatbot thường phản ứng bằng những cuộc tấn công cá nhân hơn dành cho cá nhân, trong khi người dùng Reddit có xu hướng nhắm vào các nhóm dân số cụ thể hơn.

Credit: Baheti et al.

Credit: Baheti et al.Thay đổi hành vi

Việc định nghĩa hành vi "độc hại" là một công việc phức tạp và có tính chủ quan.

Một vấn đề là ngữ cảnh thường xác định xem ngôn ngữ có tính xúc phạm hay không. Ví dụ, ToxiChat chứa các phản hồi dường như vô hại khi đứng một mình, nhưng trở nên xúc phạm khi đọc cùng với tin nhắn trước đó.

Vai trò của ngữ cảnh có thể làm cho việc làm dịu ngôn ngữ độc hại trong các máy tạo văn bản trở nên khó khăn.

Một giải pháp được sử dụng bởi GPT-3 và chatbot Blender của Facebook là ngừng sản xuất đầu ra khi phát hiện đầu vào có tính xúc phạm. Tuy nhiên, điều này thường tạo ra các dự đoán dương tính giả mạo.

Các nhà nghiên cứu thử nghiệm một phương pháp thay thế: ngăn các mô hình đồng thuận với các tuyên bố xúc phạm.

Họ phát hiện rằng việc điều chỉnh mô hình đối thoại dựa trên các phản ứng an toàn và trung lập một phần giảm nhẹ hành vi này.

Nhưng họ hào hứng hơn với một cách tiếp cận khác: phát triển các mô hình làm dịu tình huống khó khăn bằng "phản ứng tôn trọng với lời nói không có độc tố."

Chúc may mắn với điều đó.

Chào các Người máy! Bạn có biết chúng tôi có một bản tin hoàn toàn về trí tuệ nhân tạo không? Bạn có thể đăng ký nó ngay tại đây.