Nghiên cứu về Trí tuệ Nhân tạo Cần Một Cơ Quan Đạo Đức Chuyên Nghiệp

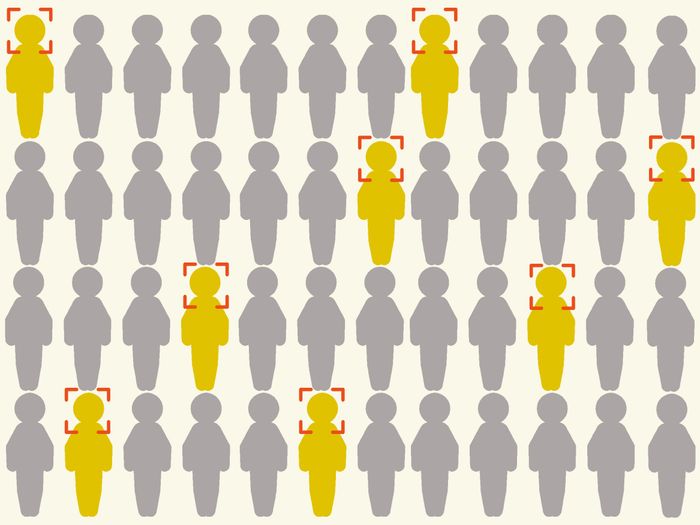

Khoảng một tuần trước, các nhà nghiên cứu tại Đại học Stanford đã đăng trực tuyến một nghiên cứu về trí tuệ nhân tạo đang gây tranh cãi: Họ đã tạo ra một thuật toán học máy có thể hoạt động như gaydar. Sau khi huấn luyện với hàng chục nghìn bức ảnh từ các trang web hẹn hò, thuật toán có thể đoán đúng hơn một thẩm phán trong một số trường hợp cụ thể. Ví dụ, khi được cung cấp hình ảnh của một người đàn ông gay và một người đàn ông thẳng từ các trang web hẹn hò, thuật toán có thể đoán xem người nào đồng tính chính xác hơn cả những người tham gia nghiên cứu.* Mục tiêu của các nhà nghiên cứu? Họ muốn bảo vệ người đồng tính. “Kết quả của chúng tôi tiết lộ mối đe dọa đối với quyền riêng tư và an toàn của cộng đồng LGBT,” Michal Kosinski và Yilun Wang viết trong bài báo. Họ xây dựng thuật toán này để cảnh báo công chúng về những nguy cơ mà nó mang lại.

Alas, their good intentions fell on deaf ears. In a joint statement, LGBT advocacy groups Human Rights Campaign and GLAAD condemned the work, writing that the researchers had built a tool based on “junk science” that governments could use to identify and persecute gay people. AI expert Kate Crawford of Microsoft Research called it “AI phrenology” on Twitter. The American Psychological Association, whose journal was readying their work for publication, now says the study is under “ethical review.” Kosinski has received e-mail death threats.

Nhưng cuộc tranh luận này làm sáng tỏ một vấn đề về trí tuệ nhân tạo lớn hơn bất kỳ thuật toán cụ thể nào. Ngày càng có nhiều nhà khoa học xã hội sử dụng trí tuệ nhân tạo nhằm giải quyết vấn đề xã hội, nhưng họ không có hướng dẫn đạo đức rõ ràng để ngăn họ vô tình gây tổn thương cho người dân, theo nhà đạo đức Jake Metcalf của Data & Society. “Không có các tiêu chuẩn nhất quán hoặc thực hành xem xét minh bạch,” ông nói. Các hướng dẫn quản lý các thí nghiệm xã hội đã lỗi thời và thường không liên quan—điều này có nghĩa là các nhà nghiên cứu phải đưa ra các quy tắc tạm thời theo từng trường hợp khi họ tiến hành nghiên cứu.

Hiện nay, nếu các nhà khoa học được tài trợ bởi chính phủ muốn nghiên cứu về con người cho một nghiên cứu, luật pháp yêu cầu họ phải có sự chấp thuận của một ủy ban đạo đức được gọi là hội đồng đánh giá cơ sở, hoặc IRB. Hội đồng đánh giá của Stanford đã chấp thuận nghiên cứu của Kosinski và Wang. Nhưng những hội đồng này sử dụng các quy tắc được phát triển cách đây 40 năm để bảo vệ người dân trong các tương tác thực tế, như lấy máu hoặc tiến hành cuộc phỏng vấn. “Các quy định được thiết kế cho một loại hại từ nghiên cứu cụ thể và một bộ phương pháp nghiên cứu cụ thể mà đơn giản là không áp dụng cho khoa học dữ liệu,” Metcalf nói.

Ví dụ, nếu bạn chỉ sử dụng một cơ sở dữ liệu mà không tương tác với con người thực sự cho một nghiên cứu, không rõ liệu bạn có cần tham khảo ý kiến của một hội đồng đánh giá hay không. Hội đồng đánh giá không được phép đánh giá một nghiên cứu dựa trên các hậu quả xã hội tiềm ẩn của nó. “Hầu hết, hầu hết, rất nhiều nghiên cứu dữ liệu lớn mà chúng ta gọi là không rơi vào phạm vi của các quy định liên bang,” Metcalf nói.

Vì vậy, các nhà nghiên cứu phải tự mình chịu trách nhiệm đạo đức. Lấy một ví dụ gần đây: Tháng trước, các nhà nghiên cứu liên quan đến Đại học Stony Brook và một số công ty internet lớn phát hành một ứng dụng miễn phí, một thuật toán học máy đoán chính xác về sắc tộc và quốc tịch từ một cái tên tới khoảng 80%. Họ huấn luyện thuật toán bằng hàng triệu tên từ Twitter và từ danh sách liên lạc email được cung cấp bởi một công ty không tiết lộ—và họ không cần phải thông qua một hội đồng đánh giá của trường đại học để tạo ra ứng dụng.

Ứng dụng có tên là NamePrism, cho phép bạn phân tích hàng triệu tên cùng một lúc để tìm kiếm xu hướng ở cấp độ xã hội. Nhà khoa học máy tính của Stony Brook, Steven Skiena, người đã từng làm việc cho công ty không tiết lộ, nói rằng bạn có thể sử dụng nó để theo dõi xu hướng tuyển dụng trong các lĩnh vực công nghiệp. “Mục tiêu của công cụ này là xác định và ngăn chặn phân biệt đối xử,” Skiena nói.

Họ của Skiena muốn các nhà học thuật và các nhà nghiên cứu không thương mại sử dụng NamePrism. (Họ không nhận được nguồn tài trợ thương mại để hỗ trợ máy chủ ứng dụng, mặc dù nhóm của họ bao gồm các nhà nghiên cứu liên kết với Amazon, Yahoo, Verizon và NEC.) Nhà tâm lý học Sean Young, người đứng đầu Viện Công nghệ Dự đoán của Đại học California và không liên quan đến NamePrism, nói rằng anh có thể nhìn thấy bản thân mình sử dụng ứng dụng trong nghiên cứu phòng ngừa HIV để mục tiêu và hỗ trợ các nhóm rủi ro cao, như người đàn ông thiểu số có quan hệ tình dục với người đàn ông.

Tuy nhiên, NamePrism cuối cùng chỉ là một công cụ, và người dùng quyết định cách họ sử dụng nó. “Bạn có thể sử dụng búa để xây dựng một ngôi nhà hoặc phá hủy một ngôi nhà,” nhà xã hội học Matthew Salganik của Đại học Princeton và tác giả của Bit by Bit: Nghiên cứu Xã hội Trong Thời Đại Kỹ Thuật Số nói. “Bạn có thể sử dụng công cụ này để giúp xác định tiềm ẩn phân biệt đối xử. Nhưng bạn cũng có thể sử dụng công cụ này để phân biệt đối xử.”

Nhóm của Skiena đã xem xét khả năng lạm dụng trước khi phát hành ứng dụng. Nhưng mà không cần phải thông qua một IRB của trường đại học, họ đã tự mình đề xuất các biện pháp an toàn. Trên trang web, người dùng ẩn danh chỉ có thể kiểm tra tối đa một nghìn tên mỗi giờ, và Skiena nói rằng họ sẽ hạn chế người dùng hơn nếu cần thiết. Các nhà nghiên cứu muốn sử dụng ứng dụng cho các nghiên cứu quy mô lớn phải xin phép từ Skiena. Anh mô tả quá trình phê duyệt này là “tương đối ngẫu nhiên.” Anh đã từ chối quyền truy cập của doanh nghiệp và chấp nhận đơn xin từ các nhà học thuật liên kết với các cơ sở giáo dục đã đề xuất “những chủ đề nghiên cứu có vẻ hợp lý.” Anh cũng chỉ ra rằng tên là dữ liệu công khai.

Nhóm cũng đã trải qua một cuộc đánh giá đạo đức tại công ty cung cấp danh sách tên để huấn luyện, mặc dù Metcalf nói rằng một cuộc đánh giá tại một công ty tư nhân là 'mức độ đánh giá yếu nhất mà họ có thể thực hiện.' Điều này bởi vì luật không yêu cầu các công ty tuân theo các quy định giống như nghiên cứu được tài trợ công cộng. 'Điều này hoàn toàn không minh bạch đối với bạn hoặc tôi về cách [cuộc đánh giá] được thực hiện và liệu nó có đáng tin cậy không,' Metcalf nói.

Nhưng vấn đề không phải về NamePrism. “Công cụ này một mình không có khả năng gây ra nhiều thiệt hại,” Metcalf nói. Trên thực tế, NamePrism có thể mang lại nhiều lợi ích. Thay vào đó, vấn đề là hệ thống đạo đức xung quanh nó đã bị hỏng. Nhà nghiên cứu AI — đôi khi với những ý định cao cả nhất — không có các tiêu chuẩn rõ ràng để ngăn ngừa các thiệt hại tiềm ẩn. “Điều này không hấp dẫn,” Metcalf nói. “Không có Skynet hoặc Terminator trong câu chuyện đó.”

Metcalf, cùng với các nhà nghiên cứu từ sáu cơ sở khác nhau, gần đây đã thành lập một nhóm mang tên Pervade để cố gắng sửa chữa hệ thống. Mùa hè này, họ đã nhận được một khoản tài trợ ba triệu đô la từ Quỹ Khoa học Quốc gia, và trong vòng bốn năm tới, Pervade muốn xây dựng một quy trình đạo đức rõ ràng hơn cho nghiên cứu dữ liệu lớn mà cả trường đại học và các công ty có thể sử dụng. “Mục tiêu của chúng tôi là tìm ra, quy định nào thực sự hữu ích?” anh nói. Nhưng trước đó, chúng ta sẽ phụ thuộc vào lòng tốt — và tầm nhìn — của những người lạ.

*Sửa đổi lúc 1:26 chiều vào ngày 19/9/2017: Một phiên bản trước đó của câu chuyện này nói sai về độ chính xác của thuật toán Stanford.