SK hynix, công ty hàng đầu trong việc phát triển HBM3 DRAM (Bộ Nhớ Động Truy Cập Ngẫu Nhiên Băng Thông Cao 3), đã bắt đầu sản xuất hàng loạt từ tháng 10/2021. Một trong những khách hàng đầu tiên sử dụng HBM3 từ SK hynix là NVIDIA.

Trong lĩnh vực công nghệ tiên tiến như AI, big data, ML (machine learning), HPC (High Performance Computing) và ADAS (Advanced Driver Assistance Systems), các công ty công nghệ hàng đầu trên toàn cầu đều cần có khả năng xử lý dữ liệu nhanh chóng để đáp ứng với lượng dữ liệu ngày càng tăng. HBM3 được coi là lựa chọn hàng đầu nhờ vào hiệu suất xử lý dữ liệu vượt trội so với DRAM truyền thống. HBM3, là thế hệ thứ tư của HBM, tiếp tục nối tiếp sự thành công của HBM (Gen 1), HBM2 (Gen 2) và HBM2E (Gen 3).

SK hynix, công ty hàng đầu trong việc phát triển HBM3 DRAM (Bộ Nhớ Động Truy Cập Ngẫu Nhiên Băng Thông Cao 3), đã bắt đầu sản xuất hàng loạt từ tháng 10/2021. Một trong những khách hàng đầu tiên sử dụng HBM3 từ SK hynix là NVIDIA.

Trong lĩnh vực công nghệ tiên tiến như AI, big data, ML (machine learning), HPC (High Performance Computing) và ADAS (Advanced Driver Assistance Systems), các công ty công nghệ hàng đầu trên toàn cầu đều cần có khả năng xử lý dữ liệu nhanh chóng để đáp ứng với lượng dữ liệu ngày càng tăng. HBM3 được coi là lựa chọn hàng đầu nhờ vào hiệu suất xử lý dữ liệu vượt trội so với DRAM truyền thống. HBM3, là thế hệ thứ tư của HBM, tiếp tục nối tiếp sự thành công của HBM (Gen 1), HBM2 (Gen 2) và HBM2E (Gen 3). HBM3 sử dụng hơn 8000 TSV (Through-Silicon Via - kỹ thuật kết nối hiệu năng cao) trên mỗi stack, tức hơn 100,000 TSV trong 12-Hi stack, và có thể có tối đa 12-Hi stack, nâng cấp từ 8-Hi stack của HBM2E thế hệ trước. Khi được xếp chồng ở mức tối đa, dung lượng HBM3 có thể lên đến 24 GB, và với kiến trúc 16 kênh, HBM3 hoạt động ở 6.4 Gbps, gấp đôi so với HBM2E và hiện tại là tốc độ nhanh nhất thế giới. Điều này khiến HBM3 trở thành điều kiện tiên quyết cho các hãng sản xuất xe tự hành ở cấp độ tự động hóa 4 và 5. Nếu thay thế toàn bộ GDDR bằng HBM3, chúng ta có thể giảm thải khí nhà kính khoảng 830,000 tấn vào năm 2030.

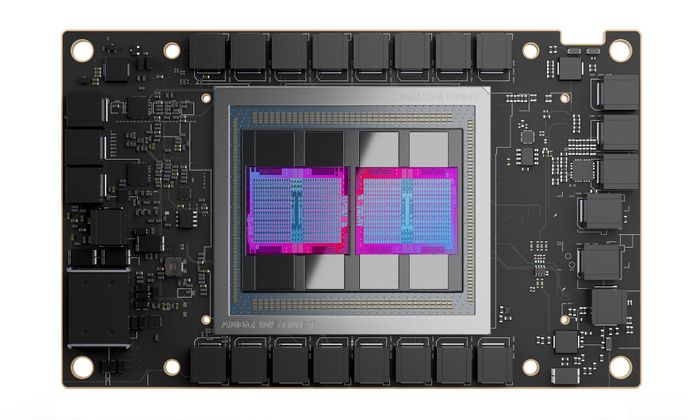

Gần đây, NVIDIA đã hoàn thành đánh giá hiệu suất của các mẫu HBM3 từ SK hynix sản xuất. Sản phẩm NVIDIA được trang bị HBM3 dự kiến sẽ xuất xưởng vào Q3 năm nay, và nổi bật trong số đó là NVIDIA H100 Tensor Core GPU. Với HBM3, DRAM này mang lại băng thông nhớ lớn lên đến 819 GBps, tương đương với việc truyền tải mỗi giây được gần 164 bộ phim chất lượng Full HD (dung lượng khoảng 5 GB), từ đó nâng cao hiệu năng tính toán.

SK hynix

HBM3 sử dụng hơn 8000 TSV (Through-Silicon Via - kỹ thuật kết nối hiệu năng cao) trên mỗi stack, tức hơn 100,000 TSV trong 12-Hi stack, và có thể có tối đa 12-Hi stack, nâng cấp từ 8-Hi stack của HBM2E thế hệ trước. Khi được xếp chồng ở mức tối đa, dung lượng HBM3 có thể lên đến 24 GB, và với kiến trúc 16 kênh, HBM3 hoạt động ở 6.4 Gbps, gấp đôi so với HBM2E và hiện tại là tốc độ nhanh nhất thế giới. Điều này khiến HBM3 trở thành điều kiện tiên quyết cho các hãng sản xuất xe tự hành ở cấp độ tự động hóa 4 và 5. Nếu thay thế toàn bộ GDDR bằng HBM3, chúng ta có thể giảm thải khí nhà kính khoảng 830,000 tấn vào năm 2030.

Gần đây, NVIDIA đã hoàn thành đánh giá hiệu suất của các mẫu HBM3 từ SK hynix sản xuất. Sản phẩm NVIDIA được trang bị HBM3 dự kiến sẽ xuất xưởng vào Q3 năm nay, và nổi bật trong số đó là NVIDIA H100 Tensor Core GPU. Với HBM3, DRAM này mang lại băng thông nhớ lớn lên đến 819 GBps, tương đương với việc truyền tải mỗi giây được gần 164 bộ phim chất lượng Full HD (dung lượng khoảng 5 GB), từ đó nâng cao hiệu năng tính toán.

SK hynix