Nhóm nghiên cứu ở Ý và Đức giới thiệu phương pháp nhũ tương trong robot

Các nhà khoa học đã sử dụng tính toán nhũ tương để giúp robot tiếp tục học về các đối tượng mới sau khi chúng đã được triển khai.

Đối với những người chưa biết, tính toán nhũ tương sao chép cấu trúc thần kinh của não người để tạo ra thuật toán có thể xử lý sự không chắc chắn của thế giới tự nhiên.

Intel Labs đã phát triển một trong những kiến trúc đáng chú ý nhất trong lĩnh vực này: vi xử lý nhũ tương Loihi. Chip nhũ tương này được tạo ra từ khoảng 130,000 tế bào thần kinh nhân tạo, gửi thông tin cho nhau qua mạng thần kinh "spiking" (SNN).

Loihi bao gồm khoảng 130,000 tế bào thần kinh nhân tạo, gửi thông tin cho nhau qua mạng thần kinh "spiking" (SNN). Những vi chip này đã đưa ra nhiều hệ thống, từ một loại da nhân tạo thông minh đến một "mũi" điện tử nhận biết mùi hương phát ra từ chất nổ.

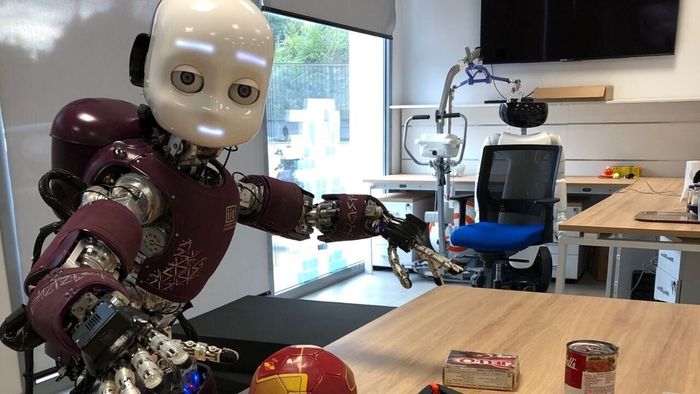

Tuần này, Intel Labs giới thiệu một ứng dụng khác. Đơn vị nghiên cứu hợp tác với Viện Công nghệ Italia và Đại học Kỹ thuật Munich để triển khai Loihi trong một phương pháp mới về học liên tục cho robot.

Học tương tác

Phương pháp này nhằm vào các hệ thống tương tác với môi trường không ràng buộc, chẳng hạn như các trợ lý robot trong lĩnh vực y tế và sản xuất trong tương lai.

Các mạng nơ-ron sâu hiện tại có thể gặp khó khăn khi học về đối tượng trong những tình huống này, vì chúng yêu cầu dữ liệu đào tạo chuẩn bị kỹ lưỡng — và đào tạo lại cẩn thận trên các đối tượng mới chúng gặp phải. Phương pháp nhũ tương mới nhằm vượt qua những hạn chế này.

Các nhà nghiên cứu đầu tiên triển khai một mạng nơ-ron nhũ tương trên Loihi. Kiến trúc này tổ chức việc học ở một lớp duy nhất của các liên kết nhựa. Nó cũng tính đến các quan điểm khác nhau về đối tượng bằng cách thêm các tế bào thần kinh mới theo yêu cầu.

Kết quả là, quá trình học diễn ra tự động trong khi tương tác với người sử dụng.

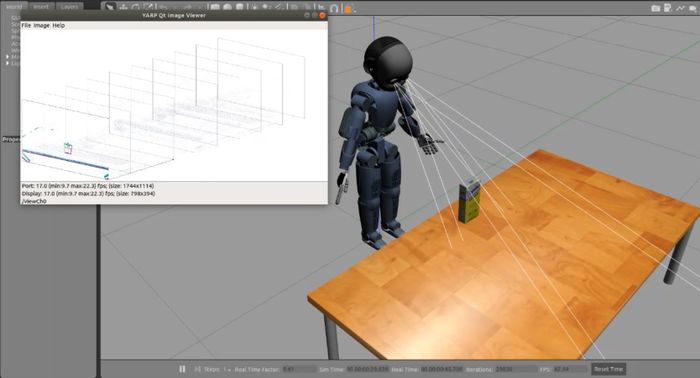

Mô phỏng nhũ tương

Đội ngũ đã thử nghiệm phương pháp của họ trong một môi trường 3D mô phỏng. Trong bài cài đặt này, robot cảm nhận hoạt động bằng cách di chuyển một máy ảnh dựa trên sự kiện, đóng vai trò là đôi mắt của nó.

Cảm biến của máy ảnh “nhìn thấy” đối tượng theo cách được truyền cảm hứng từ những chuyển động nhỏ của đôi mắt gọi là “microsaccades.” Nếu đối tượng nó nhìn thấy là mới, biểu diễn SNN sẽ được học hoặc cập nhật. Nếu đối tượng đã biết, mạng nhận diện nó và cung cấp phản hồi cho người sử dụng.

The data collected by the camera drives an SNN on the Loihi chip. Credit: Intel Labs

The data collected by the camera drives an SNN on the Loihi chip. Credit: Intel LabsNhóm nói rằng phương pháp của họ yêu cầu tới 175 lần ít năng lượng hơn để cung cấp tốc độ và độ chính xác tương đương hoặc tốt hơn so với các phương pháp thông thường chạy trên CPU.

Bây giờ họ cần thử nghiệm thuật toán của họ trong thế giới thực với các robot thực tế.

“Mục tiêu của chúng tôi là áp dụng khả năng tương tự cho các robot trong tương lai làm việc trong môi trường tương tác, giúp chúng thích ứng với những điều không lường trước và làm việc tự nhiên hơn cùng con người,” Yulia Sandamirskaya, tác giả chính của nghiên cứu, nói trong một tuyên bố.

Nghiên cứu của họ, đã được đặt tên là “Best Paper” tại Hội nghị Quốc tế về Hệ thống Nhũ tương (ICONS) năm nay, có thể đọc tại đây.