Tại sao Trí tuệ Nhân tạo nhận biết cảm xúc không thể tiết lộ cảm xúc của chúng ta

Sự sử dụng ngày càng tăng của Trí tuệ Nhân tạo trong việc nhận biết cảm xúc đang gây lo lắng cho những nhà đạo đức. Họ cảnh báo rằng công nghệ này dễ bị chệch lệch chủng tộc, không tính đến sự khác biệt văn hóa và được sử dụng cho quản lý toàn dân. Một số người cho rằng Trí tuệ Nhân tạo thậm chí không thể nhận diện cảm xúc một cách chính xác.

Một nghiên cứu mới được công bố trên Nature Communications đã đưa thêm ánh sáng vào những hạn chế này.

Các nhà nghiên cứu đã phân tích ảnh của các diễn viên để kiểm tra xem các cử động khuôn mặt có thể diễn đạt độ chân thực của trạng thái cảm xúc hay không.

Họ phát hiện ra rằng mọi người sử dụng các cử động khuôn mặt khác nhau để truyền đạt những cảm xúc tương tự. Một người có thể nhăn mày khi họ tức giận, ví dụ, nhưng người khác có thể mở to đôi mắt hoặc thậm chí cười.

Nghiên cứu cũng cho thấy mọi người sử dụng các động tác tương tự để truyền đạt các cảm xúc khác nhau, như nhăn mày để diễn đạt sự tập trung và tức giận.

Tác giả nghiên cứu Lisa Feldman Barrett, một nhà thần kinh học tại Đại học Northeastern, cho biết rằng những kết quả này đặt ra thách thức đối với những khẳng định phổ biến về Trí tuệ Nhân tạo và cảm xúc:

Các công ty khẳng định họ có thuật toán có thể phát hiện sự tức giận, ví dụ, trong khi thực tế họ - trong điều kiện tối ưu - chỉ có thể phát hiện sự nhăn mày, điều này có thể hoặc không phải là biểu hiện của sự tức giận. Quan trọng là không nhầm lẫn giữa việc mô tả cấu hình khuôn mặt với những suy luận về ý nghĩa cảm xúc của nó.

Diễn xuất phương pháp

Các nhà nghiên cứu sử dụng diễn viên chuyên nghiệp vì họ có "kiến thức chuyên môn" về cảm xúc: sự thành công của họ phụ thuộc vào việc họ diễn đạt một cách chân thực cảm xúc của nhân vật.

Các diễn viên đã được chụp ảnh khi thực hiện các kịch bản chi tiết, kích thích cảm xúc. Ví dụ, “Anh ấy là một người lái xe máy ra khỏi quán bar của biker ngay sau khi một chàng trai trong một chiếc Porsche lùi vào chiếc Harley bóng bẩy của anh ấy” và “Cô ấy đối mặt với người yêu của mình, người đã từ chối cô ấy, và vợ anh ấy khi họ ra khỏi một nhà hàng.”

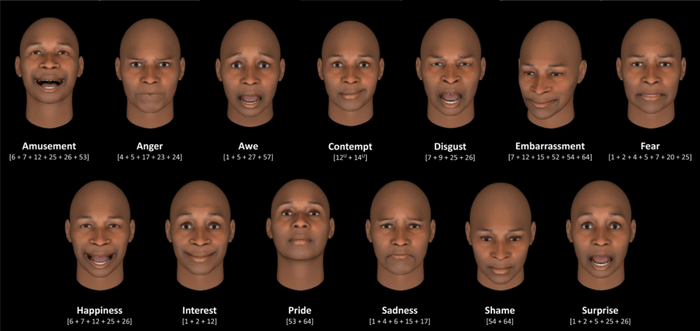

Các tình huống đã được đánh giá trong hai nghiên cứu riêng biệt. Trong nghiên cứu đầu tiên, 839 tình nguyện viên đánh giá mức độ mà mô tả tình huống một mình gợi lên một trong 13 cảm xúc: vui vẻ, tức giận, sợ hãi, kinh ngạc, khinh bỉ, kinh tởm, xấu hổ, sợ hãi, hạnh phúc, quan tâm, tự hào, buồn bã, xấu hổ và ngạc nhiên.

Credit: Nature Communications

Credit: Nature CommunicationsSau đó, các nhà nghiên cứu sử dụng đánh giá trung bình của mỗi tình huống để phân loại chúng thành 13 danh mục cảm xúc.

Đội ngũ sau đó sử dụng học máy để phân tích cách diễn viên mô tả những cảm xúc này trong các bức ảnh.

Điều này tiết lộ rằng các diễn viên đã sử dụng các cử động khuôn mặt khác nhau để diễn đạt cùng loại cảm xúc. Nó cũng cho thấy rằng các tư thế khuôn mặt tương tự không đáng tin cậy để diễn đạt cùng loại cảm xúc.

Tạo dáng

Đội ngũ sau đó yêu cầu nhóm tình nguyện viên bổ sung đánh giá ý nghĩa cảm xúc của mỗi tư thế khuôn mặt một mình.

Họ phát hiện ra rằng đánh giá của các tư thế một mình không đáng tin cậy khớp với đánh giá của các biểu hiện khuôn mặt khi chúng được xem cùng với các tình huống.

Barrett cho biết điều này chỉ ra sự quan trọng của bối cảnh trong đánh giá về biểu hiện khuôn mặt của chúng ta:

Khi nói đến việc diễn đạt cảm xúc, một khuôn mặt không nói lên chính nó.

Nghiên cứu minh họa sự biến động lớn trong cách chúng ta diễn đạt cảm xúc của mình. Nó cũng làm rõ hơn những lo ngại về Trí tuệ Nhân tạo nhận biết cảm xúc, mà đã được sử dụng trong tuyển dụng, công an, và giáo dục,

Xin chào những người ngoại trái đất! Bạn có biết chúng tôi có một bản tin về Trí tuệ Nhân tạo không? Bạn có thể đăng ký nó ngay tại đây.