Chắc chắn, Trí tuệ nhân tạo của DeepMind là ấn tượng, nhưng liệu nó có thể hướng dẫn trực giác con người không?

Bài viết này là phần của những đánh giá về các bài nghiên cứu về trí tuệ nhân tạo của chúng tôi, một loạt bài đăng khám phá những phát hiện mới nhất trong lĩnh vực trí tuệ nhân tạo.

Học sâu có thể giúp khám phá ra các mối quan hệ toán học mà các nhà khoa học con người không thể tìm ra, như một bài báo gần đây của các nghiên cứu viên tại DeepMind cho thấy. Như nhiều thứ khác đến từ phòng thí nghiệm trí tuệ nhân tạo thuộc sở hữu của Alphabet, bài báo này, mang tiêu đề “Tiến bộ toán học thông qua sự hướng dẫn trực giác con người bằng Trí tuệ Nhân tạo,” đã nhận được nhiều sự chú ý từ truyền thông khoa học và công nghệ.

Một số nhà toán học và nhà khoa học máy tính đã ca ngợi những nỗ lực của DeepMind và các phát hiện trong bài báo như là những đột phá. Những người khác lại cảm thấy hoài nghi hơn và tin rằng việc sử dụng học sâu trong toán học có thể đã được đánh giá quá mức trong bài báo và sự đưa tin trên báo đài phổ biến.

Tuy nhiên, kết quả vẫn rất hấp dẫn và có thể mở rộng bộ công cụ của các nhà khoa học trong việc khám phá và chứng minh các định lý toán học.

Một khuôn khổ cho việc khám phá toán học với máy học

TNW Conference 2024 - Mời tất cả các Startup tham gia vào ngày 20-21 tháng 6

Trình bày Startup của bạn trước nhà đầu tư, những người thay đổi và khách hàng tiềm năng với các gói Startup được chọn lọc của chúng tôi.

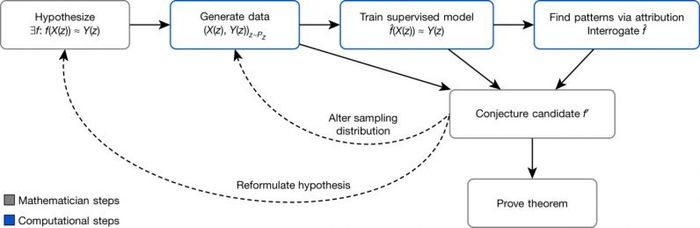

Trong bài báo của họ, các nhà nghiên cứu tại DeepMind đề xuất rằng Trí tuệ Nhân tạo có thể được sử dụng để “hỗ trợ trong việc khám phá các định lý và giả thuyết ở phía trước của nghiên cứu toán học.” Họ đề xuất một “khung cảnh để bổ sung bộ công cụ toán học tiêu chuẩn với các phương pháp nhận biết và diễn giải mạnh mẽ từ học máy.”

Framework for using machine learning in mathematical discovery. DeepMind

Framework for using machine learning in mathematical discovery. DeepMindNhững nhà toán học bắt đầu bằng cách đặt một giả thuyết về mối quan hệ giữa hai đối tượng toán học. Để xác minh giả thuyết, họ sử dụng các chương trình máy tính để tạo dữ liệu cho cả hai loại đối tượng. Tiếp theo, một thuật toán mô hình học máy học có giám sát nghiền số liệu và cố gắng điều chỉnh các tham số của nó để ánh xạ một loại đối tượng sang loại khác.

“Điều quan trọng của học máy trong quá trình hồi quy này là bộ hàm phi tuyến rộng lớn có thể được học được với đủ lượng dữ liệu,” các nhà nghiên cứu viết.

Nếu mô hình được đào tạo hoạt động tốt hơn so với việc đoán ngẫu nhiên, thì có thể gợi ý rằng thực sự có một mối quan hệ có thể khám phá giữa hai đối tượng toán học. Bằng cách sử dụng các kỹ thuật học máy khác nhau, các nhà nghiên cứu có thể tìm ra các điểm dữ liệu quan trọng hơn đối với vấn đề, điều chỉnh giả thuyết của họ, tạo dữ liệu mới và đào tạo các mô hình mới. Bằng cách lặp lại những bước này, họ có thể thu hẹp tập hợp các giả thuyết có thể và nhanh chóng tiến đến một giải pháp cuối cùng.

Các nhà khoa học của DeepMind mô tả khung cảnh này như một “laboratory kiểm thử cho trực giác” có thể nhanh chóng xác nhận “liệu một trực giác về mối quan hệ giữa hai lượng có thể đáng giá để theo đuổi” và cung cấp hướng dẫn về cách chúng có thể liên quan đến nhau.

Bằng cách sử dụng khung cảnh này, các nhà nghiên cứu của DeepMind đã sử dụng học sâu để đạt được “hai khám phá mới cơ bản, một trong topo học và một trong lý thuyết biểu diễn.”

Một khía cạnh thú vị của công việc là nó không đòi hỏi lượng lớn công suất tính mà đã trở thành một điểm cốt lõi của nghiên cứu của DeepMind. Theo bài báo, các mô hình học sâu được sử dụng trong cả hai khám phá có thể được đào tạo “trong vài giờ trên một máy có một đơn vị xử lý đồ họa.”

Nút và biểu diễn

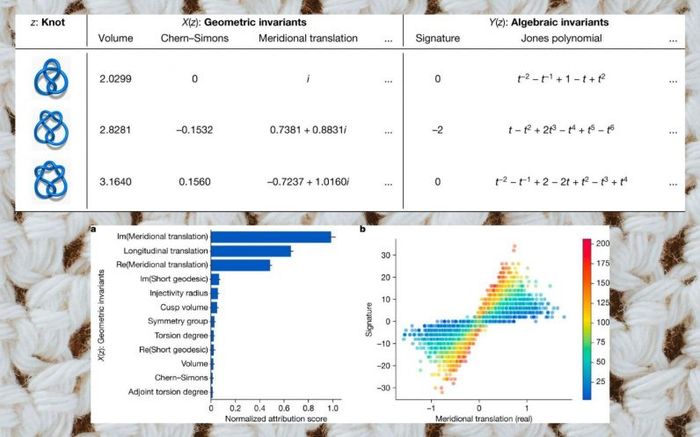

Nút là những vòng đóng trong không gian nhiều chiều có thể được định nghĩa theo nhiều cách. Chúng trở nên phức tạp hơn khi số lượng băng qua của chúng tăng lên. Các nhà nghiên cứu muốn xem liệu họ có thể sử dụng học máy để khám phá một ánh xạ giữa các không gian đại số và không gian siêu giả tưởng, hai cách định nghĩa cơ bản khác nhau về nút.

“Giả thuyết của chúng tôi là tồn tại một mối quan hệ chưa được khám phá giữa các không gian siêu giả tưởng và đại số của một nút,” các nhà nghiên cứu viết.

Sử dụng gói phần mềm SnapPy, các nhà nghiên cứu tạo ra “chữ ký,” một đại lượng đại số, và 12 đại lượng siêu giả tưởng triển vọng cho 1.7 triệu nút có đến 16 băng qua.

Tiếp theo, họ tạo ra một mạng nơ-ron truyền thẳng đầy đủ kết nối với ba tầng ẩn, mỗi tầng có 300 đơn vị. Họ đào tạo mô hình học sâu để ánh xạ các giá trị của các không gian siêu giả tưởng đến chữ ký. Mô hình ban đầu của họ có thể dự đoán chữ ký với độ chính xác 78%. Phân tích chi tiết hơn đưa họ đến một tập hợp nhỏ các tham số trong không gian siêu giả tưởng mà có thể dự đoán được chữ ký. Các nhà nghiên cứu làm rõ giả thuyết của họ, tạo dữ liệu mới, đào tạo lại mô hình và đạt được một định lý cuối cùng.

Các nhà nghiên cứu mô tả định lý này như “một trong những kết quả đầu tiên kết nối các đại lượng đại số và hình học của nút và có nhiều ứng dụng thú vị.”

“Chúng tôi kỳ vọng rằng mối quan hệ mới được phát hiện này giữa độ dốc tự nhiên và chữ ký sẽ có nhiều ứng dụng khác trong topo học chiều thấp. Điều đáng ngạc nhiên là một kết nối đơn giản nhưng sâu sắc như vậy đã bị bỏ qua trong một lĩnh vực đã được nghiên cứu một cách rộng rãi,” các nhà nghiên cứu viết.

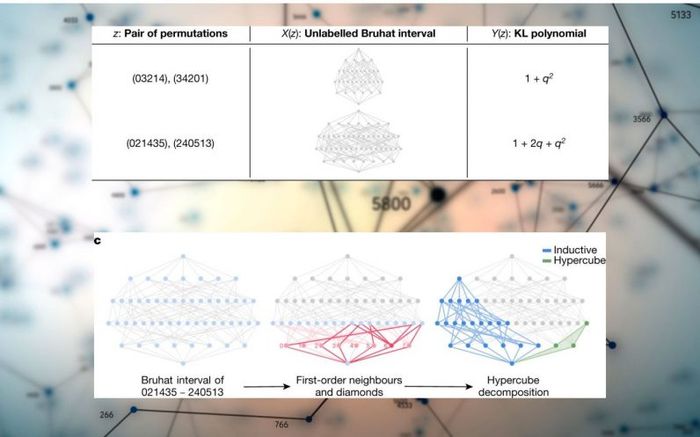

Kết quả thứ hai trong bài báo cũng là một ánh xạ giữa hai quan điểm khác nhau về đối xứng, một vấn đề phức tạp hơn nhiều so với nút.

Trong trường hợp này, họ sử dụng một loại mạng nơ-ron đồ thị (GNN) để tìm mối quan hệ giữa đồ thị khoảng Bruhat và đa thức Kazhdan-Lusztig (KL). Một trong những lợi ích của GNN là chúng có thể tính toán và học các đồ thị rất lớn và khó quản lý đối với tâm trí không được giúp đỡ. Mô hình học sâu lấy đồ thị khoảng làm đầu vào và cố gắng dự đoán đa thức KL tương ứng.

Một lần nữa, bằng cách tạo dữ liệu, đào tạo mô hình học sâu và điều chỉnh quy trình, các nhà khoa học có thể đưa ra một giả thuyết có thể chứng minh được.

Phản ứng với Trí tuệ Nhân tạo toán học của DeepMind

Nói về khám phá của DeepMind trong lý thuyết nút, Mark Brittenham, một nhà lý thuyết nút tại Đại học Nebraska–Lincoln, nói với Nature, “Việc các tác giả đã chứng minh rằng những đại lượng này có liên quan, và một cách đặc biệt trực tiếp, cho chúng ta biết rằng có điều gì đó rất cơ bản mà chúng ta trong lĩnh vực này vẫn chưa hiểu đúng.” Brittenham thêm rằng, so với những nỗ lực khác để áp dụng học máy vào nút, kỹ thuật của DeepMind là mới mẻ với khả năng khám phá các kết nối đáng kinh ngạc.

Adam Zsolt Wagner, một nhà toán học tại Đại học Tel Aviv, Israel, cũng nói chuyện với Nature, nói rằng các phương pháp mà DeepMind đưa ra có thể có giá trị đối với một số loại vấn đề.

Wagner, người có kinh nghiệm trong việc áp dụng học máy vào toán học, nói, “Mà không có công cụ này, nhà toán học có thể lãng phí tuần hoặc thậm chí là một vài tháng cố gắng chứng minh một công thức hoặc định lý cuối cùng sẽ cuối cùng là sai.” Nhưng anh cũng thêm rằng không rõ tác động của nó sẽ lớn đến đâu.

Lý do để nghi ngờ

Sau khi công bố công việc của DeepMind trên Nature, Ernest Davis, Giáo sư Khoa học Máy tính tại Đại học New York, đã công bố một bài báo của riêng mình, nêu lên một số câu hỏi quan trọng về cách DeepMind đặt ra kết quả và giới hạn của việc áp dụng học sâu vào toán học nói chung.

Về kết quả đầu tiên trình bày trong bài báo của DeepMind, Davis nhận xét rằng lý thuyết nút không phải là loại vấn đề mà học sâu thường xuất sắc hơn so với các phương pháp học máy hoặc thống kê khác.

“Sức mạnh của DL nằm ở các trường hợp như thị giác hoặc văn bản nơi mỗi trường hợp (ảnh hoặc văn bản) có một số lượng lớn đặc trưng đầu vào cấp thấp, khó xác định đặc trưng cấp cao mức độ đáng tin cậy, và hàm liên quan giữa đặc trưng đầu vào và câu trả lời, theo mọi người có thể nói, vô cùng phức tạp, mà không có tập con nhỏ nào của đặc trưng đầu vào có thể xác định,” Davis viết.

Vấn đề về nút chỉ có mười hai đặc trưng đầu vào, trong đó chỉ có ba đặc trưng quan trọng. Và mối quan hệ toán học giữa các đặc trưng đầu vào và biến mục tiêu đơn giản.

“Khó có thể thấy tại sao một mạng nơ-ron với 200,000 tham số sẽ là phương pháp được chọn; các phương pháp thống kê đơn giản, truyền thống hoặc máy vector hỗ trợ sẽ phù hợp hơn,” Davis viết.

Trong dự án thứ hai, vai trò của học sâu quan trọng hơn nhiều, Davis lưu ý. “Khác với dự án lý thuyết nút, sử dụng một kiến trúc DL chung, mạng nơ-ron được thiết kế cẩn thận để phù hợp với kiến thức toán học sâu về vấn đề. Hơn nữa, DL hoạt động hiệu quả hơn nhiều, với khoảng 1/40 lỗi so với dữ liệu gốc,” ông viết.

Một mặt, kết quả chống lại lời phê bình rằng việc tích hợp kiến thức lĩnh vực vào học sâu là khó khăn, Davis lưu ý. “Mặt khác, những người nghiện DL thường khen ngợi DL là một phương pháp học ‘cắm và chạy’ có thể được áp dụng vào dữ liệu nguyên thủy cho bất kỳ vấn đề nào xuất hiện; điều này đối nghịch với lời khen đó,” ông viết.

Davis cũng chú ý rằng thành công của việc áp dụng học sâu vào những nhiệm vụ này có thể phụ thuộc quyết định vào cách dữ liệu huấn luyện được tạo ra và cách cấu trúc toán học được mã hóa. Điều này gợi ý rằng khung nhìn có thể được áp dụng cho một lớp hẹp các vấn đề toán học.

“Tìm ra cách tốt nhất để tạo ra và mã hóa dữ liệu liên quan đến sự kết hợp của lý thuyết, kinh nghiệm, nghệ thuật và thử nghiệm. Sự gánh nặng của tất cả đều đặt trên vai người chuyên gia,” ông viết. “Học sâu có thể là một công cụ mạnh mẽ, nhưng không phải lúc nào cũng là một công cụ mạnh mẽ.”

Davis cảnh báo rằng trong bối cảnh hào nhoáng hiện tại về học sâu, “có một động lực nghịch đảo để tập trung vai trò của học sâu trong nghiên cứu này, không chỉ đối với các chuyên gia ML từ DeepMind, mà thậm chí cả với các nhà toán học.”

Davis kết luận rằng, khi sử dụng trong bài báo, học sâu nên được xem xét như là “một công cụ phân tích khác trong hộp công cụ của toán thực nghiệm thay vì là một phương pháp toán học mới mẻ.”

Cũng đáng chú ý là các tác giả của bài báo gốc cũng đã chỉ ra một số giới hạn của khung nhìn của họ, bao gồm “nó đòi hỏi khả năng tạo ra bộ dữ liệu lớn của các biểu diễn của các đối tượng và các mô hình phải có thể phát hiện ra các mẫu trong các ví dụ có thể tính toán được. Hơn nữa, ở một số lĩnh vực, các hàm mục tiêu có thể khó để học trong mô hình này.”

Học sâu và trực giác

Một trong những chủ đề gây tranh cãi là khẳng định của bài báo rằng học sâu đang “hướng dẫn trực giác.” Davis mô tả khẳng định này như là một “mô tả nghiêm trọng sai lệch về sự hỗ trợ mà những người toán học đã đạt được, hoặc có thể mong đợi đạt được, từ việc sử dụng các hệ thống học sâu.”

Trực giác là một trong những yếu tố quyết định chính giữa trí tuệ con người và trí tuệ nhân tạo. Đó là khả năng đưa ra quyết định tốt hơn so với đoán ngẫu nhiên và có thể dẫn bạn theo hướng đúng hầu hết thời gian. Như lịch sử của AI đã thể hiện, trực giác không được thu thập trong vô số các quy tắc hoặc mẫu đã được xác định trước được tìm thấy trong lượng lớn dữ liệu.

“Trong bối cảnh toán học, từ ‘trực giác’ có nghĩa là một khái niệm hoặc một bằng chứng có thể dựa trên ý thức sâu sắc của người đó về các lĩnh vực quen thuộc như số lượng, không gian, thời gian, hoặc chuyển động, hoặc theo một cách khác ‘hợp lý’ hoặc ‘có vẻ đúng’ một cách không liên quan đến tính toán rõ ràng hoặc lý luận từng bước,” Davis viết.

Mặc dù việc nhận thức trực giác về các khái niệm toán học thường đòi hỏi phải xem xét nhiều ví dụ cụ thể, đó không phải là công việc của các tương quan thống kê, Davis lập luận. Nói cách khác, bạn không có trực giác bằng cách chạy hàng triệu ví dụ và quan sát phần trăm lần xuất hiện của các mẫu cụ thể.

Điều này có nghĩa là không phải các mô hình học sâu đã cung cấp cho các nhà khoa học một hiểu biết trực giác về các khái niệm họ định nghĩa, các định lý họ chứng minh và những giả thuyết họ đề xuất.

Davis viết, “Những gì học sâu làm là đưa ra một số lời khuyên về những đặc điểm của vấn đề dường như quan trọng và những đặc điểm dường như không quan trọng. Điều này không nên bị coi thường, nhưng cũng không nên được phóng đại.”

Bài viết này được đăng ban đầu bởi Ben Dickson trên TechTalks, một xuất bản phẩm nghiên cứu xu hướng trong công nghệ, cách chúng ảnh hưởng đến cuộc sống và kinh doanh của chúng ta, và những vấn đề chúng giải quyết. Nhưng chúng tôi cũng thảo luận về mặt xấu của công nghệ, những hậu quả tối tăm của công nghệ mới, và những điều chúng ta cần phải chú ý. Bạn có thể đọc bài viết gốc tại đây.