Trong nhiều tháng qua, các công ty truyền thông xã hội đã đấu tranh với việc làm thế nào để giảm thiểu hoặc loại bỏ lời nói kỳ thị trên các nền tảng của họ. YouTube đang làm việc để đảm bảo quảng cáo không xuất hiện trên những video mang tính chất gây hấn. Instagram đang sử dụng trí tuệ nhân tạo để xóa bỏ các bình luận không hay. Và sớm hơn trong tuần này, ProPublica đưa tin về tài liệu đào tạo nội bộ mà Facebook cung cấp cho các quản lý nội dung quản lý bình luận và đăng bài trên nền tảng về cách tính toán điều gì là lời nói kỳ thị và điều gì không phải là lời nói kỳ thị.

Theo báo cáo, các quy tắc sử dụng một logic cố ý, mặc dù lạ lùng, trong việc xác định cách bảo vệ một số nhóm người khỏi lời nói kỳ thị trong khi không bảo vệ nhóm khác. ProPublica chỉ ra một ví dụ cụ thể từ tài liệu đào tạo: quy tắc của Facebook quy định rằng “đàn ông da trắng” là một nhóm được bảo vệ trong khi “trẻ em da đen” không được bảo vệ.

Cách Quy Tắc Hoạt Động

Theo quy tắc của Facebook, có các danh mục được bảo vệ --- như giới tính, nhận dạng giới tính, chủng tộc và tín ngưỡng tôn giáo --- và các danh mục không được bảo vệ --- như tầng lớp xã hội, nghề nghiệp, diện mạo và tuổi tác. Nếu lời nói ám chỉ đến nhóm đầu tiên, đó là lời nói kỳ thị; nếu ám chỉ đến nhóm thứ hai, thì không phải. Vì vậy, “chúng ta nên giết hết tất cả người Hồi giáo” là lời nói kỳ thị. “Chúng ta nên giết hết tất cả người nghèo” không phải là lời nói kỳ thị.

Phân loại nhị phân này có thể làm cho một số người cảm thấy không thoải mái, nhưng khi các nhóm được bảo vệ và không được bảo vệ liên kết với nhau trong một câu --- một hạng mục hỗn hợp --- chính sách của Facebook trở nên rất lạ lùng. Logic của Facebook quy định như sau:

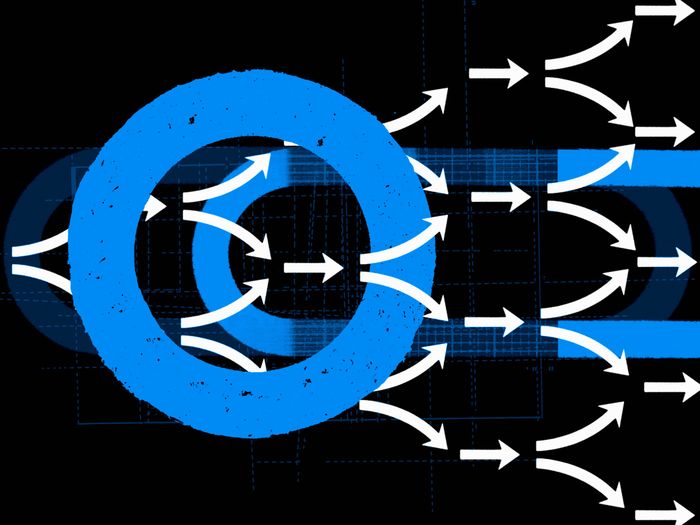

Danh mục được bảo vệ + Danh mục được bảo vệ = Danh mục được bảo vệ

Danh mục được bảo vệ + Danh mục không được bảo vệ = Danh mục không được bảo vệ

Để minh họa điều này, tài liệu đào tạo của Facebook cung cấp ba ví dụ - “đàn ông da trắng”, “phụ nữ lái xe”, và “trẻ em da đen” - và chỉ ra rằng chỉ có nhóm đầu tiên trong số này được bảo vệ khỏi lời nói kỳ thị. Câu trả lời là “đàn ông da trắng.” Tại sao? Bởi vì “trắng” + “nam” = danh mục được bảo vệ + danh mục được bảo vệ, và do đó, nhóm người kết quả được bảo vệ. Một cách đảo ngược, vì “đen” (một danh mục được bảo vệ) biến đổi “trẻ em” (không được bảo vệ), nhóm này không được bảo vệ.

Toán học + Ngôn ngữ = Mơ hồ

Trong toán học, loại quy tắc logic này được gọi là logic biểu tượng, và nó có các quy tắc có thể hiểu được. Nguyên tắc logic dựa trên từ ngữ được tạo ra lần đầu tiên vào thế kỷ 19 bởi nhà toán học George Boole, và từ đó đã trở thành điều cần thiết cho sự phát triển từ bộ xử lý máy tính đến ngôn ngữ học. Nhưng bạn không cần phải có bằng Tiến sĩ về logic hoặc triết học ngôn ngữ để nhận ra khi các quy tắc cơ bản bị vi phạm. “Những người kỹ sư của @facebook học toán ở đâu vậy? Các thành viên thuộc tập hợp C của tập hợp A vẫn là thành viên của A,” Chanda Prescod-Weinstein, một nhà thiên văn học tại Đại học Washington, tweet.

Những nhà triết học ngôn ngữ nghĩ rất nhiều về việc biến đổi một nhóm sẽ làm thay đổi logic của một câu. Đôi khi khi bạn có một từ chỉ một nhóm - như người da trắng - và bạn thay thế nó bằng một phần của cùng nhóm đó - như những kẻ sát nhân da trắng - suy luận không theo sau. Đôi khi lại có. Ví dụ, lấy câu “Tất cả chim đều có lông” và thay thế nó bằng “Tất cả chim trắng đều có lông.” Câu thứ hai vẫn hợp lý và là một suy luận tốt. Nhưng lấy câu “Một số chim thích mật ong” và thay thế nó bằng “Một số chim trắng thích mật ong,” có thể không còn đúng nữa - có thể chỉ có chim màu xanh lá thích mật ong. Đó là một suy luận tồi.

Quy định của Facebook dường như cho rằng mỗi khi một danh mục được bảo vệ được sửa đổi bằng một danh mục không được bảo vệ, suy luận là xấu. Vì vậy chỉ vì “người da đen” là một nhóm được bảo vệ, không hề ngụ ý rằng “trẻ em da đen” là một nhóm được bảo vệ, mặc dù người thông thường khi nhìn vào ví dụ đó sẽ nói rằng trẻ em da đen là một phần nhỏ của người da đen.

Thực tế là không có cách nào để biết một cách có hệ thống liệu việc thay thế một danh mục bằng một phụ loại có dẫn đến một suy luận tốt hay xấu. “Bạn phải thay thế các ví dụ khác nhau,” như Matt Teichman, một nhà triết học ngôn ngữ tại Đại học Chicago, nói. “Bạn phải chỉ nhìn vào sự phức tạp của những gì đang xảy ra để có thể biết chắc chắn.”

Teichman suy ngẫm về một ví dụ có thể hỗ trợ cho thuật toán của Facebook: Tất cả kẻ giết người da trắng nên chết. “Mỗi khi tôi gặp phải các chính sách kỳ quặc như vậy, tôi cố gắng nghĩ, liệu có cách nào để biện minh cho điều đó không?” ông nói. Ở đó, tập hợp “kẻ giết người”, trong hầu hết các trường hợp, là xấu. Vì vậy, có lẽ việc chỉ trích lời nói kỳ thị đối với họ là hợp lý. Nhưng chủng tộc của một kẻ giết người là --- hoặc ít nhất là nó nên là --- hoàn toàn không liên quan đến việc xấu, và việc bao gồm chủng tộc trong cảm xúc đó có vẻ gặp vấn đề ít nhất.

Biết Quy Tắc Thay Đổi Trò Chơi

Bây giờ khi mọi người biết quy tắc của Facebook, có rất nhiều cách để vi phạm chúng. Ví dụ, nếu ai đó sử dụng thuật ngữ “những người Hồi giáo bị cực đoan” trên Facebook, điều đó không phải là lời nói kỳ thị (đặc điểm “cực đoan” khiến nhóm đó không được bảo vệ). Chỉ cần áp dụng một điều chỉnh đến một nhóm được bảo vệ, một người có thể phổ biến một kiểu mẫu và phê phán một phụ loại trong khi bí mật ám chỉ về toàn bộ nhóm, mà không vi phạm quy tắc của Facebook.

“Có một sự khác biệt pháp lý thú vị giữa ý nghĩa chính xác và ý nghĩa ngụ ý. Bạn phải chịu trách nhiệm với những gì bạn nói chính xác, nhưng bạn thường có thể né tránh việc thực sự cam kết với những gì bạn chỉ ngụ ý,” Teichman nói.

Tuân theo các quy tắc có thể trở thành một bài tập vô lý rất nhanh chóng. Người ta có thể sửa đổi một nhóm được bảo vệ một cách sao cho bao gồm càng nhiều phần lớn của nhóm đó. Ví dụ, nói “Trẻ em da đen không nên được phép vào thị trấn của chúng ta” so với “Người lớn da đen không nên được phép vào thị trấn của chúng ta.” Bằng cách viết câu sau, một người có thể phổ biến lời nói kỳ thị mà bao gồm toàn bộ cộng đồng da đen - mà không vi phạm quy tắc của Facebook. Và việc lợi dụng các quy tắc không kết thúc ở đó. Chỉ bằng cách sửa đổi tên của một nhóm được bảo vệ với mô tả về diện mạo - “xấu xí” “béo” - một người có thể thêm lời xúc phạm vào tổn thương.

Nhìn vào các quy tắc như một tổng thể, ProPublica báo cáo rằng Facebook phát triển các quy tắc như một phản ứng với các yếu tố cụ thể, chẳng hạn như các chính phủ và người dùng, phàn nàn. Đôi khi, các quy tắc được mở rộng, bao gồm một quy tắc tổng quát cho rằng, “‘Xóa bỏ bất cứ điều gì khiến bạn cảm thấy không thoải mái,’” Dave Willner, một cựu nhân viên của Facebook, nói trong báo cáo của ProPublica. Willner đã sửa đổi các quy tắc hiện tại để làm cho chúng chặt chẽ hơn. Kết quả, Teichman nói, dường như là một sự pha trộn được xây dựng không từ một quyết định đạo đầu từ trên xuống về đạo đức, mà thay vào đó là một danh sách ghép ráp theo thời gian. “Các danh mục trở nên lộn xộn khi chúng chỉ là kết quả của việc được nối kết từ những phàn nàn mà mọi người đã gửi đi,” Teichman nói.

Khi được hỏi về quan điểm của họ về những vấn đề này, Facebook chỉ đến Mytour một tuyên bố về lời nói kỳ thị được phát hành vào ngày trước khi báo cáo của ProPublica. Theo tuyên bố, ý định của Facebook là trở thành “một nền tảng mở cho mọi ý kiến.”

Một số người nhìn nhận những quy định này với ánh sáng đen tối hơn - rằng chính sách nhằm bảo vệ người dân tối thiểu nhất có thể. “Có lẽ điều họ đang cố gắng làm với quy tắc này là cho phép một chút lời nói vấn đề đi qua để người dùng muốn tham gia vào đó sẽ sử dụng trang web của họ,” Teichman nói.

Cuối cùng, các quy định của Facebook không tính đến sự tinh tế của ngôn ngữ hoặc những vấn đề lịch sử và xã hội tinh vi đã khiến cho các danh mục được bảo vệ ban đầu. “Một mặt bạn phải yêu thích sự thanh lịch của một chính sách bảo vệ rõ ràng người đàn ông da trắng và không phải trẻ em da đen vì đó chính xác là điều mà học giả về chủng tộc và bất bình đẳng quy định làm. Chính sách không nhìn màu sắc và chính sách đa dạng làm,” Tressie McMillan Cottom, một nhà xã hội học tại Đại học Virginia Commonwealth, tweet.

Một số người nghĩ rằng lời nói kỳ thị, giống như khiêu dâm, không thể được định nghĩa theo cách có hệ thống. Thay vào đó, như Thẩm phán Tòa án Tối cao Potter Stewart viết về khiêu dâm trong Jacobellis v. Ohio, “Tôi biết nó khi tôi nhìn thấy nó.” Và đó là nơi thiên vị bắt đầu hiện diện, đặc biệt là bây giờ khi trí tuệ nhân tạo được đào tạo bởi những con người chủ nghĩa nội dung mà nó cố gắng thay thế. Không phải là các người kiểm duyệt hoàn hảo, mà là một trí tuệ nhân tạo, như DeepText mà Instagram, thuộc Facebook, gần đây triển khai để loại bỏ những bình luận xấu, có khả năng chứa đựng những giả định logic và cấu trúc quyền lực giống nhau, vô tình, trong các quyết định mà nó đưa ra.