Dùng một mô hình Trí tuệ nhân tạo đang được nổi tiếng hiện nay, các nhà khoa học có thể tái tạo lại hình ảnh mà con người nhìn thấy bằng cách quét hoạt động não.

Quét não của con người và hiểu được cách đôi mắt nhìn thế giới xung quanh là ước mơ lâu nay của các nhà khoa học thần kinh. Với hiểu biết này, các nhà khoa học có thể cải thiện giao tiếp của người khuyết tật và giúp họ tương tác với thế giới bên ngoài.

Hiện nay, ước mơ này đang dần trở thành hiện thực nhờ vào sự phát triển của công nghệ Trí tuệ nhân tạo. Vào tháng 10 năm trước, phần mềm Trí tuệ nhân tạo đã giúp các nhà khoa học quét não và chuyển đổi nó thành văn bản. Bây giờ, các mô hình Trí tuệ nhân tạo về ngôn ngữ tự nhiên còn có khả năng tái tạo lại cả hình ảnh mà con người nhìn thấy.

Mô hình Trí tuệ nhân tạo sử dụng trong nghiên cứu này là Stable Diffusion, một công cụ Trí tuệ nhân tạo nổi tiếng có khả năng tạo ra hình ảnh từ gợi ý của người dùng, tương tự như Dall-E 2 và Midjourney.

Ảnh Internet

Huấn luyện bằng dữ liệu văn bản thu được từ quét não

Trong nghiên cứu của mình, dựa vào hệ thống của Stable Diffusion, các nhà nghiên cứu tại Đại học Osaka, Nhật Bản đã huấn luyện bổ sung cho dữ liệu của mình, liên kết các mô tả bằng văn bản với hàng nghìn bức ảnh mà các người tham gia nghiên cứu đã quét não tạo ra khi họ quan sát chúng.

Điều đặc biệt ở Stable Diffusion - cũng như các mô hình Trí tuệ nhân tạo ngôn ngữ lớn khác - là khả năng học tập nhanh chóng dù chỉ được huấn luyện trên một số lượng dữ liệu nhỏ. Điều này là một bước tiến lớn trong việc tiết kiệm thời gian và công sức cho quá trình huấn luyện AI. Nhà nghiên cứu Ariel Goldstein cho rằng đây cũng là một phương pháp mới để kết hợp thông tin văn bản và hình ảnh để 'giải mã' não.

Để thu thập mô tả văn bản của bộ não đối với hình ảnh mà con người nhìn thấy, thay vì sử dụng điện cực gắn vào não, các nhà nghiên cứu hiện nay sử dụng máy chụp cộng hưởng từ chức năng (fMRI) để quét và phát hiện các thay đổi trong lưu lượng máu đến các vùng hoạt động của não.

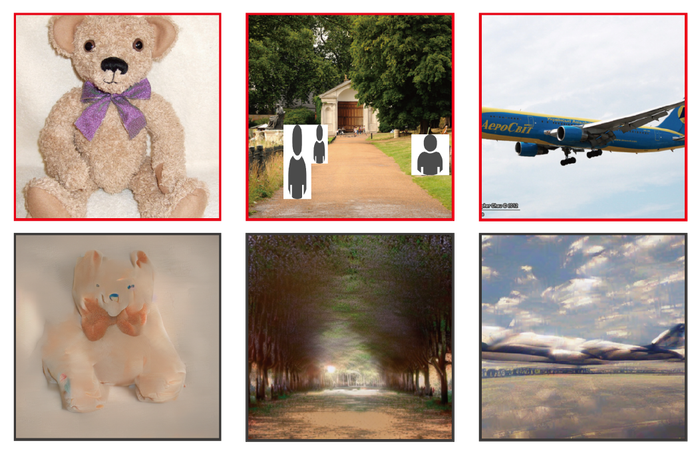

Thuật toán AI của Stable Diffusion có thể tái tạo hình ảnh con người nhìn thấy khi quét não. Ảnh Science

Khi xem một bức ảnh, thùy thái dương sẽ ghi lại thông tin về nội dung của bức ảnh (con người, vật thể hoặc phong cảnh), trong khi thùy chẩm ghi lại thông tin về cấu trúc và vị trí của nội dung. Các thông tin này được ghi lại bởi máy fMRI khi theo dõi hoạt động của não.

Từ thông tin mô tả văn bản này, thuật toán AI của Stable Diffusion có thể chuyển đổi thành một hình ảnh mô phỏng - tương tự như cách nó tạo ra hình ảnh từ gợi ý của người dùng. Trong nghiên cứu này, các nhà nghiên cứu sử dụng bộ dữ liệu trực tuyến từ Đại học Minnesota để huấn luyện Stable Diffusion. Bộ dữ liệu này bao gồm thông tin quét não của 4 người tham gia thí nghiệm, mỗi người quét 10.000 hình ảnh.

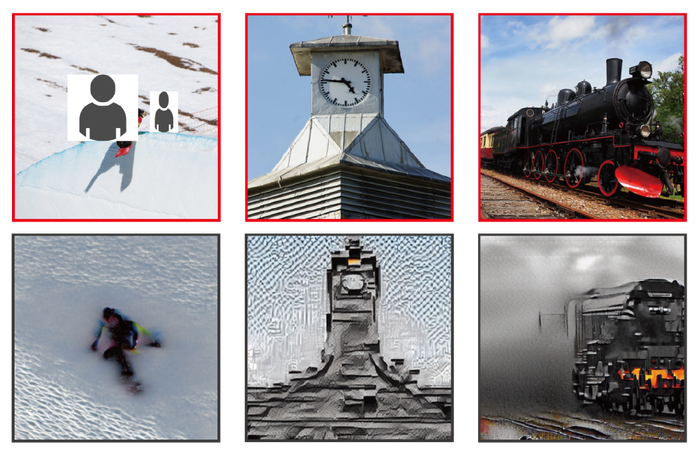

Ngay cả các nhà nghiên cứu cũng ngạc nhiên về hiệu quả thu được. Ảnh Science

Ban đầu, mỗi hình ảnh được tạo ra bởi trí tuệ nhân tạo đều chứa nhiễu và sau đó được điều chỉnh bằng các đường nét có thể phân biệt được, khi thuật toán của Stable Diffusion so sánh với các mô hình trong dữ liệu huấn luyện. Nhờ đó, hệ thống có thể tạo ra một hình ảnh mô tả gần đúng nội dung, cấu trúc và bối cảnh của hình ảnh mà người tham gia thí nghiệm đã nhìn thấy.

Tuy nhiên, các nhà nghiên cứu nhận thấy thuật toán gặp khó khăn trong việc nhận diện các đối tượng trong ảnh, ví dụ, không thể tái tạo được hình ảnh của tháp đồng hồ như trong bức ảnh, thay vào đó tạo ra các hình dáng trừu tượng hóa. Vấn đề này có thể được giải quyết bằng cách sử dụng các bộ dữ liệu huấn luyện lớn hơn, tuy nhiên, các nhà nghiên cứu Nhật Bản cho biết dữ liệu từ máy fMRI quá hạn chế so với yêu cầu này.

Thay vào đó, các nhà nghiên cứu giải quyết thách thức này bằng cách bổ sung thêm từ khóa trong phần chú thích của dữ liệu fMRI. Ví dụ, nếu trong một bức ảnh có chứa tháp đồng hồ, thông tin quét não sẽ được liên kết với đối tượng đó và sau đó dữ liệu này sẽ được nạp vào hệ thống huấn luyện của Stable Diffusion.

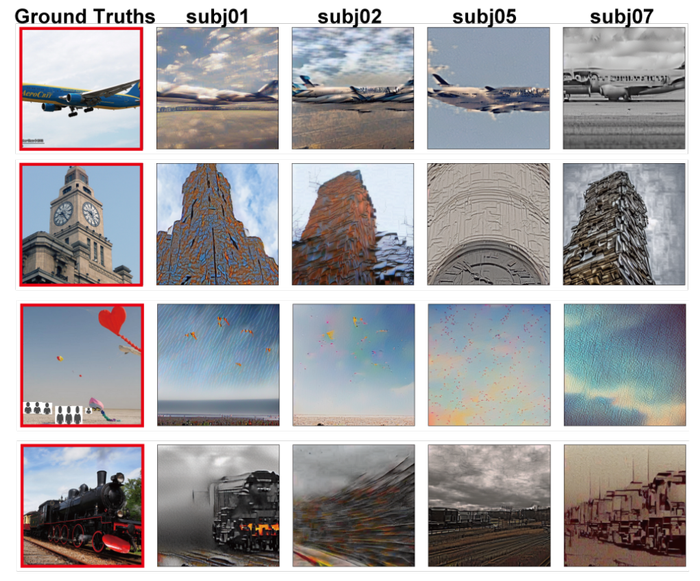

Độ chính xác của hình ảnh tái tạo được tăng dần sau mỗi lần điều chỉnh. Ảnh Science

Điều quan trọng là thuật toán của Stable Diffusion không tạo ra trực tiếp hình ảnh từ văn bản - nó chỉ nhận ra sự xuất hiện của đối tượng trong hình ảnh nếu mô hình hoạt động của não tương thích với mẫu trong dữ liệu huấn luyện. Do đó, thuật toán chỉ tái tạo lại các đối tượng xuất hiện trong những hình ảnh huấn luyện, thay vì các hình ảnh mới.

Để vượt qua thách thức này, những người tham gia thí nghiệm được quét não thêm khi xem các hình ảnh riêng lẻ về đồng hồ, gấu bông, máy bay và tàu hỏa. Bằng cách so sánh các dữ liệu quét riêng lẻ này với mẫu hình ảnh trong dữ liệu huấn luyện, thuật toán AI có thể tạo ra các hình ảnh chính xác hơn, thuyết phục hơn ngay cả khi gặp phải các hình ảnh mới. Kết quả từ phương pháp này thực sự ấn tượng.

Tuy nhiên, hiện tại hệ thống mới chỉ được thử nghiệm với dữ liệu quét não của 4 người tham gia thí nghiệm, do vậy, để nhận diện hình ảnh của mà những người khác nhìn thấy, hệ thống này cần phải được huấn luyện lại. Vì vậy sẽ phải mất thêm một thời gian nữa để hệ thống này có thể được áp dụng phổ biến.

Khi công nghệ này tiến bộ hơn, các nhà nghiên cứu hy vọng rằng nó có thể được áp dụng để khám phá cách các loài động vật nhìn nhận thế giới và có thể ghi lại giấc mơ của con người, cũng như hỗ trợ giao tiếp với những người bị liệt.

Tham khảo từ Science