Một vài năm trước, Joelle Pineau, giáo sư khoa học máy tính tại trường đại học McGill, đang giúp đỡ sinh viên của mình thiết kế một thuật toán mới khi họ rơi vào tình thế khó khăn. Phòng lab của cô nghiên cứu về học tăng cường, một loại trí tuệ nhân tạo được sử dụng, giữa những thứ khác, để giúp các nhân vật ảo (“nửa con báo” và “kiến” là phổ biến) tự dạy cách di chuyển trong thế giới ảo. Đó là điều kiện tiên quyết để xây dựng robot và ô tô tự động. Sinh viên của Pineau hy vọng cải thiện hệ thống của một phòng lab khác. Nhưng trước tiên, họ phải xây dựng lại nó, và thiết kế của họ, vì lý do không rõ, không đạt được kết quả như đã hứa. Cho đến khi sinh viên thử nghiệm một số "sửa đổi sáng tạo" mà không xuất hiện trong bài báo của phòng lab khác.

Hóa ra, hệ thống bắt đầu hoạt động như quảng cáo. Sự may mắn này là một triệu chứng của một xu hướng lo lắng, theo Pineau. Mạng nơ-ron, kỹ thuật đã đưa cho chúng ta các robot đánh cờ Go và máy tạo văn bản sáng tác thơ Trung Quốc cổ điển, thường được gọi là hộp đen vì những bí mật về cách chúng hoạt động. Đưa chúng hoạt động hiệu quả có thể giống như một nghệ thuật, bao gồm những điều chỉnh tinh tế mà không được báo cáo trong các xuất bản. Các mạng cũng ngày càng lớn hơn và phức tạp hơn, với các bộ dữ liệu lớn và mảng máy tính khổng lồ làm cho việc nhân bản và nghiên cứu những mô hình đó trở nên đắt đỏ, nếu không phải là không thể với những phòng lab chỉ có ngân sách tốt nhất.

“Điều đó có phải là nghiên cứu nữa không?” Anna Rogers, nghiên cứu máy học tại Đại học Massachusetts, hỏi. “Không rõ liệu bạn đang chứng minh sự ưu việt của mô hình hay ngân sách của bạn.”

Pineau đang nỗ lực thay đổi các tiêu chuẩn. Cô là chủ tịch tái tạo cho NeurIPS, một hội nghị trí tuệ nhân tạo hàng đầu. Dưới sự giám sát của cô, hội nghị bây giờ yêu cầu các nghiên cứu viên nộp một “danh sách kiểm tra tái tạo” bao gồm các mục thường được bỏ qua trong các bài báo, như số lượng mô hình được đào tạo trước khi chọn ra mô hình “tốt nhất”, công suất tính toán sử dụng và liên kết đến mã nguồn và tập dữ liệu. Điều này là một thay đổi đối với một lĩnh vực nơi uy tín dựa trên bảng xếp hạng—các xếp hạng xác định hệ thống của ai là “tối tân” cho một nhiệm vụ cụ thể—và mang lại động lực lớn để lướt qua những khó khăn dẫn đến những kết quả ngoạn mục đó.

Ý tưởng, Pineau nói, là khuyến khích các nghiên cứu viên cung cấp một lộ trình cho người khác sao chép công việc của họ. Điều này là một việc để kinh ngạc trước sự lưu loát của một trình tạo văn bản mới hay sự linh hoạt “siêu người” của một robot chơi trò chơi video. Nhưng ngay cả những nhà nghiên cứu tinh tế nhất cũng không hiểu rõ về cách chúng hoạt động. Việc sao chép những mô hình trí tuệ nhân tạo đó không chỉ quan trọng để xác định những lối đi nghiên cứu mới, mà còn là một cách để điều tra thuật toán khi chúng gia tăng, và đôi khi thay thế, quyết định của con người—từ việc ai ở lại tù và bao lâu đến ai được chấp thuận vay mượn.

Những người khác cũng đang giải quyết vấn đề này. Các nghiên cứu viên tại Google đã đề xuất những “thẻ mô hình” để chi tiết cách hệ thống máy học đã được kiểm tra, bao gồm kết quả chỉ ra tiềm ẩn độ chệch. Người khác đã cố gắng chỉ ra sự mong manh của thuật ngữ “tối tân” khi hệ thống, được tối ưu hóa cho các bộ dữ liệu được sử dụng trong bảng xếp hạng, được tung ra trong bối cảnh khác nhau. Tuần trước, các nghiên cứu viên tại Viện Trí tuệ Nhân tạo Allen, hoặc AI2, đã phát hành một bài báo nhằm mục tiêu mở rộng danh sách kiểm tra tái tạo của Pineau sang các phần khác của quá trình thử nghiệm. Họ gọi đó là “Hiển thị Công Việc của Bạn.”

“Bắt đầu từ nơi mà ai đó bỏ lại thật phiền phức vì chúng ta không bao giờ mô tả đầy đủ thiết lập thử nghiệm,” nói Jesse Dodge, một nhà nghiên cứu tại AI2, người đồng tác giả của nghiên cứu. “Mọi người không thể tái tạo điều chúng ta làm nếu chúng ta không nói về những gì chúng ta làm.” Điều bất ngờ, ông thêm, là khi người ta báo cáo ngay cả các chi tiết cơ bản về cách một hệ thống được xây dựng. Một cuộc khảo sát về các bài báo về học tăng cường năm ngoái chỉ thấy khoảng một nửa bài bao gồm mã nguồn.

Đôi khi, thông tin cơ bản bị thiếu vì nó là bí mật thương mại—vấn đề đặc biệt là đối với các phòng thí nghiệm công nghiệp. Nhưng nó thường là dấu hiệu của sự thất bại của lĩnh vực này trong việc theo kịp với các phương pháp thay đổi, Dodge nói. Mười năm trước, việc xem xét những thay đổi mà một nhà nghiên cứu thực hiện để cải thiện kết quả của họ là dễ dàng hơn. So với đó, các mạng nơ-ron là rất kén ăn; để có được kết quả tốt nhất thường liên quan đến việc điều chỉnh hàng ngàn cái nút nhỏ, điều Dodge gọi là một hình thức của “ma thuật đen.” Việc chọn ra mô hình tốt nhất thường đòi hỏi một số lượng lớn các thí nghiệm. Ma thuật trở nên đắt đỏ, nhanh chóng.

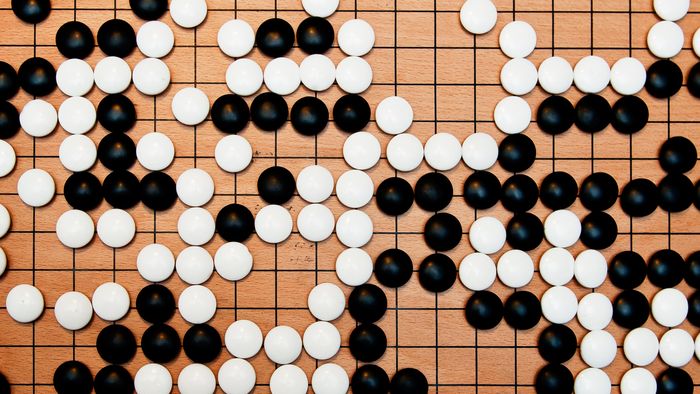

Ngay cả các phòng thí nghiệm công nghiệp lớn, có tài nguyên để thiết kế các hệ thống lớn nhất, phức tạp nhất, cũng đã đưa ra tín hiệu cảnh báo. Khi Facebook cố gắng sao chép AlphaGo, hệ thống được phát triển bởi DeepMind của Alphabet để thống trị trò chơi cổ đại Go, các nhà nghiên cứu dường như đã kiệt sức với nhiệm vụ. Yêu cầu tính toán rộng lớn—triệu thí nghiệm chạy trên hàng nghìn thiết bị trong nhiều ngày—kết hợp với mã nguồn không khả dụng, làm cho hệ thống “rất khó, nếu không thể, tái tạo, nghiên cứu, cải thiện và mở rộng,” họ viết trong một bài báo được xuất bản vào tháng 5. (Đội ngũ của Facebook cuối cùng đã thành công.)

Nghiên cứu của AI2 đề xuất một giải pháp cho vấn đề đó. Ý tưởng là cung cấp thêm dữ liệu về các thí nghiệm đã diễn ra. Bạn vẫn có thể báo cáo mô hình tốt nhất bạn đạt được sau, ví dụ, 100 thí nghiệm—kết quả có thể được xác nhận là “tối tân”—nhưng bạn cũng sẽ báo cáo phạm vi hiệu suất bạn sẽ mong đợi nếu bạn chỉ có ngân sách để thử nghiệm nó 10 lần, hoặc chỉ một lần.