Trực giác con người và lý luận của máy: Trí tuệ nhân tạo giúp chúng ta giải những câu đố toán học khổng lồ

Nghiên cứu trong toán học là một quá trình sáng tạo và trực giác sâu sắc. Điều này có thể làm bất ngờ đối với những người vẫn đang phục hồi từ đại số trung học.

Thế giới trông như thế nào ở quy mô cực nhỏ? Hình dạng của vũ trụ chúng ta sẽ như thế nào nếu chúng ta lớn như một dải ngân hà? Sống trong sáu hoặc thậm chí là 60 chiều sẽ như thế nào? Đây là những vấn đề mà các nhà toán học và nhà vật lý đang đối mặt hàng ngày.

Để tìm ra câu trả lời, các nhà toán học như tôi cố gắng tìm ra các mô hình liên quan đến các đối tượng toán học phức tạp bằng cách đưa ra giả thuyết (ý tưởng về cách những mô hình đó có thể hoạt động), được thăng cấp thành bài định nếu chúng ta có thể chứng minh chúng đúng. Quá trình này phụ thuộc vào trực giác của chúng ta cũng như kiến thức của chúng ta.

Trong những năm gần đây, tôi đã làm việc với các chuyên gia tại công ty trí tuệ nhân tạo (AI) DeepMind để tìm hiểu xem chương trình của họ có thể hỗ trợ các khía cạnh sáng tạo hoặc trực giác trong nghiên cứu toán học hay không. Trong một bài báo mới được xuất bản trên Nature, chúng tôi cho thấy rằng có thể: các kỹ thuật mới nhất trong lĩnh vực AI đã đóng vai trò quan trọng trong việc phát hiện ra một giả thuyết và một bài định mới trong hai lĩnh vực được gọi là “lý thuyết nút” và “lý thuyết biểu diễn”.

Trực giác của máy

Ban đầu, đầu ra của mạng là không hữu ích. Nhưng theo thời gian (từ vài giờ đến thậm chí vài tuần hoặc tháng), mạng được đào tạo, đơn giản là bằng cách điều chỉnh tần suất phát bắn của các tế bào thần kinh.

Những ý tưởng như vậy đã được thử nghiệm vào những năm 1970 với kết quả không thuyết phục. Xung quanh năm 2010, tuy nhiên, một cuộc cách mạng đã xảy ra khi các nhà nghiên cứu tăng đột ngột số lượng tế bào thần kinh trong mô hình (từ hàng trăm trong những năm 1970 lên đến hàng tỷ ngày nay).

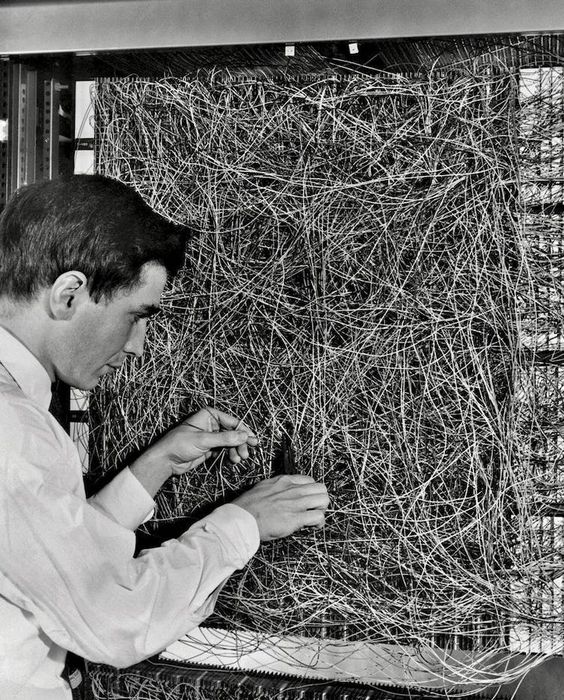

One of the first neural networks, the Mark I Perceptron, was built in the 1950s. The goal was to classify digital images, but results were disappointing. Image via Cornell University<img loading="lazy" src="https://images.theconversation.com/files/434870/original/file-20211130-17-1ydvy5w.jpg?ixlib=rb-1.1.0&q=45&auto=format&w=754&fit=clip" alt="One of the first neural networks, the Mark I Perceptron, was built in the 1950s. The goal was to classify digital images, but results were disappointing. Image via Cornell University" width="754" height="936" class="" srcset="">

One of the first neural networks, the Mark I Perceptron, was built in the 1950s. The goal was to classify digital images, but results were disappointing. Image via Cornell University<img loading="lazy" src="https://images.theconversation.com/files/434870/original/file-20211130-17-1ydvy5w.jpg?ixlib=rb-1.1.0&q=45&auto=format&w=754&fit=clip" alt="One of the first neural networks, the Mark I Perceptron, was built in the 1950s. The goal was to classify digital images, but results were disappointing. Image via Cornell University" width="754" height="936" class="" srcset="">Chương trình máy tính truyền thống gặp khó khăn với nhiều nhiệm vụ mà con người thấy dễ dàng, chẳng hạn như xử lý ngôn ngữ tự nhiên (đọc và diễn giải văn bản) và nhận dạng giọng nói cũng như hình ảnh.

Với cách mạng học sâu của thập kỷ 2010, máy tính bắt đầu thực hiện tốt những nhiệm vụ này. Trí tuệ nhân tạo bản chất đã mang thị giác và giọng nói đến cho máy móc.

Đào tạo mạng thần kinh đòi hỏi lượng lớn dữ liệu. Hơn nữa, các mô hình học sâu được đào tạo thường hoạt động như “hộp đen”. Chúng ta biết chúng thường cho câu trả lời đúng, nhưng thường không biết (và không thể xác nhận) tại sao.

Một cuộc gặp may mắn

Sự liên quan của tôi với Trí tuệ Nhân tạo bắt đầu từ năm 2018, khi tôi được bầu làm Hội viên của Hội Hoàng gia. Tại buổi lễ nhậm chức ở London, tôi gặp Demis Hassabis, giám đốc điều hành của DeepMind.

Trong khoảnh khắc nghỉ giải lao, chúng tôi thảo luận về học sâu và các ứng dụng có thể trong toán học. Liệu học máy có thể dẫn đến những khám phá trong toán học, giống như trong Go không?

Cuộc trò chuyện may mắn này dẫn đến sự hợp tác của tôi với đội ngũ tại DeepMind.

Các nhà toán học như tôi thường sử dụng máy tính để kiểm tra hoặc thực hiện tính toán dài. Tuy nhiên, máy tính thường không thể giúp tôi phát triển trực giác hoặc đề xuất một hướng tiếp cận có thể. Vì vậy, chúng tôi tự đặt câu hỏi: liệu học sâu có thể giúp nhà toán học xây dựng trực giác không?

Với đội ngũ từ DeepMind, chúng tôi huấn luyện mô hình để dự đoán một số lượng cụ thể gọi là đa thức Kazhdan-Lusztig, mà tôi đã dành phần lớn cuộc đời toán học của mình để nghiên cứu.

Trong lĩnh vực của tôi, chúng tôi nghiên cứu đại diện, mà bạn có thể tưởng tượng như là phân tử trong hóa học. Đúng như cách phân tử được tạo thành từ nguyên tử, cấu trúc của đại diện được quy định bởi đa thức Kazhdan-Lusztig.

Đáng kinh ngạc, máy tính đã có khả năng dự đoán những đa thức Kazhdan-Lusztig này với độ chính xác không tưởng. Mô hình dường như đã phát hiện ra điều gì đó, nhưng chúng tôi không thể nói rõ điều gì.

Tuy nhiên, bằng cách "nhìn vào bên trong" của mô hình, chúng tôi đã tìm thấy một gợi ý dẫn chúng tôi đến một giả định mới: rằng đa thức Kazhdan-Lusztig có thể được rút gọn từ một đối tượng đơn giản hơn nhiều (một đồ thị toán học).

Giả định này gợi ý một hướng tiến triển cho một vấn đề đã làm cho những nhà toán học bí đỏ hơn 40 năm. Điều đáng chú ý, đối với tôi, mô hình đã mang lại trực giác!

Trong công việc song song với DeepMind, các nhà toán học Andras Juhasz và Marc Lackenby tại Đại học Oxford đã sử dụng các kỹ thuật tương tự để khám phá một định lý mới trong lĩnh vực toán học về lý thuyết nút. Định lý này thiết lập một mối quan hệ giữa các đặc điểm (hoặc "bất biến") của các nút xuất phát từ các lĩnh vực khác nhau của vũ trụ toán học.

Bài báo của chúng tôi nhắc nhở rằng trí tuệ không phải là một biến duy nhất, giống như kết quả của một bài kiểm tra IQ. Trí tuệ nên được coi là có nhiều chiều.

Bài viết này của Geordie Williamson, Giáo sư Toán học, Đại học Sydney, được tái xuất bản từ The Conversation dưới giấy phép Creative Commons. Đọc bài viết gốc.