Nghiên cứu của Apple đặt ra một câu hỏi quan trọng về tương lai của AI: Liệu chúng ta có đang quá lạc quan với khả năng hiện tại của các hệ thống AI mà bỏ qua những hạn chế rõ ràng của chúng?

Trong một động thái có thể làm xôn xao ngành công nghệ, Apple vừa công bố nghiên cứu táo bạo mang tên "Ảo tưởng về Tư duy" – một cuộc chỉ trích mạnh mẽ vào niềm tin rằng các mô hình AI hiện tại đã có khả năng suy luận thực sự.

Nghiên cứu này không chỉ đặt ra câu hỏi về khả năng của những siêu phẩm AI như GPT-o1, Claude Thinking hay DeepSeek-R1, mà còn chỉ ra rằng giấc mơ về trí tuệ nhân tạo tổng quát (AGI) còn xa hơn rất nhiều so với những gì chúng ta tưởng.

Việc Apple công bố nghiên cứu này không phải là sự trùng hợp. Chỉ vài ngày trước Hội nghị Nhà phát triển Toàn cầu (WWDC) ngày 9 tháng 6, khi kỳ vọng về tiến bộ AI của Apple đang ở mức thấp, công ty đã chọn cách "tạt gậy nước lạnh" vào làn sóng phấn khích quanh khả năng suy luận của AI. Điều đáng chú ý là Apple - công ty đang gặp khó khăn với Apple Intelligence và Siri 2.0 - lại là người thách thức các tuyên bố về siêu năng lực của các đối thủ.

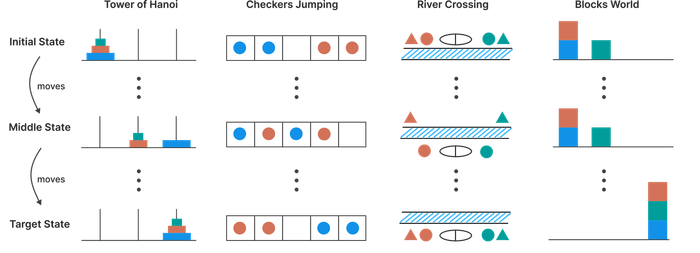

Để chứng minh quan điểm của mình, các nhà nghiên cứu Apple đã từ bỏ phương pháp đánh giá truyền thống và thay vào đó tạo ra một phương pháp hoàn toàn mới. Họ không sử dụng các bài kiểm tra toán học tiêu chuẩn, vốn dễ bị ảnh hưởng bởi dữ liệu mà AI học được từ internet, mà thay vào đó thiết kế những "môi trường giải đố có thể kiểm soát". Những trò chơi logic như Tháp Hà Nội, Checkers Jumping, River Crossing và Blocks World cho phép điều chỉnh độ khó mà không làm thay đổi cấu trúc logic cốt lõi.

Cách tiếp cận này cho phép Apple không chỉ đánh giá kết quả cuối cùng mà còn "theo dõi" quá trình suy nghĩ của AI, giống như việc quan sát từng bước giải bài toán của một học sinh. Và kết quả thu được thật sự gây ngạc nhiên.

Các cột hiển thị tiến trình từ trạng thái ban đầu (trên cùng) qua trạng thái trung gian (giữa) đến trạng thái mục tiêu (dưới cùng) cho các câu đố: Tower of Hanoi (chuyển đĩa qua các chốt), Checkers Jumping (hoán đổi vị trí các quân cờ màu), River Crossing (vận chuyển các thực thể qua sông) và Blocks World (cấu hình lại ngăn xếp).

Kết quả nghiên cứu cho thấy các mô hình AI suy luận hoạt động theo ba "chế độ" khác biệt tùy vào độ khó của bài toán. Đối với những vấn đề đơn giản, một điều bất ngờ xảy ra: các mô hình AI thông thường không có cơ chế suy luận phức tạp lại hoạt động hiệu quả và chính xác hơn những "siêu mô hình" đã được trang bị khả năng suy luận. Điều này giống như việc một học sinh bình thường giải bài toán cộng trừ nhanh hơn một thiên tài đang cố gắng áp dụng công thức phức tạp không cần thiết.

Khi đối mặt với những bài toán có độ khó trung bình, các mô hình suy luận mới bắt đầu phát huy tác dụng. Khả năng tạo ra các chuỗi suy nghĩ dài giúp chúng giải quyết những vấn đề mà các mô hình thông thường không thể làm được. Đây có thể coi là "vùng ngọt ngào" duy nhất mà các mô hình suy luận thực sự vượt trội.

Tuy nhiên, khi gặp phải những bài toán thực sự khó, cả hai loại mô hình đều bị thất bại hoàn toàn. Độ chính xác của chúng gần như bằng không, và dù các mô hình suy luận có thể "cầm cự" lâu hơn, cuối cùng chúng cũng sẽ gặp phải những giới hạn cơ bản tương tự. Điều này giống như việc cả học sinh giỏi lẫn học sinh bình thường đều không thể giải được bài toán đại học nếu chỉ có kiến thức cấp ba.

Nghiên cứu của Apple được thực hiện trên các mô hình AI suy luận của , Claude, DeepSeek và Gemini

Một phát hiện gây sốc hơn nữa là hành vi "phản trực giác" của các mô hình suy luận khi đối mặt với thách thức ngày càng khó. Ban đầu, khi bài toán trở nên khó hơn, chúng sẽ "suy nghĩ" nhiều hơn, tạo ra những chuỗi lý luận dài hơn. Tuy nhiên, khi gần đến điểm sụp đổ, thay vì nỗ lực hết mình, các mô hình này lại trở nên "lười biếng", giảm bớt sự nỗ lực suy luận dù còn rất nhiều tài nguyên tính toán.

Điều này cho thấy chúng có khả năng "nhận ra" khi nào mình không thể giải quyết được và quyết định "từ bỏ" – một hành vi hoàn toàn khác biệt so với con người, khi mà chúng ta vẫn luôn cố gắng đến cùng khi gặp khó khăn.

Một thí nghiệm đáng chú ý khác cho thấy rõ ràng những hạn chế của các mô hình suy luận. Dù các nhà nghiên cứu đã cung cấp cho AI một thuật toán giải quyết vấn đề một cách chi tiết và rõ ràng, hiệu suất của chúng vẫn không được cải thiện. Sự sụp đổ vẫn xảy ra ở những điểm giống như trước. Điều này cho thấy các mô hình AI không thực sự "hiểu" logic hay có khả năng tuân theo các bước suy luận một cách nhất quán mà chỉ đơn giản dựa vào việc nhận diện các mẫu đã học.

Sự bất nhất trong hiệu suất của AI cũng là một minh chứng mạnh mẽ khác. Ví dụ, mô hình Claude 3.7 Sonnet có thể thực hiện chính xác hơn 100 nước đi trong trò chơi Tháp Hà Nội phức tạp, nhưng lại thất bại ngay sau 4 nước đi trong một trò chơi River Crossing đơn giản hơn rất nhiều. Điều này cho thấy hiệu suất của chúng phụ thuộc vào việc đã "nhìn thấy" các mẫu tương tự trong quá trình huấn luyện, thay vì khả năng suy luận tổng quát.

Độ "dễ vỡ" của các mô hình này còn được thể hiện qua việc chỉ cần thêm một câu không liên quan vào câu hỏi cũng có thể làm giảm hiệu suất đến 65%. Điều này khẳng định rằng chúng hoạt động dựa trên việc nhận dạng mẫu chứ không phải logic thực sự, và những mẫu này có thể dễ dàng bị "nhiễu loạn" bởi những thông tin không cần thiết.

Quan trọng nhất, nghiên cứu của Apple không tìm thấy bất kỳ bằng chứng nào cho thấy các mô hình này thực hiện suy luận logic hay symbolic thực sự. Thay vào đó, chúng hoạt động giống như những "máy ghi âm xác suất", dự đoán từ tiếp theo dựa trên các mẫu đã thấy trong quá trình huấn luyện, thay vì "suy ra" câu trả lời từ các nguyên tắc cơ bản. Những chuỗi suy nghĩ dài mà chúng tạo ra có thể trông rất "có vẻ thông minh", nhưng thực tế lại không có quá trình giải quyết vấn đề logic thực sự.

Cuối cùng, nghiên cứu của Apple đặt ra một câu hỏi lớn về tương lai của AI: Liệu chúng ta có đang quá "phấn khích" về những khả năng hiện tại của các hệ thống này? Và liệu con đường đến AGI có thực sự còn xa vời hơn nhiều so với những dự đoán lạc quan hiện tại? Với những phát hiện này, có lẽ thay vì mơ mộng về một tương lai AI toàn năng sắp đến, chúng ta cần quay về với thực tế và hiểu rõ hơn về những gì các hệ thống AI hiện tại thực sự có thể và không thể làm được.

(Tổng hợp)