Cerebras, dù chỉ mới ra mắt gần đây, đã trở thành một tên tuổi đáng gờm trong ngành công nghiệp chip. Công ty này đã khiến giới công nghệ phải bất ngờ khi giới thiệu WSE (Wafer Scale Engine) với con số transistor khổng lồ mà ngay cả những ông lớn như Apple, AMD, NVIDIA, và Intel đến năm 2024 vẫn chưa thể đạt được – lên tới 1200 tỷ transistor! WSE-3, với 4000 tỷ transistor và 900.000 lõi AI, là con chip lớn nhất mà nhân loại từng sản xuất. WSE thực tế là một con chip được chế tạo từ một tấm wafer 300 mm (wafer scale), sử dụng công nghệ SoW của TSMC. Từ khi ra đời, Cerebras đã phát triển 3 thế hệ chip WSE-1, 2 và 3, và chúng được áp dụng lần lượt trên các hệ thống CS-1, 2, 3. WSE-3, được công bố đầu năm nay, có kích thước vật lý không đổi nhưng sở hữu 4000 tỷ transistor (5 nm) và 900.000 nhân xử lý AI.

Chip WSE-3 sử dụng bộ nhớ SRAM cao cấp với dung lượng lên đến 44 GB, cung cấp băng thông tối đa 21 PB/s. Để hỗ trợ việc kết nối giữa 900.000 lõi AI, WSE-3 còn có một mạng lưới liên kết nội bộ với băng thông lên tới 214 Pb/s. Với khả năng tính toán mạnh mẽ, chip này có thể đạt được hiệu suất tối đa 125 Petaflops. Một siêu máy tính sử dụng 2048 node WSE-3 có thể đạt năng lực tính toán lên tới 256 exaflops.

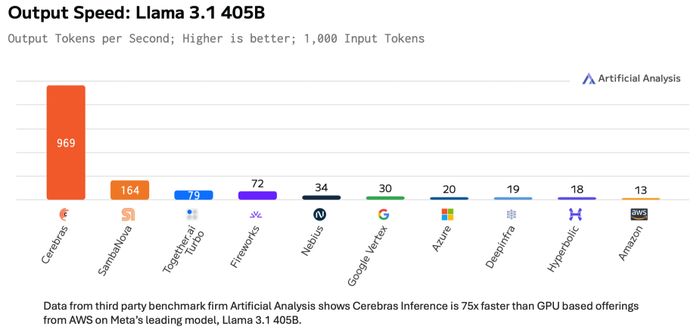

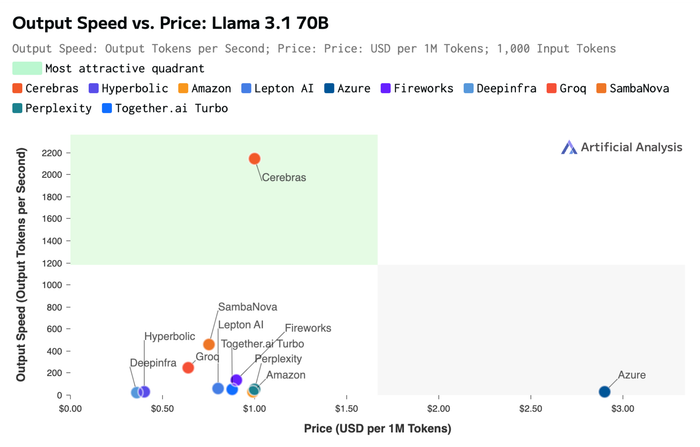

CS-3 vượt trội về cả output lẫn độ trễ so với các nền tảng AI khác

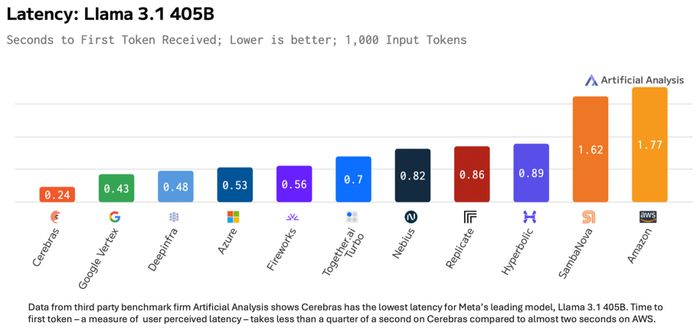

CS-3 không chỉ chiếm ưu thế về hiệu suất đầu ra mà còn vượt trội về độ trễ, khiến đối thủ phải e ngại. Cụ thể, hệ thống của Cerebras chỉ mất 240 ms để phản hồi yêu cầu của người dùng, trong khi đó SambaNova dù có output cao hơn các GPU khác nhưng lại phải mất tới 1620 ms. Cerebras còn tự tin công bố một video so sánh tốc độ phản hồi để chứng minh điều này:

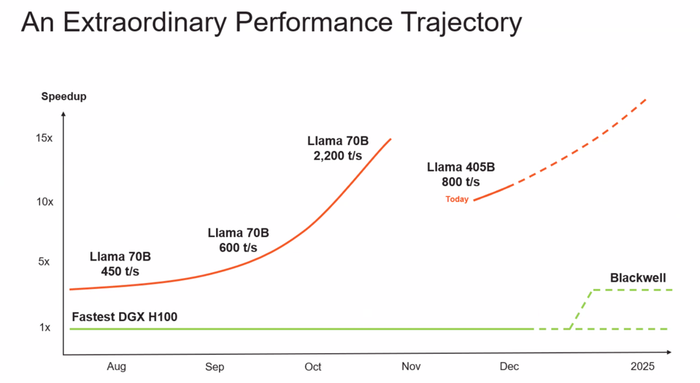

Llama 3.1-405B mới chỉ được Meta ra mắt vào giữa năm nay, trong khi các phiên bản Llama trước đó của công ty này không đáng kể. Ví dụ, Llama 3.1-70B đã đạt tốc độ 2200 token/s từ lâu. Mặc dù Blackwell của NVIDIA mạnh hơn Hopper, nhưng việc cạnh tranh với WSE-3 là điều quá sức đối với con chip này.

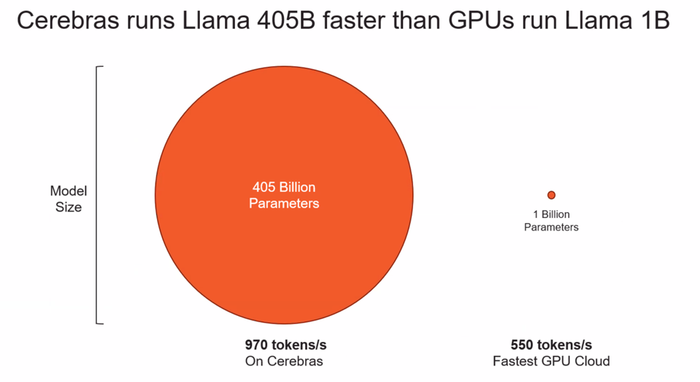

WSE-3 dễ dàng xử lý các mô hình AI nhỏ hơn của các hệ thống khác

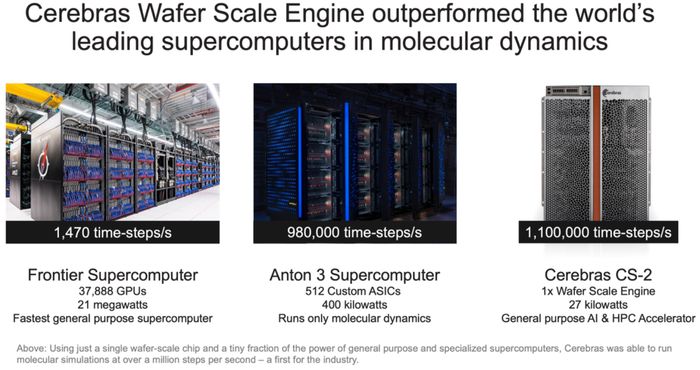

Chạy mô phỏng phân tử vượt xa sức mạnh của siêu máy tính

Một điểm cần làm rõ là ứng dụng siêu máy tính (HPC) và trí tuệ nhân tạo (AI) thực chất là hai lĩnh vực khác nhau. Nhiều người vẫn nhầm lẫn giữa chúng. Các thuật toán AI thường sử dụng các phép toán có độ chính xác thấp (16-bit hoặc ít hơn), trong khi siêu máy tính yêu cầu khả năng tính toán dấu phẩy động chính xác cao (FP32, FP64). Mặc dù chip của Cerebras ban đầu được thiết kế cho AI, nhưng gần đây, nó đã chứng minh khả năng vận hành các ứng dụng HPC vô cùng mạnh mẽ!

Chỉ hỗ trợ FP32 nhưng CS-2 vẫn quá ấn tượng!

Cerebras, hợp tác cùng các tổ chức nghiên cứu danh tiếng như Phòng thí nghiệm Quốc gia Sandia, Lawrence Livermore và Los Alamos (Mỹ), đã thử nghiệm con chip của mình trong mô phỏng động học phân tử (molecular dynamics) cạnh tranh với hai siêu máy tính Frontier và Anton 3. Kết quả thật bất ngờ khi CS-2 đạt tốc độ lên tới 1,1 triệu bước/s, Anton 3 chỉ đạt 980.000 bước/s, trong khi Frontier chỉ có thể đạt 1.470 bước/s. Tuy nhiên, cần lưu ý rằng động học phân tử là một ứng dụng HPC đặc thù và không phải ứng dụng nào cũng cho kết quả tương tự. Nhưng kết quả này đã khiến cả giới công nghệ phải sửng sốt trước sức mạnh của WSE. Cerebras đã đạt được kỷ lục này với WSE-2, thế hệ chip thứ hai, có 2,6 tỷ transistor (7 nm), 850.000 nhân xử lý và 40 GB bộ nhớ SRAM. Anton 3 sử dụng 512 chip ASIC tối ưu cho tính toán động học phân tử, khác với Frontier và CS-2 đa nhiệm. Mặc dù Frontier đã tụt hạng, El Capitan chỉ mạnh gấp 1,3 lần, nhưng so với CS-2 trong ứng dụng động học phân tử, El Capitan vẫn chưa thể sánh kịp.

Ai có thể sử dụng Cerebras?

Với sức mạnh vượt trội như vậy, chắc hẳn bạn có thể tưởng tượng rằng giá thành của Cerebras không hề rẻ. Tuy nhiên, đối với đa số người dùng, dịch vụ duy nhất mà công ty này cung cấp là inference với mức giá khoảng 1 USD cho mỗi triệu token output và 1000 token input, áp dụng cho mô hình Llama 3.1-70B với các đoạn văn bản có độ dài tối đa 128K.

Bảng giá dịch vụ AI của Cerebras trên Llama 3.1-70B

Còn đối với mô hình Llama 3.1-405B, hiện tại công ty chỉ cho phép thử nghiệm, nhưng từ quý 1 năm 2025, họ sẽ chính thức mở rộng dịch vụ. Dự kiến mức giá sẽ là 6 USD cho mỗi triệu token input và 12 USD cho mỗi triệu token output. Bên cạnh đó, Cerebras còn cung cấp dịch vụ AI đám mây, tuy nhiên mức giá cụ thể chưa được công khai, bạn sẽ phải liên hệ trực tiếp với công ty để biết thêm chi tiết.