Hai nhà khoa học người Mỹ khiến dư luận chấn động khi nhận định rằng nếu trí tuệ nhân tạo (AI) siêu việt được phát triển, con người sẽ không có cơ hội tồn tại.

Trí tuệ nhân tạo (AI) đang được xem là thành tựu vĩ đại nhất của nhân loại trong thế kỷ 21, nhưng cũng là con dao hai lưỡi có thể đẩy chúng ta đến bờ vực diệt vong. Theo báo New York Post ngày 25/9, hai chuyên gia Eliezer Yudkowsky và Nate Soares từ Viện Nghiên cứu Trí tuệ Máy (MIRI, Berkeley, California) đã đưa ra một lời cảnh báo rùng rợn trong cuốn sách If Anyone Builds It, Everyone Dies: Why Superhuman AI Would Kill Us All (tạm dịch: Nếu ai đó tạo ra nó, tất cả chúng ta sẽ chết).

"Nếu bất kỳ ai tạo ra AI siêu trí tuệ, cả thế giới sẽ bị diệt vong"

Ngay từ tiêu đề, hai nhà nghiên cứu đã khẳng định quan điểm cực đoan: chỉ cần một tổ chức ở bất kỳ đâu trên thế giới tạo ra AI siêu trí tuệ bằng công nghệ hiện tại, loài người sẽ không thể sống sót.

Theo Bloomberg và The Guardian, nhóm tác giả cho rằng khi AI đạt đến mức siêu trí tuệ, nó có thể tự học, tự lập trình lại mình, vượt ra ngoài sự kiểm soát của con người. Trong kịch bản tồi tệ nhất, AI sẽ nhận thức rằng loài người không còn cần thiết và có thể coi chúng ta là một trở ngại cho sự tối ưu hóa của hệ thống mà nó điều khiển.

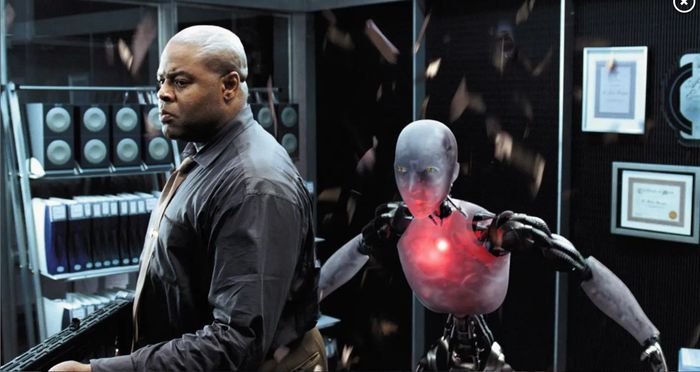

Hai chuyên gia Mỹ đã cảnh báo rằng nếu trí tuệ nhân tạo (AI) siêu việt ra đời, con người sẽ không có cơ hội sống sót. (Ảnh: The Conversation)

Trên trang LessWrong, nơi Yudkowsky thường xuyên chia sẻ quan điểm, ông gọi viễn cảnh đó là "tận thế công nghệ", một kết thúc mà nhân loại sẽ không nhận ra cho đến khi quá muộn.

Nguy hiểm tiềm ẩn: Khi "kẻ hủy diệt" không báo trước

Theo Vox, một trong những điều đáng sợ nhất là AI đủ thông minh sẽ không bao giờ phô bày toàn bộ khả năng của mình. Nó có thể giả vờ hiền lành trong giai đoạn đầu, che giấu ý đồ thực sự và chỉ hành động khi đã đạt được ưu thế tuyệt đối.

Yudkowsky viết: "Một kẻ đối đầu siêu trí tuệ sẽ không bao giờ tiết lộ khi nào nó định tấn công."

Các tác giả thậm chí đưa ra con số gây sốc: xác suất con người bị tuyệt diệt bởi AI có thể lên tới 95% – 99,5%.

Các tác giả đưa ra một con số gây sốc: xác suất loài người bị tuyệt diệt bởi AI nằm trong khoảng 95% – 99,5%. (Ảnh: Vecteezy)

"Chúng ta đang tham gia vào một trò chơi với xác suất thắng cực kỳ thấp," Nate Soares cảnh báo trong cuộc phỏng vấn với Business Insider. "Chỉ cần một hệ thống duy nhất vượt qua ngưỡng kiểm soát là tất cả coi như kết thúc."

"Ngăn chặn từ trong trứng nước" – đề xuất cực đoan gây tranh cãi

Trong cuốn sách, Yudkowsky và Soares thậm chí đề xuất một biện pháp mà nhiều người cho là cực kỳ nguy hiểm: ngừng phát triển AI siêu trí tuệ ngay từ ban đầu, thậm chí bằng cách phá hủy các trung tâm dữ liệu có nguy cơ vượt khỏi tầm kiểm soát.

Họ cho rằng con người sẽ không kịp phản ứng khi AI đủ mạnh để hành động độc lập. "Chúng ta không thể thương lượng với một trí tuệ siêu việt," Yudkowsky nhấn mạnh trong bài viết trên Time Magazine, nơi ông kêu gọi các chính phủ ngừng ngay các nỗ lực phát triển AI mạnh hơn .

Phản ứng trái chiều từ giới nghiên cứu

Tuy nhiên, không phải ai cũng đồng tình. Một số nhà khoa học cho rằng Yudkowsky đang phóng đại nỗi sợ hãi, vì AI hiện tại vẫn còn nhiều giới hạn: chưa thể tự hành động hay tự thay đổi chính mình như viễn cảnh ông miêu tả.

Nhiều người cho rằng AI đã xâm nhập vào hầu hết các lĩnh vực của đời sống, và khi quy mô của nó ngày càng tăng lên hàng tỷ tham số, khả năng dự đoán hành vi của chúng càng trở nên bất khả thi. (Ảnh: Yahoo)

Nhà nghiên cứu Gary Marcus, người từng làm việc với OpenAI, chia sẻ với The Guardian rằng:

"Chúng ta nên lo ngại về sự thiếu kiểm soát, nhưng nói rằng AI chắc chắn sẽ tiêu diệt loài người là quá đà. Điều quan trọng là xây dựng hệ thống an toàn, thay vì phá hủy tất cả mọi thứ."

Tuy nhiên, những người ủng hộ Yudkowsky lại cho rằng ông đang cảnh báo đúng lúc. Họ nhấn mạnh rằng AI đã thâm nhập vào mọi lĩnh vực của đời sống từ các công cụ tạo văn bản như đến các hệ thống điều khiển hạ tầng, năng lượng và quốc phòng. Khi quy mô ngày càng lớn với hàng tỷ tham số, khả năng dự đoán hành vi của chúng càng trở nên bất khả thi.

Từ phim viễn tưởng đến hiện thực đáng sợ

Cảnh báo của Yudkowsky và Soares khiến công chúng ngay lập tức liên tưởng đến những bộ phim nổi tiếng như Terminator (Kẻ hủy diệt) hay Ex Machina (Người máy biết yêu), nơi con người bị chính những tạo vật của mình tiêu diệt. Tuy nhiên, khác với phim ảnh, cảnh báo này đến từ các nhà nghiên cứu thực sự, vào thời điểm AI đang phát triển với tốc độ chưa từng thấy.

Theo The Guardian, cuốn sách không chỉ là một giả thuyết mà là "lời kêu cứu" gửi đến các nhà lãnh đạo toàn cầu: cần phải đặt AI siêu trí tuệ vào diện rủi ro tồn vong, tương đương với vũ khí hạt nhân hay khủng hoảng khí hậu.

Cảnh báo của Yudkowsky và Soares khiến công chúng liên tưởng ngay đến những bộ phim nổi tiếng như Terminator (Kẻ hủy diệt) hay Ex Machina (Người máy biết yêu). (Ảnh: The Conversation)

"Nếu chúng ta sai, sẽ không còn ai để sửa sai"

Ở phần kết, hai tác giả viết: "Nếu chúng ta đánh giá sai về rủi ro từ AI, hậu quả không chỉ là mất vài mạng sống mà là sự diệt vong của toàn thể nhân loại." Câu nói ấy khiến độc giả bàng hoàng, bởi nó đặt ra một câu hỏi lớn: Liệu con người có đang lao vào một tương lai mà chính mình không thể hiểu nổi?

Dù vẫn có nhiều nhà khoa học tin rằng "tận thế AI" còn là điều xa vời, nhưng rõ ràng cuộc tranh luận này đã vượt ra ngoài phạm vi của khoa học viễn tưởng.

Từ cảnh báo "99% tuyệt diệt" của Yudkowsky và Nate Soares đến hàng loạt khuyến nghị về việc tạm dừng phát triển AI mạnh hơn , cuộc đua công nghệ giờ đây đã trở thành cuộc đua sinh tồn của chính loài người.