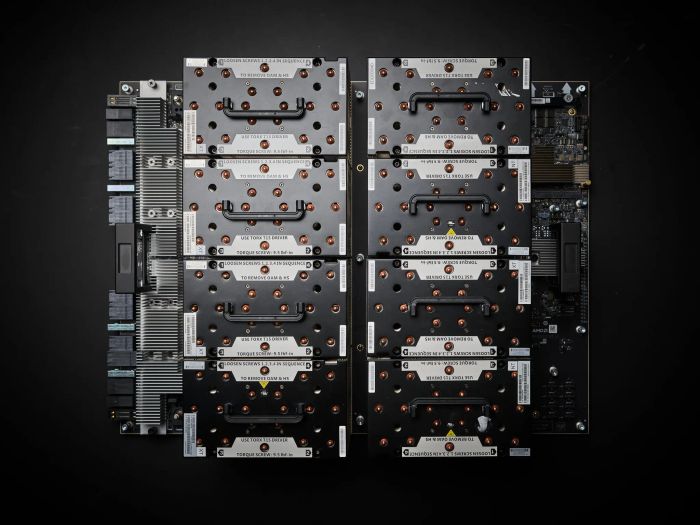

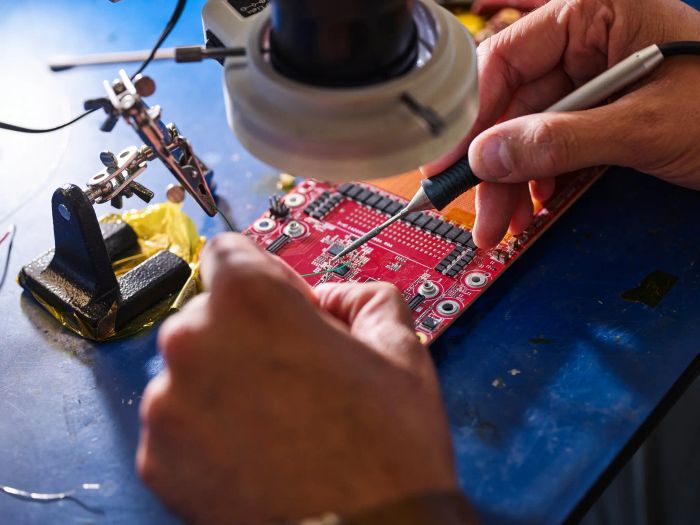

Tại khu vực phía nam hạt Austin, Texas, các kỹ sư của AMD đã phát triển chip tăng tốc xử lý AI mang tên MI300, ra mắt cách đây khoảng một năm. Những chip thuộc dòng MI300 dự kiến sẽ mang về cho AMD doanh thu hơn 5 tỷ USD chỉ trong năm đầu tiên. Không xa trung tâm nghiên cứu của AMD, một phòng thí nghiệm thuộc Amazon cũng đang phát triển thế hệ chip AI tiếp theo, được gọi là Trainium. Những kỹ sư tại đây đã gắn những con chip này vào các bo mạch cỡ nhỏ, lắp vào các hệ thống máy chủ to như hai tủ lạnh để kiểm tra hiệu năng.

Tại khu vực phía nam hạt Austin, Texas, các kỹ sư của AMD đã phát triển chip tăng tốc xử lý AI mang tên MI300, ra mắt cách đây khoảng một năm. Những chip thuộc dòng MI300 dự kiến sẽ mang về cho AMD doanh thu hơn 5 tỷ USD chỉ trong năm đầu tiên. Không xa trung tâm nghiên cứu của AMD, một phòng thí nghiệm thuộc Amazon cũng đang phát triển thế hệ chip AI tiếp theo, được gọi là Trainium. Những kỹ sư tại đây đã gắn những con chip này vào các bo mạch cỡ nhỏ, lắp vào các hệ thống máy chủ to như hai tủ lạnh để kiểm tra hiệu năng. Hai ví dụ trên, diễn ra tại thủ phủ bang Texas, minh họa rõ ràng sự thay đổi mạnh mẽ trong ngành chip AI. Hiện tại, đây là lĩnh vực công nghệ thu hút sự chú ý lớn nhất. Nvidia đã thống trị thị trường này trong một thời gian dài nhờ những bộ xử lý AI cho máy chủ đám mây, giúp công ty trở thành gã khổng lồ với giá trị vốn hóa lên tới 3 nghìn tỷ USD. Mặc dù các đối thủ khác đã nỗ lực theo kịp Nvidia trong việc phát triển chip xử lý cho các mô hình AI hàng nghìn tỷ tham số, nhưng chưa có ai đạt được thành công thực sự.

Hai ví dụ trên, diễn ra tại thủ phủ bang Texas, minh họa rõ ràng sự thay đổi mạnh mẽ trong ngành chip AI. Hiện tại, đây là lĩnh vực công nghệ thu hút sự chú ý lớn nhất. Nvidia đã thống trị thị trường này trong một thời gian dài nhờ những bộ xử lý AI cho máy chủ đám mây, giúp công ty trở thành gã khổng lồ với giá trị vốn hóa lên tới 3 nghìn tỷ USD. Mặc dù các đối thủ khác đã nỗ lực theo kịp Nvidia trong việc phát triển chip xử lý cho các mô hình AI hàng nghìn tỷ tham số, nhưng chưa có ai đạt được thành công thực sự. Các sản phẩm chip đối kháng với Nvidia trong lĩnh vực AI đã chứng tỏ khả năng vượt trội về hiệu suất xử lý hoặc tiết kiệm chi phí vận hành. Daniel Newman, nhà phân tích tại Futurum Group, nhận định rằng: “Đó là điều mà mọi người đã tin tưởng vào tiềm năng, nhưng giờ đây nó đã trở thành hiện thực.” Quá trình chuyển dịch thị trường chip AI máy chủ đang được thúc đẩy bởi một số tên tuổi lớn như Amazon và AMD, cùng với các startup nhỏ. Tất cả đều chạy đua để phát triển và tối ưu hóa các con chip bán dẫn cho từng giai đoạn trong quy trình nghiên cứu, huấn luyện và vận hành AI. Giai đoạn vận hành AI, hay còn gọi là nội suy, diễn ra khi các tập đoàn và startup công nghệ sử dụng hàng nghìn con chip để huấn luyện các mô hình ngôn ngữ.

Các sản phẩm chip đối kháng với Nvidia trong lĩnh vực AI đã chứng tỏ khả năng vượt trội về hiệu suất xử lý hoặc tiết kiệm chi phí vận hành. Daniel Newman, nhà phân tích tại Futurum Group, nhận định rằng: “Đó là điều mà mọi người đã tin tưởng vào tiềm năng, nhưng giờ đây nó đã trở thành hiện thực.” Quá trình chuyển dịch thị trường chip AI máy chủ đang được thúc đẩy bởi một số tên tuổi lớn như Amazon và AMD, cùng với các startup nhỏ. Tất cả đều chạy đua để phát triển và tối ưu hóa các con chip bán dẫn cho từng giai đoạn trong quy trình nghiên cứu, huấn luyện và vận hành AI. Giai đoạn vận hành AI, hay còn gọi là nội suy, diễn ra khi các tập đoàn và startup công nghệ sử dụng hàng nghìn con chip để huấn luyện các mô hình ngôn ngữ. Cristiano Amon, CEO của Qualcomm, đã chia sẻ kế hoạch sử dụng chip do Amazon phát triển để triển khai các tính năng AI, như huấn luyện mô hình mới và vận hành với chip xử lý của Qualcomm trên các thiết bị smartphone và laptop. Ông cho rằng: “Giá trị thực sự đến từ quá trình nội suy AI, và quá trình này đang ngày càng mở rộng. Chúng ta bắt đầu chứng kiến sự thay đổi rõ rệt trong ngành công nghệ.” Các đối thủ của Nvidia cũng đang học hỏi từ chiến lược phát triển của công ty này, không chỉ tập trung vào việc phát triển chip tăng tốc AI mà còn xây dựng hệ thống máy chủ hoàn chỉnh. Điều này giúp khách hàng tận dụng tối đa hiệu suất của các chip chuyên biệt.

Cristiano Amon, CEO của Qualcomm, đã chia sẻ kế hoạch sử dụng chip do Amazon phát triển để triển khai các tính năng AI, như huấn luyện mô hình mới và vận hành với chip xử lý của Qualcomm trên các thiết bị smartphone và laptop. Ông cho rằng: “Giá trị thực sự đến từ quá trình nội suy AI, và quá trình này đang ngày càng mở rộng. Chúng ta bắt đầu chứng kiến sự thay đổi rõ rệt trong ngành công nghệ.” Các đối thủ của Nvidia cũng đang học hỏi từ chiến lược phát triển của công ty này, không chỉ tập trung vào việc phát triển chip tăng tốc AI mà còn xây dựng hệ thống máy chủ hoàn chỉnh. Điều này giúp khách hàng tận dụng tối đa hiệu suất của các chip chuyên biệt. Khách hàng sẽ có cơ hội trải nghiệm AI với mức giá thấp hơn và tốc độ cao hơn.

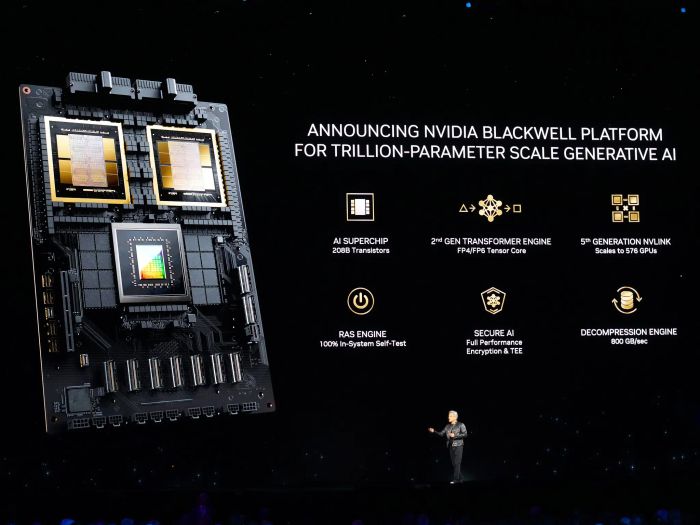

Khách hàng sẽ có cơ hội trải nghiệm AI với mức giá thấp hơn và tốc độ cao hơn. Dù cạnh tranh trong ngành chip AI máy chủ đám mây ngày càng khốc liệt, nhưng Nvidia vẫn giữ vững vị thế dẫn đầu. Theo phát ngôn viên của công ty, CEO Jensen Huang nhấn mạnh lợi thế cạnh tranh vượt trội của Nvidia trong phần mềm vận hành AI và khả năng nội suy mô hình AI. Những con chip Blackwell hiện đang được thị trường săn đón mạnh mẽ, với hiệu suất vượt trội mặc dù tiêu thụ điện năng có phần cao hơn, nhưng sự cải thiện về hiệu năng so với công suất điện tiêu thụ là rất đáng kể.Chip Nvidia quá đắt đỏ.

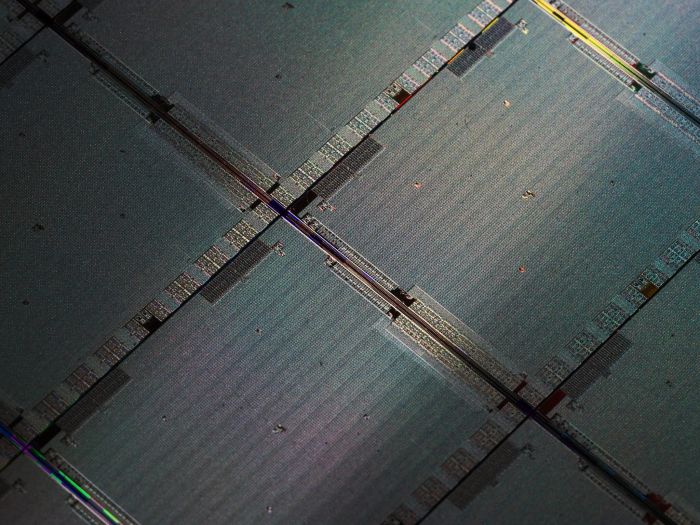

Dù cạnh tranh trong ngành chip AI máy chủ đám mây ngày càng khốc liệt, nhưng Nvidia vẫn giữ vững vị thế dẫn đầu. Theo phát ngôn viên của công ty, CEO Jensen Huang nhấn mạnh lợi thế cạnh tranh vượt trội của Nvidia trong phần mềm vận hành AI và khả năng nội suy mô hình AI. Những con chip Blackwell hiện đang được thị trường săn đón mạnh mẽ, với hiệu suất vượt trội mặc dù tiêu thụ điện năng có phần cao hơn, nhưng sự cải thiện về hiệu năng so với công suất điện tiêu thụ là rất đáng kể.Chip Nvidia quá đắt đỏ. AMD thông báo rằng thế hệ chip AI mới dành cho máy chủ đám mây, dự kiến ra mắt vào năm 2025, sẽ tập trung vào việc cạnh tranh trực tiếp với hiệu suất của chip Nvidia Blackwell. Tại phòng thí nghiệm ở Austin, Texas, các lãnh đạo của AMD cho biết hiệu năng nội suy là một lợi thế quan trọng của dòng chip Instinct mới. Một trong những khách hàng sử dụng chip Nvidia là Meta, để huấn luyện mô hình AI Llama 3.1 với 405 tỷ tham số, nhưng lại sử dụng các máy chủ trang bị chip Instinct MI300 của AMD để vận hành các tính năng AI trên mạng xã hội. Bên cạnh AMD và Amazon, Google, Microsoft và Meta cũng đang phát triển chip AI riêng để giảm chi phí, đồng thời vận hành chip AI của Nvidia. Dự kiến trong tháng 12 này, Google sẽ ra mắt dịch vụ máy chủ đám mây sử dụng chip TPU thế hệ thứ 6, Trillium, với hiệu năng cao gấp 5 lần so với TPUv5. Amazon, mặc dù bị cho là có dấu hiệu tụt hậu trong ngành AI, đã đầu tư 75 tỷ USD vào nghiên cứu và phát triển sản phẩm phần cứng AI trong năm 2024.

AMD thông báo rằng thế hệ chip AI mới dành cho máy chủ đám mây, dự kiến ra mắt vào năm 2025, sẽ tập trung vào việc cạnh tranh trực tiếp với hiệu suất của chip Nvidia Blackwell. Tại phòng thí nghiệm ở Austin, Texas, các lãnh đạo của AMD cho biết hiệu năng nội suy là một lợi thế quan trọng của dòng chip Instinct mới. Một trong những khách hàng sử dụng chip Nvidia là Meta, để huấn luyện mô hình AI Llama 3.1 với 405 tỷ tham số, nhưng lại sử dụng các máy chủ trang bị chip Instinct MI300 của AMD để vận hành các tính năng AI trên mạng xã hội. Bên cạnh AMD và Amazon, Google, Microsoft và Meta cũng đang phát triển chip AI riêng để giảm chi phí, đồng thời vận hành chip AI của Nvidia. Dự kiến trong tháng 12 này, Google sẽ ra mắt dịch vụ máy chủ đám mây sử dụng chip TPU thế hệ thứ 6, Trillium, với hiệu năng cao gấp 5 lần so với TPUv5. Amazon, mặc dù bị cho là có dấu hiệu tụt hậu trong ngành AI, đã đầu tư 75 tỷ USD vào nghiên cứu và phát triển sản phẩm phần cứng AI trong năm 2024. Tại văn phòng Annapurna Labs, thuộc sở hữu của Amazon sau khi mua lại vào năm 2015, các kỹ sư đã từng phát triển các chip mạng và vi xử lý đa dụng phục vụ các máy chủ của Amazon Web Services. Dù Trainium thế hệ đầu tiên không đạt được thành công như kỳ vọng của Amazon, thế hệ 2 lại nhận được rất nhiều sự kỳ vọng. Vào thứ 3 vừa rồi, Amazon đã công bố kế hoạch phát triển Trainium thế hệ 3, với hiệu suất mạnh mẽ hơn so với Trainium 2. Eiso Kant, người sáng lập và giám đốc công nghệ của startup AI Poolside, dự đoán rằng Trainium 2 sẽ cải thiện hiệu suất vận hành lên tới 40% so với chi phí khi so với chip của Nvidia.Theo The New York Times,

Tại văn phòng Annapurna Labs, thuộc sở hữu của Amazon sau khi mua lại vào năm 2015, các kỹ sư đã từng phát triển các chip mạng và vi xử lý đa dụng phục vụ các máy chủ của Amazon Web Services. Dù Trainium thế hệ đầu tiên không đạt được thành công như kỳ vọng của Amazon, thế hệ 2 lại nhận được rất nhiều sự kỳ vọng. Vào thứ 3 vừa rồi, Amazon đã công bố kế hoạch phát triển Trainium thế hệ 3, với hiệu suất mạnh mẽ hơn so với Trainium 2. Eiso Kant, người sáng lập và giám đốc công nghệ của startup AI Poolside, dự đoán rằng Trainium 2 sẽ cải thiện hiệu suất vận hành lên tới 40% so với chi phí khi so với chip của Nvidia.Theo The New York Times,