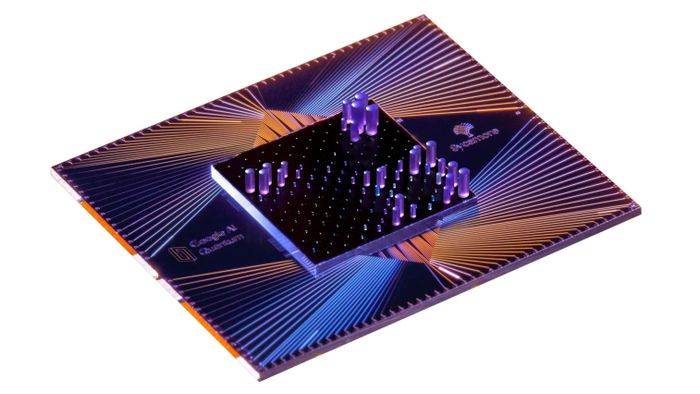

Nhờ vào sức mạnh từ siêu máy tính EOS của NVIDIA, Google Quantum AI kết hợp điện toán lai để mô phỏng cấu trúc vi xử lý lượng tử mà công ty hướng tới.

Nhờ vào sức mạnh từ siêu máy tính EOS của NVIDIA, Google Quantum AI kết hợp điện toán lai để mô phỏng cấu trúc vi xử lý lượng tử mà công ty hướng tới.

Một trong những hạn chế của chip lượng tử hiện tại là chúng chỉ thực hiện được một số phép toán nhất định trước khi gặp phải giới hạn, mà các chuyên gia gọi là "tiếng ồn lượng tử" (quantum noise). Khi đạt tới ngưỡng này, các phép tính phải tạm dừng. Chính đặc điểm này khiến việc áp dụng điện toán lượng tử vào thực tế gặp nhiều khó khăn. Việc giảm thiểu "tiếng ồn" là mục tiêu lớn của Google Quantum AI.

Guifre Vidal, nhà nghiên cứu tại Google Quantum AI, chia sẻ: "Việc phát triển máy tính lượng tử thương mại chỉ có ý nghĩa khi chúng ta có thể mở rộng phần cứng mà vẫn kiểm soát được mức độ "tiếng ồn". Chúng tôi đang sử dụng điện toán tăng cường từ NVIDIA để tìm hiểu sâu hơn về bản chất của "tiếng ồn" thông qua các thiết kế chip lượng tử có quy mô lớn hơn".

Một trong những hạn chế của chip lượng tử hiện tại là chúng chỉ thực hiện được một số phép toán nhất định trước khi gặp phải giới hạn, mà các chuyên gia gọi là "tiếng ồn lượng tử" (quantum noise). Khi đạt tới ngưỡng này, các phép tính phải tạm dừng. Chính đặc điểm này khiến việc áp dụng điện toán lượng tử vào thực tế gặp nhiều khó khăn. Việc giảm thiểu "tiếng ồn" là mục tiêu lớn của Google Quantum AI.

Guifre Vidal, nhà nghiên cứu tại Google Quantum AI, chia sẻ: "Việc phát triển máy tính lượng tử thương mại chỉ có ý nghĩa khi chúng ta có thể mở rộng phần cứng mà vẫn kiểm soát được mức độ "tiếng ồn". Chúng tôi đang sử dụng điện toán tăng cường từ NVIDIA để tìm hiểu sâu hơn về bản chất của "tiếng ồn" thông qua các thiết kế chip lượng tử có quy mô lớn hơn".

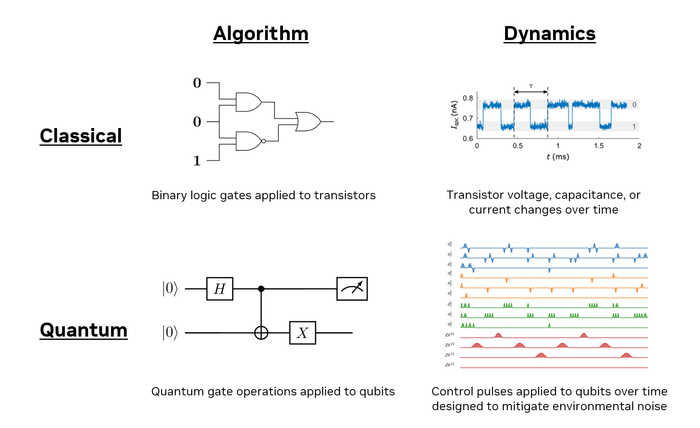

Sự khác biệt giữa mạch logic truyền thống và mạch qubit

Nói đơn giản, quy trình mà các kỹ sư của Google đang áp dụng tương tự như các công ty thiết kế chip khác khi tạo ra một mẫu mô phỏng trước khi chế tạo chip vật lý thực sự - xây dựng mô hình mô phỏng để kiểm tra cách thức hoạt động của thiết kế này. Điểm khác biệt lớn nhất ở đây là nền tảng CUDA-Q được NVIDIA phát triển riêng biệt để hỗ trợ các qubit, vốn có hành vi khác biệt so với các mạch logic thông thường.

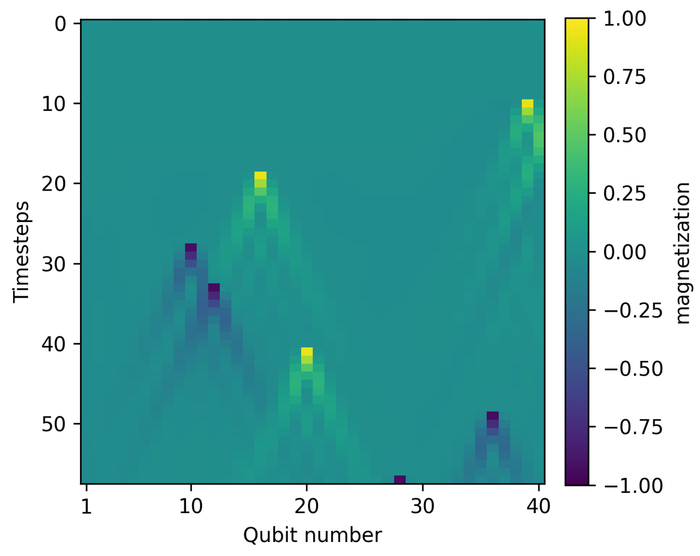

Hiện tại, Google có thể tận dụng 1000 GPU NVIDIA H100 trên hệ thống EOS để giả lập mẫu chip lượng tử của mình. Hệ thống giả lập này dự kiến có thể mô phỏng lên đến 40 qubit, là mô hình giả lập lớn nhất trong lĩnh vực lượng tử. Hệ thống sẽ giả lập "tiếng ồn" với độ chính xác tính theo phút, điều mà trước đây phải mất cả tuần mới có thể thực hiện được.

Hệ thống NVIDIA EOS hỗ trợ giả lập lượng tử với quy mô lên tới 40 qubit

Phần mềm sử dụng để thực hiện các mô phỏng dựa trên CUDA-Q sẽ sớm được công bố rộng rãi, NVIDIA cho biết.