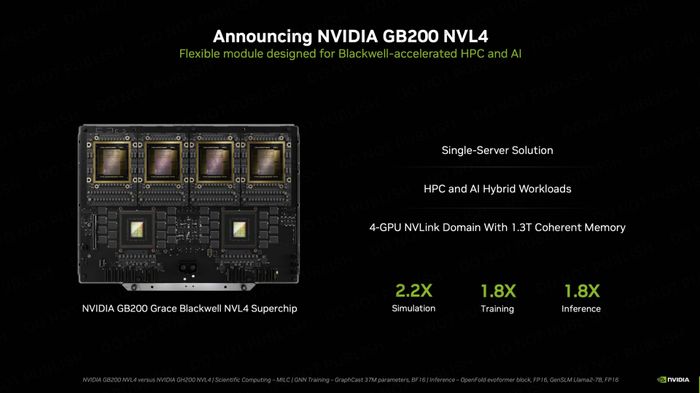

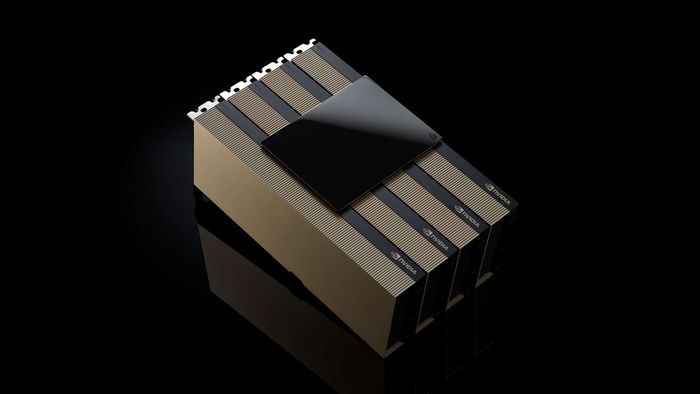

Trong sự kiện SC24 về siêu máy tính, NVIDIA đã giới thiệu hai giải pháp AI mới, bao gồm GB200 NVL4 và H200 NVL. Trong đó, GB200 NVL4 nổi bật nhất nhờ vào sức mạnh vượt trội, đồng thời cũng là nền tảng AI tốn nhiều điện năng nhất với cấu hình gồm 4 GPU Blackwell và 2 CPU Grace. Việc này khiến vấn đề làm mát trở thành thách thức lớn đối với công nghệ này.

Trong sự kiện SC24 về siêu máy tính, NVIDIA đã giới thiệu hai giải pháp AI mới, bao gồm GB200 NVL4 và H200 NVL. Trong đó, GB200 NVL4 nổi bật nhất nhờ vào sức mạnh vượt trội, đồng thời cũng là nền tảng AI tốn nhiều điện năng nhất với cấu hình gồm 4 GPU Blackwell và 2 CPU Grace. Việc này khiến vấn đề làm mát trở thành thách thức lớn đối với công nghệ này.Đây là "siêu chip" hay một siêu server?

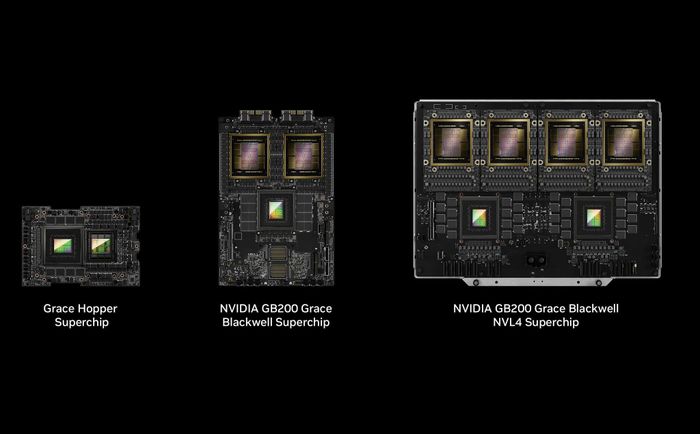

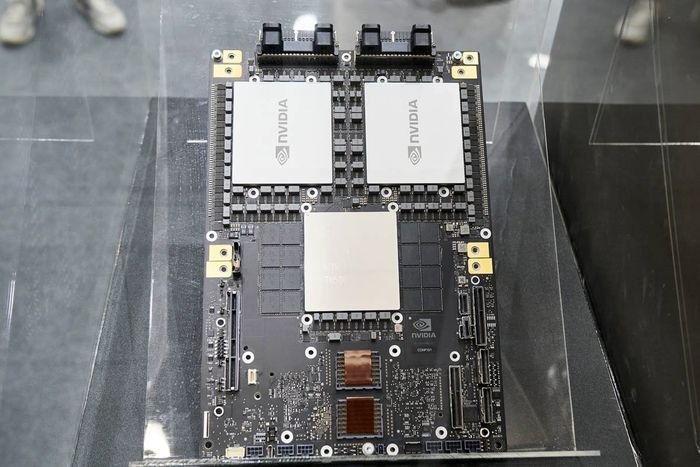

Điểm dễ nhận thấy nhất ở GB200 NVL4 là kích thước lớn gấp đôi so với GB200 (mặc dù tên của cả hai mẫu này hơi dài, bao gồm Grace Blackwell Superchip), với số lượng chip chính nhiều gấp đôi so với phiên bản trước. Tuy nhiên, khi xem xét kỹ, PCB của GB200 NVL4 lại rộng rãi và thoáng hơn, các linh kiện được phân bố hợp lý, không bị chật chội. Điều thú vị là "siêu chip" này có thể gắn vừa một chiếc server, và tôi nghĩ rằng tên gọi server chính là sự lựa chọn phù hợp hơn là "siêu chip".

Một điểm đáng chú ý khác của GB200 NVL4 là việc loại bỏ các chân cắm nằm ở góc PCB như trên phiên bản GB200 (dành cho server NVL72). Đây là một cải tiến đáng giá về mặt thiết kế, bởi vì để có 4 GPU trên một rack server, phiên bản cũ cần phải sử dụng 2 PCB đặt song song và kết nối chúng với các cáp chuyên dụng, khiến việc đi dây trở nên phức tạp. Còn với GB200 NVL4, mọi thứ trở nên đơn giản hơn rất nhiều.

GB200 NVL4 (trên) tại SC24 và GB200 NVL72 (dưới) tại Computex 2024

GB200 NVL4 (trên) tại SC24 và GB200 NVL72 (dưới) tại Computex 2024Về thông số kỹ thuật, GB200 NVL4 sở hữu 768 GB bộ nhớ HBM3E cho cả 4 GPU và 960 GB bộ nhớ LPDDR5X cho 2 CPU. "Siêu chip" này còn được trang bị công nghệ NVLink giúp kết nối tất cả các chip lại với nhau. NVIDIA cho biết GB200 NVL4 có khả năng mô phỏng mạnh mẽ gấp 2.2 lần, và tốc độ huấn luyện cũng như suy luận gấp 1.8 lần so với thế hệ trước là Grace Hopper Superchip. Dự kiến, sản phẩm này sẽ được phân phối rộng rãi vào cuối năm nay thông qua các đối tác OEM như MSI, ASUS, GIGABYTE, Wistron, Pegatron, ASRock Rack, Lenovo, HPE...

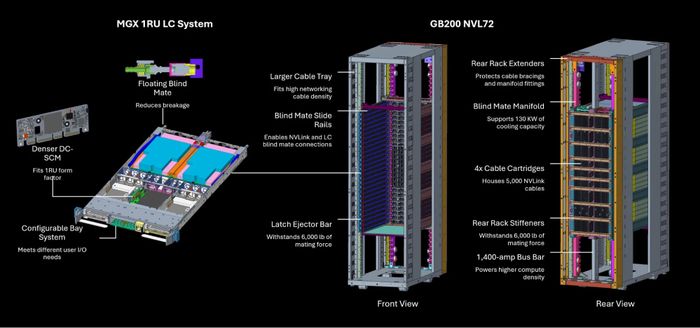

Thiết kế một server NVL72 với 18 khe, mỗi khe chứa 2 "siêu chip" GB200 (phiên bản cũ)

Card AI "chi phí thấp"

Về H200 NVL, nhiều người đặt câu hỏi tại sao NVIDIA lại ra mắt một sản phẩm "cũ" như vậy trong bối cảnh hiện nay (H200 là Hopper)? Thực tế, H200 NVL là giải pháp "mát mẻ" với 4 GPU H200, mỗi card PCIe có TDP không vượt quá 600 W. Điều này có nghĩa là H200 NVL sẽ có hiệu suất thấp hơn phiên bản SXM với TDP lên tới 700 W. Tuy nhiên, đây là sự đánh đổi hợp lý vì không phải tất cả các công ty hay trung tâm dữ liệu đều có thể sử dụng hệ thống tản nhiệt bằng chất lỏng.

Theo nghiên cứu của chính NVIDIA, 70% các rack server trong doanh nghiệp có mức tiêu thụ điện dưới 20 kW và chỉ sử dụng tản nhiệt bằng gió. Điều này đồng nghĩa với việc họ chỉ có thể sử dụng các chip tiêu thụ ít điện năng và không sinh nhiệt quá nhiều. Để tiếp cận được nhóm khách hàng này, NVIDIA cần phải có giải pháp phù hợp. Và H200 NVL chính là lựa chọn đó.

Dù H200 NVL sẽ kém mạnh hơn H200 SXM, nhưng nó vẫn mạnh mẽ hơn rất nhiều so với thế hệ H100 NVL. Với dung lượng bộ nhớ lớn hơn 1.5 lần và băng thông bộ nhớ nhanh hơn 1.2 lần so với phiên bản cũ, H200 NVL có khả năng inference mạnh hơn gấp 1.7 lần và khả năng tính toán HPC mạnh hơn gấp 1.3 lần. Sản phẩm này cũng sẽ là lựa chọn nâng cấp lý tưởng cho các khách hàng đang sử dụng dòng chip Ampere (A100) cũ, với tốc độ nhanh hơn gấp 2.5 lần so với các model A100 hiện tại.