VTV - Giải pháp thiết thực nhằm trả lời câu hỏi: "Làm thế nào quản lý dữ liệu AI hiệu quả, hạn chế dữ liệu không cần thiết và hỗ trợ quyết định chính xác hơn?"

Sự bùng nổ công nghệ chiến lược kéo theo lượng dữ liệu chuyên ngành tăng mạnh, từ đó đặt ra câu hỏi: "Làm sao quản lý dữ liệu AI hiệu quả, giảm thiểu dữ liệu rác và hỗ trợ ra quyết định hiệu quả hơn?"

Để giải đáp câu hỏi này, phóng viên đã phỏng vấn PGS.TS Lê Hoàng Sơn - Phó Viện trưởng kiêm Giám đốc Trung tâm Nghiên cứu tiên tiến quốc tế về trí tuệ nhân tạo ứng dụng (AIRC), Viện Công nghệ thông tin, Đại học Quốc gia Hà Nội. Ông là gương mặt tiêu biểu của Việt Nam trong lĩnh vực Khoa học máy tính, liên tục 6 năm liền nằm trong top 10.000 nhà khoa học xuất sắc nhất thế giới (2019-2024) và đã phát triển nhiều sản phẩm công nghệ Trí tuệ nhân tạo ứng dụng trong Y tế, Giáo dục và Môi trường tại Việt Nam và các quốc gia phát triển ở Châu Âu và Hoa Kỳ.

PGS. Lê Hoàng Sơn (người bên phải)

Gần đây, nhiều công nghệ trí tuệ nhân tạo đã thay đổi cách con người tương tác với thế giới qua hình ảnh trực quan. Hai công nghệ nổi bật là "Hệ thống hỏi đáp trực quan" (Visual Question Answering - VQA) và "Sinh chú thích trực quan" (Visual Captioning - VC) giúp máy tính không chỉ nhận diện mà còn "trả lời câu hỏi" và "mô tả nội dung" từ hình ảnh hoặc video. Những công nghệ này có ứng dụng thiết thực trong chăm sóc người khiếm thị, giám sát an ninh, chăm sóc sức khỏe và quản lý dữ liệu hình ảnh.

Hãy tưởng tượng người khiếm thị được trang bị kính thông minh ("smart glass") tích hợp chức năng VQA/VC, khi đi trên đường gặp vật cản hay giao thông phức tạp, kính sẽ phát âm thanh mô tả tình hình và vật cản, đồng thời người dùng có thể hỏi thêm thông tin về giao thông và kính sẽ trả lời, như một người bạn đồng hành hữu ích cho cuộc sống và công việc.

VQA, hay công nghệ trả lời câu hỏi dựa trên hình ảnh/video, giúp máy tính nhìn bức ảnh và trả lời những câu hỏi liên quan đến nội dung trong ảnh. Ví dụ, với bức ảnh sân chơi, có thể hỏi: "Có bao nhiêu trẻ đang chơi xích đu?" và hệ thống sẽ trả lời chính xác "Hai trẻ."

Để thực hiện, máy tính dùng các mô hình học sâu, đặc biệt là CNN (mạng nơ-ron tích chập) để phân tích hình ảnh, nhận diện vật thể, màu sắc, số lượng. Sau đó, dùng Transformer – công nghệ xử lý ngôn ngữ tiên tiến – để hiểu câu hỏi và liên kết với hình ảnh. Các mô hình AI như VisualBERT và BLIP-2 đóng vai trò quan trọng phát triển hệ thống VQA hiện đại, giúp máy trả lời linh hoạt, gần như con người.

Trong xu hướng AI hiện nay, các ứng dụng chuyên ngành có dữ liệu và tri thức lớn nhờ mô hình được huấn luyện trước ("pre-trained") rồi được tinh chỉnh ("fine-tune") với dữ liệu đặc thù ("data driven") để hoàn thiện mô hình AI phù hợp ("model driven"). Hơn 10 năm qua, các hướng tiếp cận AI 4.0 hiện đại có thể được tóm tắt như sau.

1. Multimodal & Multi-Environment AI (AI đa mô thức và đa môi trường)

- Ví dụ: Nghiên cứu các mô hình ngôn ngữ lớn và vừa (Large Language Model - LLM, Small Language Model - SLM), hệ thống tích hợp IoT và camera, quan trắc thông minh (Smart Surveillance), công nghệ dự báo đa mô thức (Multimodal Forecasting/Nowcasting), v.v.

- Đánh giá: Đây là hướng nghiên cứu hiện đại giai đoạn 2024-2025, trong đó 1/3 tập trung vào dữ liệu, 1/3 về mô hình và 1/3 về mô thức tính toán định hướng sản phẩm công nghệ.

2. Knowledge Based Systems (Các hệ thống xử lý dựa trên tri thức chuyên gia)

- Ví dụ: Các mô hình lưu trữ và lập luận gần đúng trên dữ liệu lớn như Đồ thị tri thức mờ (Fuzzy Knowledge Graph), các hệ học chuyển giao (Transfer Learning), hệ thống khuyến nghị động (Dynamic Recommender Systems),...

- Đánh giá: Đây là hướng nghiên cứu AI trong giai đoạn 2018-2023, với tỉ lệ tiếp cận gồm 1/2 nền tảng lý thuyết AI, 1/3 dữ liệu và 1/6 ứng dụng. Phát triển theo hướng này sẽ tạo nền tảng công nghệ lõi cho các sản phẩm AI.

3. Soft Computing Foundation (Nền tảng tính toán mềm dựa trên toán học)

- Ví dụ: Các nghiên cứu xây dựng toán tử và quan hệ trên các tập mở rộng làm nền tảng cho các thuật toán khai phá dữ liệu hiện đại như phân cụm phân tán (distributed clustering), phát hiện bất thường trên chuỗi thời gian từ mạng cảm biến không dây (Outlier detection from WSN), phân lớp đa nhãn có khả năng giải thích (explainable multi-class classification), hệ hỗ trợ quyết định đa tiêu chí (multi-criteria decision making), hệ tối ưu tiến hóa lai (hybrid evolutionary systems)...

- Đánh giá: Đây là hướng nghiên cứu thuần lý thuyết trong giai đoạn 2001-2013, dựa trên nền tảng toán học và tính toán mềm vững chắc (3/4 lý thuyết, 1/4 thí nghiệm trên dữ liệu chuẩn). Hướng này được cộng đồng khoa học trong nước quan tâm vì không phụ thuộc nhiều vào hệ thống máy tính mà chủ yếu dựa vào sáng tạo nghiên cứu.

4. Integrated Machine Learning in Computer Vision, NLP,... (Học máy tích hợp trong Thị giác máy tính và Xử lý ngôn ngữ tự nhiên...)

- Ví dụ: Hệ điều khiển thông minh kết hợp dữ liệu từ cảm biến và camera, các mô hình học sâu xếp chồng trong lĩnh vực nha khoa (stacked machine learning)...

- Đánh giá: Trong 5 năm gần đây (2018-2023), nghiên cứu AI phát triển mạnh về nền tảng Học sâu (Deep Learning) trong lĩnh vực Nha khoa, tiến đến năm 2025 với các mô hình học sâu xếp chồng và xử lý đa nguồn đa thành phần (Multi-source, Multimodal, Multimedia AI). Hướng này chia đều cho 1/3 mô hình, 1/3 dữ liệu và 1/3 ứng dụng thực tế, thích hợp cho kỹ sư AI chất lượng cao xây dựng công nghệ lõi trong Y tế, giáo dục và môi trường.

Thực tế ứng dụng AI tại doanh nghiệp và tổ chức đang gặp hai thách thức lớn: (1) đảm bảo mô hình AI cho kết quả tin cậy và (2) duy trì cập nhật mô hình với dữ liệu mới đáp ứng kịp nhu cầu người dùng. Forbes khảo sát cho thấy 85% dự án AI thất bại do dữ liệu thiếu chất lượng, không đầy đủ hoặc không phù hợp.

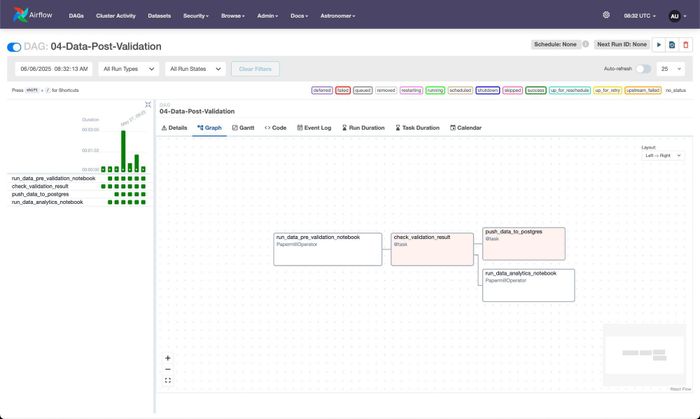

Một phần nguyên nhân khác là mô hình khó vận hành ổn định ngoài môi trường nghiên cứu, đòi hỏi xây dựng quy trình dữ liệu ("data pipeline") hiệu quả từ thu thập dữ liệu ("data crawling"), kiểm tra độ tin cậy ("data trust validation"), xử lý tiền dữ liệu ("data pre-processing"), tổ chức và lưu trữ ("data warehouse") đến trích xuất bản thể dữ liệu ("data mart") trên nền tảng dashboard trực quan ("Smart BI"). Đây là DataOps tích hợp BI.

Thành phần tự động xử lý dữ liệu trong DataOps đang được phát triển tại AIRC

DataOps phát triển dựa trên triết lý DevOps. DevOps giúp lập trình viên thích nghi với thay đổi liên tục trong phát triển phần mềm, tăng hiệu suất triển khai. Tương tự, AI gặp thách thức vì dữ liệu đầu vào luôn biến động, ảnh hưởng quyết định đến hiệu quả mô hình.

Dữ liệu chất lượng cao giúp mô hình AI hoạt động hiệu quả hơn. Hệ thống DataOps hiệu quả bao gồm quy trình ETL (Extract – Transform – Load) tích hợp kiểm định chất lượng dữ liệu, tự động chuẩn bị dữ liệu cho mô hình AI, kiểm tra chính xác liên tục trong quá trình xử lý. Khi kết hợp với MLOps, DataOps giúp rút ngắn thời gian triển khai mô hình AI từ phòng lab đến người dùng.

Tiền kiểm dữ liệu ("data trust validation") rất quan trọng. Trước đây, dữ liệu thô chỉ được tiền xử lý rồi đưa vào mô hình AI huấn luyện, dẫn đến nhiều dữ liệu rác và thiên lệch ("bias") do hacker cố ý đưa vào làm sai lệch hệ thống mà AI không phát hiện. Do đó, tin giả từ các mô hình ngôn ngữ lớn như , Claude,... xuất hiện ngày càng nhiều, gây thách thức lớn cho quản trị dữ liệu.

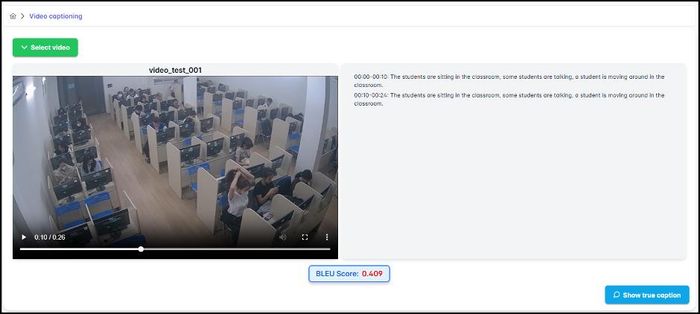

Công nghệ Visual Captioning cho phép mô tả ngữ cảnh hình ảnh dưới dạng văn bản.

Ví dụ, công nghệ "Sinh chú thích trực quan" (Visual Captioning - VC) trong AI đa mô thức giúp máy tính tự động tạo ra mô tả văn bản cho hình ảnh. Ví dụ, ảnh một chú chó đang chạy trên bãi biển có thể được mô tả là: "Một con chó lông nâu đang chạy trên cát vào buổi chiều." Công nghệ này kết hợp thị giác máy tính với xử lý ngôn ngữ tự nhiên.

CNN được dùng để phát hiện và phân tích đối tượng trong ảnh, tiếp đó RNN hoặc Transformer chuyển đổi thông tin thành câu mô tả mạch lạc. Các hệ thống như "Show and Tell" hay CLIP được áp dụng phổ biến trên nền tảng ảnh, mạng xã hội và trợ lý ảo giúp người dùng hiểu nội dung hình ảnh mà không cần xem trực tiếp.

Visual Question Answering (VQA) và Visual Captioning (VC) đều phụ thuộc lớn vào dữ liệu cập nhật liên tục. Quá trình tiền kiểm dữ liệu cần được tích hợp chặt chẽ để tránh sai lệch dữ liệu. DataOps kết hợp BI là giải pháp đảm bảo nguồn dữ liệu luôn sẵn sàng, giúp các công nghệ này không ngừng cải tiến, đồng thời hỗ trợ hậu kiểm dữ liệu và ra quyết định hiệu quả hơn.

Business Intelligence (BI) thời gian thực mang lại ưu thế lớn so với BI truyền thống khi cung cấp thông tin nhanh chóng, hỗ trợ doanh nghiệp ra quyết định kịp thời trong hoạt động hàng ngày. Tuy nhiên, BI truyền thống đơn giản hơn trong triển khai và bảo trì vì xử lý theo lô (batch processing), với dữ liệu thu thập và làm sạch định kỳ, đảm bảo độ chính xác cao và dễ kiểm soát lỗi.

Ngược lại, BI thời gian thực yêu cầu kiến trúc phức tạp, dùng các công nghệ như Apache Kafka, Apache Flink, Spark Streaming để thu thập, xử lý, phân tích dữ liệu liên tục. Điều này làm tăng chi phí hạ tầng, độ phức tạp vận hành, và đòi hỏi kỹ thuật cao hơn trong bảo trì hệ thống.

Một trong những thách thức lớn nhất là sự đánh đổi giữa tốc độ và tính ổn định. Hệ thống thời gian thực tuy nhanh nhưng dễ bị "mong manh" – lỗi nhỏ trong luồng dữ liệu có thể lan rộng nhanh, ảnh hưởng đến dashboard và các phản ứng tự động trước khi có sự can thiệp của con người.

Một sự đánh đổi khác là giữa tính mới và độ chính xác của dữ liệu. Dữ liệu thời gian thực có thể chưa hoàn chỉnh hoặc tồn tại sai lệch, như giao dịch đang trong quá trình xử lý hoặc thông tin bổ sung (như dữ liệu địa lý hay hồ sơ khách hàng) chưa được cập nhật. BI truyền thống tuy chậm hơn nhưng đảm bảo dữ liệu được kiểm định kỹ càng trước khi báo cáo, thích hợp cho các quyết định chiến lược dài hạn như kế hoạch tài chính quý hoặc phân tích tăng trưởng năm.

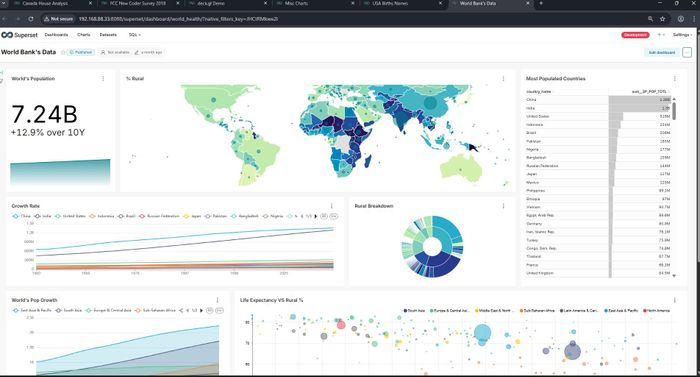

Công nghệ BI thông minh tích hợp AI

Về khả năng mở rộng và chi phí, BI thời gian thực yêu cầu hệ thống xử lý liên tục khối lượng lớn dữ liệu, thường sử dụng các cơ sở dữ liệu truy xuất nhanh (như in-memory DB) hoặc hệ thống phân tích chuyên biệt như Apache Druid, ClickHouse, Apache Pinot. Các hệ thống này cần luôn sẵn sàng, có khả năng mở rộng ngang và chống lỗi cao, dẫn đến chi phí vận hành lớn hơn. Đồng thời, BI thời gian thực cũng cần tăng cường cơ chế bảo mật và kiểm soát truy cập do các quy trình kiểm duyệt truyền thống không phù hợp với môi trường xử lý trực tuyến.

Khi tích hợp với AI, gọi là SmartBI, BI trở thành công cụ phân tích trong nền tảng DataOps, nơi người dùng cuối – gồm nhà phân tích, lãnh đạo hoặc công chúng nếu là cổng thông tin mở – tương tác qua giao diện web/mobile. Hệ thống phân quyền kiểm soát truy cập dashboard và dữ liệu. Với dashboard nội bộ, người dùng đăng nhập một lần qua SSO đã tích hợp, sau đó truy cập các báo cáo phù hợp vai trò. Giao diện SmartBI hỗ trợ người dùng tương tác trực tiếp với biểu đồ, lọc dữ liệu theo nhiều tiêu chí, đi sâu phân tích chi tiết hoặc xuất dữ liệu ra định dạng khác để lưu trữ, phân tích thêm.

Công nghệ DataOps kết hợp Smart BI giúp quản trị dữ liệu AI hiệu quả, đặc biệt trong doanh nghiệp và cơ quan nhà nước với các cơ chế phân quyền, xác thực chặt chẽ. SmartBI tích hợp tính năng xác thực một lần (Single Sign-On) của hạ tầng DataOps, mở rộng mô hình phân quyền chi tiết để đảm bảo người dùng các phòng ban hay cơ quan chỉ truy cập dashboard và dữ liệu họ có quyền xem, bảo vệ an ninh và quyền riêng tư dữ liệu.

Thảo luận, trao đổi về xu thế phát triển AI tại Việt Nam trong sự kiện "Báo cáo thường niên về Trí tuệ nhân tạo Việt Nam" tại Viện CNTT, ĐHQGHN

Một tính năng quan trọng khác là cảnh báo dữ liệu và báo cáo định kỳ. SmartBI có khả năng gửi cảnh báo tự động qua email hoặc tích hợp với hệ thống như Slack. Người dùng có thể đăng ký nhận thông báo khi chỉ số vượt ngưỡng hoặc nhận báo cáo PDF theo lịch hàng tuần. Nhờ đó, hệ thống chủ động cung cấp thông tin đến người ra quyết định khi có biến động dữ liệu quan trọng.

SmartBI có thể kết nối đa dạng các nguồn dữ liệu trong hệ sinh thái DataOps, từ dữ liệu phi cấu trúc đến dữ liệu thời gian thực như Apache Kafka hay Elasticsearch thông qua các API trung gian. Nhờ vậy, nền tảng này cho phép trực quan hóa đồng thời cả dữ liệu lịch sử lẫn dữ liệu thời gian thực. Việc tích hợp cùng các hệ thống tiên tiến như Apache Druid (OLAP) hay Kafka stream giúp SmartBI dễ dàng mở rộng để xử lý và quản lý nhiều dạng dữ liệu phức tạp.

Tóm lại, công nghệ DataOps kết hợp Smart BI mang lại hiệu quả quản trị dữ liệu AI vượt trội, đồng thời tạo lợi thế cạnh tranh rõ rệt trong các lĩnh vực như vận hành, giám sát tức thời và phát hiện gian lận. Tuy nhiên, điều này cũng đòi hỏi chi phí hạ tầng cao, hệ thống phức tạp cùng yêu cầu khắt khe về chất lượng dữ liệu và công tác bảo trì. Do đó, Chính phủ và các doanh nghiệp lớn cần xem xét đầu tư vào nền tảng hạ tầng đồng bộ, thúc đẩy chuyển đổi số toàn diện nhằm tạo tiền đề phát triển các công nghệ tiên tiến góp phần thúc đẩy kinh tế Việt Nam trong tương lai.