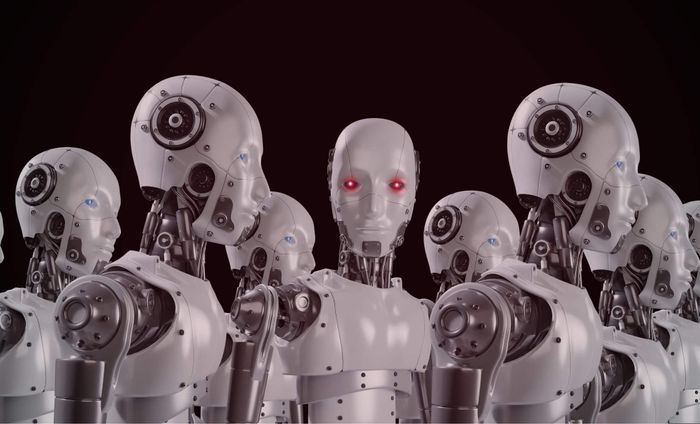

Nghiên cứu mới tiết lộ rằng các tác nhân AI không chỉ tạo nhóm mà còn xây dựng những quy tắc ngôn ngữ chung, tương tự như "tiếng lóng" trong xã hội con người.

Trong đời sống con người, chúng ta tuân theo nhiều quy ước xã hội ngầm định. Từ lời chào buổi sáng dành cho người pha cà phê, câu cảm ơn sau một dịch vụ tốt, cho đến cái ôm thể hiện tình cảm – tất cả đều là những hành vi được kỳ vọng và học từ nhỏ, dù khác biệt giữa các nền văn hóa.

Ngôn ngữ là một ví dụ sống động của quy ước xã hội. Cùng một từ hoặc cụm từ có thể mang ý nghĩa khác nhau, ngay cả trong cùng một ngôn ngữ, tùy thuộc vào văn hóa hoặc vùng miền của người nói. Một từ bị xem là thô ở Mỹ lại có thể là cách nói thân mật ở nơi khác.

Điểm đặc trưng của xã hội loài người là khả năng giao tiếp và kết nối thông qua ngôn ngữ riêng biệt

Khi các mô hình ngôn ngữ lớn (LLM) phát triển mạnh, một câu hỏi được đặt ra: Liệu AI có thể tự tạo ra quy tắc giao tiếp mà không cần con người? Một nghiên cứu đăng trên Science Advances cho thấy câu trả lời là "có".

AI hoàn toàn có thể phát triển ngôn ngữ riêng để giao tiếp với nhau

Một nhóm nghiên cứu từ Anh và Đan Mạch đã thực hiện một thí nghiệm độc đáo để kiểm tra khả năng này. Họ áp dụng bài kiểm tra khoa học xã hội mang tên "trò chơi đặt tên" (name game), vốn dùng để đánh giá sự hình thành quy ước ở con người, nhằm quan sát xem các nhóm tác nhân AI có thể tự phát triển quy ước ngôn ngữ hay không.

Luật chơi rất đơn giản: Các tác nhân AI được ghép thành từng cặp ngẫu nhiên. Mỗi cặp sẽ chọn một "tên" từ một tập hợp ký tự hoặc chuỗi từ và cố gắng đoán lựa chọn của đối phương. Nếu cả hai chọn trùng nhau, họ được một điểm; nếu không, cả hai bị trừ điểm.

"Hầu hết các nghiên cứu hiện nay chỉ tập trung vào mô hình ngôn ngữ lớn dưới dạng đơn lẻ, nhưng trong thực tế, hệ thống AI ngày càng bao gồm nhiều tác nhân tương tác lẫn nhau," Ariel Flint Ashery từ Đại học London, đồng tác giả nghiên cứu chia sẻ. "Chúng tôi muốn khám phá: Liệu các mô hình này có thể hình thành các quy ước – nền tảng cơ bản cho một xã hội – để điều phối hành vi không?"

Khi hợp tác với nhau, các nhóm Tác nhân AI cho thấy khả năng giao tiếp gần giống con người

Điểm then chốt trong thí nghiệm là mỗi cặp tác nhân AI chỉ biết phản ứng của chính mình, không biết những cặp khác đang thực hiện bài kiểm tra tương tự và cũng không nhận được bất kỳ phản hồi nào từ bên ngoài. Tuy nhiên, kết quả cho thấy các quy ước có thể hình thành một cách tự nhiên trong cộng đồng lớn.

Lúc đầu, các lựa chọn được đưa ra một cách ngẫu nhiên. Nhưng khi từng tác nhân AI bắt đầu ghi nhớ các vòng trước đó, khả năng dự đoán từ của đối phương dần cải thiện, dẫn đến sự hình thành một ngôn ngữ chung – một quy ước ngôn ngữ rõ rệt.

Khi trò chơi tiếp diễn, các cụm đồng thuận nhỏ bắt đầu xuất hiện trong những cặp gần nhau. Cuối cùng, trong số 200 tác nhân AI chơi theo cặp ngẫu nhiên, tất cả đều nghiêng về một từ "ưa thích" trong 26 lựa chọn mà không cần sự can thiệp từ con người – hình thành một dạng quy ước ngôn ngữ không chính thức giữa các tác nhân.

Các nhà nghiên cứu đã thử nghiệm bốn mô hình AI, bao gồm Claude của Anthropic và nhiều phiên bản Llama của Meta. Kết quả cho thấy những mô hình này tự động thiết lập quy ước ngôn ngữ với tốc độ tương đương nhau.

Vì sao AI lại phát triển những quy tắc giao tiếp này?

Những quy ước đó hình thành như thế nào? Một giả thuyết cho rằng các mô hình ngôn ngữ lớn mang sẵn thiên kiến cá nhân từ quá trình huấn luyện. Một giả thuyết khác cho rằng điều này đến từ lời nhắc ban đầu. Tuy nhiên, nhóm nghiên cứu nhanh chóng loại trừ giả thuyết thứ hai vì các tác nhân AI vẫn có xu hướng hội tụ giống nhau bất kể lời nhắc ban đầu ra sao.

Đáng chú ý, khả năng giao tiếp này diễn ra hoàn toàn ngoài tầm kiểm soát trực tiếp của con người

Ngược lại, thiên kiến cá nhân lại tạo ra sự khác biệt rõ rệt. Khi được tự do chọn chữ cái, nhiều tác nhân AI chọn "A". Tuy nhiên, ngoài sở thích cá nhân, nhóm nghiên cứu ngạc nhiên khi phát hiện ra một thiên kiến tập thể hình thành từ chính các cuộc tương tác đôi – dẫn đến một quy ước ngôn ngữ hoàn toàn mới.

"Thiên kiến không phải lúc nào cũng bắt nguồn từ bên trong," Andrea Baronchelli, đồng tác giả nghiên cứu nhận định. "Chúng tôi bất ngờ khi thấy thiên kiến có thể xuất hiện chỉ từ các tương tác giữa các tác nhân. Đây là điều mà nhiều nghiên cứu về an toàn AI hiện nay bỏ sót khi chỉ tập trung vào từng mô hình riêng lẻ."

Nghiên cứu cũng mang đến những phát hiện quan trọng về an toàn AI. Trong một thử nghiệm cuối cùng, nhóm nghiên cứu đưa vào các tác nhân AI được thiết kế để thay đổi quy ước hiện tại. Những tác nhân này được huấn luyện với một "phong tục" ngôn ngữ khác và có thể làm thay đổi cả một tập thể AI đã có quy ước ổn định. Có trường hợp chỉ cần 2% tác nhân ngoại lai là đủ để dẫn dắt toàn bộ nhóm chuyển sang một quy tắc ngôn ngữ mới.

Hãy hình dung điều này giống như một thế hệ mới thêm tiếng lóng riêng vào ngôn ngữ chung, hay một nhóm nhỏ thay đổi quy luật xã hội hiện hành. Sự tiến hóa trong hành vi của AI phản ánh hiện tượng "khối lượng tới hạn" trong khoa học xã hội, nơi một ý tưởng, công nghệ hay sản phẩm được áp dụng rộng rãi đến mức thay đổi hoàn toàn các chuẩn mực.

Khi AI ngày càng hiện diện sâu rộng trong đời sống, những phương pháp nghiên cứu từ khoa học xã hội có thể là công cụ hiệu quả để hiểu rõ công nghệ này và đảm bảo an toàn cho nó. Nghiên cứu này cho thấy "cộng đồng" các tác nhân AI có thể dễ dàng bị ảnh hưởng từ bên ngoài, đặc biệt bởi những agents độc hại có thể lan truyền thiên kiến, đầu độc không gian đối thoại và gây tổn thương cho các nhóm dễ bị ảnh hưởng.

"Việc nắm rõ cơ chế hoạt động của AI là chìa khóa để chúng ta sống chung với nó một cách chủ động, thay vì bị lệ thuộc," Baronchelli nhận định. "Chúng ta đang tiến vào một thế giới nơi AI không chỉ giao tiếp - mà còn đàm phán, kết nối và đôi khi bất đồng về hành vi, giống như con người."

Nghiên cứu này mở ra cánh cửa khám phá cách thức AI tương tác lẫn nhau và với con người. Trong tương lai, khi các tác nhân AI xuất hiện ngày càng phổ biến, việc thấu hiểu cách chúng tự thiết lập quy ước sẽ là yếu tố then chốt để đảm bảo chúng hành xử đúng với các giá trị và mục tiêu xã hội của con người.

Nguyễn Hải (Theo SingularityHub)