Nvidia đang chiếm ưu thế trong việc thu hút phần lớn dòng vốn đầu tư vào lĩnh vực trí tuệ nhân tạo (AI).

Khi AI bước vào giai đoạn công nghiệp, các trung tâm dữ liệu hiện đại không còn được đánh giá bằng diện tích hay số lượng máy chủ, mà bằng công suất tính toán - đơn vị gigawatt (GW). Phố Wall đã bắt đầu định giá chi phí cho mỗi gigawatt và dự báo những doanh nghiệp nào sẽ thu được lợi ích từ làn sóng đầu tư này.

Theo các nhà phân tích tại TD Cowen, một gigawatt tương đương với công suất của một lò phản ứng hạt nhân và nó đang trở thành tiêu chuẩn mới cho các trung tâm dữ liệu AI thế hệ tiếp theo như Colossus 2 của xAI ở Memphis, Prometheus của Meta ở Ohio, Hyperion tại Louisiana, Stargate của OpenAI và Mount Rainier của Amazon ở Indiana. Những công trình này tiêu thụ một lượng điện cực lớn, kết hợp với nguồn vốn và các chip silicon để sản xuất 'trí tuệ', một quy trình vô cùng tốn kém.

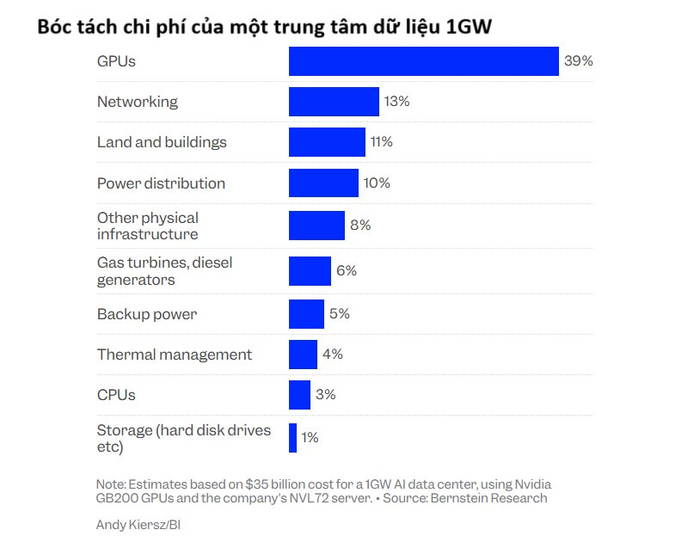

Theo một báo cáo gần đây từ Bernstein Research, chi phí xây dựng một trung tâm dữ liệu AI có công suất 1GW lên đến khoảng 35 tỷ USD. Mặc dù nghe có vẻ khó tin, nhưng đây chính là nền tảng kinh tế mới trong thời đại AI. Mỗi gigawatt không chỉ là một chỉ số về năng lượng mà còn là biểu tượng của một hệ sinh thái công nghiệp mới, bao gồm chất bán dẫn, thiết bị mạng, hệ thống điện, xây dựng và sản xuất năng lượng.

Trong tổng số 35 tỷ USD chi phí xây dựng trung tâm dữ liệu AI, phần lớn nhất – khoảng 39% – thuộc về GPU. Đây là bộ não của các trung tâm dữ liệu AI, chủ yếu đến từ dòng GB200 và các chip Rubin mới của Nvidia. Với biên lợi nhuận gộp đạt 70%, Bernstein ước tính Nvidia thu về gần 30% tổng chi phí cho các trung tâm dữ liệu AI dưới dạng lợi nhuận, lý giải tại sao công ty đạt giá trị thị trường gần 5 nghìn tỷ USD.

Theo TD Cowen, mỗi gigawatt công suất tương đương với hơn 1 triệu lõi GPU, tức là bộ não trung tâm của các chip AI. Đối tác sản xuất của Nvidia, TSMC, kiếm được khoảng 1,3 tỷ USD cho mỗi gigawatt nhờ vào việc gia công các thành phần này. Dù các đối thủ như AMD và Intel đang cố gắng đuổi kịp, và những gã khổng lồ như Google, Amazon hay Microsoft đang đầu tư vào chip tăng tốc AI ASIC để giảm chi phí hệ thống, các nhà phân tích từ Bernstein và TD Cowen cho rằng GPU vẫn là trung tâm của toàn bộ nền kinh tế AI.

Sau GPU, yếu tố tiêu tốn chi phí lớn thứ hai là mạng lưới kết nối, chiếm khoảng 13% tổng chi phí. Đây là yếu tố quan trọng giúp liên kết hàng triệu GPU lại với nhau thông qua các switch tốc độ cao và kết nối quang học. Các công ty hưởng lợi bao gồm Arista Networks, Broadcom, Marvell (thiết bị mạng và chip), Amphenol, Luxshare (cáp và đầu nối), cùng InnoLight, Eoptolink, Coherent (bộ thu phát quang).

Hạ tầng năng lượng và hệ thống làm mát cũng chiếm phần lớn chi phí. Theo Bernstein, phân phối điện chiếm khoảng 10% tổng chi phí, trong khi làm mát chiếm khoảng 4%, với sự phân bổ đều giữa hệ thống làm mát bằng không khí và bằng chất lỏng. Các nhà cung cấp lớn trong lĩnh vực này bao gồm Eaton, Schneider Electric, ABB và Vertiv, trong đó Vertiv nắm bắt cơ hội lớn trong lĩnh vực làm mát.

Khoảng 10% chi phí còn lại liên quan đến đất đai và xây dựng các tòa nhà. Tuy nhiên, chi phí vận hành lại không quá cao. Theo Bernstein, mỗi năm một trung tâm dữ liệu AI công suất 1GW tốn khoảng 1,3 tỷ USD cho tiền điện và chỉ cần từ 8 đến 10 nhân viên vận hành, với mức lương trung bình dao động từ 30.000–80.000 USD/năm.

Tuy nhiên, thách thức lớn nhất hiện nay là nguồn cung cấp điện năng. Các công ty như Siemens Energy, GE Vernova và Mitsubishi Heavy đang ghi nhận lượng đơn hàng tăng mạnh cho các tuabin và hạ tầng lưới điện, khi các tập đoàn công nghệ hàng đầu thế giới đua nhau cạnh tranh để đảm bảo nguồn điện ổn định phục vụ cho sự phát triển AI quy mô công nghiệp.

Tóm lại, một trung tâm dữ liệu AI 1GW yêu cầu khoản đầu tư lên đến 35 tỷ USD, và Nvidia là người hưởng lợi chính, khi GPU trở thành nền tảng cốt lõi trong cuộc cách mạng trí tuệ nhân tạo toàn cầu.

Theo: BI