VTV.vn - MiMo-7B là mô hình ngôn ngữ lớn mã nguồn mở đầu tiên do Xiaomi phát triển, nhắm đến các nhiệm vụ suy luận và lập trình.

Xiaomi âm thầm gia nhập đường đua LLM với MiMo-7B – hệ thống AI mã nguồn mở đầu tiên của hãng. Được phát triển bởi đội ngũ Big Model Core Team mới thành lập, MiMo-7B tập trung mạnh vào khả năng suy luận và đã vượt qua các đối thủ như OpenAI và Alibaba trong các bài đánh giá về toán học và sinh mã.

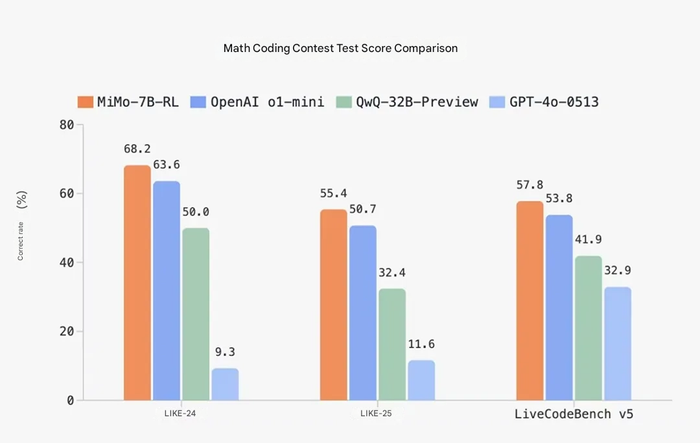

Với 7 tỷ tham số như tên gọi, MiMo-7B dù nhỏ hơn nhiều so với các LLM lớn khác nhưng Xiaomi tuyên bố hiệu năng của nó ngang ngửa o1-mini của OpenAI và Qwen-32B-Preview của Alibaba – những mô hình nổi bật trong lĩnh vực suy luận.

Trọng tâm của MiMo-7B là quy trình huấn luyện nghiêm ngặt. Xiaomi cho biết đã xây dựng một bộ dữ liệu với 200 tỷ token tập trung vào suy luận và cung cấp tổng cộng 25 nghìn tỷ token qua ba giai đoạn huấn luyện.

Thay vì dự đoán từng token kế tiếp như truyền thống, Xiaomi chọn cách dự đoán nhiều token cùng lúc, giúp tăng tốc suy luận mà vẫn giữ nguyên chất lượng đầu ra.

Ở giai đoạn hậu huấn luyện, Xiaomi sử dụng các kỹ thuật học tăng cường kết hợp với cải tiến hạ tầng. Hãng triển khai thuật toán riêng mang tên "Test Difficulty Driven Reward" để giải quyết vấn đề tín hiệu phần thưởng khan hiếm trong RL và áp dụng thêm phương pháp "Easy Data Re-Sampling" để làm ổn định quá trình học.

Về mặt hạ tầng, Xiaomi đã phát triển hệ thống Seamless Rollout giúp giảm thiểu thời gian GPU không hoạt động trong quá trình huấn luyện và đánh giá. Theo dữ liệu nội bộ, tốc độ huấn luyện được cải thiện gấp 2,29 lần, trong khi hiệu suất đánh giá tăng gần gấp đôi.

Công cụ này còn tích hợp các chiến lược suy diễn tiên tiến như dự đoán nhiều token cùng lúc trong môi trường vLLM.

MiMo-7B hiện có bốn phiên bản chính thức. Phiên bản Base là mô hình gốc sau huấn luyện sơ bộ. Phiên bản SFT đã được tinh chỉnh bằng dữ liệu có giám sát. RL-Zero được xây dựng từ Base thông qua học tăng cường. Cuối cùng, phiên bản RL tinh chỉnh sâu từ SFT và được đánh giá là chính xác nhất.

Xiaomi đã chia sẻ các kết quả benchmark chứng minh sức mạnh của MiMo-7B-RL: đạt 95,8% trên MATH-500 và hơn 68% trên AIME 2024 trong toán học; đạt 57,8% trên LiveCodeBench v5 và gần 50% trên phiên bản 6 trong lập trình. Với các tác vụ kiến thức tổng quát như DROP, MMLU-Pro, GPQA, mô hình đạt điểm trung bình đến cao 50 – một thành tích ấn tượng với mô hình 7B.

Hiện tại, MiMo-7B đã được phát hành công khai trên nền tảng Hugging Face theo giấy phép mã nguồn mở.