Vào năm 1966, Joseph Weizenbaum đã vô tình mở ra chiếc hộp Pandora khi ông tạo ra ELIZA. Tuy nhiên, điều khiến ông sợ hãi không phải là con quái vật trong chiếc hộp ấy, mà là sự khao khát mù quáng của con người muốn được hiểu thấu bởi chính 'con quái vật' này.

Trong lịch sử phát triển của trí tuệ nhân tạo (AI), hiếm có câu chuyện nào mang đậm màu sắc bi kịch và triết lý như câu chuyện của Joseph Weizenbaum. Ông là người đã thắp lên ngọn lửa cho các mô hình ngôn ngữ lớn mà chúng ta thấy ngày nay như hay Claude, nhưng đồng thời cũng là người đầu tiên tìm cách dập tắt sự sùng bái dành cho chúng.

Câu chuyện bắt đầu tại Viện Công nghệ Massachusetts (MIT) vào giữa thập niên 60. Weizenbaum phát triển ELIZA, một chương trình đơn giản đóng vai trò như một bác sĩ tâm lý. Về mặt kỹ thuật, nó rất thô sơ: chỉ đơn thuần quét từ khóa trong câu của người dùng và đưa ra câu hỏi dựa trên các mẫu có sẵn. Không có tư duy, không có cảm xúc, chỉ là những dòng mã vô tri. Mục tiêu của Weizenbaum là để chỉ ra sự nông cạn trong giao tiếp giữa người và máy.

Tuy nhiên, kết quả lại là một cú sốc tâm lý đối với chính tác giả. Một giai thoại nổi tiếng kể lại rằng, thư ký của Weizenbaum - người biết rõ ELIZA chỉ là một chương trình máy tính - đã yêu cầu ông rời khỏi phòng để bà có thể 'tâm sự riêng' với cỗ máy. Những người dùng khác cũng vậy, họ trút bầu tâm sự, chia sẻ những bí mật thầm kín nhất với một thuật toán. Weizenbaum gọi đây là 'Hiệu ứng ELIZA' - ảo giác về trí tuệ và cảm xúc của máy móc, do chính con người phóng chiếu lên.

Sự kiện này đã thay đổi Weizenbaum mãi mãi. Từ một nhà khoa học máy tính, ông chuyển mình thành một nhà triết học đạo đức, một 'kẻ nổi loạn' trong thế giới công nghệ. Tại sao ông lại phản ứng mạnh mẽ như vậy? Câu trả lời nằm ở quá khứ đầy đau thương của ông.

Là một người Do Thái từng phải trốn chạy khỏi Đức Quốc xã, Weizenbaum thấu hiểu hơn ai hết cái giá của việc 'phi nhân hóa'. Ông rùng mình khi nghe các đồng nghiệp tại MIT so sánh con người với 'những cỗ máy bằng thịt' (meat machines). Đối với ông, đó không phải là một phép so sánh khoa học thú vị, mà là mầm mống của tội ác.

Khi ranh giới giữa con người và máy móc trở nên mờ nhạt, và con người bị coi như những cỗ máy lỗi thời cần phải bị robot thay thế, đó chính là lúc xã hội đánh mất giá trị nhân văn. Ông nhận thấy sự tương đồng đáng sợ giữa tư duy lạnh lùng này và những lý thuyết đã dẫn đến thảm họa Holocaust.

Nỗi lo lớn nhất của Weizenbaum không phải là viễn cảnh AI nổi dậy và tiêu diệt loài người theo kiểu Hollywood. Ông lo sợ một kết cục tinh vi và buồn thảm hơn: Con người tự nguyện trao lại quyền quyết định và đạo đức cho máy móc. Ông lo ngại chúng ta sẽ tôn sùng công nghệ như một 'thần tượng giả', tin tưởng vào phán đoán của thuật toán thay vì lòng trắc ẩn của chính mình.

Brian Merchant, tác giả cuốn sách 'Blood in the Machine', đã có một nhận định chính xác về tầm nhìn của Weizenbaum: 'Ông ấy nhận ra rằng con người luôn khao khát kết nối, và sự dễ dàng mà một chương trình máy tính có thể lợi dụng khao khát đó sẽ khiến chúng ta trở thành con mồi'.

Ngày nay, trong kỷ nguyên AI đang bùng nổ, những lời cảnh báo của Weizenbaum từ nửa thế kỷ trước lại trở nên vô cùng hiện thực. Chúng ta chứng kiến người ta yêu thích chatbot, hỏi AI về các quyết định đạo đức, và thậm chí để thuật toán quyết định ai xứng đáng vay tiền hay ai sẽ được tuyển dụng.

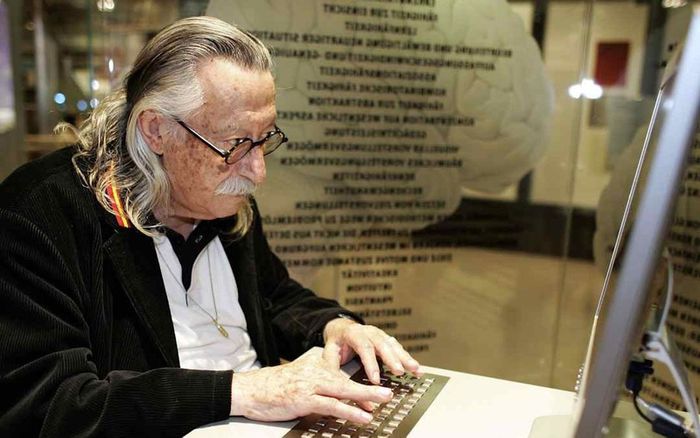

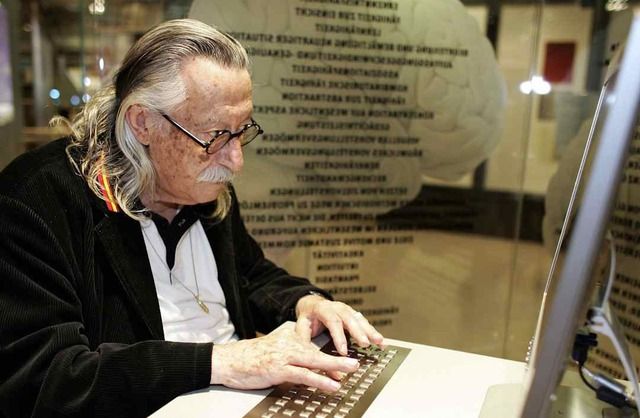

Weizenbaum đã qua đời năm 2008, nhưng di sản ông để lại không chỉ là dòng mã của ELIZA. Đó là lời nhắc nhở đanh thép rằng: Công nghệ không có lỗi, lỗi nằm ở sự yếu đuối của con người khi tìm kiếm sự thấu hiểu từ những vật thể vô tri. Như ông từng nói với bạn bè: 'Tôi không phê phán AI. Tôi phê phán xã hội'. Và có lẽ, xã hội mà ông phê phán chính là tấm gương phản chiếu chúng ta ngày hôm nay.