MLflow là một nền tảng mã nguồn mở hỗ trợ quản lý toàn bộ vòng đời học máy (ML lifecycle), từ lên ý tưởng, thử nghiệm, triển khai đến giám sát mô hình. Công cụ này giúp các nhóm Data Scientist và ML Engineer lưu trữ, tái tạo và tối ưu quy trình phát triển mô hình một cách hiệu quả và minh bạch.

MLflow là gì? Tổng quan về nền tảng MLOps mã nguồn mở

Machine Learning Lifecycle Platform là một nền tảng mã nguồn mở được phát triển bởi Databricks từ năm 2018, nhằm cung cấp giải pháp toàn diện cho quản lý vòng đời học máy. Từ khâu thử nghiệm, phát triển, triển khai đến giám sát mô hình, ML experiment tracking tool mang đến bộ công cụ chuẩn hóa quy trình MLOps cho cả cá nhân và tổ chức.

Mục tiêu cốt lõi của Machine Learning Lifecycle Platform là giúp các nhóm ML chuẩn hóa quy trình phát triển, giảm thiểu rủi ro mất thông số, thất lạc version, đồng thời tăng khả năng tái tạo và làm việc nhóm hiệu quả. Nền tảng bao gồm: Tracking (theo dõi thí nghiệm), Projects (đóng gói mã & môi trường), Models (lưu trữ, quản lý và phục vụ mô hình), và Model Registry (quản lý version model, phê duyệt và vòng đời).

Lợi ích của Machine Learning Lifecycle Platform trong machine learning là gì? Đó là giúp tăng tốc phát triển mô hình nhờ lưu trữ đầy đủ tham số và kết quả, đảm bảo khả năng tái tạo thí nghiệm, kiểm soát version và chủ động triển khai mô hình. Nền tảng còn giúp tiết kiệm thời gian khi chuyển giao dự án, hỗ trợ cộng tác nhóm, đồng thời dễ dàng tích hợp với các hệ thống hiện đại như cloud, Docker, Kubernetes, Databricks hoặc các framework ML phổ biến.

Các thành phần và chức năng chính của MLflow

Nền tảng được thiết kế gồm bốn thành phần chính, mỗi phần đảm nhiệm một vai trò riêng trong việc quản lý và tối ưu vòng đời học máy. Hiểu rõ từng thành phần là chìa khóa để khai thác tối đa sức mạnh của nền tảng trong các dự án thực tế.

Tracking: Theo dõi và quản lý thí nghiệm học máy

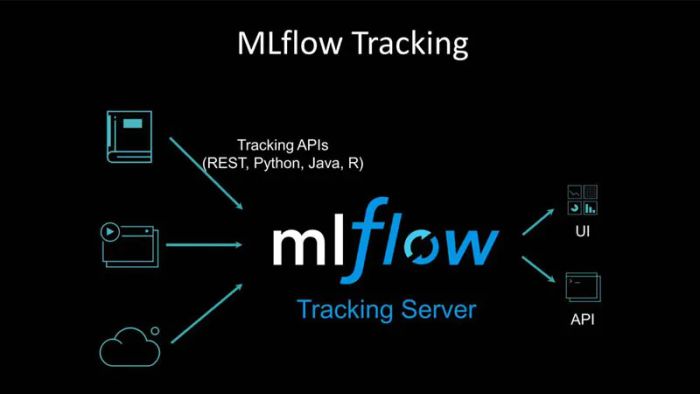

Tracking được xem là “trái tim” của nền tảng, giúp ghi lại, lưu trữ và so sánh toàn bộ thông số (parameters), chỉ số đánh giá (metrics) và artifacts (file, mô hình, log) của từng lần chạy mô hình (run). Điều này giúp giải quyết triệt để vấn đề: làm sao không bị “lạc mất” kết quả hoặc biết chính xác run nào cho ra model tốt nhất!

- UI: Nền tảng cung cấp giao diện web trực quan, cho phép xem và so sánh các run, lọc theo thông số hoặc metric, tải artifacts và trực quan hóa quá trình huấn luyện.

- Logging custom metrics: Người dùng có thể ghi lại mọi loại chỉ số như loss, accuracy, confusion matrix, ROC-AUC, thậm chí cả hình ảnh hoặc file CSV tùy ý.

- Best practices: Nên đặt tên experiment một cách logic, log đầy đủ thông số quan trọng, lưu model và code dưới dạng artifacts, đồng thời sử dụng tags để dễ tìm kiếm và phân tích.

- Local Tracking vs Remote Tracking Server: Ban đầu log được lưu trên local. Khi làm việc nhóm, có thể cấu hình mlflow remote tracking server (SQL backend, lưu trữ artifact trên S3, GCS, Azure…) để đồng bộ và cộng tác hiệu quả hơn.

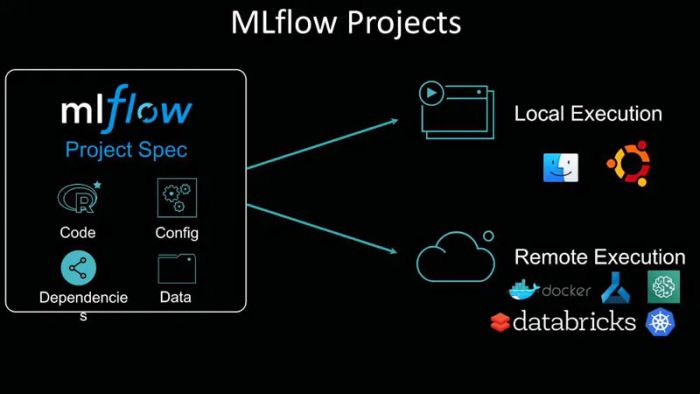

Projects: Đóng gói và tái tạo mã nguồn ML

Projects giúp chuẩn hóa cách đóng gói mã nguồn, môi trường và các dependency để đảm bảo mọi người đều có thể tái tạo kết quả thí nghiệm ở bất kỳ đâu. Mỗi project là một thư mục bao gồm mã nguồn, file MLproject (mô tả dự án và entry points), file conda.yaml (khai báo môi trường) hoặc Dockerfile.

- Tái tạo môi trường: Khi chạy mlflow run ., hệ thống sẽ tự động tạo environment (conda/docker), cài đặt dependencies và thực thi đúng entry point (ví dụ: train.py).

- Tích hợp với GitHub: Có thể trỏ trực tiếp đến repo GitHub hoặc file zip, hệ thống sẽ tự động clone và chạy code trong môi trường phù hợp.

- Ưu điểm: Giúp cộng tác nhóm dễ dàng hơn, tránh lỗi “chạy được trên máy tôi”, hỗ trợ CI/CD và tái tạo thí nghiệm chỉ bằng một dòng lệnh.

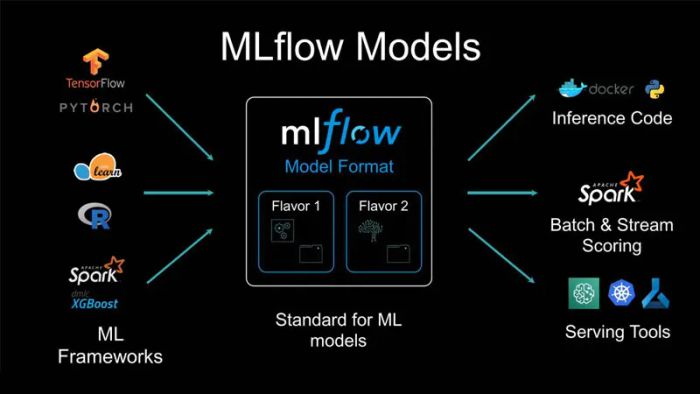

Models: Lưu trữ, Quản lý và Phục vụ Mô hình

Models là chuẩn đóng gói mô hình giúp lưu trữ, chia sẻ và triển khai (serving) mô hình ML một cách thuận tiện. Khi sử dụng mlflow.log_model(), mô hình sẽ được đóng gói theo chuẩn MLmodel kèm metadata như framework, flavor, version và dependencies…

- Đa dạng flavor: hỗ trợ nhiều framework như scikit-learn, PyTorch, TensorFlow, H2O, XGBoost, LightGBM, và cả custom python_function.

- Model serving: Chỉ với một lệnh models serve -m model_dir, bạn có thể tạo REST API để phục vụ model, đồng thời hỗ trợ tích hợp Flask, Docker, Kubernetes và cloud.

- Model deployment strategies: Cho phép triển khai lên production, cloud, serverless hoặc tích hợp CI/CD để cập nhật model tự động.

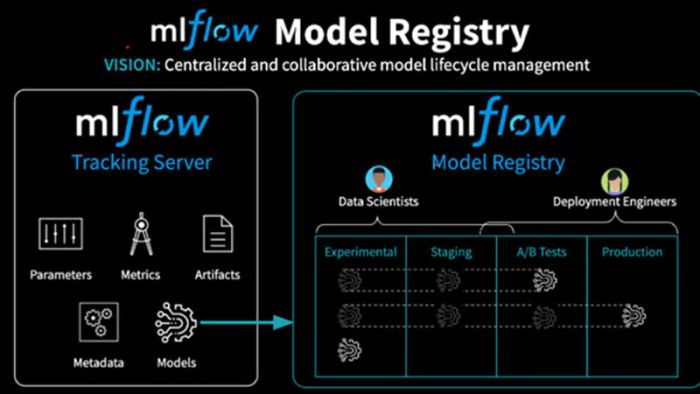

Model Registry: Quản lý version, phê duyệt và vòng đời model

Model Registry là nơi quản lý toàn bộ version của mô hình, lịch sử cập nhật, trạng thái (Staging, Production, Archived) và quy trình phê duyệt (approval). Đây được xem là “bộ não” điều phối vòng đời model chuyên nghiệp trong tổ chức.

- Tính năng chính: Cho phép đăng ký model mới, quản lý version, review, chuyển trạng thái (promotion/demotion), rollback model cũ, gắn tags và ghi chú cho từng version.

- Quy trình CI/CD ML: Kết hợp Model Registry giúp tự động hóa kiểm thử, phê duyệt và triển khai model an toàn, minh bạch.

- Phù hợp cho tổ chức: Hỗ trợ phân quyền, ghi log mọi hành động và kiểm soát model chặt chẽ trong môi trường production.

Cài đặt và khởi chạy Machine Learning Lifecycle Platform: Hướng dẫn từng bước

Bạn có thể install chỉ với vài dòng lệnh, hỗ trợ đa nền tảng và môi trường (local, cloud, Docker, Kubernetes). Dưới đây là hướng dẫn chi tiết từng bước để bắt đầu sử dụng:

- Cài đặt với pip: pip install (hỗ trợ Python 3.x). Với Conda: conda install -c conda-forge.

- Khởi động UI (server local): ui –port 5000 hoặc server để chạy tracking server với backend SQL/remote.

- Chạy bằng Docker: Sử dụng -docker hoặc docker-compose để triển khai nhanh, phù hợp cho team hoặc môi trường production.

- Hướng dẫn cài đặt trên Windows: Chỉ cần Python và pip là có thể cài đặt như trên. Nếu cần, có thể sử dụng Anaconda để quản lý môi trường dễ dàng hơn.

Tích hợp và triển khai MLflow với các công nghệ AI hiện đại

Machine Learning Lifecycle Platform không chỉ là một công cụ độc lập mà còn dễ dàng tích hợp với nhiều nền tảng, framework và dịch vụ cloud phổ biến. Điều này giúp mở rộng khả năng tự động hóa, triển khai và vận hành mô hình AI trong môi trường doanh nghiệp.

- Tích hợp với GitHub: Hỗ trợ tự động clone project, CI/CD cho thử nghiệm và deploy model trực tiếp từ repo (github).

- Hỗ trợ Docker & Kubernetes: Cho phép đóng gói và triển khai tracking server, model serving dễ dàng với docker, k8s hoặc on kubernetes.

- Tích hợp với framework ML: Tương thích scikit-learn, PyTorch, TensorFlow, HuggingFace, XGBoost, LightGBM… Cho phép log mọi loại model từ supervised learning đến deep learning, NLP và computer vision.

- Triển khai production: Hỗ trợ deploy model to production thông qua REST API, Flask, cloud server hoặc các nền tảng như Bitnami, Databricks, SageMaker…

- Tích hợp CI/CD: Kết hợp Jenkins, GitHub Actions, GitLab CI để tự động hóa kiểm thử, build và deploy model theo pipeline chuyên nghiệp.

Tài liệu và nguồn học tập MLflow cho data scientist

Để làm chủ ML experiment tracking tool, bạn nên tham khảo các tài liệu chính thức và các hướng dẫn thực hành dưới đây:

- Tutorial: Các tutorial chính thức cung cấp ví dụ thực tế cho từng thành phần.

- Documentation: Tài liệu tổng quan bao gồm API, command-line, best practices và cấu hình nâng cao.

- : Các hướng dẫn trên kênh giúp bạn học nhanh hơn qua thực hành .

- Data Scientist: Có thể tham khảo notebook, example trên GitHub, Kaggle hoặc cộng đồng để học từ các dự án thực tế.

So sánh MLflow với Kubeflow, DVC và các công cụ MLOps khác

Machine Learning Lifecycle Platform và Machine Learning Toolkit for Kubernetes là hai giải pháp MLOps phổ biến nhưng có triết lý và ưu điểm khác nhau. Dưới đây là bảng so sánh nhanh giúp bạn lựa chọn phù hợp:

| Tiêu chí | MLflow | Kubeflow | DVC |

| Dễ cài đặt & sử dụng | Rất dễ, chỉ 1-2 dòng lệnh | Khá phức tạp, cần k8s | Dễ, chủ yếu quản lý data/code |

| Quản lý thí nghiệm | Rất mạnh (Tracking UI, logging) | Có, nhưng phức tạp hơn | Có, nhưng không trực quan |

| Quản lý model lifecycle | Đầy đủ (Registry, version, deployment) | Đầy đủ, tích hợp CI/CD mạnh | Chưa hỗ trợ rõ ràng |

| Tích hợp cloud/CI/CD | Tốt, đa dạng, linh hoạt | Xuất sắc, cloud-native | Hỗ trợ Git tốt, cloud hạn chế |

| Phù hợp | Mọi quy mô, dễ mở rộng | Doanh nghiệp lớn, cloud-native | Dự án cá nhân, data versioning |

Quản lý và tùy chỉnh ML model management system nâng cao

Khi triển khai ML model management system ở quy mô tổ chức, cần chú ý các vấn đề nâng cao sau:

- Authentication: Bảo mật tracking server bằng cơ chế xác thực như OAuth2, Basic Auth, hoặc tích hợp SSO…

- Cấu hình database backend: Lưu trữ log, run và model vào PostgreSQL, MySQL hoặc cloud SQL để tăng khả năng mở rộng và chia sẻ.

- Lưu trữ artifact: Sử dụng S3, GCS hoặc Azure Blob thay vì local để đảm bảo an toàn, backup và truy cập đa nền tảng.

- Check version: Sử dụng –version để kiểm tra phiên bản hiện tại và cập nhật khi cần.

- Quản lý phân quyền: Thiết lập phân quyền người dùng và nhóm trong Registry và Tracking UI nhằm bảo vệ dữ liệu và kiểm soát hoạt động.

Câu hỏi thường gặp

ML model management system có cần cài đặt phức tạp không?

Không! Chỉ cần một lệnh pip install hoặc conda install là bạn có thể sử dụng trên local. Với team hoặc production, có thể triển khai dễ dàng qua Docker, Kubernetes hoặc cloud.

ML model management system hỗ trợ framework ML nào?

ML model management system tương thích với hầu hết các framework phổ biến như scikit-learn, PyTorch, TensorFlow, XGBoost, LightGBM, Keras, HuggingFace,… và cả custom model (python_function).

Làm thế nào để triển khai model với MLflow?

Chỉ cần log model bằng .log_model() và sử dụng lệnh models serve để tạo REST API. Bạn cũng có thể tích hợp serving với Flask, Docker hoặc triển khai lên cloud/Kubernetes tùy nhu cầu.

Làm thế nào để lưu artifact/model trên cloud?

Bạn chỉ cần thiết lập storage backend (S3, GCS hoặc Azure Blob) khi khởi động server, ML model management system sẽ tự động lưu artifact/model lên cloud, đảm bảo an toàn và thuận tiện truy cập từ nhiều vị trí.